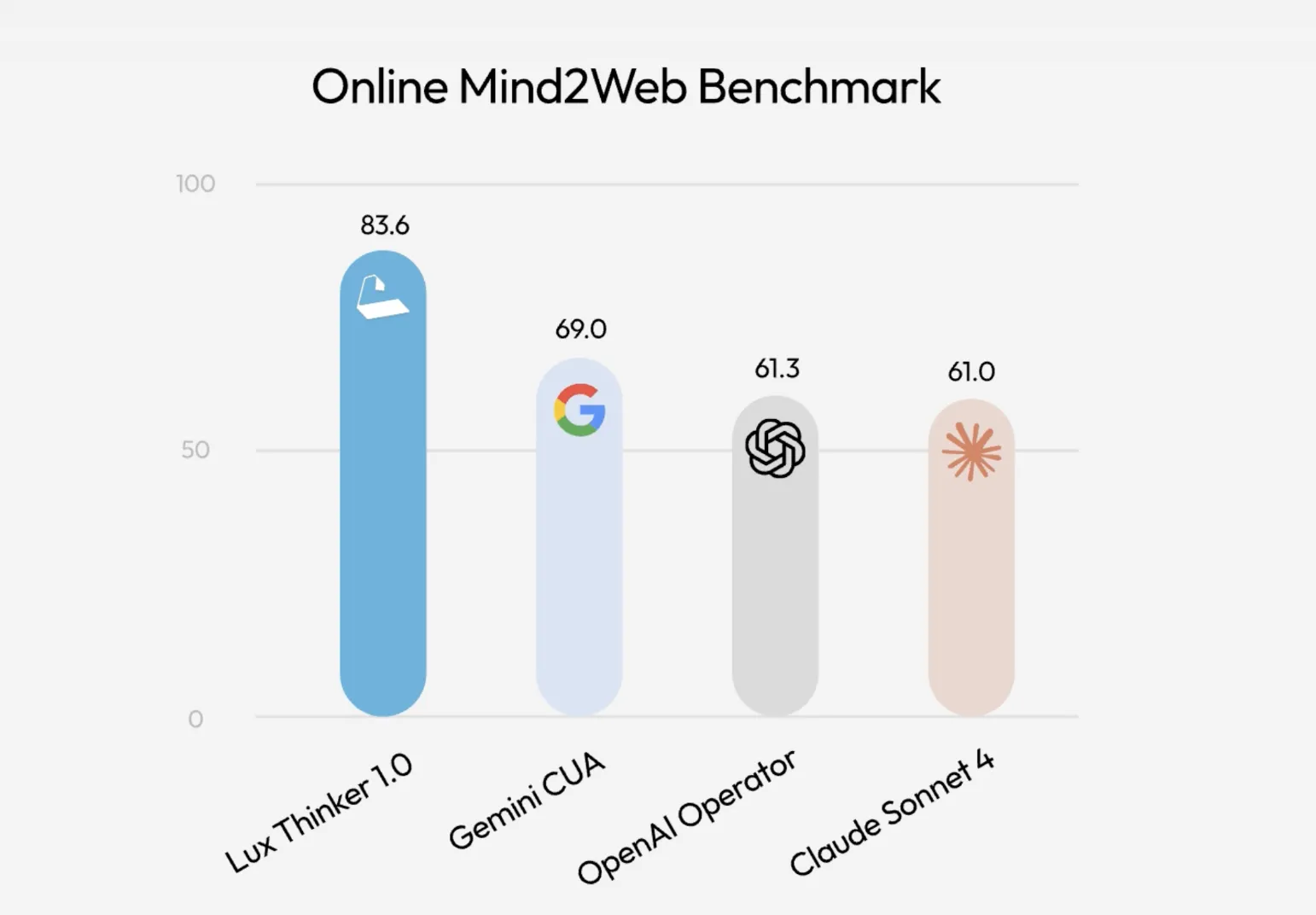

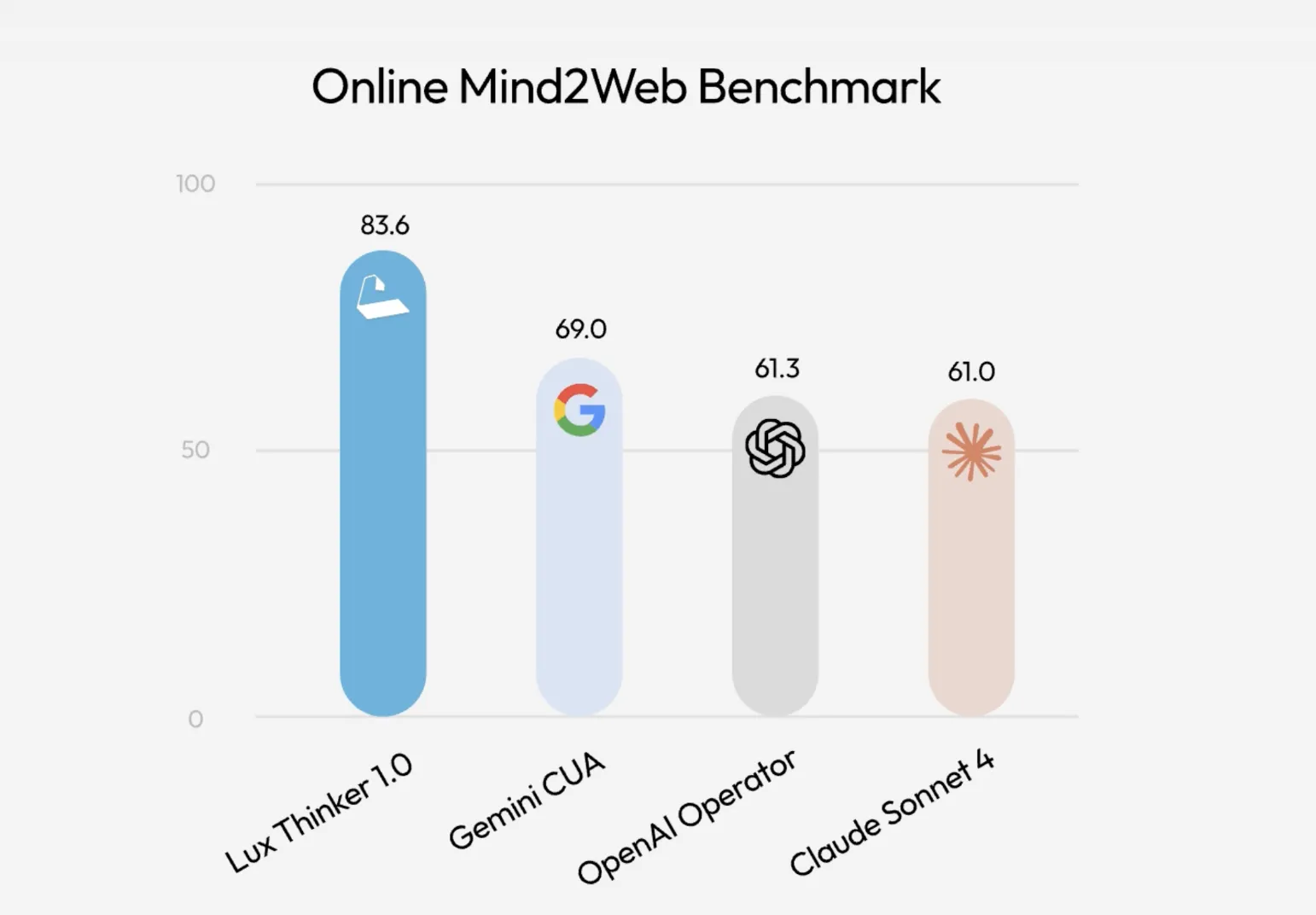

Wie verwandeln Sie langsame, manuelle Klickvorgänge über Browser und Desktops hinweg in ein zuverlässiges, automatisiertes System, das einen Laptop tatsächlich in großem Umfang für Sie nutzen kann? Lux ist das jüngste Beispiel für den Übergang von Computernutzungsagenten von der Forschungsdemo zur Infrastruktur. Das Staff der OpenAGI Basis hat veröffentlicht Luxein Basismodell, das echte Desktops und Browser betreibt und einen Wert von 83,6 im On-line Mind2Web-Benchmark meldet, der mehr als 300 reale Computernutzungsaufgaben abdeckt. Dies liegt vor Google Gemini CUA mit 69,0, OpenAI Operator mit 61,3 und Anthropic Claude Sonnet 4 mit 61,0.

Was macht Lux eigentlich?

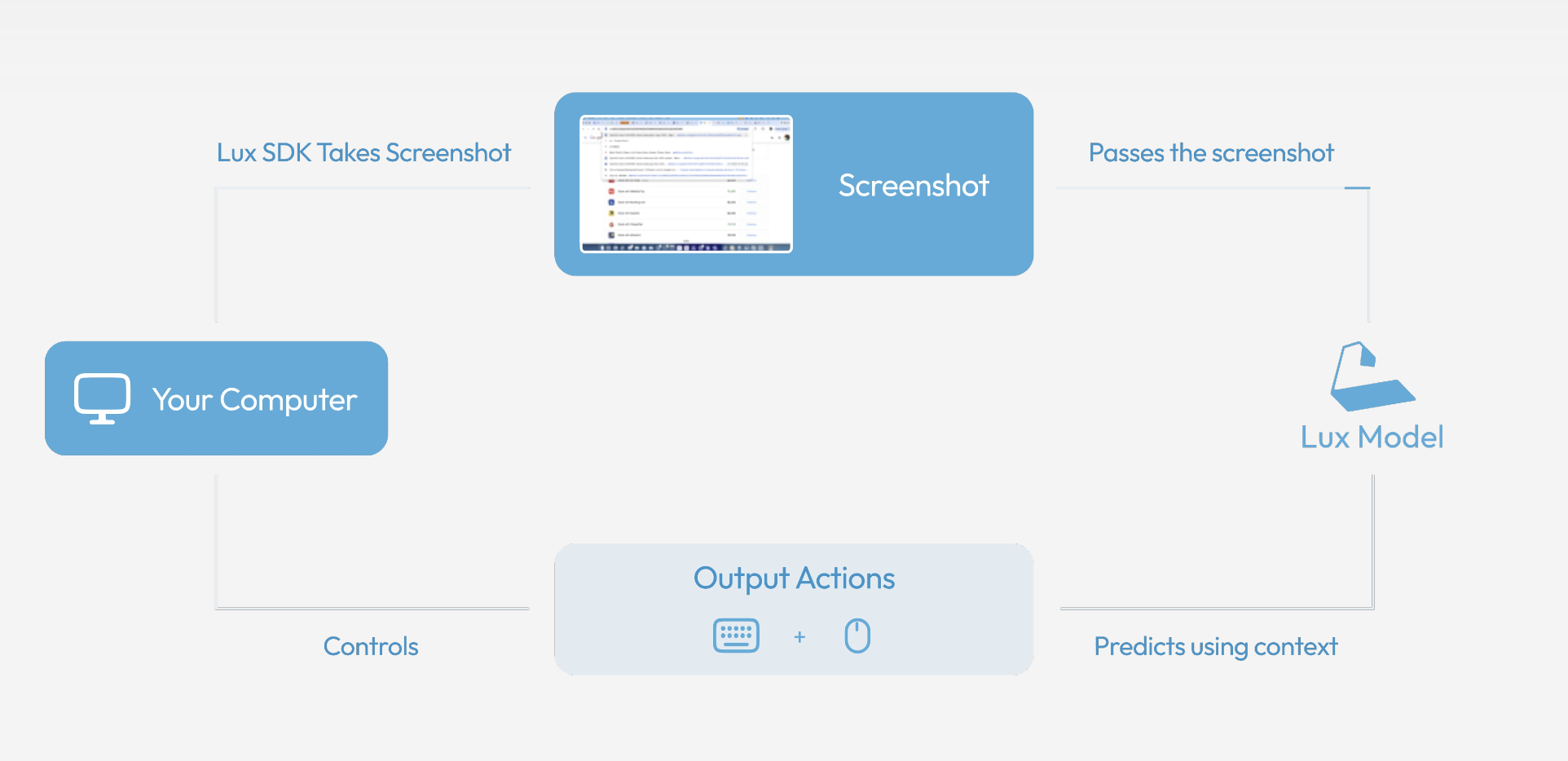

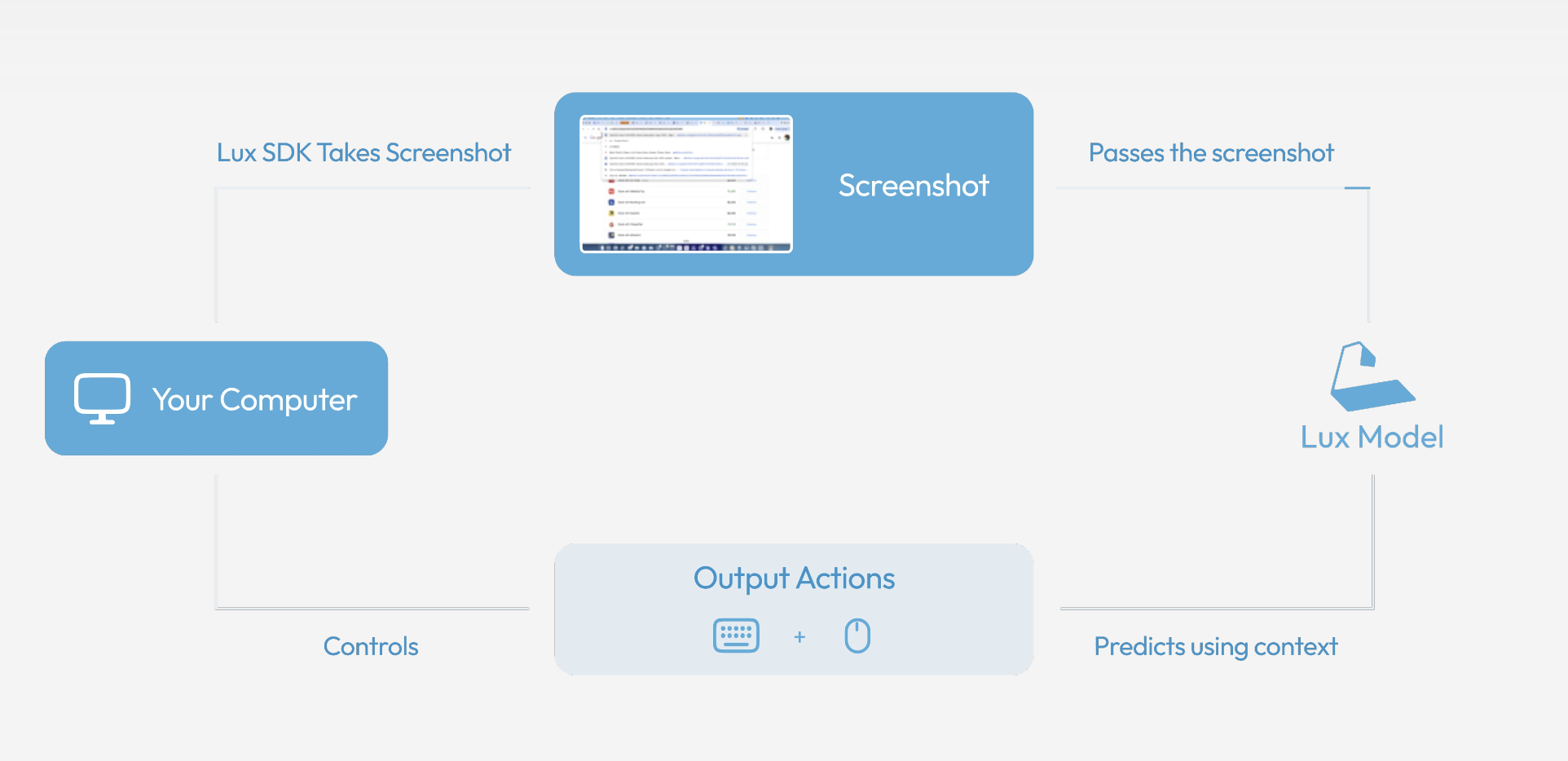

Lux ist ein Computernutzungsmodell, kein Chat-Modell mit einem Browser-Plugin. Es benötigt ein Ziel in natürlicher Sprache, zeigt den Bildschirm an und gibt Aktionen auf niedriger Ebene wie Klicks, Tastendrücke und Scroll-Ereignisse aus. Es kann Browser, Editoren, Tabellenkalkulationen, E-Mail-Purchasers und andere Desktop-Anwendungen steuern, da es auf der gerenderten Benutzeroberfläche und nicht auf anwendungsspezifischen APIs funktioniert.

Aus Entwicklersicht ist Lux über erhältlich OpenAGI SDK und API-Konsole. Das Forschungsteam beschreibt Zielarbeitslasten, die Software program-QA-Abläufe, umfassende Forschungsläufe, Social-Media-Administration, On-line-Store-Betrieb und Massendateneingabe umfassen. In all diesen Einstellungen muss der Agent Dutzende oder Hunderte von UI-Aktionen sequenzieren und dabei an einer Aufgabenbeschreibung in natürlicher Sprache festhalten.

Drei Ausführungsmodi für unterschiedliche Kontrollebenen

Lux wird mit geliefert drei Ausführungsmodi die unterschiedliche Kompromisse zwischen Geschwindigkeit, Autonomie und Kontrolle aufdecken.

Schauspielermodus ist der schnelle Weg. Es dauert etwa 1 Sekunde professional Schritt und ist auf klar spezifizierte Aufgaben wie das Ausfüllen eines Formulars, das Abrufen eines Berichts aus einem Dashboard oder das Extrahieren einer kleinen Reihe von Feldern aus einer Seite ausgerichtet. Betrachten Sie es als eine Makro-Engine mit geringer Latenz, die dennoch natürliche Sprache versteht.

Denkermodus Bewältigt vage oder mehrstufige Ziele. Es zerlegt die übergeordnete Anweisung in kleinere Unteraufgaben und führt diese dann aus. Zu den Arbeitslasten gehören beispielsweise mehrseitige Recherchen, die Sortierung langer E-Mail-Warteschlangen oder die Navigation auf Analyseoberflächen, bei denen der genaue Klickpfad nicht im Voraus festgelegt wird.

Tasker-Modus gibt maximalen Determinismus. Der Aufrufer stellt eine explizite Python-Liste von Schritten bereit, die Lux nacheinander ausführt und wiederholt, bis die Sequenz abgeschlossen ist oder ein schwerwiegender Fehler auftritt. Dadurch können Groups Aufgabendiagramme, Leitplanken und Fehlerrichtlinien in ihrem eigenen Code behalten und gleichzeitig die UI-Kontrolle an das Modell delegieren.

Tasker, Actor und Thinker sind die drei Hauptmodi für prozedurale Arbeitsabläufe, schnelle Ausführung und komplexe Ziellösung.

Benchmarks, Latenz und Kosten

Auf On-line Mind2Web erreicht Lux eine Erfolgsquote von 83,6 Prozent. Der gleiche Benchmark meldet 69,0 Prozent für Gemini CUA, 61,3 Prozent für OpenAI Operator und 61,0 Prozent für Claude Sonnet 4. Der Benchmark enthält mehr als 300 webbasierte Aufgaben, die von realen Diensten gesammelt wurden, und ist daher ein nützlicher Proxy für praktische Agenten, die Browser und Internet-Apps steuern.

Latenz und Kosten sind die entscheidenden Zahlen für Entwicklungsteams. Das OpenAGI-Staff berichtet, dass Lux jeden Schritt in etwa 1 Sekunde abschließt, während OpenAI Operator bei derselben Bewertungseinstellung etwa 3 Sekunden professional Schritt benötigt. Das Forschungsteam gibt außerdem an, dass Lux professional Token etwa zehnmal günstiger ist als Operator. Für jeden Agenten, der problemlos Hunderte von Schritten in einer Sitzung ausführen kann, bestimmen diese konstanten Faktoren, ob eine Arbeitslast in der Produktion realisierbar ist.

Agentic Energetic Pre-Coaching und warum OSGym wichtig ist?

Lux wird mit einer Methode trainiert, die das OpenAGI-Forschungsteam nennt Agentic Energetic Pre-Coaching. Das Staff stellt dies einem Customary-Sprachmodell-Vortraining gegenüber, bei dem Textual content passiv aus dem Web aufgenommen wird. Die Idee ist, dass Lux lernt, indem es in digitalen Umgebungen agiert und sein Verhalten durch groß angelegte Interaktion verfeinert, anstatt nur den Verlust von Token-Vorhersagen in statischen Protokollen zu minimieren. Das Optimierungsziel unterscheidet sich vom klassischen Reinforcement Studying und ist so angelegt, dass es die selbstgesteuerte Erkundung und das Verständnis anstelle einer manuell gestalteten Belohnung fördert.

Dieses Trainingssetup hängt von einer Daten-Engine ab, die viele Betriebssystemumgebungen parallel verfügbar machen kann. Das OpenAGI-Staff hat diese Engine bereits als Open Supply bereitgestellt OSGym, unter einer MIT-Lizenz, die sowohl Forschung als auch kommerzielle Nutzung erlaubt. OSGym führt vollständige Betriebssystemrepliken aus, nicht nur Browser-Sandboxen, und unterstützt Aufgaben, die Bürosoftware, Browser, Entwicklungstools und Arbeitsabläufe mit mehreren Anwendungen umfassen.

Wichtige Erkenntnisse

- Lux ist ein grundlegendes Computernutzungsmodell, das vollständige Desktops und Browser betreibt und beim On-line Mind2Web-Benchmark einen Erfolg von 83,6 Prozent erreicht, vor Gemini CUA, OpenAI Operator und Claude Sonnet-4.

- Lux stellt 3 Modi zur Verfügung, Schauspieler, Denker und Taskerdie UI-Makros mit geringer Latenz, mehrstufige Zielzerlegung und deterministische Skriptausführung für Produktionsworkflows abdecken.

- Berichten zufolge läuft Lux etwa 1 Sekunde professional Schritt und ist professional Token etwa zehnmal günstiger als OpenAI Operator, was für Agenten mit langem Horizont wichtig ist, die Hunderte von Aktionen professional Aufgabe ausführen.

- Lux wird mit dem Agentic Energetic Pre-Coaching trainiert, bei dem das Modell lernt, indem es in Umgebungen agiert, anstatt nur statischen Webtext zu konsumieren, der auf robustes Bildschirm-zu-Aktion-Verhalten statt auf reine Sprachmodellierung abzielt.

- OSGym, die Open-Supply-Daten-Engine hinter Lux, kann mehr als 1.000 Betriebssystemrepliken ausführen und mehr als 1.400 Multiturn-Trajektorien professional Minute zu geringen Kosten professional Replikat generieren, was Groups eine praktische Möglichkeit bietet, ihre eigenen Laptop-Nutzungsagenten zu schulen und zu bewerten.

Schauen Sie sich das an Offizielle Ankündigung, Projekt Und Repo. Schauen Sie sich gerne bei uns um GitHub-Seite für Tutorials, Codes und Notebooks. Sie können uns auch gerne weiter folgen Twitter und vergessen Sie nicht, bei uns mitzumachen 100.000+ ML SubReddit und Abonnieren Unser E-newsletter. Warten! Bist du im Telegram? Jetzt können Sie uns auch per Telegram kontaktieren.

Michal Sutter ist ein Knowledge-Science-Experte mit einem Grasp of Science in Knowledge Science von der Universität Padua. Mit einer soliden Grundlage in statistischer Analyse, maschinellem Lernen und Datentechnik ist Michal hervorragend darin, komplexe Datensätze in umsetzbare Erkenntnisse umzuwandeln.