Bild vom Autor

# Einführung

Die KI-Bildbearbeitung hat rasante Fortschritte gemacht. Instruments wie ChatGPT und Gemini haben gezeigt, wie leistungsfähig KI für kreative Arbeit sein kann, und viele Menschen fragen sich, wie dies die Zukunft des Grafikdesigns verändern wird. Gleichzeitig verbessern sich Open-Supply-Bildbearbeitungsmodelle rasch und schließen die Qualitätslücke.

Mit diesen Modellen können Sie Bilder mithilfe einfacher Texteingaben bearbeiten. Mit minimalem Aufwand können Sie Hintergründe entfernen, Objekte ersetzen, Fotos verbessern und künstlerische Effekte hinzufügen. Was früher fortgeschrittene Designfähigkeiten erforderte, kann jetzt in wenigen Schritten erledigt werden.

In diesem Weblog stellen wir fünf Open-Supply-KI-Modelle vor, die sich durch Bildbearbeitung auszeichnen. Sie können sie je nach Arbeitsablauf und Bedarf lokal ausführen, über eine API verwenden oder direkt im Browser darauf zugreifen.

# 1. FLUX.2 (klein) 9B

FLUX.2 (klein) ist ein leistungsstarkes Open-Supply-Bildgenerierungs- und -bearbeitungsmodell, das auf Geschwindigkeit, Qualität und Flexibilität ausgelegt ist. Es wurde von Black Forest Labs entwickelt und vereint Bilderzeugung und Bildbearbeitung in einer einzigen kompakten Architektur, die eine Finish-to-Finish-Inferenz in weniger als einer Sekunde auf Shopper-{Hardware} ermöglicht.

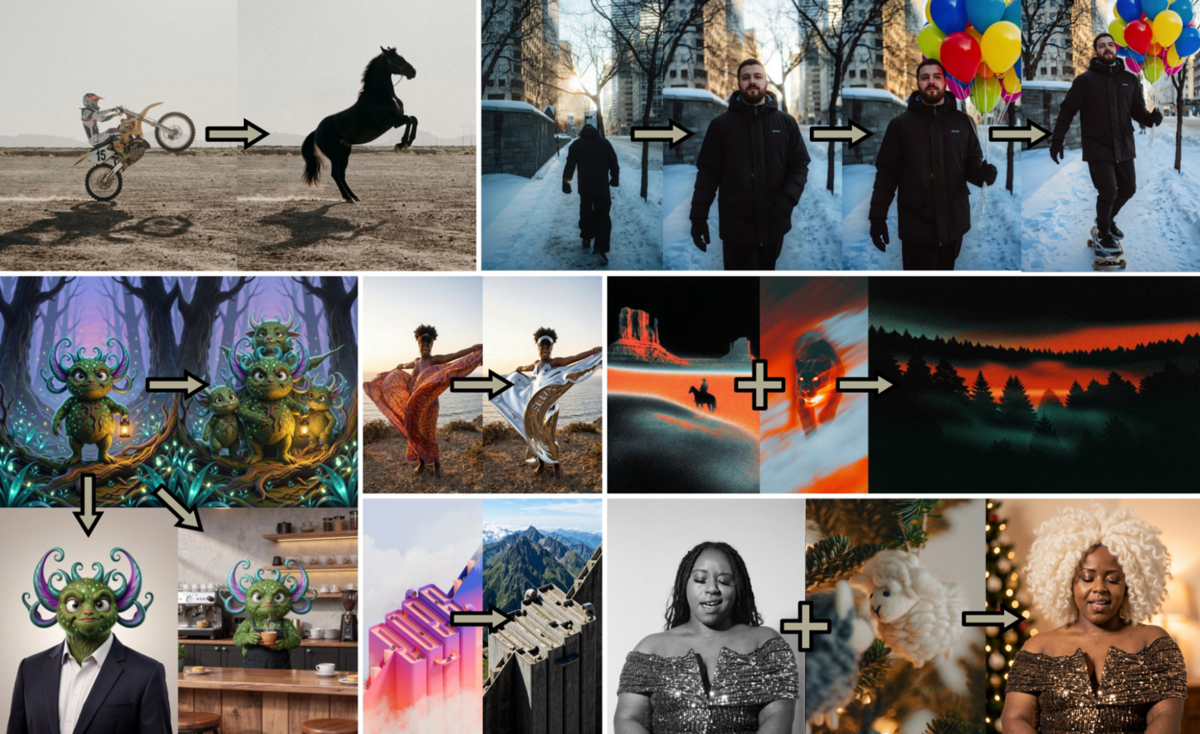

Das FLUX.2 (klein) 9B-Basismodell ist ein undestilliertes Basismodell mit voller Kapazität, das die Textual content-zu-Bild-Generierung und die Bildbearbeitung mit mehreren Referenzen unterstützt und sich daher intestine für Forscher, Entwickler und Kreative eignet, die eine genaue Kontrolle über die Ausgaben wünschen, anstatt sich auf stark destillierte Pipelines zu verlassen.

Hauptmerkmale:

- Einheitliche Generierung und Bearbeitung: Erledigt Textual content-zu-Bild- und Bildbearbeitungsaufgaben innerhalb einer einzigen Modellarchitektur.

- Undestilliertes Grundierungsmodell: Behält das volle Trainingssignal bei und bietet so mehr Flexibilität, Kontrolle und Ausgabevielfalt.

- Unterstützung für die Bearbeitung mehrerer Referenzen: Ermöglicht Bildbearbeitungen anhand mehrerer Referenzbilder für präzisere Ergebnisse.

- Optimiert für den Echtzeiteinsatz: Bietet modernste Qualität mit sehr geringer Latenz, selbst auf Shopper-GPUs.

- Offene Gewichte und Feinabstimmung bereit: Entwickelt für LoRA-Schulungen, Forschung und benutzerdefinierte Pipelines, mit Kompatibilität mit Instruments wie Diffusers und ComfyUI.

# 2. Qwen-Picture-Edit-2511

Qwen-Picture-Edit-2511 ist ein fortschrittliches Open-Supply-Bildbearbeitungsmodell, das auf hohe Konsistenz und Präzision ausgerichtet ist. Es wurde von Alibaba Cloud als Teil der Qwen-Modellfamilie entwickelt und basiert auf Qwen-Picture-Edit-2509 mit erheblichen Verbesserungen bei Bildstabilität, Zeichenkonsistenz und Strukturgenauigkeit.

Das Modell ist für komplexe Bildbearbeitungsaufgaben wie Bearbeitungen durch mehrere Personen, Industriedesign-Workflows und geometriebewusste Transformationen konzipiert und lässt sich dennoch einfach über Diffusoren und browserbasierte Instruments wie Qwen Chat integrieren.

Hauptmerkmale:

- Verbesserte Bild- und Zeichenkonsistenz: Reduziert Bilddrift und bewahrt die Identität bei Einzel- und Mehrpersonenbearbeitungen.

- Bearbeitung mehrerer Bilder und mehrerer Personen: Ermöglicht die hochwertige Fusion mehrerer Referenzbilder zu einem kohärenten Endergebnis.

- Integrierte LoRA-Integration: Enthält von der Neighborhood erstellte LoRAs direkt im Basismodell und schaltet erweiterte Effekte ohne zusätzliche Einrichtung frei.

- Industriedesign- und Engineering-Unterstützung: Optimiert für Produktdesignaufgaben wie Materialaustausch, Chargendesign und Strukturänderungen.

- Erweitertes geometrisches Denken: Unterstützt geometriebezogene Bearbeitungen, einschließlich Konstruktionslinien und Designanmerkungen für technische Anwendungsfälle.

# 3. FLUX.2 (Entwickler) Turbo

FLUX.2 (Entwickler) Turbo ist ein leichter Hochgeschwindigkeits-Bildgenerierungs- und -bearbeitungsadapter, der die Inferenzzeit ohne Qualitätseinbußen drastisch verkürzen soll.

Er wurde von Black Forest Labs als destillierter LoRA-Adapter für das Basismodell FLUX.2 (dev) entwickelt und ermöglicht qualitativ hochwertige Ausgaben in nur acht Inferenzschritten. Dies macht es zu einer hervorragenden Wahl für Echtzeitanwendungen, Speedy Prototyping und interaktive Bild-Workflows, bei denen es auf Geschwindigkeit ankommt.

Hauptmerkmale:

- Ultraschnelle 8-stufige Inferenz: Ermöglicht eine bis zu sechsmal schnellere Generierung im Vergleich zum standardmäßigen 50-Schritte-Workflow.

- Qualität erhalten: Entspricht oder übertrifft die visuelle Qualität des Originalmodells FLUX.2 (dev) trotz starker Destillation.

- LoRA-basierter Adapter: Leicht und einfach mit minimalem Overhead in bestehende FLUX.2-Pipelines einzubinden.

- Unterstützung für Textual content-zu-Bild und Bildbearbeitung: Funktioniert sowohl für Generierungs- als auch Bearbeitungsaufgaben in einem einzigen Setup.

- Breite Ökosystemunterstützung: Verfügbar über gehostete APIs, Diffusoren und ComfyUI für versatile Bereitstellungsoptionen.

# 4. LongCat-Bildbearbeitung

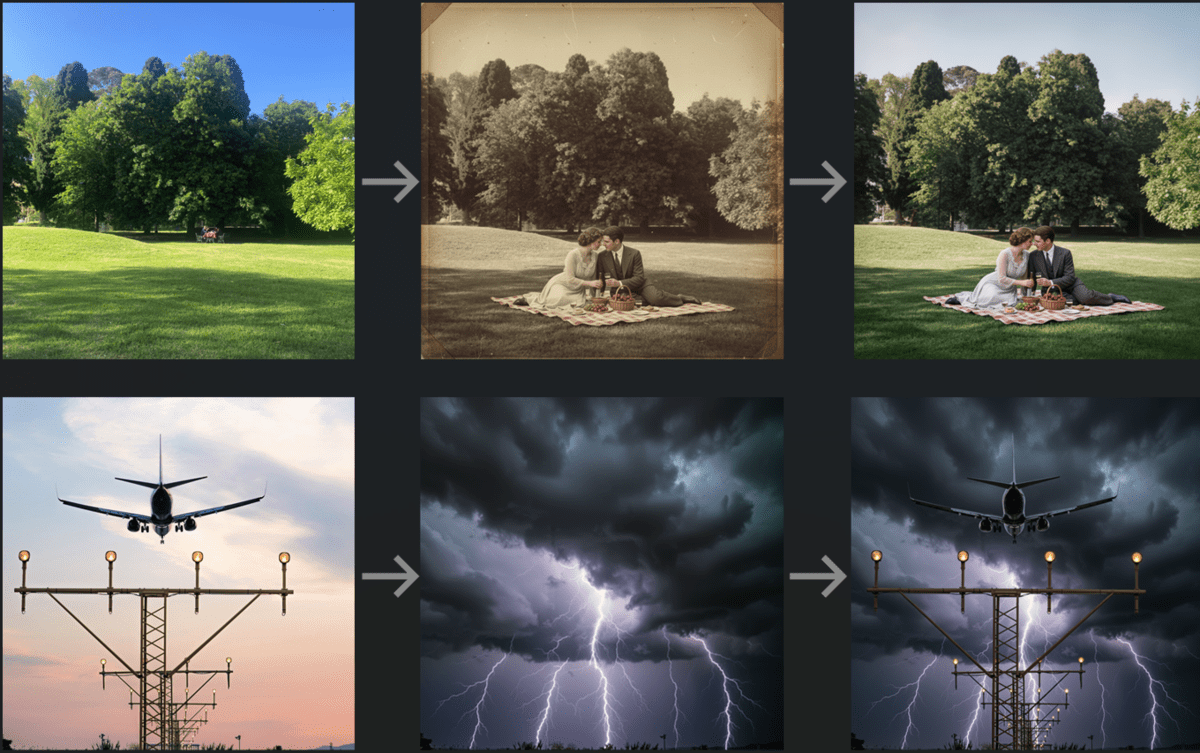

LongCat-Bildbearbeitung ist ein hochmodernes Open-Supply-Bildbearbeitungsmodell, das für hochpräzise, anweisungsgesteuerte Bearbeitungen mit starker visueller Konsistenz entwickelt wurde. Es wurde von Meituan als Gegenstück zur Bildbearbeitung zu LongCat-Picture entwickelt und unterstützt die zweisprachige Bearbeitung in Chinesisch und Englisch.

Das Modell zeichnet sich dadurch aus, dass es komplexe Bearbeitungsanweisungen befolgt und gleichzeitig nicht bearbeitete Bereiche beibehält, was es besonders effektiv für mehrstufige und referenzgesteuerte Bildbearbeitungs-Workflows macht.

Hauptmerkmale:

- Präzise anleitungsbasierte Bearbeitung: Unterstützt globale Bearbeitungen, lokale Bearbeitungen, Textmodifikationen und referenzgesteuerte Bearbeitungen mit ausgeprägtem semantischen Verständnis.

- Starke Konsistenzerhaltung: Behält Format, Textur, Farbton und Motividentität in nicht bearbeiteten Bereichen bei, auch über mehrere Bearbeitungen hinweg.

- Unterstützung für zweisprachige Bearbeitung: Verarbeitet sowohl chinesische als auch englische Eingabeaufforderungen und ermöglicht so eine breitere Zugänglichkeit und Anwendungsfälle.

- Modernste Open-Supply-Leistung: Liefert SOTA-Ergebnisse unter Open-Supply-Bildbearbeitungsmodellen mit verbesserter Inferenzeffizienz.

- Optimierung der Textwiedergabe: Verwendet eine spezielle Kodierung auf Zeichenebene für zitierten Textual content und ermöglicht so eine genauere Textgenerierung in Bildern.

# 5. Schritt 1X-Bearbeiten-v1p2

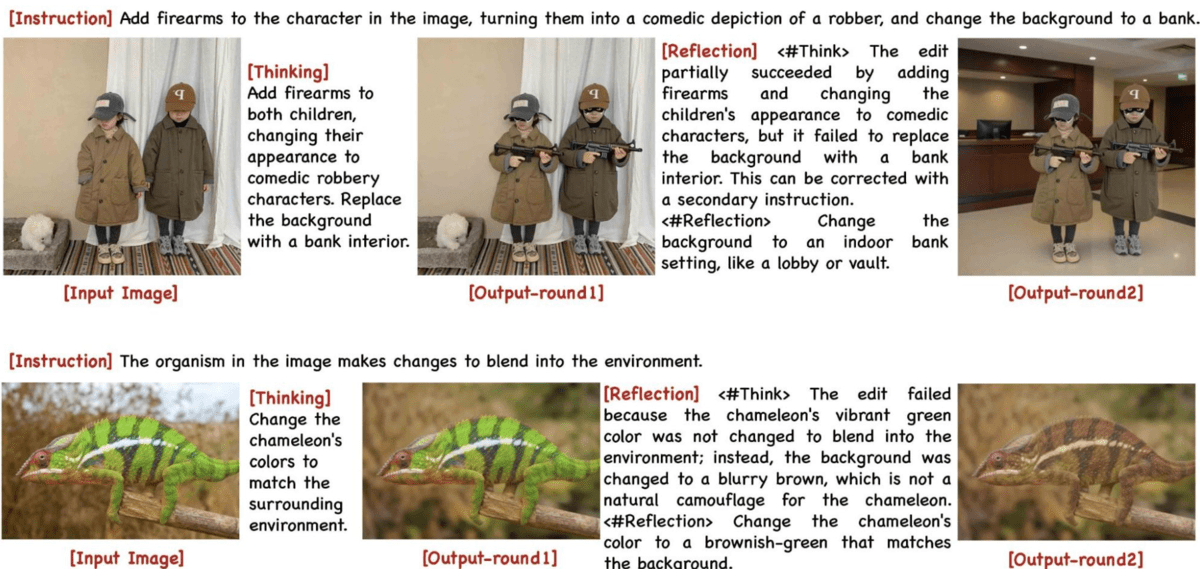

Schritt 1X-Bearbeiten-v1p2 ist ein auf Argumenten basierendes Open-Supply-Bildbearbeitungsmodell, das das Verständnis von Anweisungen und die Bearbeitungsgenauigkeit verbessern soll. Es wurde von StepFun AI entwickelt und führt durch Strukturierung native Denkfähigkeiten ein Denken Und Spiegelung Mechanismen. Dadurch kann das Modell komplexe oder abstrakte Bearbeitungsanweisungen interpretieren, Änderungen sorgfältig anwenden und dann die Ergebnisse überprüfen und korrigieren, bevor die Ausgabe finalisiert wird.

Dadurch erreicht Step1X-Edit-v1p2 eine starke Leistung bei Benchmarks wie KRIS-Bench und GEdit-Bench, insbesondere in Szenarien, die präzise, mehrstufige Bearbeitungen erfordern.

Hauptmerkmale:

- Argumentationsgesteuerte Bildbearbeitung: Verwendet explizite Denk- und Reflexionsphasen, um Anweisungen besser zu verstehen und unbeabsichtigte Änderungen zu reduzieren.

- Starke Benchmark-Leistung: Liefert wettbewerbsfähige Ergebnisse auf KRIS-Bench und GEdit-Bench unter den Open-Supply-Bildbearbeitungsmodellen.

- Verbessertes Unterrichtsverständnis: Hervorragend im Umgang mit abstrakten, detaillierten oder mehrteiligen Bearbeitungsaufforderungen.

- Reflexionsbasierte Korrektur: Überprüft bearbeitete Ausgaben, um Fehler zu beheben und zu entscheiden, wann die Bearbeitung abgeschlossen ist.

- Forschungsorientiert und erweiterbar: Entwickelt zum Experimentieren, mit mehreren Modi, die Geschwindigkeit, Genauigkeit und Argumentationstiefe abwägen.

# Letzte Gedanken

Open-Supply-Bildbearbeitungsmodelle entwickeln sich schnell weiter und bieten Kreativen und Entwicklern ernsthafte Alternativen zu geschlossenen Instruments. Sie vereinen jetzt Geschwindigkeit, Konsistenz und feinkörnige Steuerung, sodass sich die erweiterte Bildbearbeitung einfacher experimentieren und einsetzen lässt.

Die Modelle im Überblick:

- FLUX.2 (klein) 9B konzentriert sich auf hochwertige Generierung und versatile Bearbeitung in einem einzigen, unverfälschten Grundmodell.

- Qwen-Picture-Edit-2511 zeichnet sich durch konsistente, strukturbewusste Bearbeitungen aus, insbesondere in Mehrpersonen- und designlastigen Szenarien.

- FLUX.2 (Entwickler) Turbo LoRA legt großen Wert auf Geschwindigkeit und liefert überzeugende Ergebnisse in Echtzeit mit minimalen Inferenzschritten.

- LongCat-Bildbearbeitung zeichnet sich durch präzise, anweisungengesteuerte Bearbeitungen aus und bewahrt gleichzeitig die visuelle Konsistenz über mehrere Runden hinweg.

- Schritt 1X-Bearbeiten-v1p2 treibt die Bildbearbeitung weiter voran, indem Argumente hinzugefügt werden, sodass das Modell komplexe Bearbeitungen durchdenken kann, bevor es sie abschließt.

Abid Ali Awan (@1abidaliawan) ist ein zertifizierter Datenwissenschaftler, der gerne Modelle für maschinelles Lernen erstellt. Derzeit konzentriert er sich auf die Erstellung von Inhalten und das Schreiben technischer Blogs zu maschinellem Lernen und Datenwissenschaftstechnologien. Abid verfügt über einen Grasp-Abschluss in Technologiemanagement und einen Bachelor-Abschluss in Telekommunikationstechnik. Seine Imaginative and prescient ist es, ein KI-Produkt mithilfe eines graphischen neuronalen Netzwerks für Schüler mit psychischen Erkrankungen zu entwickeln.