Google hat gerade die Artwork und Weise geändert, wie Entwickler recherchieren. Am 21. April 2026 starteten sie Deep Analysis Max. Es läuft weiter Gemini 3.1 Professional und ist nicht nur ein weiteres Chatbot-Improve. Dies ist ein autonomer KI-Forschungsagent. Es plant, sucht, liest, begründet und schreibt alles über einen einzigen API-Aufruf. Am Ende erhalten Sie einen vollständig zitierten Bericht zurück.

Wenn Sie KI-Apps erstellen, ist dieser Leitfaden genau das Richtige für Sie. Sie werden verstehen, wie es funktioniert, es einrichten und noch heute Ihre erste Forschungsaufgabe ausführen.

Was ist Deep Analysis Max?

Deep Analysis Max fungiert als Forschungsanalyst, der über eine Anwendungsprogrammierschnittstelle arbeitet. Wenn Sie eine schwierige Anfrage stellen, erstellt das System eine Recherchestrategie, mit der es On-line-Recherchen durchführt und Ihre Dokumente analysiert, bevor ein referenziertes Dokument erstellt wird.

Google führte Deep Analysis im Dezember 2025 mit einfacher Zusammenfassung und begrenzten Funktionen, fehlender Visualisierung, externen Integrationen und Zugriff auf non-public Daten ein. Die Model vom April 2026 markiert ein großes Improve.

Deep Analysis Max läuft auf Gemini 3.1 Professional und erreicht 77,1 % auf ARC-AGI-2, mehr als das Doppelte der Leistung von Gemini 3 Professional, und erweitert seine Argumentationsfähigkeiten um autonome Forschung.

Was ist der Unterschied zwischen Deep Analysis und Deep Analysis Max?

Google hat mit Deep Analysis zwei Agenten ausgeliefert, nicht einen. Ihr Arbeitsablauf benötigt eine Bewertung, da er die Auswahl des geeigneten Agenten erfordert.

- Der Commonplace Tiefgründige Forschung Agent (

deep-research-preview-04-2026) ist auf Geschwindigkeit ausgelegt. Das Modell erzielt schnellere Ergebnisse, indem es weniger Abfragen durchsucht und weniger Token verarbeitet. Das System funktioniert, wenn Benutzer am entfernten Betrachtungsort sitzen. Interaktive Dashboards, Chat-Oberflächen und schnelle Suchfunktionen veranschaulichen die Verwendung. - Tiefe Forschung max (

deep-research-max-preview-04-2026) ist auf Tiefe ausgelegt. Das System führt kontinuierlich eine Testzeitberechnung durch, bis ein umfassender Bericht erstellt wird. Verwenden Sie es für Hintergrundjobs. Das System übernimmt Arbeiten, die eine nächtliche Auswertung, eine Analyse der Wettbewerbsbedingungen am Markt und eine Literaturrecherche erfordern.

Hier ist der Vergleich, der zählt:

| Besonderheit | Tiefgründige Forschung | Tiefe Forschung max |

|---|---|---|

| Optimiert für | Geschwindigkeit und geringe Latenz | Maximale Tiefe und Vollständigkeit |

| Bester Anwendungsfall | Interaktive Benutzeroberflächen, Dashboards | Batch-Jobs über Nacht, Due Diligence |

| Suchanfragen/Aufgabe | ~80 | ~160 |

| Eingabetoken/Aufgabe | ~250K | ~900K |

| Kosten professional Aufgabe | 1 $ – 3 $ | 3 – 5 $ |

| Typischer Abschluss | 5 – 10 Min | 10 – 20 Min |

Hauptmerkmale von Deep Analysis Max

- MCP bot spezialisierte Lösungen an: Zur Verknüpfung proprietärer Daten aus FactSet, S&P, PitchBook oder unternehmenseigenem Materials. Es kann extern bereitgestellte Internetinformationen durch native Diagramme und Infografiken ergänzen oder ersetzen.

- Kollaborative Planung: Jetzt haben Sie eine bessere Kontrolle darüber, wie Ihr Forschungsplan ausgeführt wird, indem Sie den Forschungsplan vor der Ausführung überprüfen und genehmigen.

- Erweiterte Werkzeugausstattung: Die gemeinsame Verwendung mehrerer Instruments, z. B. Suchtools, MCPDateispeicherung, Code, URL usw. verbessern die Forschung und fördern die Compliance.

- Multimodale Erdung: Analysieren Sie Formate wie PDF(s), CSV(s), Bilder, Audio und Video neben Webinformationen.

- Echtzeit-Streaming: Zeigen Sie alle aktuellen Fortschritte, Zwischenprodukte und resultierenden Produkte gleichzeitig und in Echtzeit an.

Wie funktioniert Deep Analysis Max?

Deep Analysis Max geht nicht vom Traditionellen aus generate_content Endpunkt. Stattdessen soll es ausschließlich über die Interactions API ausgeführt werden, eine relativ neue, zustandsbehaftete API, die für die Ausführung lang andauernder Hintergrundarbeiten entwickelt wurde.

Wenn Sie eine Eingabeaufforderung senden, passieren die folgenden Dinge:

- Sie übermitteln Ihre Forschungsfrage an die API mit dem

background=TrueChoice und erhalten Sie sofort eine Interaktions-ID. Ihre Bewerbung kann dann mit der Arbeit fortfahren, die sie zuvor ausgeführt hat. - Der KI-Agent Wir nehmen Ihre Frage auf und unterteilen sie in Unterfragen, legen fest, welche Instruments eingesetzt werden sollen, und erstellen einen vollständigen Rechercheplan, bevor wir uns mit einer Quelle befassen.

- Der KI-Agent führt die Suchabfragen durch (normalerweise etwa 80 für eine normale Aufgabe, bis zu 160 für MAX). Die Ergebnisse der Abfragen werden gründlich analysiert, um Wissenslücken zu identifizieren.

- Hier glänzt MAX; Der KI-Agent durchläuft die Recherche mehrmals. Es führt keine einmalige Recherche durch und hört dann auf. Es wird die Forschung erneut fortsetzen und dabei eine Vielzahl von Quellen nutzen, um jede Forschungsphase durchzuführen und die bisherigen Forschungsergebnisse zu überprüfen oder ihnen zu widersprechen.

- Schließlich konsolidiert der KI-Agent alle Recherchen in einem strukturierten Bericht, der zitiert wird. Wenn die Daten dies erfordern, werden im Bericht auch Inline-Diagramme und -Grafiken enthalten sein.

- An diesem Punkt fragen Sie den Standing der Interaktion ab. Wenn eine Interaktion anzeigt, dass sie abgeschlossen ist, erhalten Sie Ihre Ergebnisse. Der gesamte Prozess ist asynchron, was bedeutet, dass Ihre Anwendung nicht blockiert wird.

Erste Schritte mit Deep Analysis Max

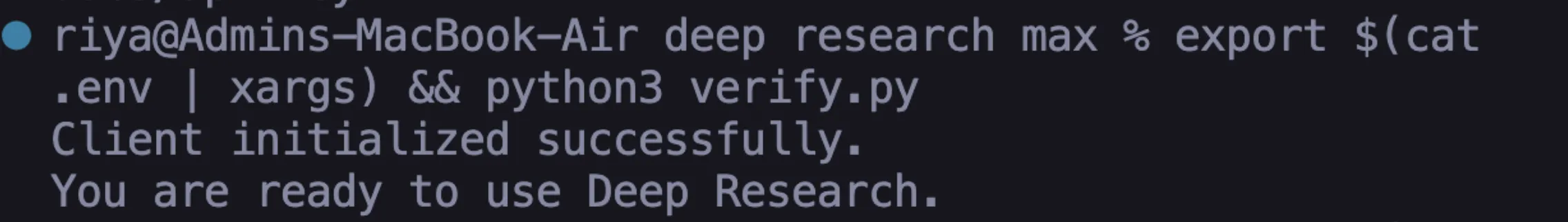

Sie benötigen drei Elemente, um mit der Arbeit am Forschungscode zu beginnen: einen Gemini-API-Schlüssel, das Python SDK und eine Umgebungsvariable. Dieser Vorgang dauert etwa fünf Minuten.

1. Im ersten Schritt müssen Sie Ihre erwerben Gemini-API-Schlüssel.

2. Im zweiten Schritt müssen Sie das installieren Python-SDK. Sobald Sie Python installiert haben, können Sie die offizielle Google GenAI-Clientbibliothek installieren, indem Sie diesen Befehl ausführen:

pip set up google-genai Bei der Systeminstallation müssen Benutzer warten, bis der Installationsvorgang abgeschlossen ist.

3. Im dritten Schritt müssen Sie Ihre Umgebungsvariable festlegen. Ihr SDK ruft Ihren API-Schlüssel automatisch aus einer Umgebungsvariablen ab. Stellen Sie es in Ihrer Terminalsitzung wie folgt ein:

export GEMINI_API_KEY="your-api-key-here"Sie müssen ersetzen Ihr-API-Schlüssel-hier mit dem tatsächlichen Schlüssel, von dem Sie kopiert haben Google AI Studio. Benutzer sollten den Set-Befehl in Home windows anstelle von Export verwenden.

4. Im vierten Schritt müssen Sie alle Systemkomponenten auf ordnungsgemäße Funktion überprüfen. Erstellen Sie eine neue Datei mit dem Namen verifizieren.py in Ihrem Projektordner. Fügen Sie diesen Code hinzu:

from google import genai

shopper = genai.Consumer()

print("Consumer initialized efficiently.")

print("You're prepared to make use of Deep Analysis.")5. Führen Sie den Befehl über Ihr Terminal aus:

python confirm.pyIhre Umgebung ist vollständig vorbereitet, wenn Sie mit beiden Erfolgsmeldungen Erfolg haben.

6. Möglicherweise liegt ein Fehler bei der API-Schlüsselauthentifizierung vor, der darauf zurückzuführen ist, dass die Einrichtung Ihrer API-Schlüsselauthentifizierung falsch ist. Sie müssen bestätigen, dass die Einrichtung Ihrer API-Schlüsselauthentifizierung korrekt ist. Deep Analysis ist im kostenlosen Kontingent nicht verfügbar.

Aufgabe 1: Ihre erste Forschungsaufgabe

Hier erstellen Sie Ihre erste eigenständige Forschungsaufgabe. In dieser Aufgabe lernen Sie die drei Kernmuster kennen, die mit dem Senden einer Eingabeaufforderung, dem Abfragen des Standing und dem Abrufen des Endergebnisses verbunden sind.

Schritt 1: Erstellen Sie das Skript

Sie erstellen eine neue Datei mit dem Namen „first_research.py“, die Ihren Agenten auffordert, Recherchen zur Regulierung künstlicher Intelligenz in Europa durchzuführen. Sie können jedoch gerne das Thema Ihrer Forschung ändern.

import time

from google import genai

shopper = genai.Consumer()

interplay = shopper.interactions.create(

enter="Analysis the present state of AI regulation within the European Union.",

agent="deep-research-preview-04-2026",

background=True

)

print(f"Analysis began. Interplay ID: {interplay.id}") Bitte beachten Sie die beiden wichtigen Werte. agent stellt den KI-Agenten dar, den die API zur Durchführung von Recherchen verwendet. Wir verwenden den standardmäßigen Deep Analysis-Agenten, da dieser Daten schneller abruft. Der background=True Der Parameter muss angegeben werden, da die Anforderung fehlschlägt, wenn er nicht verfügbar ist. Die Forschung erfolgt stets asynchron über Deep Analysis.

Schritt 2: Erstellen Sie die Abfrageschleife

Die API gibt Ihre Interaktions-ID schnell zurück. Ihre Aufgabe ist es, regelmäßig nachzuschauen, bis die Recherche abgeschlossen ist. Fügen Sie Ihren Umfragecode unter Ihrem Erstellungscode hinzu.

whereas True:

interplay = shopper.interactions.get(interplay.id)

if interplay.standing == "accomplished":

print("n--- Analysis Full ---n")

print(interplay.outputs(-1).textual content)

break

elif interplay.standing == "failed":

print(f"Analysis failed: {interplay.error}")

break

print("Nonetheless researching...", flush=True)

time.sleep(10)Es überprüft alle 10 Sekunden seinen Standing und druckt nach Abschluss den gesamten Bericht aus. Wenn etwas fehlschlägt, wird „Fehler“ ausgegeben.

Schritt 3: Skript ausführen

python first_research.pyIn Ihrem Terminalfenster sollte mehrmals der Satz „Noch recherchieren…“ angezeigt werden. Die meisten Arbeiten dauern zwischen 5 und 15 Minuten. Wenn alle Arbeiten abgeschlossen sind, erhalten Sie einen vollständig zusammengestellten Forschungsbericht, der vollständig zitiert wird.

Schritt 4: Überprüfen Sie die Ausgabe

Nehmen Sie sich Zeit, den Bericht durchzusehen und achten Sie darauf, wie der Agent die Recherche anhand logischer Abschnitte organisiert hat. Nach jedem Anspruch sehen Sie einen Verweis auf die Quelle, die der Agent zum Vervollständigen dieses Abschnitts des Berichts verwendet hat. Sie haben gerade das geschafft, wofür ein Mensch Dutzende Stunden zum Lesen und Schreiben gebraucht hätte.

Aufgabe 2: Native Visualisierungen generieren

Mit Deep Analysis Max können Sie Visualisierungen (Diagramme) direkt aus Ihren Daten erstellen, ohne auf Bibliotheken von Drittanbietern zurückgreifen zu müssen, indem Sie den Agenten verwenden, um automatisch visuelle Berichte zu erhalten.

Schritt 1: Alle Diagramme im Bericht generieren:

import time

from google import genai

shopper = genai.Consumer()

immediate = """

Analysis the highest 10 programming languages by job demand in 2026.

Embody in your report:

- A bar chart evaluating job postings throughout languages

- A development line displaying development over the previous 3 years

- A comparability desk with wage ranges

Generate all charts natively inline.

"""

interplay = shopper.interactions.create(

enter=immediate,

agent="deep-research-max-preview-04-2026",

background=True

)

print(f"Visible analysis began. ID: {interplay.id}")Erstellen visual_research.py mit einer Aufforderung zum Anfordern von Diagrammen – die Aufforderung sollte den Satz „Alle Diagramme nativ inline generieren“ enthalten, um den Agenten aufzufordern, eine HTML- oder Nano-Bananen-Visualisierung zu erstellen, die direkt in den Bericht eingebettet wird.

Schritt 2: Ergebnisse abfragen und als HTML-Datei speichern

whereas True:

interplay = shopper.interactions.get(interplay.id)

if interplay.standing == "accomplished":

with open("visual_report.html", "w") as f:

f.write(interplay.outputs(-1).textual content)

print("Saved to visual_report.html")

break

elif interplay.standing == "failed":

print(f"Failed: {interplay.error}")

break

time.sleep(10)Schritt 3: Öffnen Sie visual_report.html in einem Webbrowser

Der Agent hat die Diagramme direkt auf der Seite erstellt: Nein MatplotlibNEIN Plotlykeine JavaScript-Diagrammbibliotheken, der Agent hat diese alle als Teil der Berichtsausgabe erstellt.

Dies ist für automatisierte Berichtspipelines äußerst vorteilhaft. Der Bericht kann ohne zusätzliche Nachbearbeitung sofort geteilt werden.

Greatest Practices für die Produktion

Beim Übergang von Laborskripten zu Produktionscode sind einige Änderungen erforderlich:

- Anstatt Ihren Hauptserver mithilfe einer Whereas-Schleife abzufragen, verwenden Sie eine Jobwarteschlangenarchitektur. Akzeptieren Sie die Anfrage über Cloud Run, speichern Sie dann die Interaktions-ID in einer Datenbank und überprüfen Sie die Ergebnisse mit Cloud Scheduler oder einem Cronjob. Auf diese Weise bleibt Ihr Server auch bei hohem Datenverkehr reaktionsfähig.

- Behalten Sie Interaktions-IDs und Ereignis-IDs bei. Bei 20-minütigen Rechercheaufgaben kommt es häufig zu Verbindungsabbrüchen. Beharren Sie immer darauf

interaction_idUndlast_event_idvom Streaming. Durch die erneute Verbindung mitshopper.interactions.get()Mithilfe der beibehaltenen IDs können Sie dort weitermachen, wo Sie aufgehört haben. - Schreiben Sie spezifische Aufforderungen, um die Kosten zu kontrollieren. Allgemeine Eingabeaufforderungen führen zu einer umfassenden Suche, die mehr Token und Zeit erfordert als die Verwendung einer spezifischen und klar definierten Eingabeaufforderung.

- Cache wann immer möglich. Ein Deep Analysis Max-Bericht kann zwischen 3 und 5 US-Greenback kosten. Wenn Benutzer additionally viele ähnliche Fragen haben, sollten Sie diese Ergebnisse zwischenspeichern. Für die Bereitstellung aus dem Cache fallen nur sehr geringe Betriebskosten an.

- Überprüfen Sie Zitate immer. Der Agent stellt seine Zitate bereit, aber es ist eine Lektüre des offenen Webs. Bei kritischen Geschäftsentscheidungen empfiehlt es sich, die wichtigsten Behauptungen stichprobenartig anhand von Originalquellen zu überprüfen; deshalb: „Vertrauen, aber überprüfen.“

Lohnt sich die Verwendung von Deep Analysis Max?

Deep Analysis Max entspricht nicht dem Commonplace KI-Chatbots dass wir es gewohnt sind. Mit Deep Analysis Max geben Sie der Maschine eine Aufgabe, lassen sie in Ruhe und schauen später noch einmal nach, um einen vollständigen Bericht zu erhalten (wie Sie es bei einer Einzelperson tun würden). Sie müssen der KI nicht mehr mehrere Eingabeaufforderungen geben, um die richtige Antwort zu erhalten.

Es ist auch von Vorteil, alles an einem Ort zu haben. Deep Analysis Max kann für Sie nachschlagen; Nutzen Sie Ihre Daten (sofern verfügbar) und erstellen Sie Diagramme ohne zusätzlichen Aufwand Ihrerseits. Ich möchte Sie ermutigen, Deep Analysis Max etwas Kleines für Sie erledigen zu lassen, damit Sie sehen, wie intestine es funktioniert, bevor Sie den Arbeitsaufwand erhöhen, für den Sie es verwenden.

Häufig gestellte Fragen

A. Es handelt sich um einen autonomen KI-Agenten, der vollständig zitierte Berichte plant, sucht, analysiert und generiert.

A. Verwenden Sie es für tiefergehende, längere und umfassendere Forschungsaufgaben.

A. Ja, es erstellt native Inline-Diagramme und visuelle Berichte ohne externe Bibliotheken.

Melden Sie sich an, um weiterzulesen und von Experten kuratierte Inhalte zu genießen.