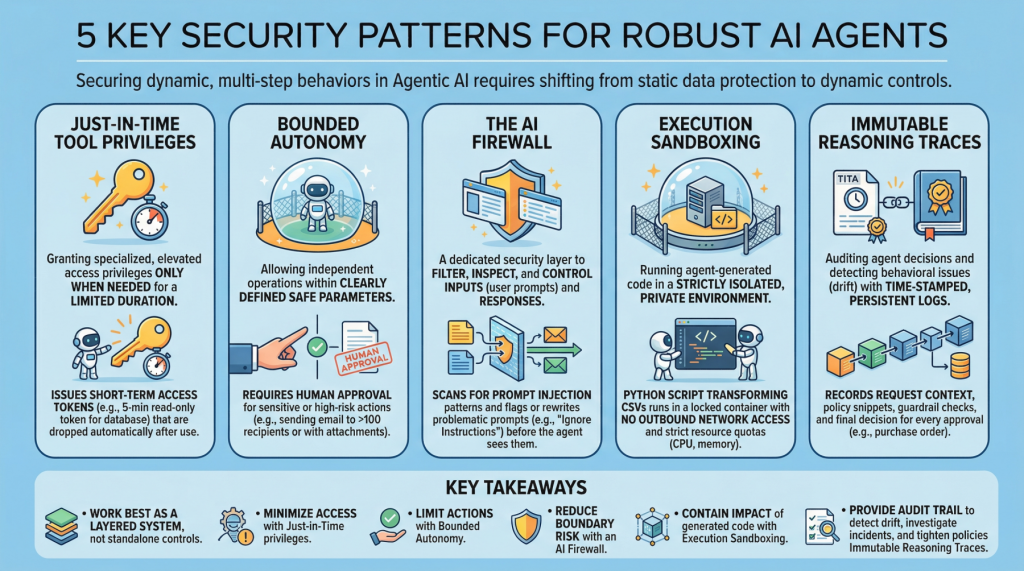

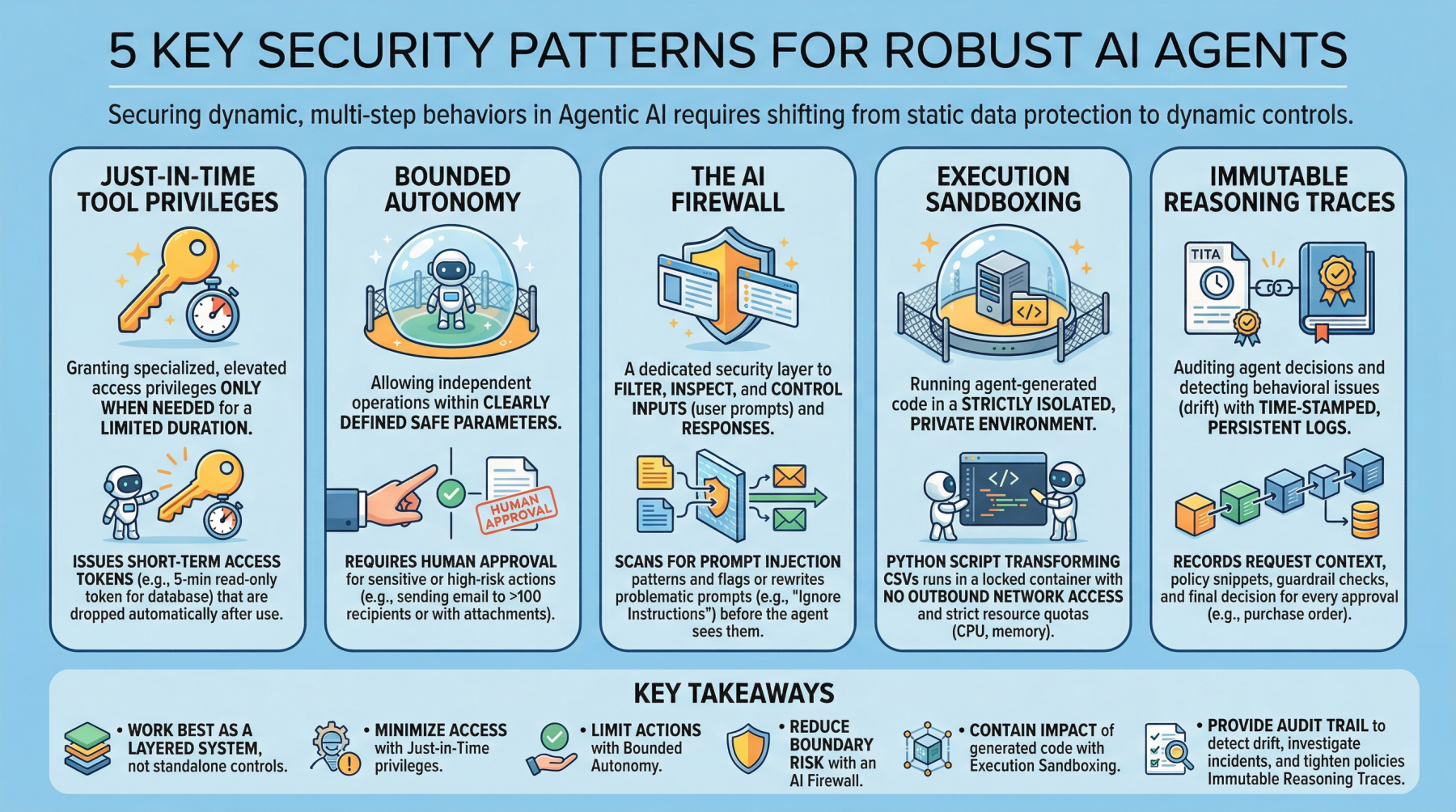

5 wesentliche Sicherheitsmuster für robuste Agenten-KI

Bild vom Herausgeber

Einführung

Agentische KIdas sich um autonome Softwareeinheiten, sogenannte Agenten, dreht, hat die KI-Landschaft verändert und viele ihrer sichtbarsten Entwicklungen und Tendencies in den letzten Jahren beeinflusst, darunter Anwendungen, die auf generativen und Sprachmodellen basieren.

Mit jeder großen Technologiewelle wie der Agenten-KI entsteht die Notwendigkeit, diese Systeme zu sichern. Dies erfordert eine Umstellung vom statischen Datenschutz hin zum Schutz dynamischer, mehrstufiger Verhaltensweisen. Dieser Artikel listet 5 wichtige Sicherheitsmuster für robuste KI-Agenten auf und zeigt, warum sie wichtig sind.

1. Simply-in-Time-Software-Berechtigungen

Dies wird oft als JIT abgekürzt und ist ein Sicherheitsmodell, das Benutzern oder Anwendungen nur bei Bedarf und nur für einen begrenzten Zeitraum spezielle oder erhöhte Zugriffsrechte gewährt. Dies steht im Gegensatz zu klassischen, dauerhaften Privilegien, die bestehen bleiben, sofern sie nicht manuell geändert oder widerrufen werden. Im Bereich der Agenten-KI wäre ein Beispiel die Ausgabe kurzfristiger Zugriffstoken, um den „Explosionsradius“ zu begrenzen, wenn der Agent kompromittiert wird.

Beispiel: Bevor ein Agent einen Abrechnungsabgleichsjob ausführt, fordert er ein eng begrenztes, schreibgeschütztes 5-Minuten-Token für eine einzelne Datenbanktabelle an und löscht das Token automatisch, sobald die Abfrage abgeschlossen ist.

2. Begrenzte Autonomie

Dieses Sicherheitsprinzip ermöglicht es KI-Agenten, innerhalb einer begrenzten Umgebung, d. h. innerhalb klar definierter sicherer Parameter, unabhängig zu agieren und so ein Gleichgewicht zwischen Kontrolle und Effizienz herzustellen. Dies ist besonders wichtig in Hochrisikoszenarien, in denen katastrophale Fehler bei vollständiger Autonomie vermieden werden können, indem für wise Aktionen die Zustimmung eines Menschen erforderlich ist. In der Praxis wird dadurch eine Kontrollebene geschaffen, um Risiken zu reduzieren und Compliance-Anforderungen zu unterstützen.

Beispiel: Ein Agent kann ausgehende E-Mails selbst entwerfen und planen, aber jede Nachricht an mehr als 100 Empfänger (oder mit Anhängen) wird vor dem Senden zur Genehmigung an einen Menschen weitergeleitet.

3. Die KI-Firewall

Damit ist eine dedizierte Sicherheitsschicht gemeint, die Eingaben (Benutzeraufforderungen) und nachfolgende Reaktionen filtert, prüft und steuert, um KI-Systeme zu schützen. Es trägt zum Schutz vor Bedrohungen wie Immediate-Injection, Datenexfiltration und toxischen oder richtlinienverletzenden Inhalten bei.

Beispiel: Eingehende Eingabeaufforderungen werden auf Eingabeaufforderungsmuster überprüft (z. B. Aufforderungen, frühere Anweisungen zu ignorieren oder Geheimnisse preiszugeben), und markierte Eingabeaufforderungen werden entweder blockiert oder in eine sicherere Kind umgeschrieben, bevor der Agent sie sieht.

4. Ausführungs-Sandboxing

Nehmen Sie eine streng isolierte, non-public Umgebung oder einen Netzwerkperimeter und führen Sie darin jeglichen vom Agenten generierten Code aus: Dies wird als Ausführungs-Sandboxing bezeichnet. Es trägt dazu bei, unbefugten Zugriff, Ressourcenerschöpfung und potenzielle Datenschutzverletzungen zu verhindern, indem es die Auswirkungen einer nicht vertrauenswürdigen oder unvorhersehbaren Ausführung eindämmt.

Beispiel: Ein Agent, der ein Python-Skript zur Transformation von CSV-Dateien schreibt, führt es in einem gesperrten Container ohne ausgehenden Netzwerkzugriff, strengen CPU-/Speicherkontingenten und einer schreibgeschützten Bereitstellung der Eingabedaten aus.

5. Unveränderliche Argumentationsspuren

Diese Vorgehensweise unterstützt die Prüfung autonomer Agentenentscheidungen und die Erkennung von Verhaltensproblemen wie Drift. Dazu gehört die Erstellung zeitgestempelter, manipulationssicherer und dauerhafter Protokolle, die die Eingaben des Agenten, wichtige Zwischenartefakte, die für die Entscheidungsfindung verwendet werden, und Richtlinienprüfungen erfassen. Dies ist ein entscheidender Schritt in Richtung Transparenz und Rechenschaftspflicht für autonome Systeme, insbesondere in wichtigen Anwendungsbereichen wie Beschaffung und Finanzen.

Beispiel: Für jede Bestellung, die der Agent genehmigt, zeichnet er den Anfragekontext, die abgerufenen Richtlinienausschnitte, die angewendeten Leitplankenprüfungen und die endgültige Entscheidung in einem einmal beschreibbaren Protokoll auf, das bei Audits unabhängig überprüft werden kann.

Wichtige Erkenntnisse

Diese Muster funktionieren am besten als mehrschichtiges System und nicht als eigenständige Steuerelemente. Simply-in-Time-Software-Berechtigungen minimieren den Zugriff, auf den ein Agent jederzeit zugreifen kann, während die begrenzte Autonomie die Aktionen einschränkt, die er ohne Aufsicht durchführen kann. Die KI-Firewall reduziert das Risiko an der Interaktionsgrenze, indem sie Eingaben und Ausgaben filtert und formt, und das Ausführungs-Sandboxing dämmt die Auswirkungen jeglichen Codes ein, den der Agent generiert oder ausführt. Schließlich liefern unveränderliche Argumentationsspuren den Prüfpfad, mit dem Sie Abweichungen erkennen, Vorfälle untersuchen und Richtlinien im Laufe der Zeit kontinuierlich verschärfen können.

| Sicherheitsmuster | Beschreibung |

|---|---|

| Simply-in-Time-Software-Berechtigungen |

Gewähren Sie nur bei Bedarf kurzlebigen, eng begrenzten Zugriff, um den Explosionsradius der Gefährdung zu verringern. |

| Begrenzte Autonomie |

Beschränken Sie, welche Aktionen ein Agent unabhängig ausführen kann, und leiten Sie wise Schritte durch Genehmigungen und Leitplanken. |

| Die KI-Firewall |

Filtern und prüfen Sie Eingabeaufforderungen und Antworten, um Bedrohungen wie Immediate-Injection, Datenexfiltration und toxische Inhalte zu blockieren oder zu neutralisieren. |

| Ausführungs-Sandboxing |

Führen Sie vom Agenten generierten Code in einer isolierten Umgebung mit strengen Ressourcen- und Zugriffskontrollen aus, um Schäden einzudämmen. |

| Unveränderliche Argumentationsspuren |

Erstellen Sie zeitgestempelte, manipulationssichere Protokolle von Eingaben, Zwischenartefakten und Richtlinienprüfungen für Überprüfbarkeit und Abweichungserkennung. |

Zusammengenommen verringern diese Einschränkungen die Wahrscheinlichkeit, dass ein einzelner Fehler zu einem systemischen Verstoß wird, ohne die betrieblichen Vorteile zunichte zu machen, die die Agenten-KI attraktiv machen.