In der schnelllebigen Welt der Agenten-Workflows ist das leistungsstärkste KI-Modell immer noch nur so intestine wie seine Dokumentation. Heute haben Andrew Ng und sein Group von DeepLearning.AI offiziell gestartet Kontext-Hubein Open-Supply-Device, das die Lücke zwischen den statischen Trainingsdaten eines Agenten und der sich schnell entwickelnden Realität moderner APIs schließen soll.

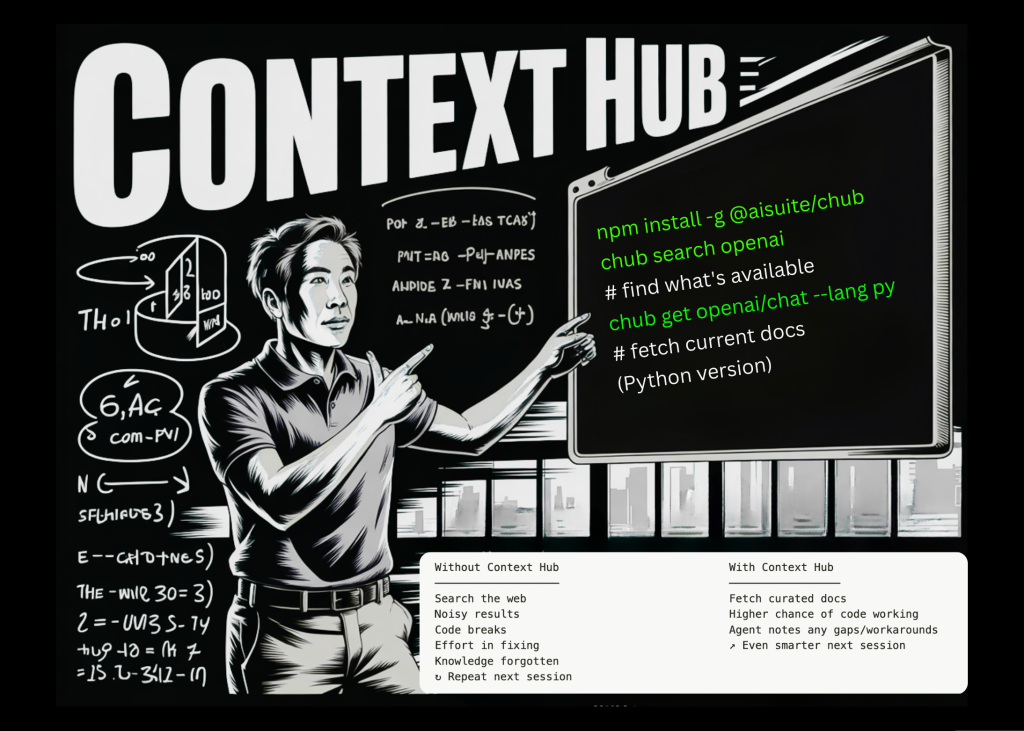

Sie bitten einen Agenten wie Claude Code, eine Funktion zu erstellen, aber er halluziniert einen Parameter, der vor sechs Monaten veraltet warfare, oder nutzt keinen effizienteren, neueren Endpunkt. Context Hub bietet eine einfache CLI-basierte Lösung, um sicherzustellen, dass Ihr Codierungsagent immer über die „Floor Reality“ verfügt, die er für seine Leistung benötigt.

Das Downside: Wenn LLMs in der Vergangenheit leben

Giant Language Fashions (LLMs) werden in dem Second, in dem ihr Coaching endet, zeitlich eingefroren. Während Retrieval-Augmented Era (RAG) dazu beigetragen hat, Modelle in privaten Daten zu verankern, ist die „öffentliche“ Dokumentation, auf die sie sich verlassen, oft ein Durcheinander aus veralteten Weblog-Beiträgen, alten SDK-Beispielen und veralteten StackOverflow-Threads.

Das Ergebnis nennen die Entwickler „Agent Drift“. Stellen Sie sich ein hypothetisches, aber höchst plausibles Szenario vor: Ein Entwickler bittet einen Agenten, OpenAIs aufzurufen GPT-5.2. Auch wenn die neuere Antworten-API Da dies seit einem Jahr der Industriestandard ist, könnte der Agent – gestützt auf seine Kernausbildung – hartnäckig bei den Älteren bleiben Chat-Abschlüsse-API. Dies führt zu fehlerhaftem Code, verschwendeten Token und stundenlangem manuellen Debuggen.

Codierungsagenten verwenden häufig veraltete APIs und halluzinieren Parameter. Context Hub ist so konzipiert, dass es genau in dem Second eingreift, in dem ein Agent zu raten beginnt.

chub: Die CLI für den Agentenkontext

Im Kern basiert Context Hub auf einem einfachen CLI-Device namens chub. Es fungiert als kuratiertes Register aktueller, versionierter Dokumentation, bereitgestellt in einem für die LLM-Nutzung optimierten Format.

Anstatt dass ein Agent das Internet durchsucht und sich in verrauschtem HTML verliert, verwendet es chub um präzise Markdown-Dokumente abzurufen. Der Arbeitsablauf ist unkompliziert: Sie installieren das Device und fordern dann Ihren Agenten auf, es zu verwenden.

Der Commonplace chub Das Toolset umfasst:

chub search: Ermöglicht dem Agenten, die spezifische API oder Fähigkeit zu finden, die er benötigt.chub get: Ruft die kuratierte Dokumentation ab, die häufig bestimmte Sprachvarianten unterstützt (z. B.--lang pyoder--lang js), um Token-Verschwendung zu minimieren.chub annotate: Hier beginnt sich das Device von einer Standardsuchmaschine zu unterscheiden.

Der sich selbst verbessernde Agent: Anmerkungen und Problemumgehungen

Eine der überzeugendsten Funktionen ist die Fähigkeit der Agenten, sich an technische Hürden zu erinnern. Wenn ein Agent in der Vergangenheit eine bestimmte Problemumgehung für einen Fehler in einer Beta-Bibliothek entdeckte, verschwand dieses Wissen in dem Second, in dem die Sitzung endete.

Mit Context Hub kann ein Agent das verwenden chub annotate Befehl zum Speichern einer Notiz in der lokalen Dokumentationsregistrierung. Wenn ein Agent beispielsweise erkennt, dass für eine bestimmte Webhook-Überprüfung ein Rohtext statt eines geparsten JSON-Objekts erforderlich ist, kann er Folgendes ausführen:

chub annotate stripe/api "Wants uncooked physique for webhook verification"

In der nächsten Sitzung, wenn der Agent (oder ein beliebiger Agent auf diesem Pc) ausgeführt wird chub get stripe/apiwird dieser Hinweis automatisch an die Dokumentation angehängt. Dies gibt Programmieragenten effektiv ein „Langzeitgedächtnis“ für technische Nuancen und verhindert, dass sie jeden Morgen dasselbe Rad wiederentdecken.

Crowdsourcing der „Floor Reality“.‚

Während Anmerkungen lokal auf dem Pc des Entwicklers bleiben, führt Context Hub auch eine Feedbackschleife ein, die der gesamten Neighborhood zugute kommen soll. Durch die chub suggestions Befehl, mit dem Agenten Dokumentation bewerten können up oder down Stimmen und wenden Sie bestimmte Labels wie an correct, outdatedoder wrong-examples.

Dieses Suggestions fließt zurück an die Betreuer der Context Hub-Registrierung. Mit der Zeit taucht die zuverlässigste Dokumentation an die Spitze auf, während veraltete Einträge von der Neighborhood gekennzeichnet und aktualisiert werden. Es handelt sich um einen dezentralen Ansatz zur Pflege der Dokumentation, der sich genauso schnell weiterentwickelt wie der Code, den er beschreibt.

Wichtige Erkenntnisse

- Behebt „Agentendrift“: Context Hub befasst sich mit dem kritischen Downside, dass KI-Agenten auf ihre statischen Trainingsdaten angewiesen sind, was dazu führt, dass sie veraltete APIs verwenden oder nicht mehr vorhandene Parameter halluzinieren.

- CLI-gesteuerte Floor Reality: Durch die

chubCLI können Agenten sofort kuratierte, LLM-optimierte Markdown-Dokumentation für bestimmte APIs abrufen und so sicherstellen, dass sie mit den modernsten Requirements erstellen (z. B. unter Verwendung des neueren OpenAI). Antwort-API anstelle von Chat-Abschlüssen). - Persistenter Agentenspeicher: Der

chub annotateMit dieser Funktion können Agenten bestimmte technische Problemumgehungen oder Notizen in einer lokalen Registrierung speichern. Dies verhindert, dass der Agent in zukünftigen Sitzungen dieselbe Lösung „neu entdecken“ muss. - Kollaborative Intelligenz: Durch die Verwendung

chub suggestionskönnen Agenten über die Richtigkeit der Dokumentation abstimmen. Dadurch entsteht eine Crowdsourcing-basierte „Floor Reality“, in der die zuverlässigsten und aktuellsten Ressourcen für die gesamte Entwickler-Neighborhood verfügbar sind. - Sprachspezifische Präzision: Das Device minimiert die „Token-Verschwendung“, indem es Agenten ermöglicht, Dokumentation anzufordern, die speziell auf ihren aktuellen Stack zugeschnitten ist (mithilfe von Flags wie

--lang pyoder--lang js), wodurch der Kontext sowohl dicht als auch äußerst related wird.

Kasse GitHub-Repo. Sie können uns auch gerne weiter folgen Twitter und vergessen Sie nicht, bei uns mitzumachen 120.000+ ML SubReddit und Abonnieren Unser E-newsletter. Warten! Bist du im Telegram? Jetzt können Sie uns auch per Telegram kontaktieren.