Die Neurowissenschaften sind seit langem ein Feld des Teilens und Herrschens. Forscher ordnen typischerweise bestimmte kognitive Funktionen isolierten Gehirnregionen zu – etwa Bewegung dem Bereich V5 oder Gesichtern dem Gyrus fusiformis –, indem sie Modelle verwenden, die auf enge experimentelle Paradigmen zugeschnitten sind. Obwohl dies zu tiefgreifenden Erkenntnissen geführt hat, ist die resultierende Landschaft fragmentiert und es fehlt ein einheitlicher Rahmen, um zu erklären, wie das menschliche Gehirn multisensorische Informationen integriert.

Das FAIR-Workforce von Meta hat sich vorgestellt TRIBE v2ein trimodales Gründungsmodell, das diese Lücke schließen soll. Durch die Ausrichtung der latenten Darstellungen modernster KI-Architekturen auf die menschliche Gehirnaktivität prognostiziert TRIBE v2 hochauflösende fMRT-Reaktionen unter verschiedenen naturalistischen und experimentellen Bedingungen.

Die Architektur: Multimodale Integration

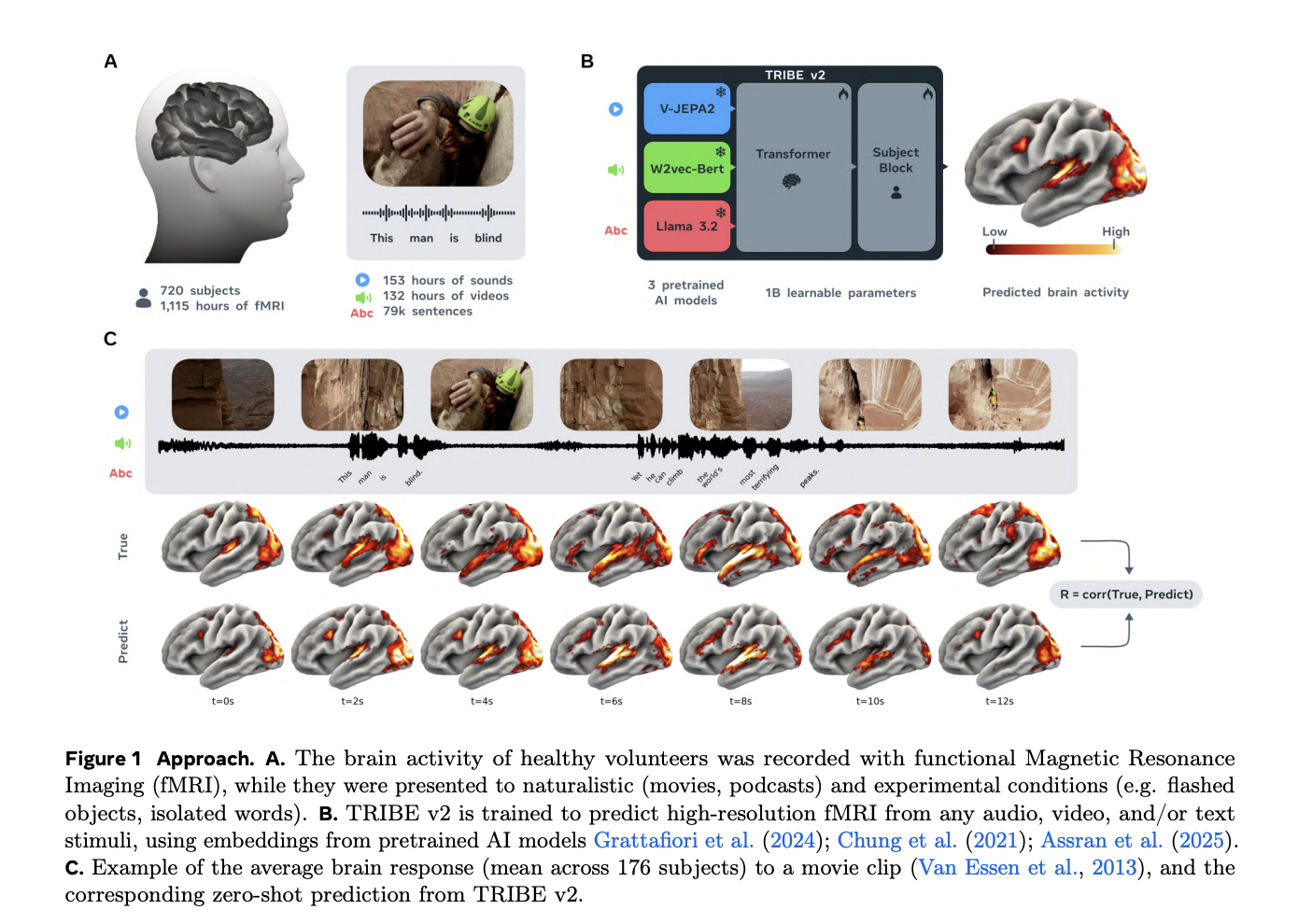

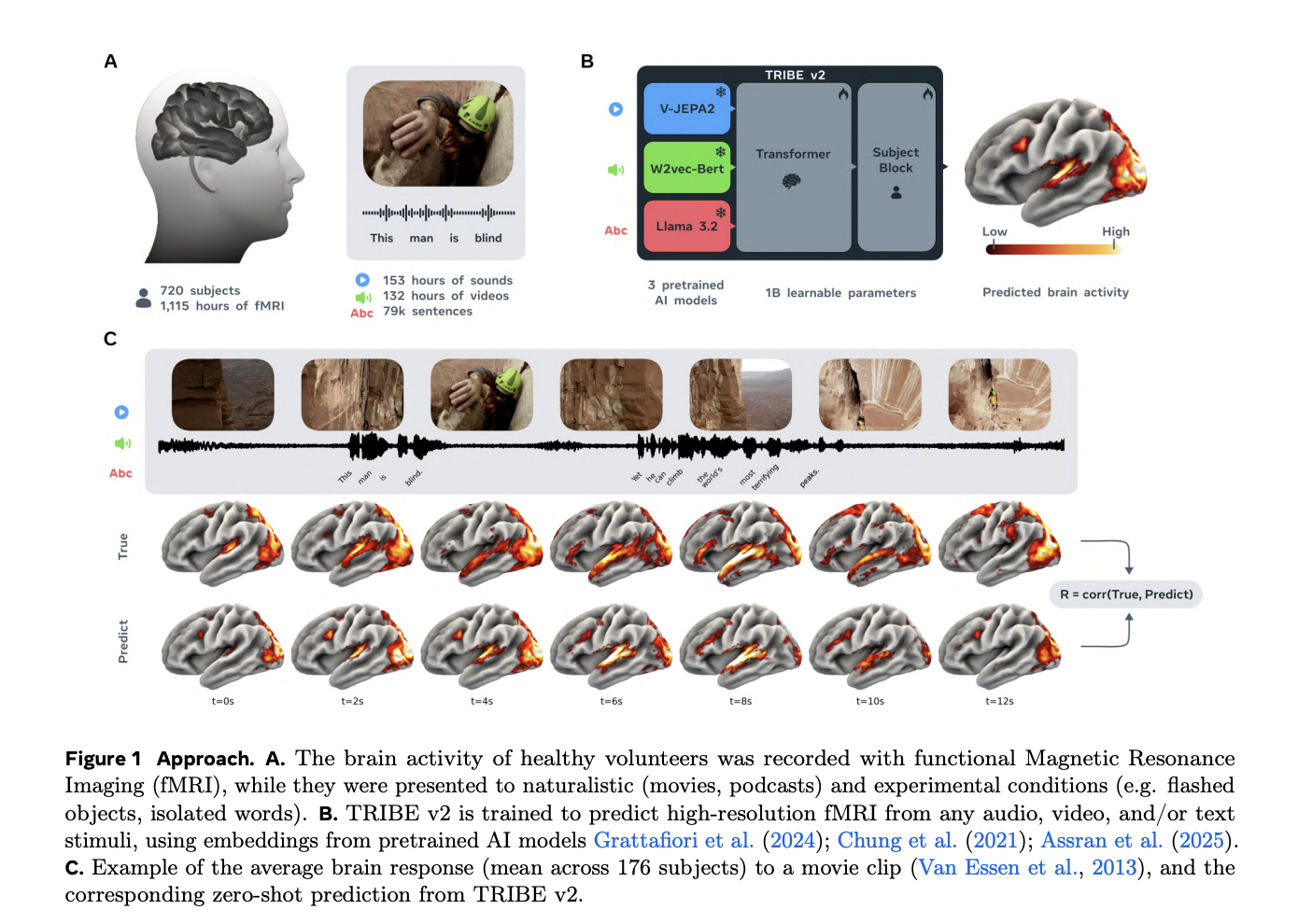

TRIBE v2 lernt das „Sehen“ oder „Hören“ nicht von Grund auf. Stattdessen nutzt es die Repräsentationsausrichtung zwischen tiefen neuronalen Netzwerken und dem Gehirn von Primaten. Die Architektur besteht aus drei eingefrorenen Fundamentmodellen, die als dienen Characteristic-Extraktoren, ein zeitlicher Transformator, und a fachspezifischer Vorhersageblock.

Das Modell verarbeitet Reize über drei spezialisierte Encoder:

- Textual content: Kontextualisierte Einbettungen werden daraus extrahiert LLaMA 3.2-3B. Für jedes Wort stellt das Modell die vorhergehenden 1.024 Wörter voran, um einen zeitlichen Kontext bereitzustellen, der dann einem 2-Hz-Raster zugeordnet wird.

- Video: Das Modell verwendet V-JEPA2-Big um 64-Body-Segmente zu verarbeiten, die sich über die vorangegangenen 4 Sekunden für jedes Zeitintervall erstrecken.

- Audio: Der Ton wird durch verarbeitet Wav2Vec-BERT 2.0wobei die Darstellungen auf 2 Hz neu abgetastet wurden, um sie an die Reizfrequenz anzupassen .

2. Zeitliche Aggregation

Die resultierenden Einbettungen werden in eine gemeinsame Dimension komprimiert und zu einer multimodalen Zeitreihe mit einer Modelldimension von verkettet . Diese Sequenz wird in a eingespeist Transformator-Encoder (8 Schichten, 8 Aufmerksamkeitsköpfe), die über ein 100-Sekunden-Fenster Informationen austauschen.

3. Subjektspezifische Vorhersage

Um die Gehirnaktivität vorherzusagen, werden die Transformer-Ausgänge auf die fMRT-Frequenz von 1 Hz dezimiert und ging durch a Betreffblock. Dieser Block projiziert die latenten Darstellungen auf 20.484 kortikale Eckpunkte und 8.802 subkortikale Voxel.

Daten- und Skalierungsgesetze

Eine wesentliche Hürde bei der Gehirnkodierung ist die Datenknappheit. TRIBE v2 geht dieses Drawback an, indem es „tiefe“ Datensätze für das Coaching verwendet – wobei einige Probanden viele Stunden lang aufgezeichnet werden – und „breite“ Datensätze für die Auswertung.

- Ausbildung: Das Modell wurde anhand von 451,6 Stunden fMRT-Daten von 25 Probanden in vier naturalistischen Studien (Filme, Podcasts und Stummfilme) trainiert.

- Auswertung: Es wurde in einer größeren Sammlung von insgesamt 1.117,7 Stunden von 720 Probanden ausgewertet.

Das Forschungsteam beobachtete einen logarithmisch linearen Anstieg der Codierungsgenauigkeit mit zunehmender Trainingsdatenmenge, ohne Anzeichen eines Plateaus. Dies deutet darauf hin, dass mit der Erweiterung der Neuroimaging-Repositories die Vorhersagekraft von Modellen wie TRIBE v2 weiter zunehmen wird.

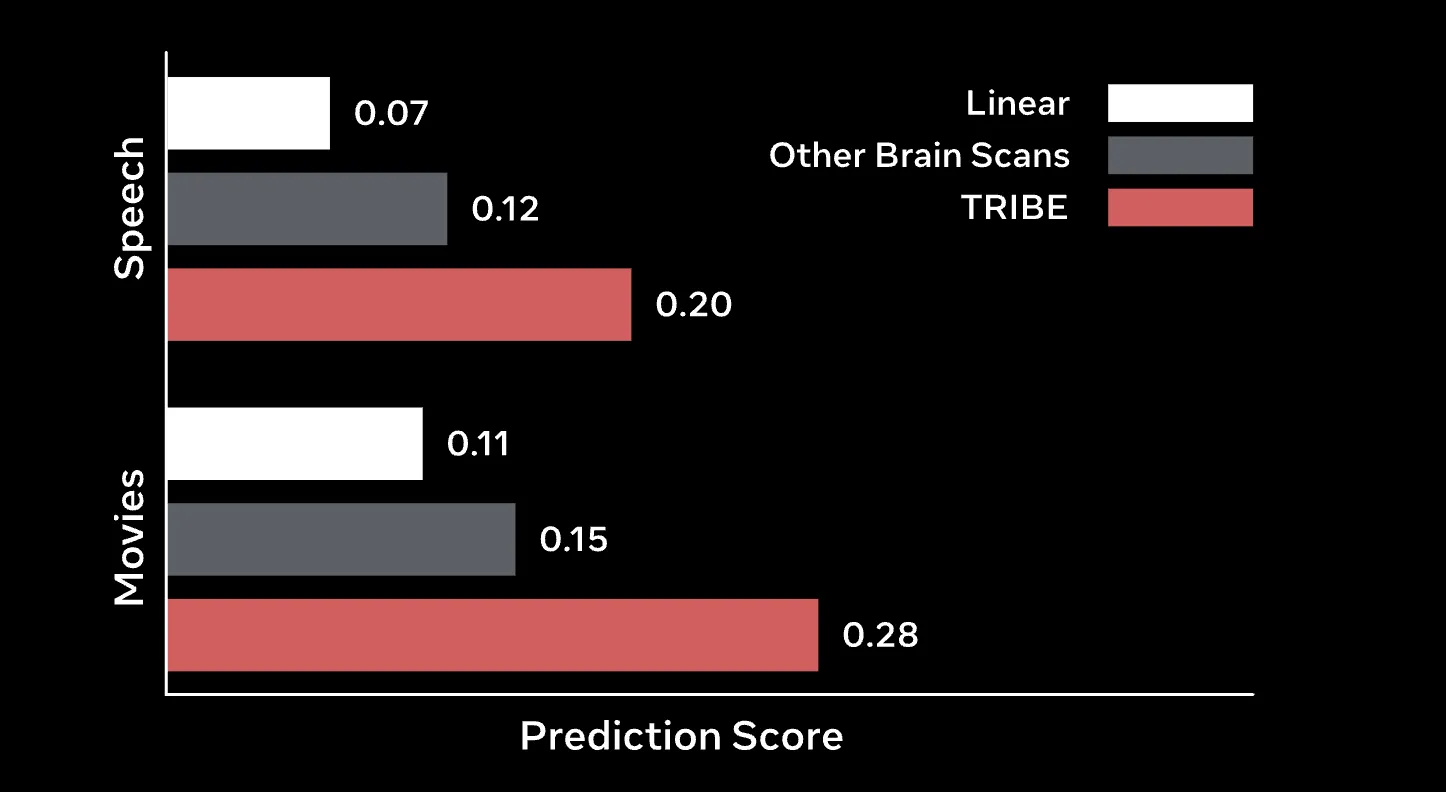

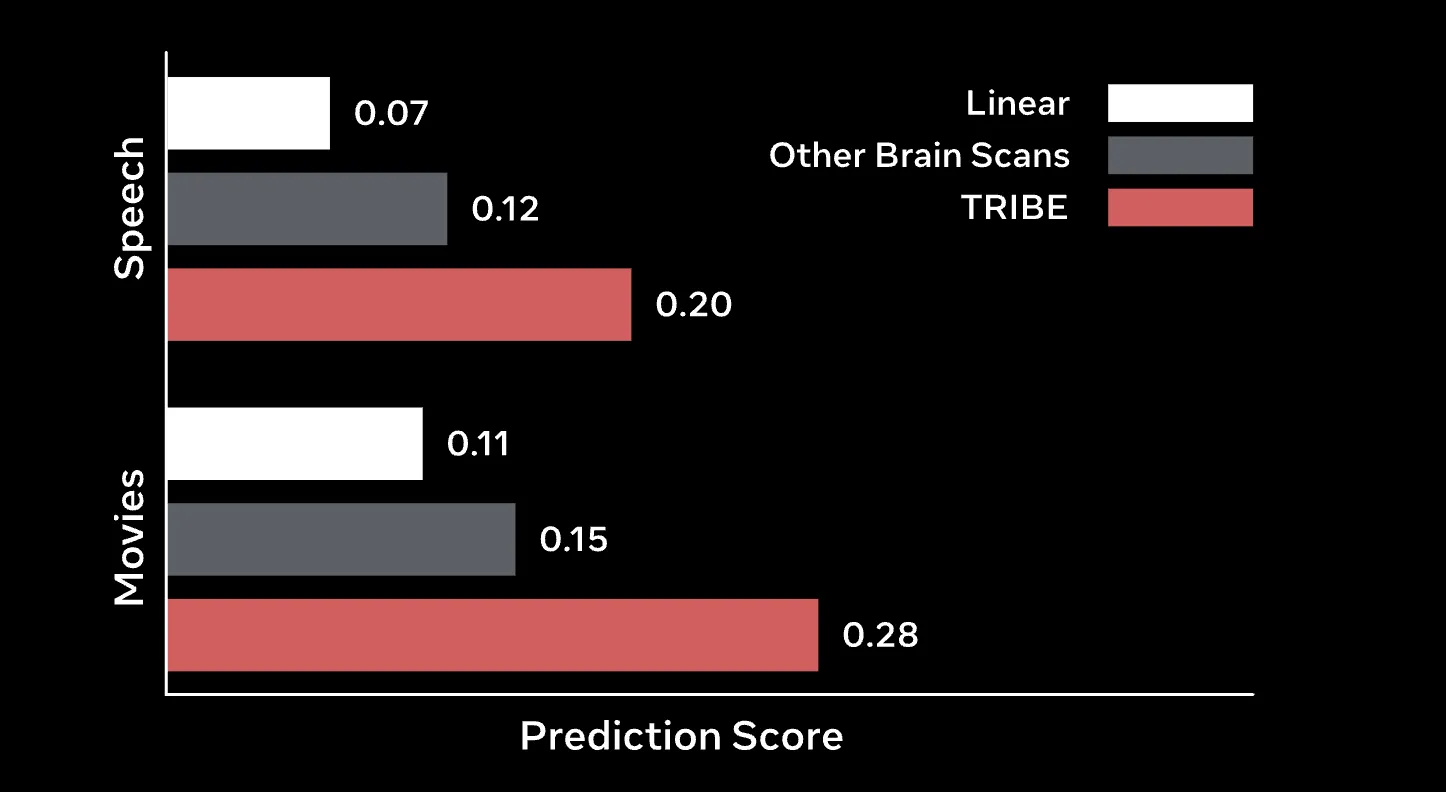

Ergebnisse: Übertreffen der Grundlinien

TRIBE v2 übertrifft herkömmliche Systeme deutlich Endliche Impulsantwort (FIR) Modelle, der langjährige Goldstandard für die voxelweise Kodierung.

Zero-Shot und Gruppenleistung

Eine der auffälligsten Fähigkeiten des Modells ist Zero-Shot-Verallgemeinerung zu neuen Themen. Mithilfe einer Ebene „unsichtbarer Probanden“ kann TRIBE v2 die gruppendurchschnittliche Reaktion einer neuen Kohorte genauer vorhersagen als die tatsächliche Aufzeichnung vieler einzelner Probanden innerhalb dieser Kohorte. Im hochauflösenden 7T-Datensatz des Human Connectome Challenge (HCP) erreichte TRIBE v2 eine Gruppenkorrelation nahe 0,4, eine zweifache Verbesserung gegenüber der Gruppenvorhersagefähigkeit des mittleren Probanden.

Feinabstimmung

Wenn einem neuen Teilnehmer eine kleine Datenmenge (höchstens eine Stunde) zur Verfügung gestellt wird, führt die Feinabstimmung von TRIBE v2 für nur eine Epoche zu einer zwei- bis vierfachen Verbesserung gegenüber linearen Modellen, die von Grund auf trainiert wurden.

In-Silico-Experimente

Das Forschungsteam argumentiert, dass TRIBE v2 nützlich sein könnte Pilotierung oder Vorscreening von Neuroimaging-Studien. Durch die Durchführung virtueller Experimente auf dem Individuelles Mind Charting (IBC) Datensatz, Das Modell hat klassische funktionale Wahrzeichen wiederhergestellt:

- Imaginative and prescient: Der fusiforme Gesichtsbereich wurde genau lokalisiert (FFA) und parahippocampaler Ortsbereich (PPA).

- Sprache: Der temporo-parietale Übergang wurde erfolgreich wiederhergestellt (TPJ) zur emotionalen Verarbeitung und Brocas Gegend für die Syntax.

Darüber hinaus bewerben Unabhängige Komponentenanalyse (ICA) Die letzte Ebene des Modells ergab, dass TRIBE v2 auf natürliche Weise fünf bekannte Funktionsnetzwerke lernt: primäres Gehör, Sprache, Bewegung, Standardmodus und visuell.

Schlüssel zum Mitnehmen

- Eine leistungsstarke trimodale Architektur: TRIBE v2 ist ein Basismodell, das integriert Video, Audio und Sprache durch den Einsatz modernster Encoder wie LLaMA 3.2 für Textual content, V-JEPA2 für Video und Wav2Vec-BERT für Audio.

- Logarithmisch-lineare Skalierungsgesetze: Ähnlich wie die großen Sprachmodelle, die wir jeden Tag verwenden, folgt TRIBE v2 a logarithmisch-lineares Skalierungsgesetz; Seine Fähigkeit, die Gehirnaktivität genau vorherzusagen, nimmt stetig zu, je mehr fMRT-Daten zugeführt werden, und ein Leistungsplateau ist derzeit nicht in Sicht.

- Überlegene Zero-Shot-Generalisierung: Das Modell kann die Gehirnreaktionen von vorhersagen unsichtbare Themen unter neuen Versuchsbedingungen ohne zusätzliche Schulung. Bemerkenswert ist, dass seine Zero-Shot-Vorhersagen bei der Schätzung gruppengemittelter Gehirnreaktionen oft genauer sind als die Aufzeichnungen einzelner menschlicher Probanden selbst.

- Der Beginn der In-Silico-Neurowissenschaft: TRIBE v2 ermöglicht „In-silico“-Experimente und ermöglicht es Forschern, virtuelle neurowissenschaftliche Checks auf einem Pc durchzuführen. Es replizierte erfolgreich jahrzehntelange empirische Forschung, indem es spezielle Bereiche wie die identifizierte fusiformer Gesichtsbereich (FFA) Und Brocas Gegend rein durch digitale Simulation.

- Neue biologische Interpretierbarkeit: Auch wenn es sich um eine Deep-Studying-„Blackbox“ handelt, organisierten sich die internen Darstellungen des Modells natürlich in fünf bekannte funktionale Netzwerke: primäres Gehör, Sprache, Bewegung, Standardmodus und visuell.

Schauen Sie sich das an Code, Gewichte Und Demo. Sie können uns auch gerne weiter folgen Twitter und vergessen Sie nicht, bei uns mitzumachen 120.000+ ML SubReddit und Abonnieren Unser E-newsletter. Warten! Bist du im Telegram? Jetzt können Sie uns auch per Telegram kontaktieren.

Michal Sutter ist ein Information-Science-Experte mit einem Grasp of Science in Information Science von der Universität Padua. Mit einer soliden Grundlage in statistischer Analyse, maschinellem Lernen und Datentechnik ist Michal hervorragend darin, komplexe Datensätze in umsetzbare Erkenntnisse umzuwandeln.