Annotierende Regionen, die an medizinischen Bildern interessiert sind, ist häufig einer der ersten Schritte, die klinische Forscher durchführen, wenn eine neue Studie mit biomedizinischen Bildern durchgeführt wird.

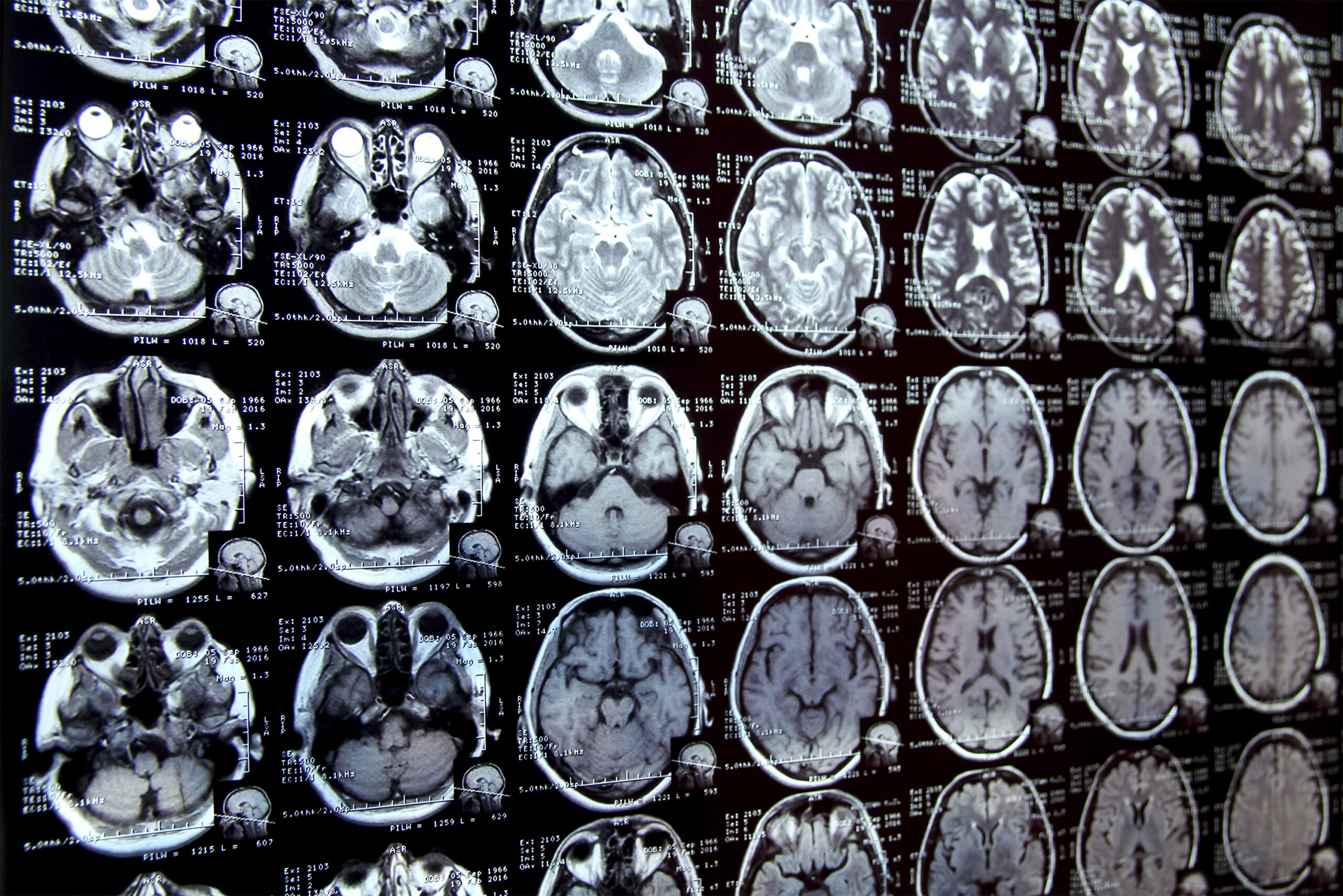

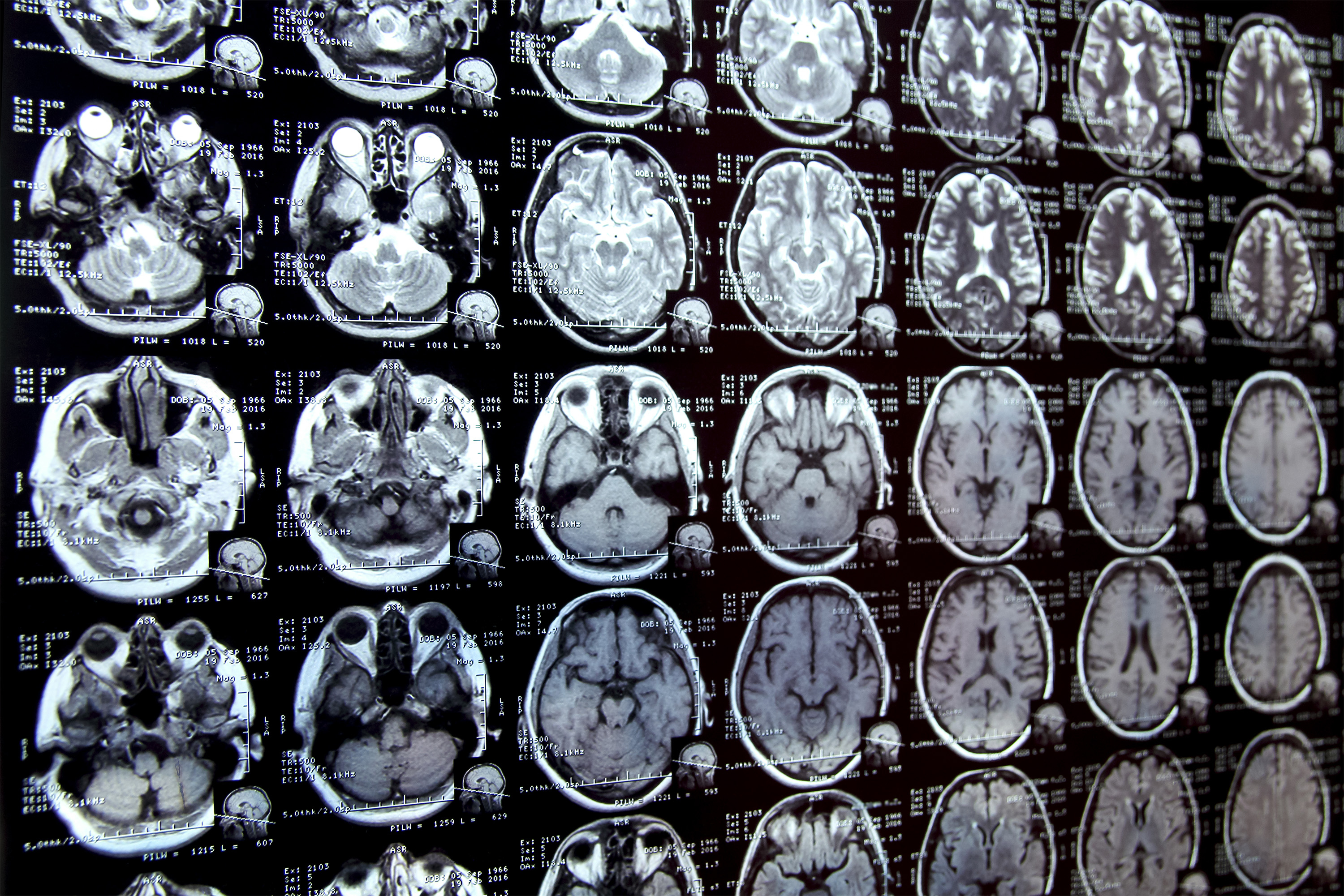

Um beispielsweise zu bestimmen, wie sich die Größe des Hippocampus des Gehirns im Alter von Patienten verändert, skizziert der Wissenschaftler zunächst jeden Hippocampus in einer Reihe von Gehirnscans. Für viele Strukturen und Bildtypen ist dies häufig ein manueller Vorgang, der extrem zeitaufwändig sein kann, insbesondere wenn die untersuchten Regionen eine Herausforderung für die Größenordnung sind.

Um den Prozess zu optimieren, entwickelten MIT-Forscher ein System für künstliche Intelligenz, das es einem Forscher ermöglicht, neue biomedizinische Bildgebungsdatensätze durch Klicken, Kritzeln und Zeichnungsfelder auf den Bildern schnell zu segmentieren. Dieses neue KI -Modell verwendet diese Interaktionen, um die Segmentierung vorherzusagen.

Wenn der Benutzer zusätzliche Bilder markiert, nimmt die Anzahl der Interaktionen, die er für die Durchführung benötigt, ab und sinkt schließlich auf Null. Das Modell kann dann jedes neue Bild ohne Benutzereingabe genau segmentieren.

Dies kann dies tun, weil die Architektur des Modells speziell für die Verwendung von Informationen aus Bildern entwickelt wurde, die bereits segmentiert wurden, um neue Vorhersagen zu treffen.

Im Gegensatz zu anderen medizinischen Bildsegmentierungsmodellen ermöglicht dieses System dem Benutzer, einen gesamten Datensatz zu segmentieren, ohne seine Arbeit für jedes Bild zu wiederholen.

Darüber hinaus erfordert das interaktive Instrument für das Coaching kein vorbereiteter Bilddatensatz, sodass Benutzer kein Experience für maschinelles Lernen oder umfangreiche Rechenressourcen benötigen. Sie können das System für eine neue Segmentierungsaufgabe verwenden, ohne das Modell umzusetzen.

Auf lange Sicht könnte dieses Instrument Studien zu neuen Behandlungsmethoden beschleunigen und die Kosten klinischer Studien und medizinischer Forschung senken. Es könnte auch von Ärzten verwendet werden, um die Effizienz klinischer Anwendungen wie die Planung der Strahlenbehandlung zu verbessern.

„Viele Wissenschaftler haben möglicherweise nur Zeit, ein paar Bilder professional Tag für ihre Forschung zu segmentieren, da die manuelle Bildsegmentierung so zeitaufwändig ist. Wir hoffen, dass dieses System neue Wissenschaft ermöglichen wird, indem klinische Forscher durchführen, Studien durchzuführen, die sie vor dem Fehlen eines effizienten Instruments verboten hatten“ Papier zu diesem neuen Werkzeug.

Sie ist auf der Zeitung von Jose Javier Gonzalez Ortiz PhD ’24 begleitet; John Guttag, Professor für Informatik und Elektrotechnik von Dugald C. Jackson; und Senior Autor Adrian Dalca, Assistenzprofessor an der Harvard Medical Faculty und MGH und Forschungswissenschaftler in der MIT -Labor für Informatik und künstliche Intelligenz (CSAIL). Die Forschung wird auf der Internationalen Konferenz über Pc Imaginative and prescient vorgestellt.

Straffungssegmentierung

Es gibt hauptsächlich zwei Methoden, die Forscher verwenden, um neue Sätze von medizinischen Bildern zu segmentieren. Bei der interaktiven Segmentierung geben sie ein Bild in ein AI -System ein und verwenden eine Schnittstelle, um Bereiche von Interesse zu markieren. Das Modell prognostiziert die Segmentierung basierend auf diesen Interaktionen.

Ein Instrument, das zuvor von den MIT -Forschern entwickelt wurde, ScribblepromptErmöglicht Benutzern, dies zu tun, aber sie müssen den Vorgang für jedes neue Bild wiederholen.

Ein anderer Ansatz besteht darin, ein aufgabenspezifisches KI-Modell zu entwickeln, um die Bilder automatisch zu segmentieren. Dieser Ansatz erfordert den Benutzer, Hunderte von Bildern manuell zu segmentieren, um einen Datensatz zu erstellen und dann ein maschinelles Lernmodell zu trainieren. Dieses Modell sagt die Segmentierung für ein neues Bild voraus. Der Benutzer muss jedoch für jede neue Aufgabe den komplexen, maschinenlernbasierten Prozess von Grund auf neu starten, und es gibt keine Möglichkeit, das Modell zu korrigieren, wenn es einen Fehler macht.

Dieses neue System, Multiversegkombiniert das Beste von jedem Ansatz. Es prognostiziert eine Segmentierung für ein neues Bild basierend auf Benutzerinteraktionen wie Kritzeleien, hält aber auch jedes segmentierte Bild in einem Kontextsatz, auf den es sich später bezieht.

Wenn der Benutzer ein neues Bild hochlädt und Interessenbereiche markiert, stützt sich das Modell auf die Beispiele in seinem Kontext, um eine genauere Vorhersage mit weniger Benutzereingaben zu machen.

Die Forscher haben die Architektur des Modells so gestaltet, dass sie einen Kontextsatz einer beliebigen Größe verwenden, sodass der Benutzer keine bestimmte Anzahl von Bildern haben muss. Dies gibt MultiverSEg die Flexibilität, die in einer Reihe von Anwendungen verwendet werden kann.

„Irgendwann sollten Sie für viele Aufgaben keine Interaktionen bereitstellen. Wenn Sie im Kontext -Satz genügend Beispiele haben, kann das Modell die Segmentierung selbst genau vorhersagen“, sagt Wong.

Die Forscher haben das Modell sorgfältig für eine vielfältige Sammlung biomedizinischer Bildgebungsdaten entwickelt und geschult, um sicherzustellen, dass es die Fähigkeit hatte, ihre Vorhersagen auf der Grundlage der Benutzereingabe inkrementell zu verbessern.

Der Benutzer muss das Modell nicht für seine Daten übertragen oder anpassen. Um Multiverse für eine neue Aufgabe zu verwenden, kann man ein neues medizinisches Picture hochladen und mit dem Markieren beginnen.

Wenn die Forscher Multiverseg mit hochmodernen Instruments für die In-Kontext- und interaktive Bildsegmentierung verglichen, übertraf es jede Basislinie.

Weniger Klicks, bessere Ergebnisse

Im Gegensatz zu diesen anderen Instruments benötigt MultiverSEg weniger Benutzereingaben für jedes Bild. Nach dem neunten neuen Bild wurden nur zwei Klicks vom Benutzer benötigt, um eine Segmentierung genauer zu generieren als ein speziell für die Aufgabe entworfenes Modell.

Bei einigen Bildtypen wie Röntgenstrahlen muss der Benutzer möglicherweise nur ein oder zwei Bilder manuell segmentieren, bevor das Modell genau genug wird, um selbst Vorhersagen zu treffen.

Die Interaktivität des Instruments ermöglicht es dem Benutzer auch, Korrekturen der Vorhersage des Modells vorzunehmen und die gewünschte Genauigkeit zu erreichen. Im Vergleich zum vorherigen System der Forscher erreichte Multiverseg mit rund 2/3 die Anzahl der Kritzeleien und 3/4 die Anzahl der Klicks.

„Mit Multiverse können Benutzer immer mehr Interaktionen zur Verfeinerung der KI -Vorhersagen bereitstellen. Dies beschleunigt den Prozess immer noch dramatisch, da es normalerweise schneller ist, etwas zu korrigieren, das existiert, als von vorne zu beginnen“, sagt Wong.

In Zukunft möchten die Forscher dieses Instrument in realen Situationen mit klinischen Mitarbeitern testen und es basierend auf dem Suggestions der Benutzer verbessern. Sie möchten auch, dass Multiverseg 3D -biomedizinische Bilder segmentiert.

Diese Arbeit wird teilweise von Quanta Pc, Inc. und den Nationwide Institutes of Well being mit Hardwareunterstützung des Massachusetts Life Sciences Middle unterstützt.