Bild vom Autor

# Einführung

Bevor wir anfangen, möchte ich, dass Sie sich dieses Video ansehen:

Ist das nicht erstaunlich? Ich meine, Sie können jetzt ein vollständiges lokales Modell ausführen, mit dem Sie auf Ihrem eigenen Pc kommunizieren können, und es funktioniert sofort. Es fühlt sich an, als würde man mit einer echten Individual sprechen weil das System gleichzeitig zuhören und sprechen kann, genau wie bei einem natürlichen Gespräch.

Dies ist nicht das übliche Muster „Sie sprechen, dann wartet es, dann antwortet es“. PersonaPlex ist eine Sprach-zu-Sprache-Konversations-KI in Echtzeit das mit Unterbrechungen, Überschneidungen und natürlichen Gesprächshinweisen wie „uh-huh“ oder „richtig“ umgeht, während Sie sprechen.

PersonaPlex ist auf Vollduplex ausgelegt, sodass es gleichzeitig zuhören und Sprache erzeugen kann, ohne dass der Benutzer zuerst eine Pause einlegen muss. Dadurch fühlen sich Gespräche im Vergleich zu herkömmlichen Sprachassistenten viel flüssiger und menschlicher an.

In diesem Tutorial erfahren Sie, wie Sie die Linux-Umgebung einrichten, PersonaPlex lokal installieren und dann den PersonaPlex-Webserver starten, damit Sie in Echtzeit mit der KI in Ihrem Browser interagieren können.

# PersonaPlex lokal verwenden: Eine Schritt-für-Schritt-Anleitung

In diesem Abschnitt erfahren Sie, wie wir PersonaPlex unter Linux installieren, die Echtzeit-WebUI starten und mit einem Vollduplex-Speech-to-Speech-KI-Modell sprechen, das lokal auf unserem eigenen Pc ausgeführt wird.

// Schritt 1: Akzeptieren der Modellbedingungen und Generieren eines Tokens

Bevor Sie PersonaPlex herunterladen und ausführen können, müssen Sie die Nutzungsbedingungen für das Modell auf Hugging Face akzeptieren. Das Speech-to-Speech-Modell PersonaPlex-7B-v1 von NVIDIA ist Gated, was bedeutet, dass Sie auf die Gewichtungen erst zugreifen können, wenn Sie den Lizenzbedingungen auf der Modellseite zustimmen.

Gehen Sie zum PersonaPlex Modellseite Klicken Sie auf Hugging Face und melden Sie sich an. Sie sehen einen Hinweis, dass Sie der Weitergabe Ihrer Kontaktinformationen zustimmen und die Lizenzbedingungen akzeptieren müssen, um auf die Dateien zugreifen zu können. Überprüfen Sie die NVIDIA Open Mannequin-Lizenz und akzeptieren Sie die Bedingungen, um das Repository freizuschalten.

Sobald der Zugriff gewährt wurde, erstellen Sie ein Hugging Face-Zugriffstoken:

- Gehe zu Einstellungen → Zugriffstoken

- Erstellen Sie ein neues Token mit Lesen Erlaubnis

- Kopieren Sie das generierte Token

Dann exportieren Sie es in Ihr Terminal:

export HF_TOKEN="YOUR_HF_TOKEN"Mit diesem Token kann Ihr lokaler Pc das PersonaPlex-Modell authentifizieren und herunterladen.

// Schritt 2: Installieren der Linux-Abhängigkeit

Bevor Sie PersonaPlex installieren, müssen Sie Folgendes installieren Opus Audio-Codec-Entwicklungsbibliothek. PersonaPlex verlässt sich für die Echtzeit-Audiokodierung und -Dekodierung auf Opus, daher muss diese Abhängigkeit auf Ihrem System verfügbar sein.

Führen Sie auf Ubuntu- oder Debian-basierten Systemen Folgendes aus:

sudo apt replace

sudo apt set up -y libopus-dev// Schritt 3: PersonaPlex aus der Quelle erstellen

Jetzt klonen wir das PersonaPlex-Repository und installieren das erforderliche Moshi-Paket aus der Quelle.

Klonen Sie das offizielle NVIDIA-Repository:

git clone https://github.com/NVIDIA/personaplex.git

cd personaplexSobald Sie sich im Projektverzeichnis befinden, installieren Sie Moshi:

Dadurch werden die PersonaPlex-Komponenten zusammen mit allen erforderlichen Abhängigkeiten kompiliert und installiert, einschließlich PyTorch, CUDA-Bibliotheken, NCCL und Audio-Instruments.

Sie sollten sehen, dass Pakete wie Torch, Nvidia-Cublas-Cu12, Nvidia-Cudnn-Cu12, Satzstück und Moshi-Personaplex erfolgreich installiert werden.

Tipp: Tun Sie dies in einer virtuellen Umgebung, wenn Sie sich auf Ihrem eigenen Pc befinden.

// Schritt 4: Starten des WebUI-Servers

Installieren Sie vor dem Starten des Servers den schnelleren Hugging Face-Downloader:

Starten Sie nun den PersonaPlex-Echtzeitserver:

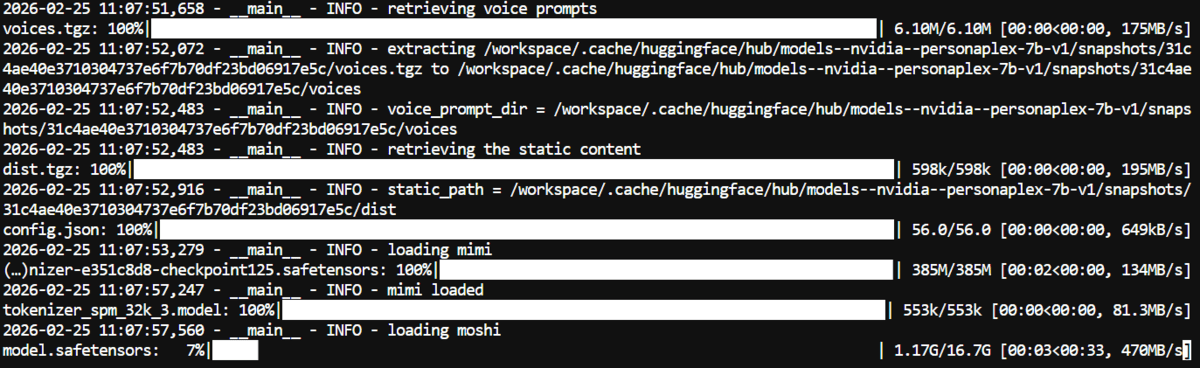

python -m moshi.server --host 0.0.0.0 --port 8998Beim ersten Durchlauf wird das vollständige PersonaPlex-Modell heruntergeladen, das etwa 16,7 GB groß ist. Dies kann je nach Internetgeschwindigkeit einige Zeit dauern.

Nachdem der Obtain abgeschlossen ist, wird das Modell in den Speicher geladen und der Server wird gestartet.

// Schritt 5: Im Browser mit PersonaPlex sprechen

Da der Server nun läuft, ist es an der Zeit, tatsächlich mit PersonaPlex zu sprechen.

Wenn Sie dies auf Ihrem lokalen Pc ausführen, kopieren Sie diesen Hyperlink und fügen Sie ihn in Ihren Browser ein: http://localhost:8998.

Dadurch wird die WebUI-Oberfläche in Ihren Browser geladen.

Sobald die Seite geöffnet ist:

- Wählen Sie eine Stimme aus

- Klicken Verbinden

- Erlauben Sie Mikrofonberechtigungen

- Fangen Sie an zu sprechen

Die Benutzeroberfläche enthält Konversationsvorlagen. Für diese Demo haben wir ausgewählt Astronaut (Spaß) Vorlage, um die Interaktion spielerischer zu gestalten. Sie können auch Ihre eigene Vorlage erstellen, indem Sie den anfänglichen Textual content der Systemaufforderung bearbeiten. Dadurch können Sie die Persönlichkeit und das Verhalten der KI vollständig anpassen.

Für die Sprachauswahl haben wir von der Standardeinstellung gewechselt und ausgewählt Natürliches F3 einfach mal etwas anderes ausprobieren.

Und ehrlich gesagt fühlt es sich überraschend natürlich an.

Sie können es während des Sprechens unterbrechen.

Sie können Folgefragen stellen.

Sie können das Thema mitten im Satz wechseln.

Es verwaltet den Gesprächsfluss reibungslos und reagiert clever in Echtzeit. Ich habe es sogar getestet, indem ich einen Anruf beim Bankkundendienst simuliert habe, und die Erfahrung fühlte sich realistisch an.

PersonaPlex umfasst mehrere Sprachvoreinstellungen:

- Natürlich (weiblich): NATF0, NATF1, NATF2, NATF3

- Natürlich (männlich): NATM0, NATM1, NATM2, NATM3

- Sorte (weiblich): VARF0, VARF1, VARF2, VARF3, VARF4

- Sorte (männlich): VARM0, VARM1, VARM2, VARM3, VARM4

Sie können mit verschiedenen Stimmen experimentieren, um die gewünschte Persönlichkeit zu erreichen. Manche fühlen sich gesprächiger, andere ausdrucksvoller.

# Abschließende Bemerkungen

Nachdem wir die gesamte Einrichtung durchgegangen sind und tatsächlich in Echtzeit mit PersonaPlex gesprochen haben, wird eines sehr klar.

Das fühlt sich anders an.

Wir sind an chatbasierte KI gewöhnt. Sie tippen. Es reagiert. Du wartest, bis du an der Reihe bist. Es fühlt sich transaktional an.

Speech-to-Speech verändert diese Dynamik völlig.

Da PersonaPlex lokal ausgeführt wird, müssen Sie nicht mehr warten, bis Sie an der Reihe sind. Sie können es unterbrechen. Sie können die Richtung mitten im Satz ändern. Sie können natürlich weitere Fragen stellen. Das Gespräch fließt. Es fühlt sich näher an, wie Menschen tatsächlich sprechen.

Und deshalb bin ich fest davon überzeugt, dass die Zukunft der KI in Speech-to-Speech liegt.

Aber selbst das ist nur die halbe Wahrheit.

Der eigentliche Wandel wird stattfinden, wenn diese Echtzeit-Konversationssysteme eng mit Agenten und Instruments verbunden sind. Stellen Sie sich vor, Sie sprechen mit Ihrer KI und sagen: „Buchen Sie mir ein Ticket für Freitagmorgen.“ Überprüfen Sie den Aktienkurs und tätigen Sie den Handel. Schreiben Sie diese E-Mail und senden Sie sie ab. Planen Sie das Treffen. Ziehen Sie den Bericht.

Tabs werden nicht gewechselt. Kein Kopieren und Einfügen. Keine Befehle eingeben.

Ich rede nur.

PersonaPlex löst bereits eines der schwierigsten Probleme, nämlich natürliche Vollduplex-Konversation. Die nächste Ebene ist die Ausführung. Sobald Speech-to-Speech-Systeme mit APIs, Automatisierungstools, Browsern, Handelsplattformen und Produktivitäts-Apps verbunden sind, sind sie keine Assistenten mehr, sondern werden zu Bedienern.

Kurz gesagt, es wird so etwas wie OpenClaw bei Steroiden.

Ein System, das nicht nur wie ein Mensch spricht, sondern in Ihrem Namen in Echtzeit handelt.

Abid Ali Awan (@1abidaliawan) ist ein zertifizierter Datenwissenschaftler, der gerne Modelle für maschinelles Lernen erstellt. Derzeit konzentriert er sich auf die Erstellung von Inhalten und das Schreiben technischer Blogs zu maschinellem Lernen und Datenwissenschaftstechnologien. Abid verfügt über einen Grasp-Abschluss in Technologiemanagement und einen Bachelor-Abschluss in Telekommunikationstechnik. Seine Imaginative and prescient ist es, ein KI-Produkt mithilfe eines graphischen neuronalen Netzwerks für Schüler mit psychischen Erkrankungen zu entwickeln.