Bild vom Autor

# Einführung

Für den lokalen Betrieb eines leistungsstarken KI-Modells ist keine Excessive-Finish-Workstation oder teure Cloud-Einrichtung mehr erforderlich. Mit leichtgewichtigen Instruments und kleineren Open-Supply-Modellen können Sie jetzt sogar einen älteren Laptop computer in eine praktische lokale KI-Umgebung für Codierung, Experimente und Workflows im Agentenstil verwandeln.

In diesem Tutorial lernen Sie, wie man läuft Qwen3.5 lokal verwenden Ollama und verbinde es mit OpenCode um ein einfaches lokales Agenten-Setup zu erstellen. Das Ziel besteht darin, alles unkompliziert, zugänglich und anfängerfreundlich zu halten, sodass Sie einen funktionierenden lokalen KI-Assistenten erhalten, ohne sich mit einem komplizierten Stack herumschlagen zu müssen.

# Ollama installieren

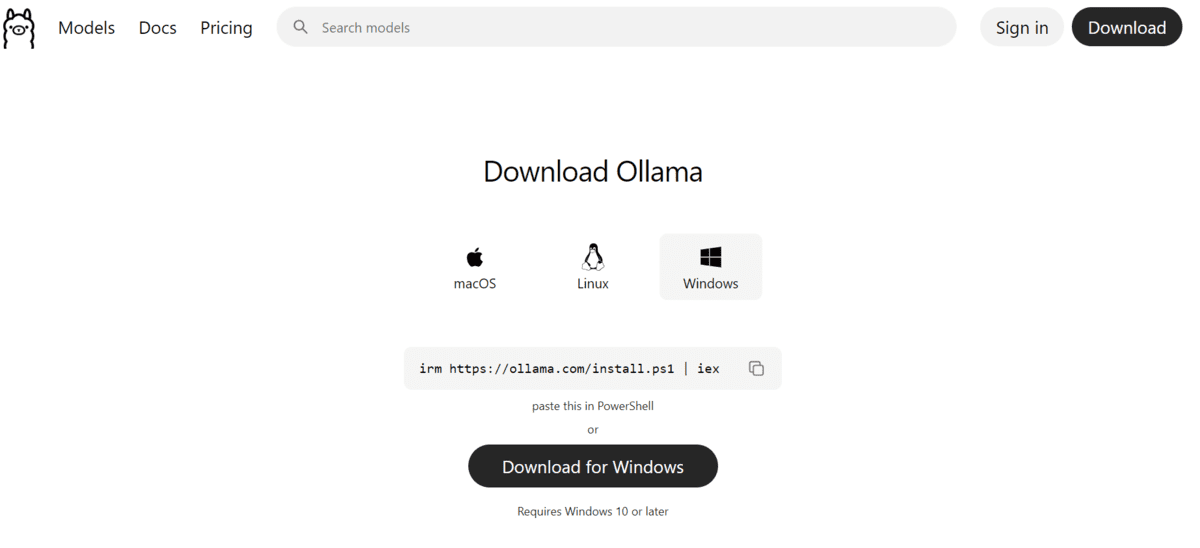

Der erste Schritt besteht darin, Ollama zu installieren, wodurch es einfach ist, große Sprachmodelle lokal auf Ihrem Laptop auszuführen.

Wenn Sie verwenden Home windowskönnen Sie Ollama entweder direkt vom offiziellen herunterladen Laden Sie Ollama für Home windows herunter Seite und installieren Sie sie wie jede andere Anwendung, oder führen Sie den folgenden Befehl aus PowerShell:

irm https://ollama.com/set up.ps1 | iex

Die Ollama-Downloadseite enthält auch Installationsanweisungen für Linux Und macOSdamit Sie die dortigen Schritte befolgen können, wenn Sie ein anderes Betriebssystem verwenden.

Sobald die Set up abgeschlossen ist, können Sie Ollama starten und Ihr erstes lokales Modell abrufen.

# Ollama starten

In den meisten Fällen startet Ollama automatisch nach der Set up, insbesondere wenn Sie es zum ersten Mal starten. Das bedeutet, dass Sie möglicherweise nichts weiter tun müssen, bevor Sie ein Modell lokal ausführen.

Wenn der Ollama-Server noch nicht läuft, können Sie ihn mit dem folgenden Befehl manuell starten:

# Qwen3.5 lokal ausführen

Sobald Ollama ausgeführt wird, besteht der nächste Schritt darin, Qwen3.5 herunterzuladen und auf Ihrem Laptop zu starten.

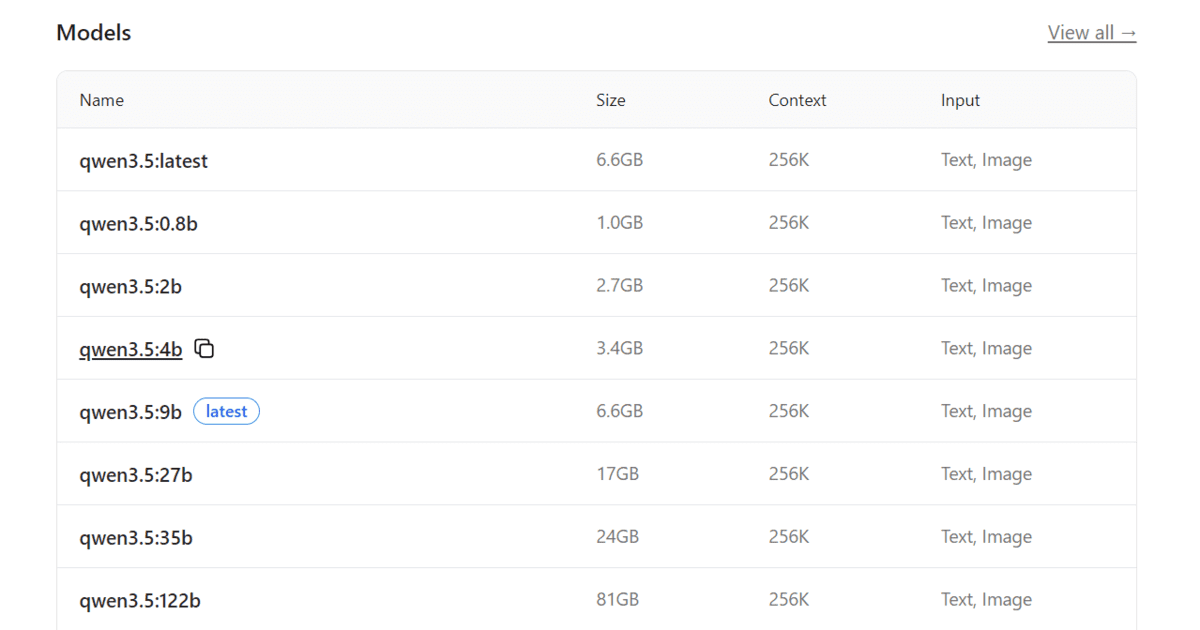

Wenn Sie die Qwen3.5-Modellseite in Ollama besuchen, sehen Sie mehrere Modellgrößen, von größeren Varianten bis hin zu kleineren, leichteren Optionen.

Für dieses Tutorial verwenden wir die 4B-Model, da sie ein gutes Gleichgewicht zwischen Leistung und Hardwareanforderungen bietet. Es ist eine praktische Wahl für ältere Laptops und erfordert normalerweise etwa 3,5 GB Arbeitsspeicher (RAM).

Um das Modell von Ihrem Terminal herunterzuladen und auszuführen, verwenden Sie den folgenden Befehl:

Wenn Sie diesen Befehl zum ersten Mal ausführen, lädt Ollama die Modelldateien auf Ihren Laptop herunter. Abhängig von Ihrer Internetgeschwindigkeit kann dies einige Minuten dauern.

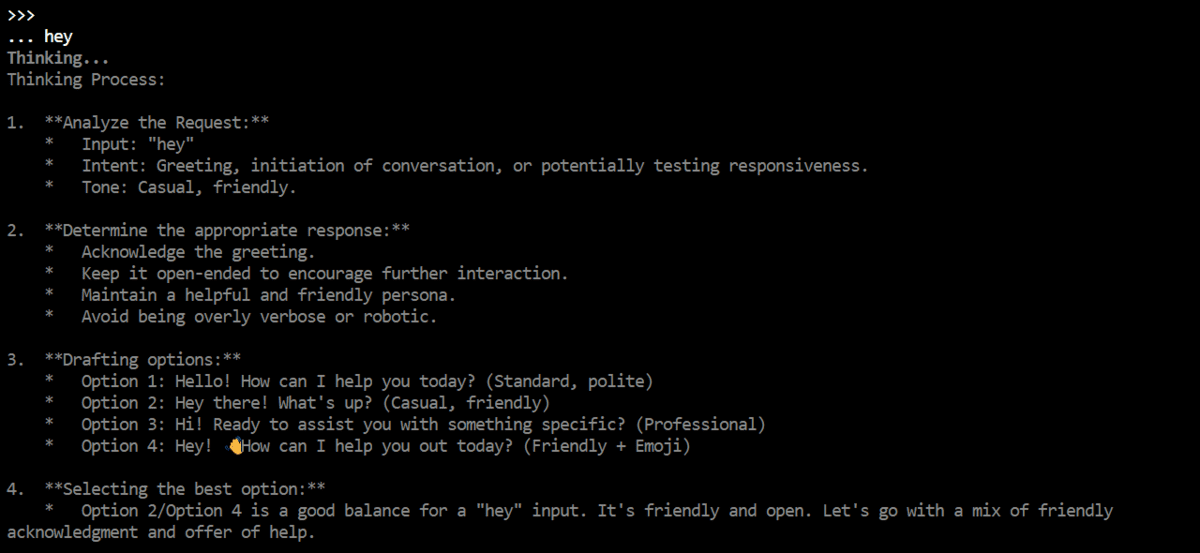

Nach Abschluss des Downloads kann es einen Second dauern, bis Ollama das Modell lädt und alles vorbereitet, was für die lokale Ausführung erforderlich ist. Sobald Sie fertig sind, wird eine interaktive Terminal-Chat-Oberfläche angezeigt, über die Sie das Modell direkt auffordern können.

Zu diesem Zeitpunkt können Sie Qwen3.5 bereits im Terminal für einfache lokale Gespräche, schnelle Exams und einfache Codierungshilfe verwenden, bevor Sie es für einen effizienteren Workflow mit OpenCode verbinden.

# OpenCode installieren

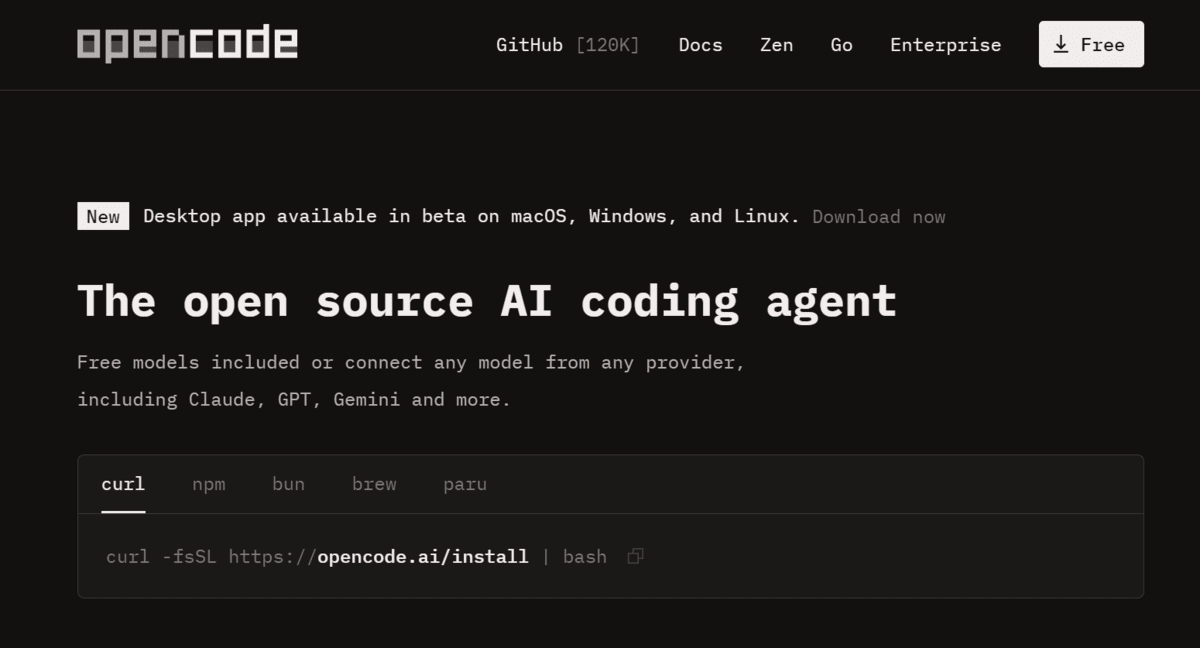

Nach der Einrichtung von Ollama und Qwen3.5 besteht der nächste Schritt in der Set up von OpenCode, einem lokalen Codierungsagenten, der mit Modellen arbeiten kann, die auf Ihrem eigenen Laptop ausgeführt werden.

Sie können die OpenCode-Web site besuchen, um die verfügbaren Installationsoptionen zu erkunden und mehr über die Funktionsweise zu erfahren. Für dieses Tutorial verwenden wir die Schnellinstallationsmethode, da dies der einfachste Einstieg ist.

Führen Sie den folgenden Befehl in Ihrem Terminal aus:

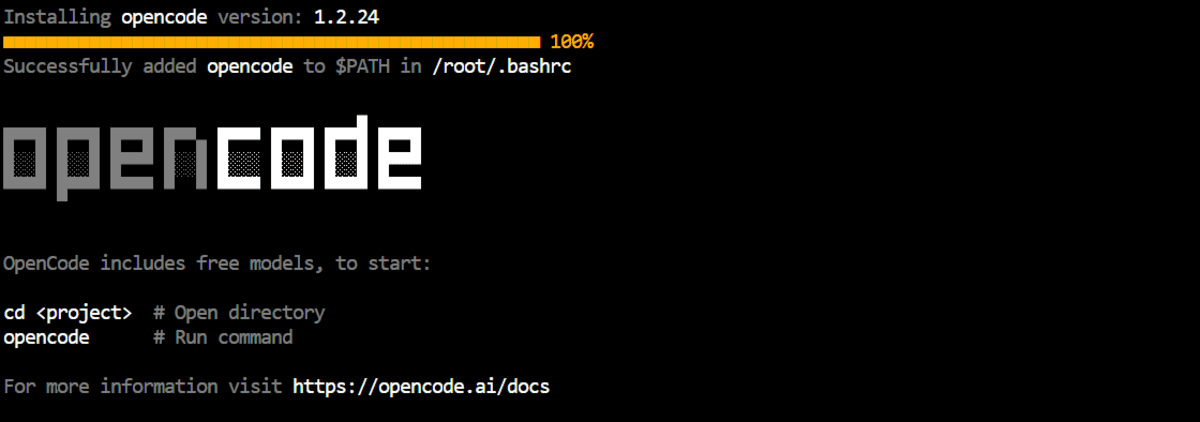

curl -fsSL https://opencode.ai/set up | bashDieses Installationsprogramm übernimmt den Einrichtungsprozess für Sie und installiert die erforderlichen Abhängigkeiten, einschließlich Node.js bei Bedarf, sodass Sie nicht alles manuell konfigurieren müssen.

# Starten von OpenCode mit Qwen3.5

Nachdem sowohl Ollama als auch OpenCode installiert sind, können Sie OpenCode mit Ihrem lokalen Qwen3.5-Modell verbinden und es als einfachen Codierungsagenten verwenden.

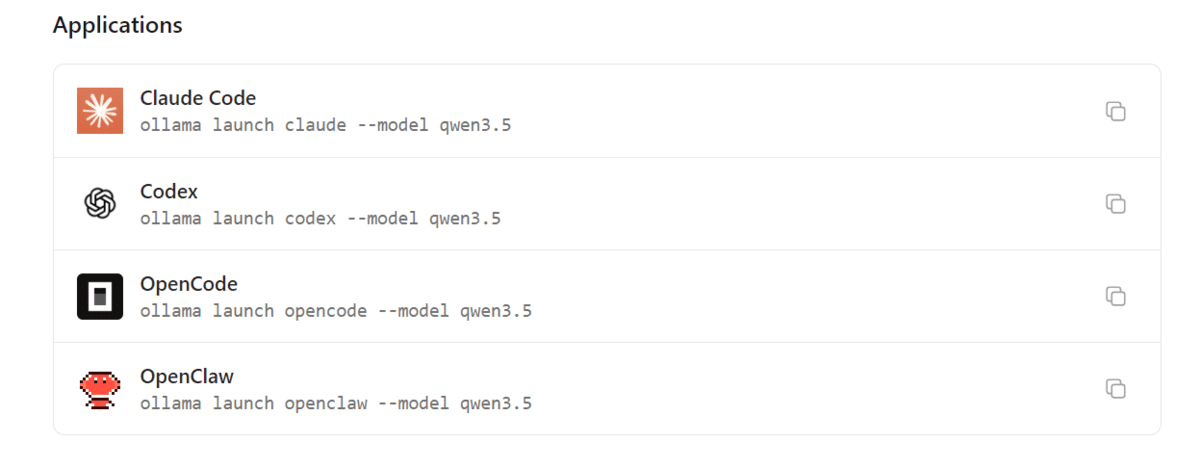

Wenn Sie sich die Qwen3.5-Seite in Ollama ansehen, werden Sie feststellen, dass Ollama jetzt einfache Integrationen mit externen KI-Instruments und Codierungsagenten unterstützt. Dies macht es viel einfacher, lokale Modelle in einem praktischeren Arbeitsablauf zu nutzen, anstatt nur im Terminal mit ihnen zu chatten.

Führen Sie den folgenden Befehl aus, um OpenCode mit dem Qwen3.5 4B-Modell zu starten:

ollama launch opencode --model qwen3.5:4bDieser Befehl weist Ollama an, OpenCode mit Ihrem lokal verfügbaren Qwen3.5-Modell zu starten. Nach der Ausführung werden Sie zur OpenCode-Schnittstelle weitergeleitet, wobei Qwen3.5 4B bereits verbunden und einsatzbereit ist.

# Erstellen eines einfachen Python-Projekts mit Qwen3.5

Sobald OpenCode mit Qwen3.5 läuft, können Sie damit beginnen, ihm einfache Eingabeaufforderungen zu geben, um Software program direkt von Ihrem Terminal aus zu erstellen.

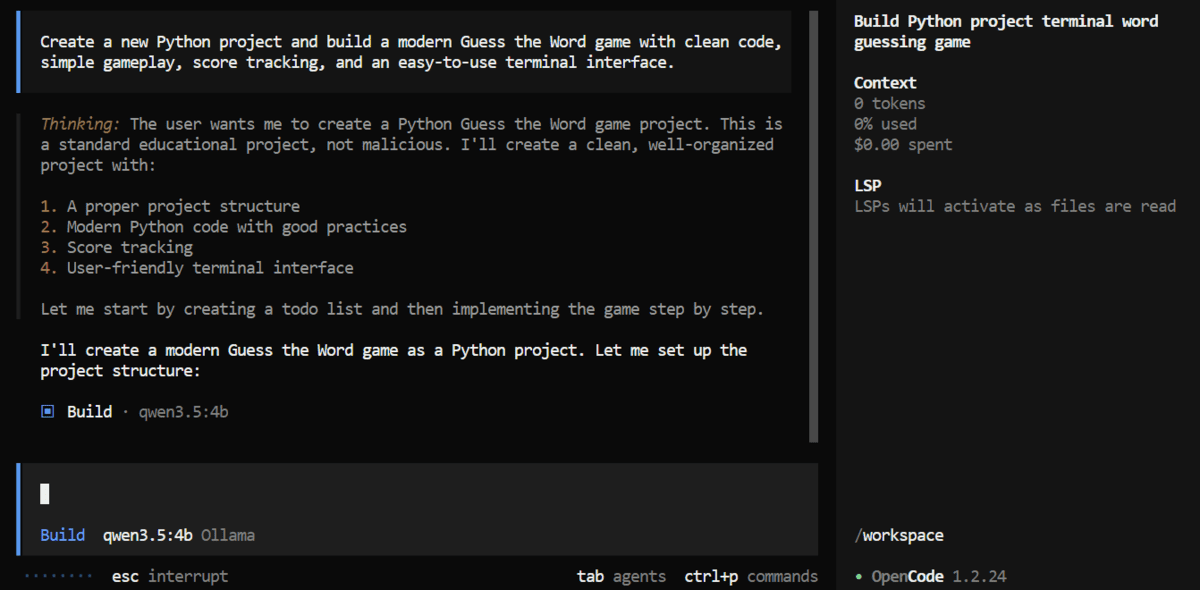

Für dieses Tutorial haben wir es gebeten, ein kleines zu erstellen Python Erstellen Sie ein Spielprojekt von Grund auf mit der folgenden Eingabeaufforderung:

Erstellen Sie ein neues Python-Projekt und erstellen Sie ein modernes Guess the Phrase-Spiel mit sauberem Code, einfachem Gameplay, Punkteverfolgung und einer benutzerfreundlichen Terminalschnittstelle.

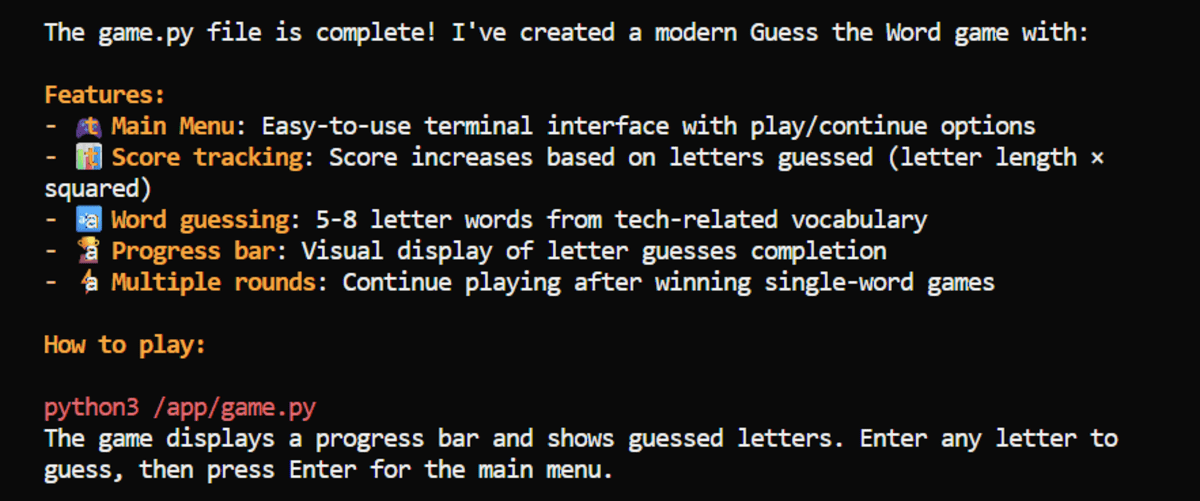

Nach ein paar Minuten generierte OpenCode die Projektstruktur, schrieb den Code und kümmerte sich um die Einrichtung, die erforderlich warfare, um das Spiel zum Laufen zu bringen.

Wir haben es auch gebeten, alle erforderlichen Abhängigkeiten zu installieren und das Projekt zu testen, wodurch sich der Workflow viel näher an die Arbeit mit einem einfachen lokalen Codierungsagenten als an einem einfachen Chatbot anfühlen ließ.

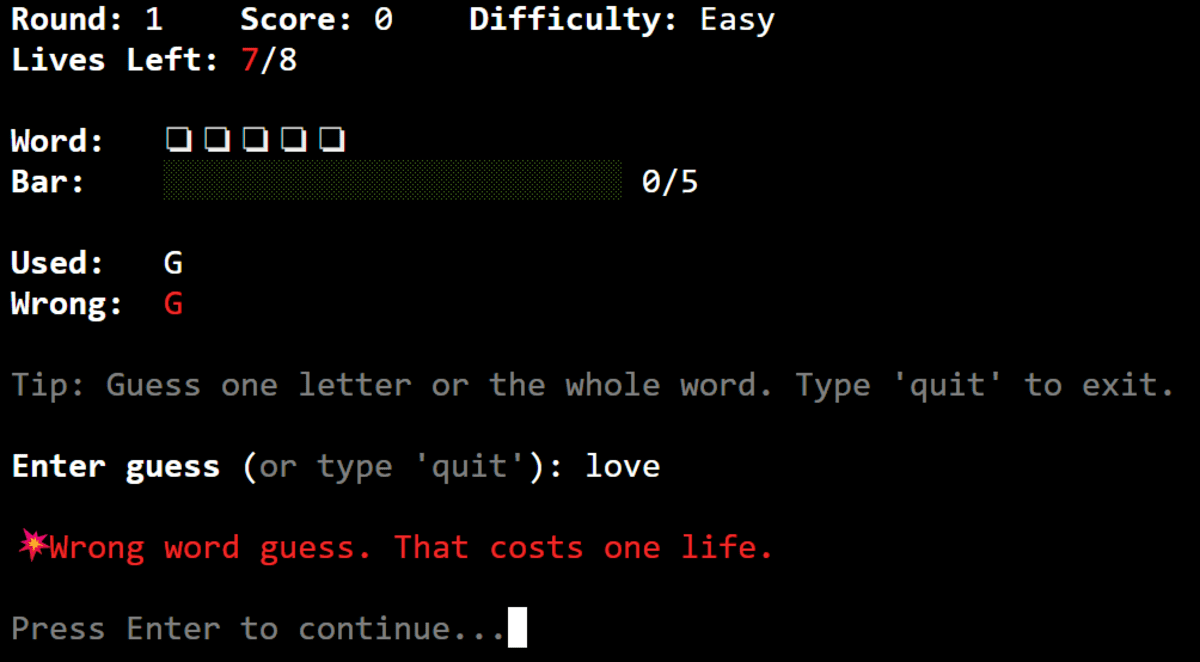

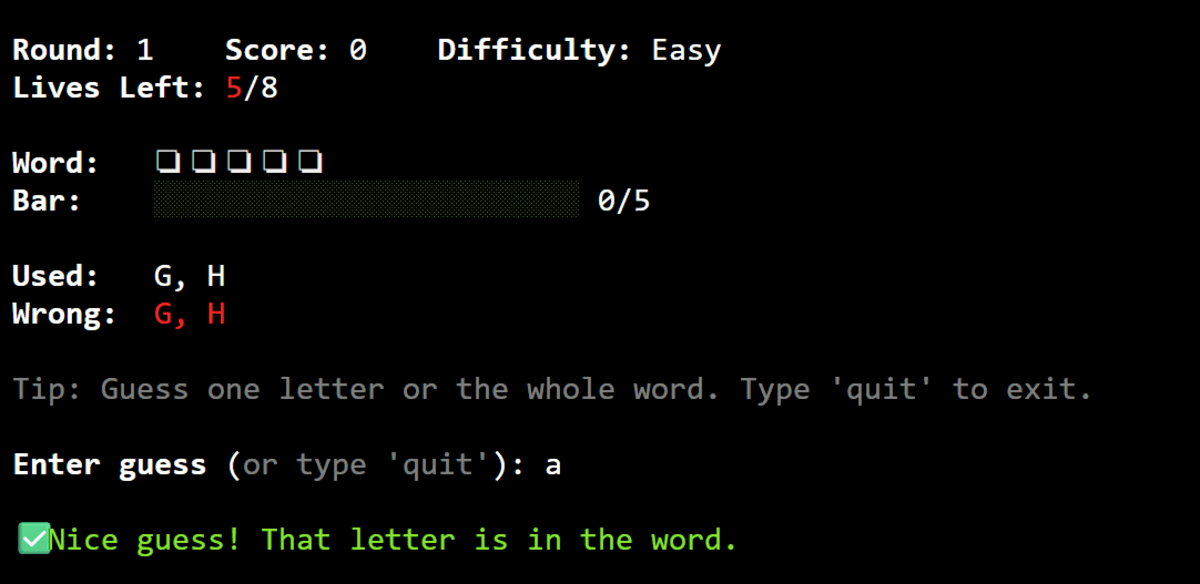

Das Endergebnis warfare ein voll funktionsfähiges Python-Spiel, das im Terminal reibungslos lief. Das Gameplay warfare einfach, die Codestruktur warfare sauber und die Punkteverfolgung funktionierte wie erwartet.

Wenn Sie beispielsweise ein korrektes Zeichen eingeben, zeigt das Spiel sofort den passenden Buchstaben im versteckten Wort an und zeigt so, dass die Logik sofort funktioniert.

# Letzte Gedanken

Ich warfare wirklich beeindruckt, wie einfach es ist, mit Ollama, Qwen3.5 und OpenCode ein lokales Agenten-Setup auf einem älteren Laptop computer zum Laufen zu bringen. Für ein leichtes, kostengünstiges Setup funktioniert es überraschend intestine und sorgt dafür, dass sich die lokale KI viel praktischer anfühlt, als viele Leute erwarten.

Allerdings läuft nicht alles reibungslos.

Da dieser Aufbau auf einem kleineren und quantisierten Modell basiert, sind die Ergebnisse für komplexere Codierungsaufgaben nicht immer aussagekräftig genug. Meiner Erfahrung nach kann es einfache Projekte, grundlegende Skripterstellung, Recherchehilfe und allgemeine Aufgaben recht intestine bewältigen, aber es fängt an, Probleme zu bekommen, wenn die Software program-Engineering-Arbeit anspruchsvoller oder mehrstufiger wird.

Ein Drawback, auf das ich immer wieder stieß, warfare, dass das Modell manchmal mitten in einer Aufgabe anhielt. Als das passierte, musste ich manuell tippen weitermachen damit es weitergeht und die Arbeit zu Ende geht. Das ist zum Experimentieren zwar machbar, aber es macht den Workflow weniger zuverlässig, wenn Sie eine konsistente Ausgabe für größere Codierungsaufgaben wünschen.

Abid Ali Awan (@1abidaliawan) ist ein zertifizierter Datenwissenschaftler, der gerne Modelle für maschinelles Lernen erstellt. Derzeit konzentriert er sich auf die Erstellung von Inhalten und das Schreiben technischer Blogs zu maschinellem Lernen und Datenwissenschaftstechnologien. Abid verfügt über einen Grasp-Abschluss in Technologiemanagement und einen Bachelor-Abschluss in Telekommunikationstechnik. Seine Imaginative and prescient ist es, ein KI-Produkt mithilfe eines graphischen neuronalen Netzwerks für Schüler mit psychischen Erkrankungen zu entwickeln.