Open-Weight-Modelle sorgen für die neueste Aufregung in der KI-Landschaft. Die lokale Ausführung leistungsstarker Modelle verbessert den Datenschutz, senkt die Kosten und ermöglicht die Offline-Nutzung. Aber es gibt nur wenige Open-Supply-Modelle! Aber GOOGle’s Gemma 4 ist hier, um das zu ändern!

Dieser Leitfaden erläutert, was Gemma 4 ist, untersucht seine Varianten und beschreibt die für seine Leistung erforderliche {Hardware}. Außerdem erfahren Sie, wie Sie Ihr Setup testen und ein erstellen Second Mind AI-Projekt Unterstützt durch Gemma 4 von Google. Wir werden auch Claude Code CLI verwenden, um die Entwicklung zu rationalisieren und Arbeitsabläufe zu integrieren.

Gemma 4 verstehen

Gemma ist Googles Familie offener Sprachmodelle und Gemma 4 stellt einen bedeutenden Fortschritt dar. Es bietet stärkere Argumentation, bessere Effizienz und eine breitere multimodale Unterstützung und verarbeitet nicht nur Textual content, sondern auch Bilder, wobei einige Varianten auch Audio und Video umfassen. Die Modelle sind für die lokale Ausführung konzipiert und eignen sich daher für datenschutzrelevante und Offline-Anwendungsfälle.

Mehr lesen: Gemma 4: Zum Anfassen

Gemma 4 Varianten

Es gibt 4 verschiedene Gemma 4-Varianten. Dazu gehören E2B, E4B, 26B A4B und 31B. E2B und E4B werden mit der Bedeutung von effektiven Parametern abgekürzt. Diese Modelle eignen sich für Edge-Geräte. Der 26B A4B basiert auf Combination-of-Consultants (MoE) Architektur. Die Dense-Architektur wird im 31B verwendet.

| Modell | Effektive/aktive Parameter | Gesamtparameter | Architektur | Kontextfenster |

|---|---|---|---|---|

| E2B | 2,3B effektiv | 5.1B mit Einbettungen | Dicht + PLE | 128.000 Token |

| E4B | 4,5B effektiv | 8B mit Einbettungen | Dicht + PLE | 128.000 Token |

| 26B-A4B | 3,8B aktiv | 25,2 Milliarden insgesamt | Combination-of-Consultants (MoE) | 256.000 Token |

| 31B | 30,7B aktiv | Insgesamt 30,7 Milliarden | Dichter Transformator | 256.000 Token |

Die MoE-Struktur ermöglicht Wirksamkeit. Für eine bestimmte Aufgabe kommen nur bestimmte Fachleute ins Spiel. Dadurch sind größere Modelle beherrschbar. Der Dicht Architektur nutzt alle Parameter. Alle Gemma 4-Varianten haben ihre eigenen Vorteile.

Einrichten von Gemma 4 auf Ihrem PC mit Ollama

Ollama bietet einen einfachen Ansatz. Es unterstützt den einfachen Betrieb lokaler LLMs. Ollama ist benutzerfreundlich. Die Set up ist einfach. Es verwaltet Modelle effizient. Ollama 4 ist lokal in Gemma 4 mit Ollama verfügbar.

Installationsanleitung

Installieren Sie Ollama auf Ihrem PC. Installieren Sie die Anwendung über die offizielle Web site von Ollama. Ziehen Sie die Anwendung in Ihre Anwendungen. Öffnen Sie von dort aus Ollama. Es funktioniert in Ihrer Menüleiste.

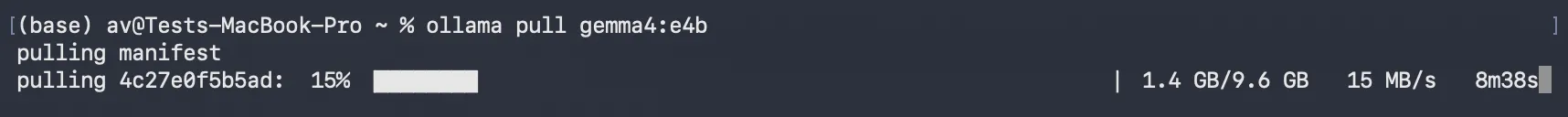

Dann laden Sie Gemma 4-Modelle herunter. Öffnen Sie Ihr Terminal. Geben Sie den Befehl ollama pull ein. Geben Sie die entsprechenden Tags an.

- Für E2B: Ollama Pull

gemma4:e2b - Für E4B: Ollama Pull

gemma4:e4b - Für 26B A4B: Ollama Pull

gemma4:26b - Für 31B: Ollama Pull

gemma4:31b

Dadurch werden die Modelldateien abgerufen. Das haben Sie jetzt Gemma 4 vor Ort mit Ollama.

Hardwarekonfiguration

Berücksichtigen Sie die {Hardware} Ihres PCs. Gemma 4-Varianten haben unterschiedliche Anforderungen.

- In E2B und E4B: Diese Modelle sind mit den meisten modernen Laptops kompatibel. Sie benötigen mindestens 8 GB RAM. Laut einer aktuellen Umfrage verfügen 75 Prozent der Entwickler über 16 GB RAM oder mehr. Solche Varianten sind sinnvoll.

- Im Fall von 26B A4B: In diesem Modell sind mehr Ressourcen erforderlich. Es benötigt etwa 16 GB oder mehr VRAM. Dies ist für Excessive-Finish-Laptops oder Workstations geeignet.

- Im Fall von 31B: Die ressourcenintensivste Variante ist diese. Es erfordert 24 GB oder mehr VRAM. Das ist die Stärke der Apple Silicon Macs (M1/M2/M3/M4). Diese Modelle haben den Vorteil, dass sie über eine gemeinsame Speicherstruktur verfügen.

Ausführen und Testen des Modells

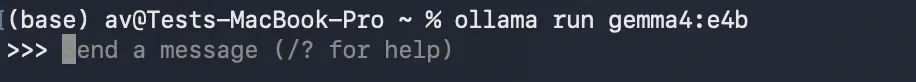

Führen Sie das Modell von Ihrem Terminal aus. Verwenden Sie den Befehl ollama run.

ollama run gemma4:e2b (Substitute e2b together with your chosen variant).Das Modell wird geladen. Anschließend können Sie Eingabeaufforderungen eingeben.

Beispielaufforderungen:

- Textgenerierung: „Schreiben Sie ein kurzes Gedicht über den Ozean.“

- Codierungsfrage: „Erklären Sie, wie man eine Liste in Python sortiert.“

- Begründung/Zusammenfassung: „Fassen Sie die Kernpunkte des Klimawandels in zwei Sätzen zusammen.“

Beachten Sie die Reaktionszeiten. Die größeren Modelle sind langsamer. Mit Ollama ist es einfach, lokal mit Gemma 4 zu interagieren.

Praktische Projektentwicklung mit Claude Code CLI und Gemma 4

Wir werden ein zweites Gehirn schaffen, das von KI angetrieben wird. Dieses Projekt bietet Antworten auf Ihre lokalen Dateien. Es fasst auch Dokumente zusammen. Dieser Teil zeigt seine Entwicklung. Claude Code CLI wird unser Codierungsassistent sein. Insbesondere werden wir Claude Code CLI so einstellen, dass es lokal mit Gemma 4 und Ollama als seinem großen Sprachmodell funktioniert. Dies macht unsere gesamte Entwicklung und unser gesamtes Projekt lokal und privat.

Einrichten der Claude Code-CLI für die Verwendung von Gemma 4

Claude Code CLI ist ein Agenten-Codierungstool. Es funktioniert direkt in Ihrem Terminal. Es hilft bei der Codegenerierung, beim Debuggen und beim Refactoring.

Set up:

Claude Code CLI funktioniert unter macOS (10.15+), Linux und Home windows (10+ über WSL/Git Bash). Es benötigt mindestens 4 GB RAM. 8 GB oder mehr sind besser.

Für macOS und Linux lautet das empfohlene native Installationsprogramm:

curl -fsSL https://claude.ai/set up.sh | bashFür macOS-Benutzer ist Homebrew eine Choice:

brew set up --cask claude-codeClaude Code CLI über Ollama mit Gemma 4 verbinden:

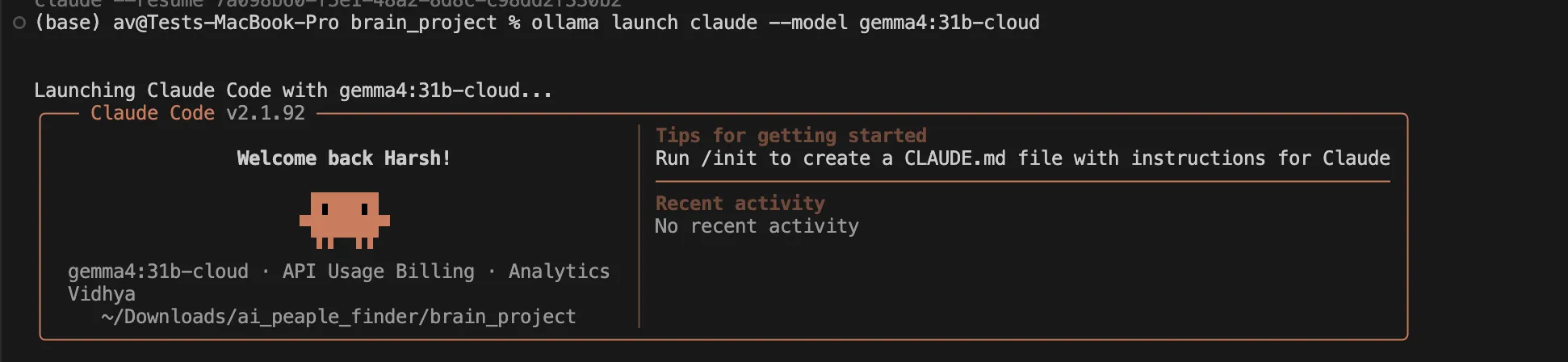

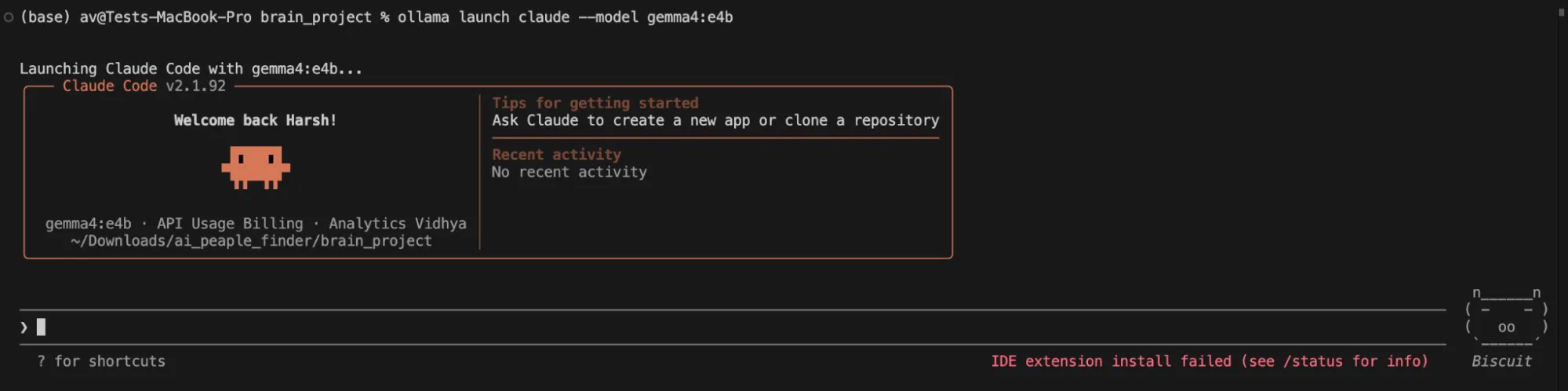

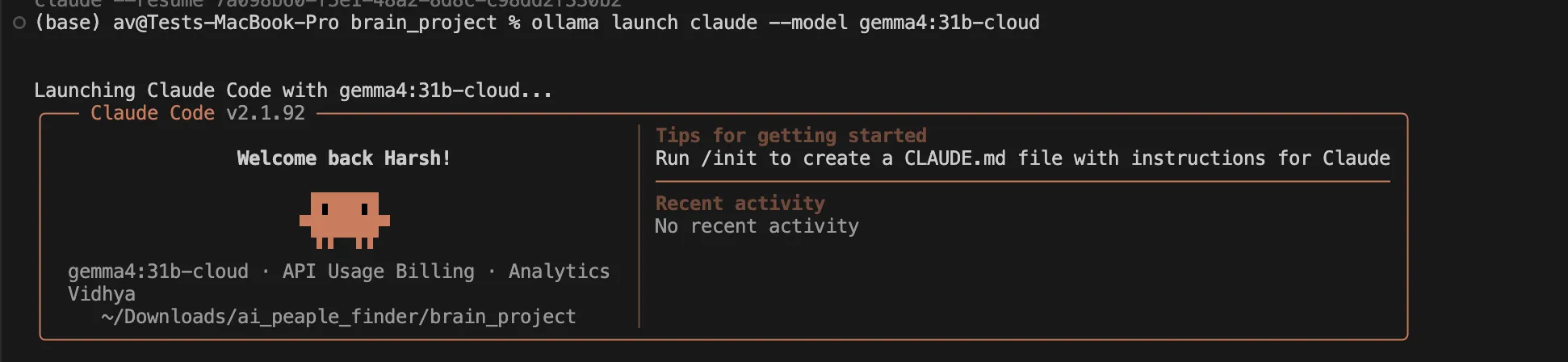

Nachdem Sie Claude Code CLI installiert und Ihr gewünschtes gemma4-Modell mit Ollama abgerufen haben, können Sie Claude Code CLI starten und es anweisen, Gemma 4 zu verwenden:

ollama launch claude --model gemma4:e4b (Substitute e4b together with your chosen variant).Dieser Befehl weist Claude Code CLI an, seine LLM-Anfragen an Ihre lokale Ollama-Instanz weiterzuleiten, insbesondere unter Verwendung des von Ihnen abgerufenen gemma4-Modells. Für den Betrieb in diesem vollständig lokalen Setup ist kein Anthropic-API-Schlüssel erforderlich.

Praktische Schritte zum Aufbau des „zweiten Gehirns“

Wir verwenden Claude Code CLI um Python-Code zu schreiben. Dieser Code interagiert dann mit Gemma 4 vor Ort mit Ollama.

1. Projektinitialisierung und -struktur mit Claude Code CLI

Öffnen Sie Ihr Terminal. Navigieren Sie zu Ihrem gewünschten Projektverzeichnis. Stellen Sie sicher, dass die Claude Code-CLI aktiv ist ollama launch claude --model gemma4:26b (Ersetzen Sie e4b durch die von Ihnen gewählte Variante) Befehl.

Ich benutze gemma4:26b lokal ohne jegliche Cloud-Unterstützung, mal sehen, wie es geht.

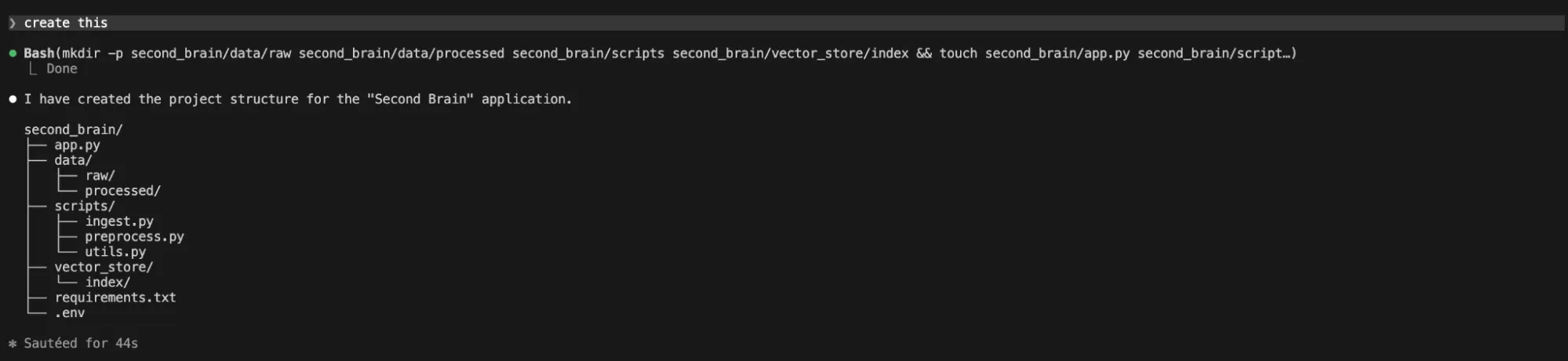

Fordern Sie die Claude Code-CLI auf, die Grundstruktur zu erstellen:

“Generate a Python mission construction for a "Second Mind" software. Embody directories for 'knowledge', 'scripts', 'vector_store', and a foremost 'app.py' file.”

Es gab mir als Antwort, dass keine Struktur erstellt wurde.

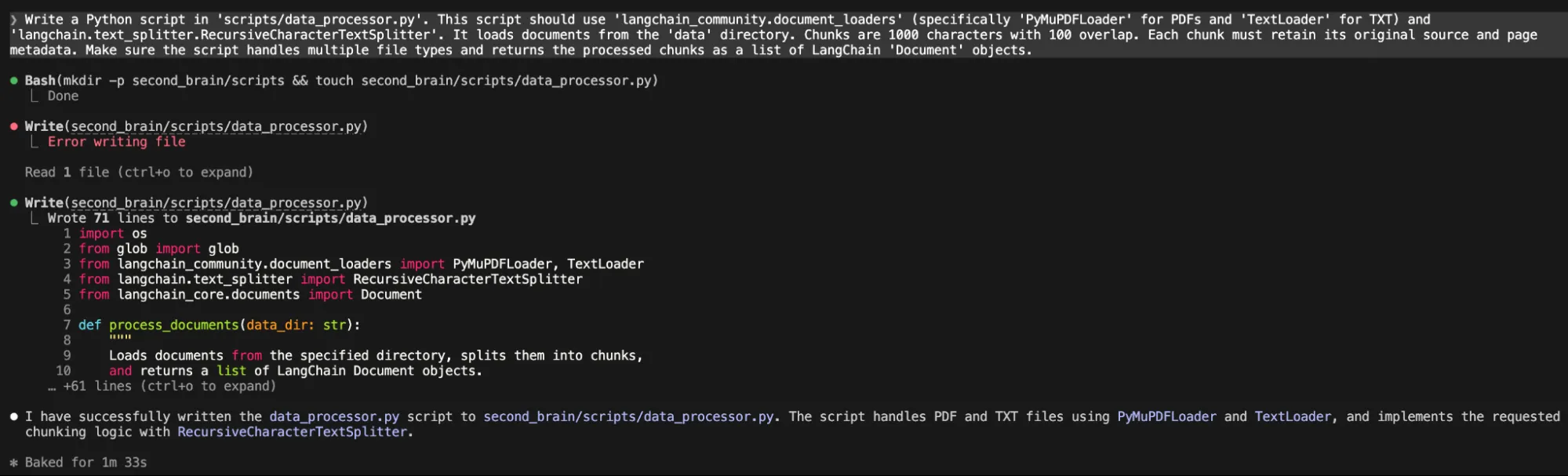

2. Doc Loader & Chunker Script (mit Claude Code CLI)

Jetzt brauchen wir ein Skript, um Dokumente zu verarbeiten.

“Write a Python script in 'scripts/data_processor.py'. This script ought to use 'langchain_community.document_loaders' (particularly 'PyMuPDFLoader' for PDFs and 'TextLoader' for TXT) and 'langchain.text_splitter.RecursiveCharacterTextSplitter'. It masses paperwork from the 'knowledge' listing. Chunks are 1000 characters with 100 overlap. Every chunk should retain its unique supply and web page metadata. Ensure that the script handles a number of file sorts and returns the processed chunks as a listing of LangChain 'Doc' objects.“

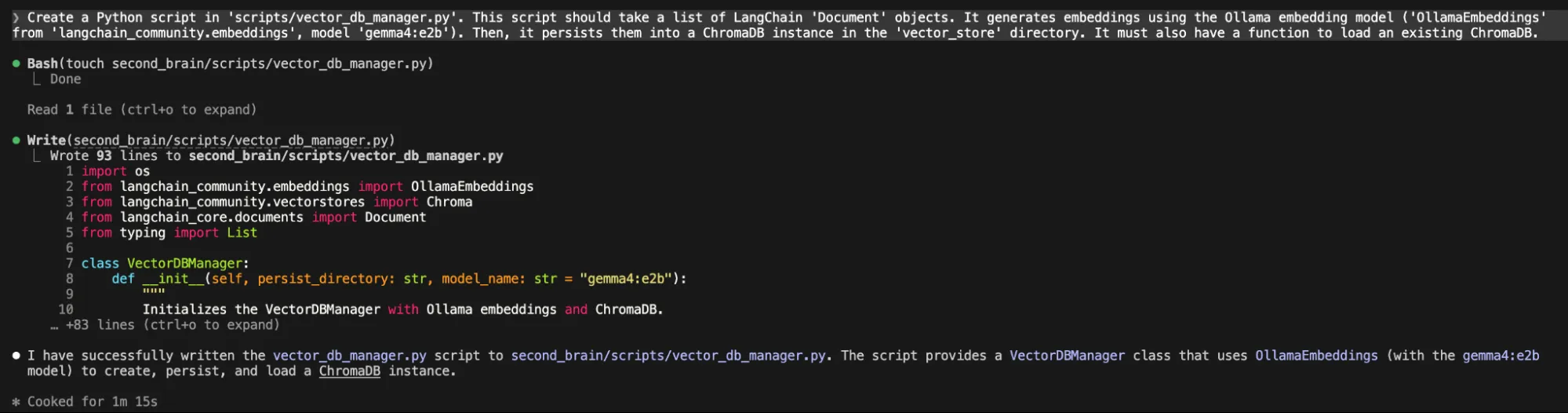

3. Einbettungs- und Vector Retailer-Skript (mit Claude Code CLI)

Als nächstes generieren wir Einbettungen und speichern sie.

“Create a Python script in 'scripts/vector_db_manager.py'. This script ought to take a listing of LangChain 'Doc' objects. It generates embeddings utilizing the Ollama embedding mannequin ('OllamaEmbeddings' from 'langchain_community.embeddings', mannequin 'gemma4:e2b'). Then, it persists them right into a ChromaDB occasion within the 'vector_store' listing. It should even have a operate to load an present ChromaDB.”

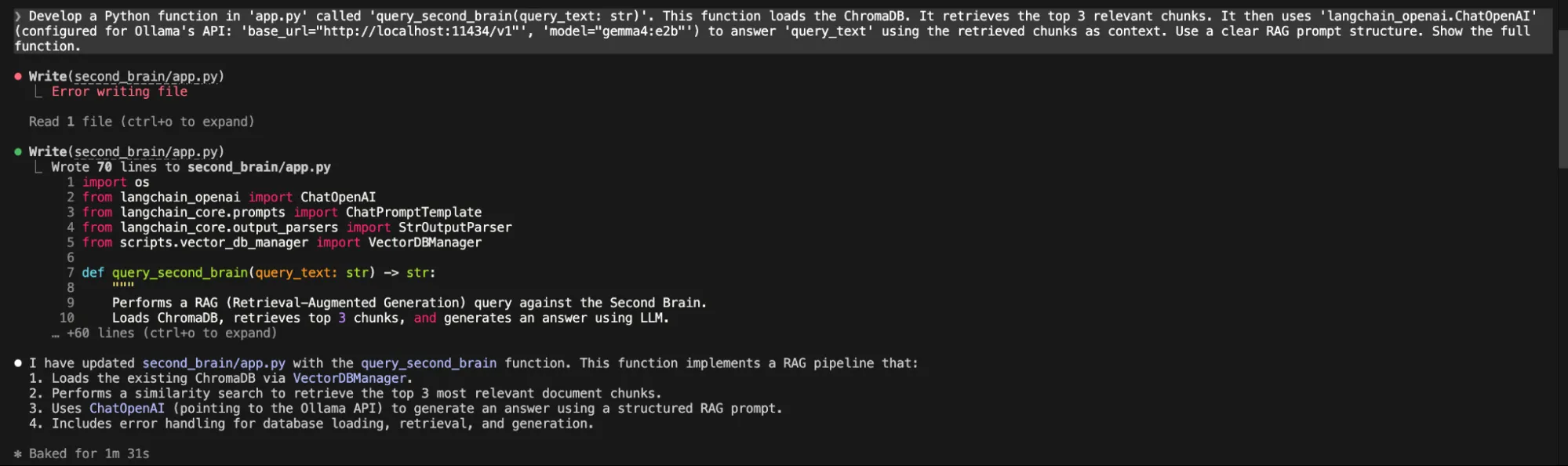

4. RAG-Abfragefunktion (mit Claude Code CLI)

Nun zur Kernfrage-Beantwortung.

“Develop a Python operate in 'app.py' known as 'query_second_brain(query_text: str)'. This operate masses the ChromaDB. It retrieves the highest 3 related chunks. It then makes use of 'langchain_openai.ChatOpenAI' (configured for Ollama's API: 'base_url="http://localhost:11434/v1"', 'mannequin="gemma4:e2b"') to reply 'query_text' utilizing the retrieved chunks as context. Use a transparent RAG immediate construction. Present the total operate.”

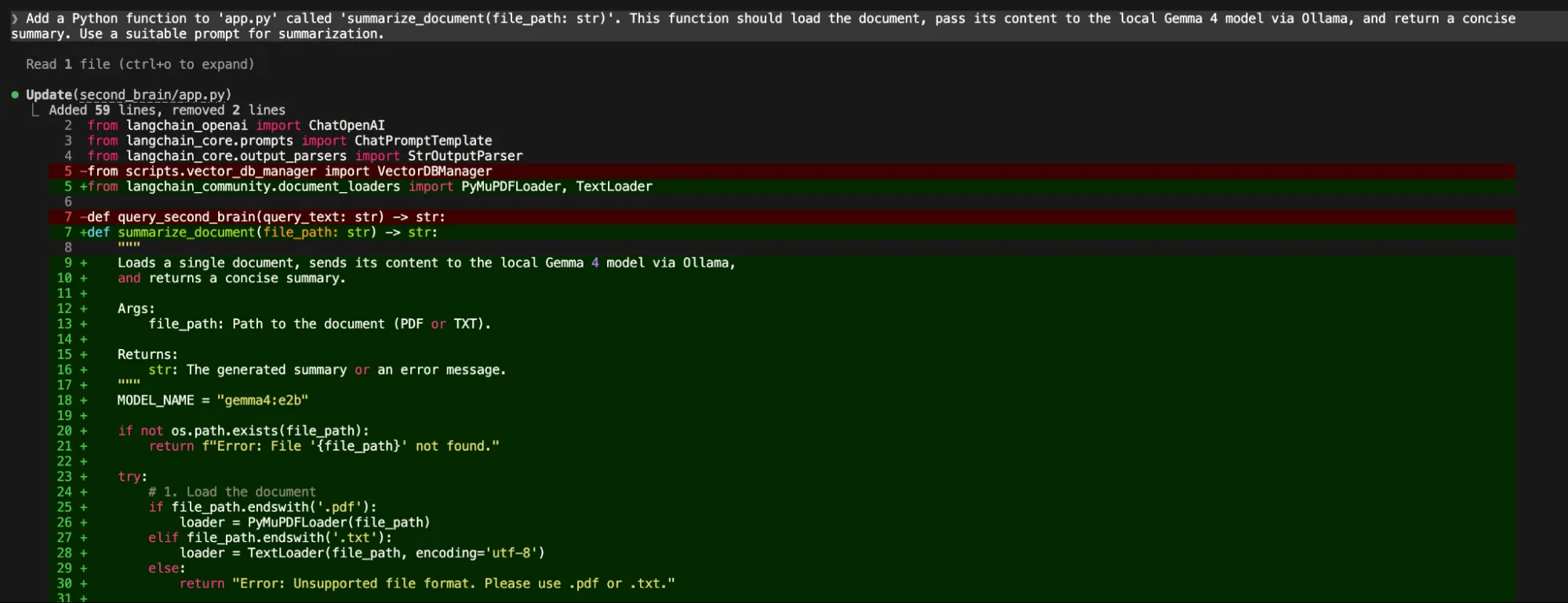

5. Zusammenfassungsfunktion (mit Claude Code CLI)

Zum Schluss noch eine Zusammenfassungsfunktion.

“Add a Python operate to 'app.py' known as 'summarize_document(file_path: str)'. This operate ought to load the doc, move its content material to the native Gemma 4 mannequin through Ollama, and return a concise abstract. Use an appropriate immediate for summarization.”

Durch jeden Schritt, Claude Code CLIpowered by Gemma 4, hat den Code generiert. Gemma 4 selbst führte die zentralen KI-Aufgaben des Projekts durch.

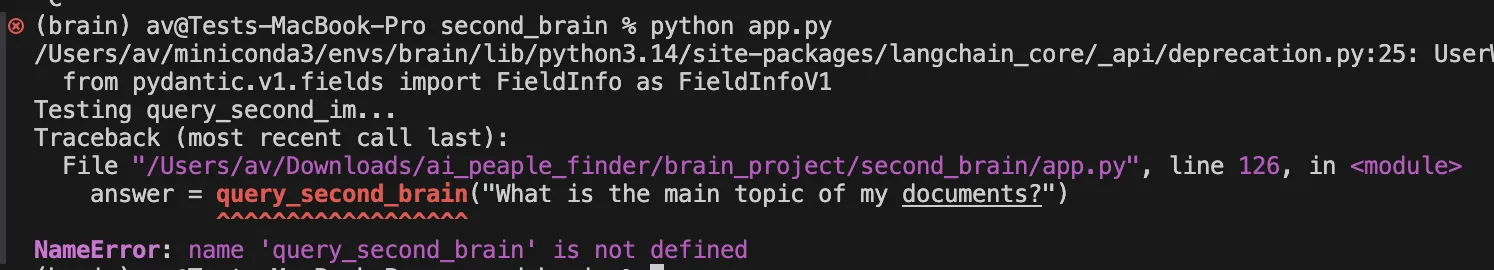

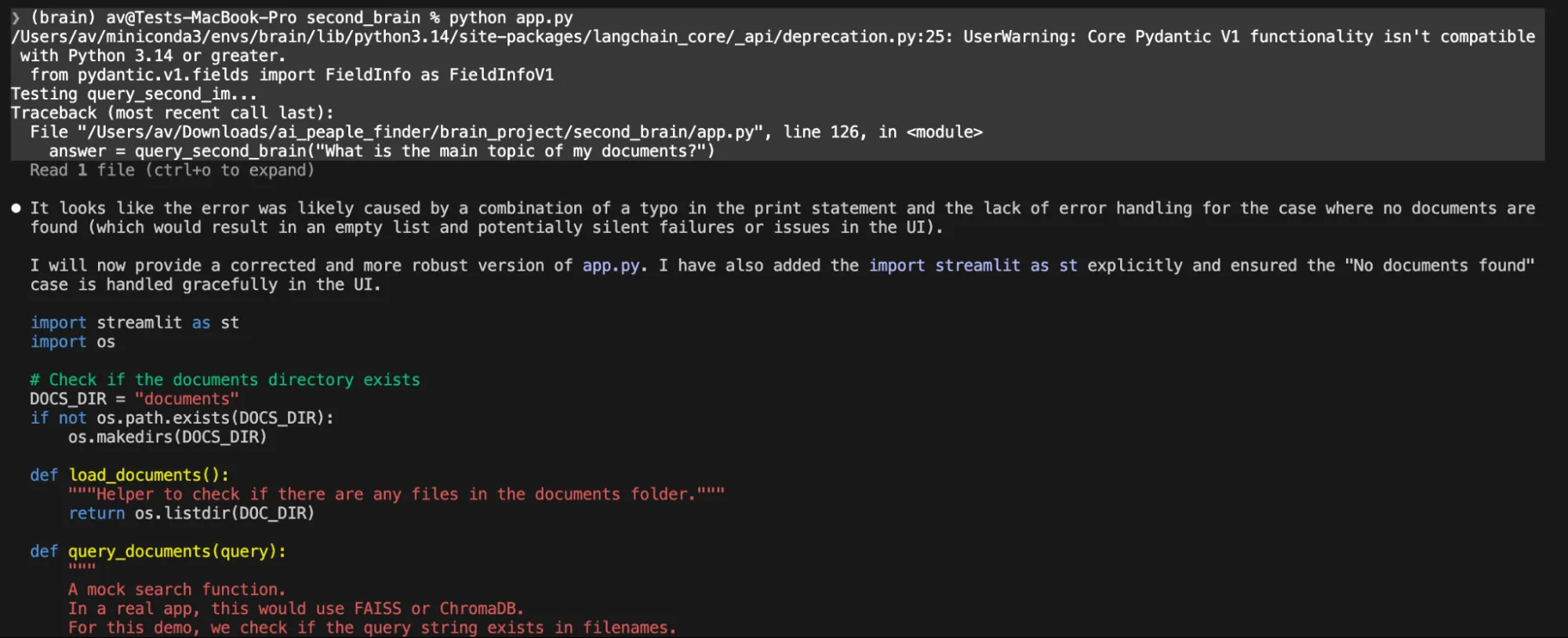

NOTIZ: Beim Ausführen des endgültigen Codes python app.py Wie von Gemma4 vorgeschlagen, ist ein Fehler aufgetreten.

Ich habe versucht, das Drawback zu beheben, indem ich für mehrere Iterationen den genauen Fehler angegeben habe, aber dieses lokale Modell battle nicht in der Lage, den Code zu reparieren. Der Claude-Code ist mehrmals kaputt gegangen, weil er nur die Zusammenfassung, aber keine Änderungen bereitgestellt hat.

In einer Eingabeaufforderung wurde uns lediglich der Codeinhalt mit der Aufforderung gegeben, selbst eine Datei zu erstellen.

Wir haben uns dann entschieden, auf die Cloud-Model von umzusteigen gemma4:31b das in der Ollama-Cloud in einem kostenlosen Kontingent verfügbar ist. Verwenden Sie einfach diesen Befehl

ollama launch claude --model gemma4:31b-cloudSie werden aufgefordert, sich im Browser anzumelden. Tun Sie dies einfach und schon können Sie mit dem Codieren beginnen.

Wir haben ihm eine einfache Aufforderung gegeben

❯ analyse the @second_brain/ mission and make a full plan to make the mission purposefulAnschließend analysierte das Gemma 4 31b-Cloud-Modell das gesamte Projekt und korrigierte jeden Code. Es dauerte quick 7 Minuten, diese Arbeit zu erledigen, aber es wurde jeder einzelne fehlerhafte Code vervollständigt und die vollständige Funktionsfähigkeit der App überprüft.

Testen der App

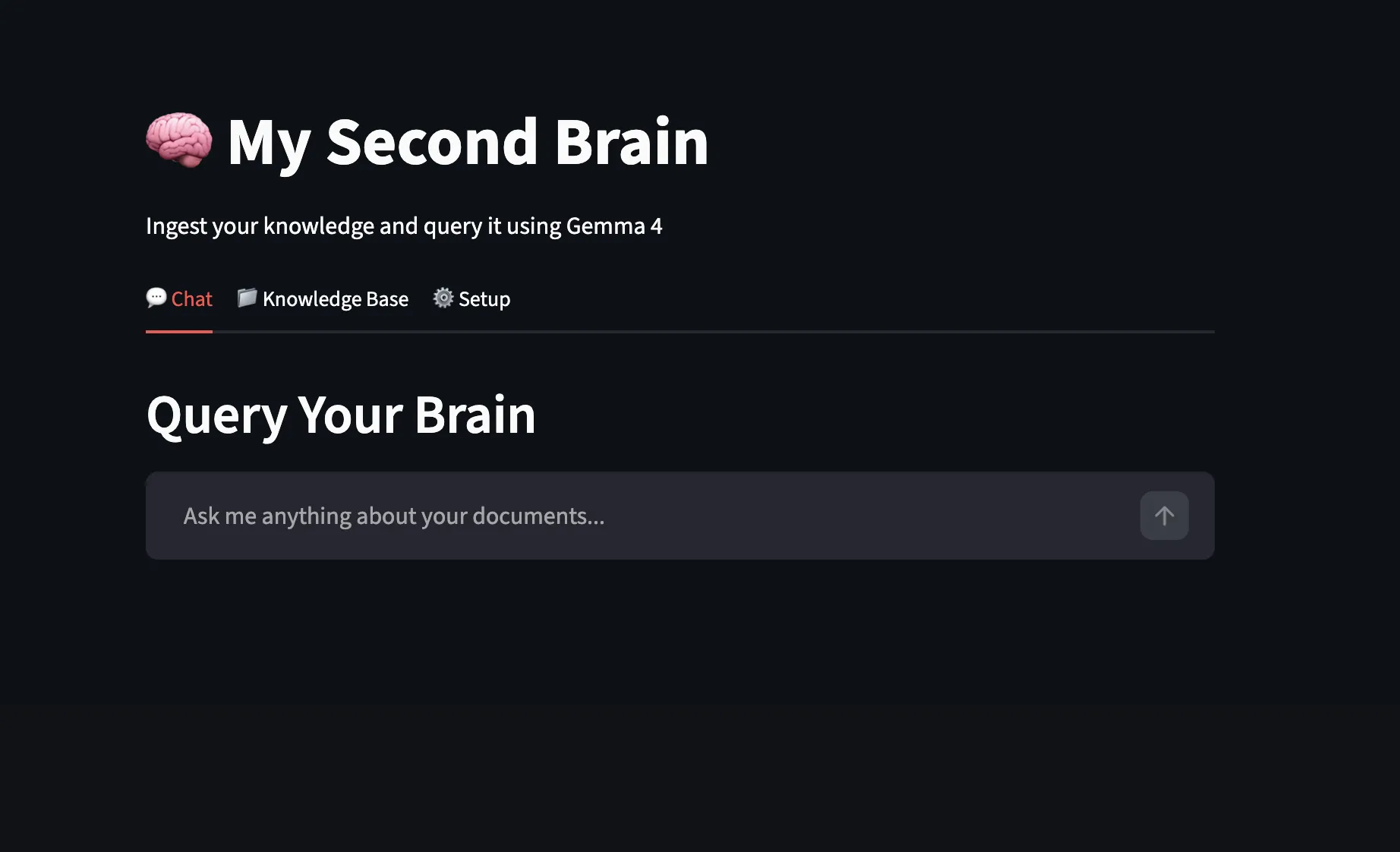

Beim Öffnen der App sieht es so aus.

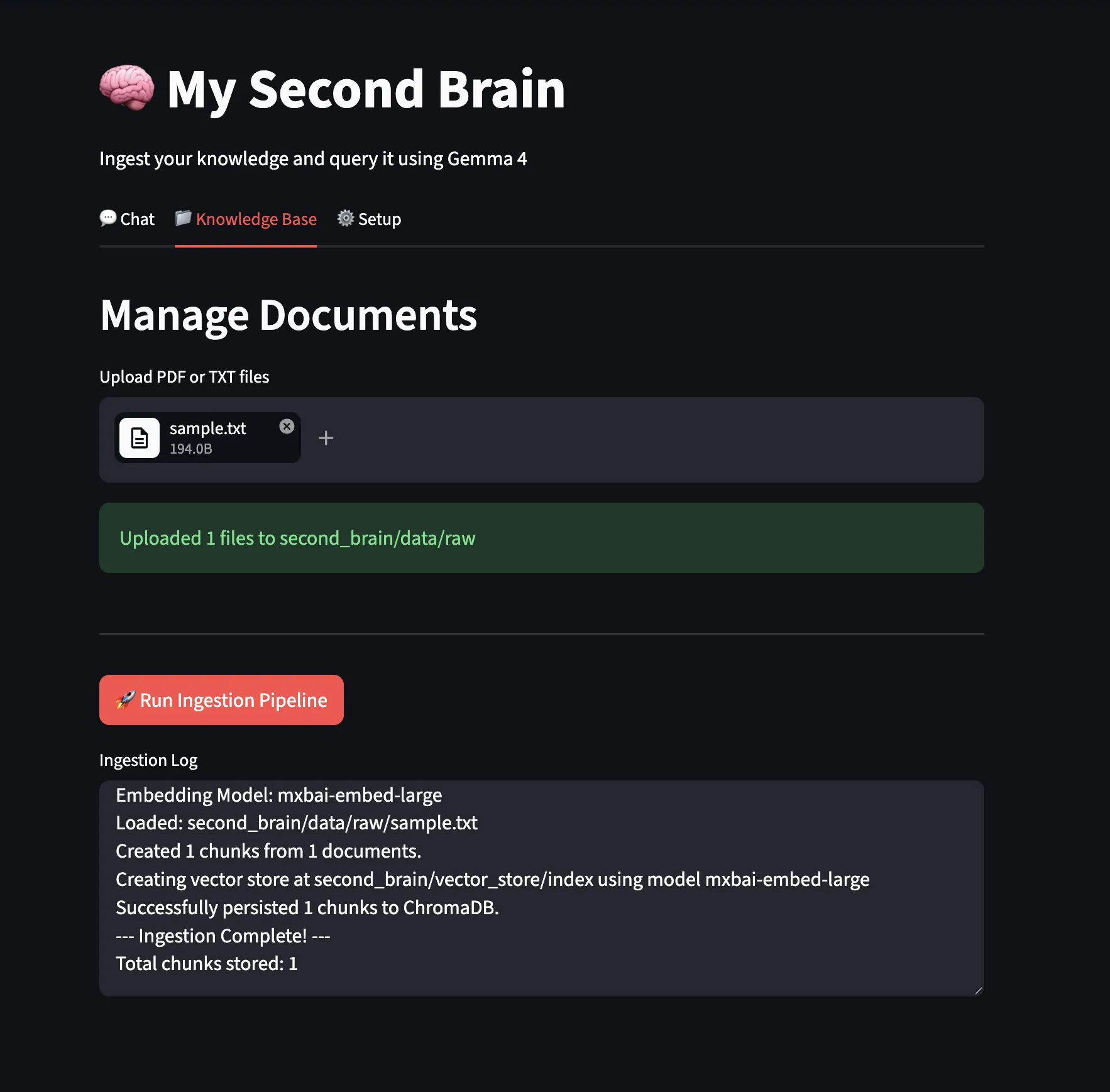

Wir haben eine Beispieltextdatei hochgeladen und die Aufnahmepipeline ausgeführt.

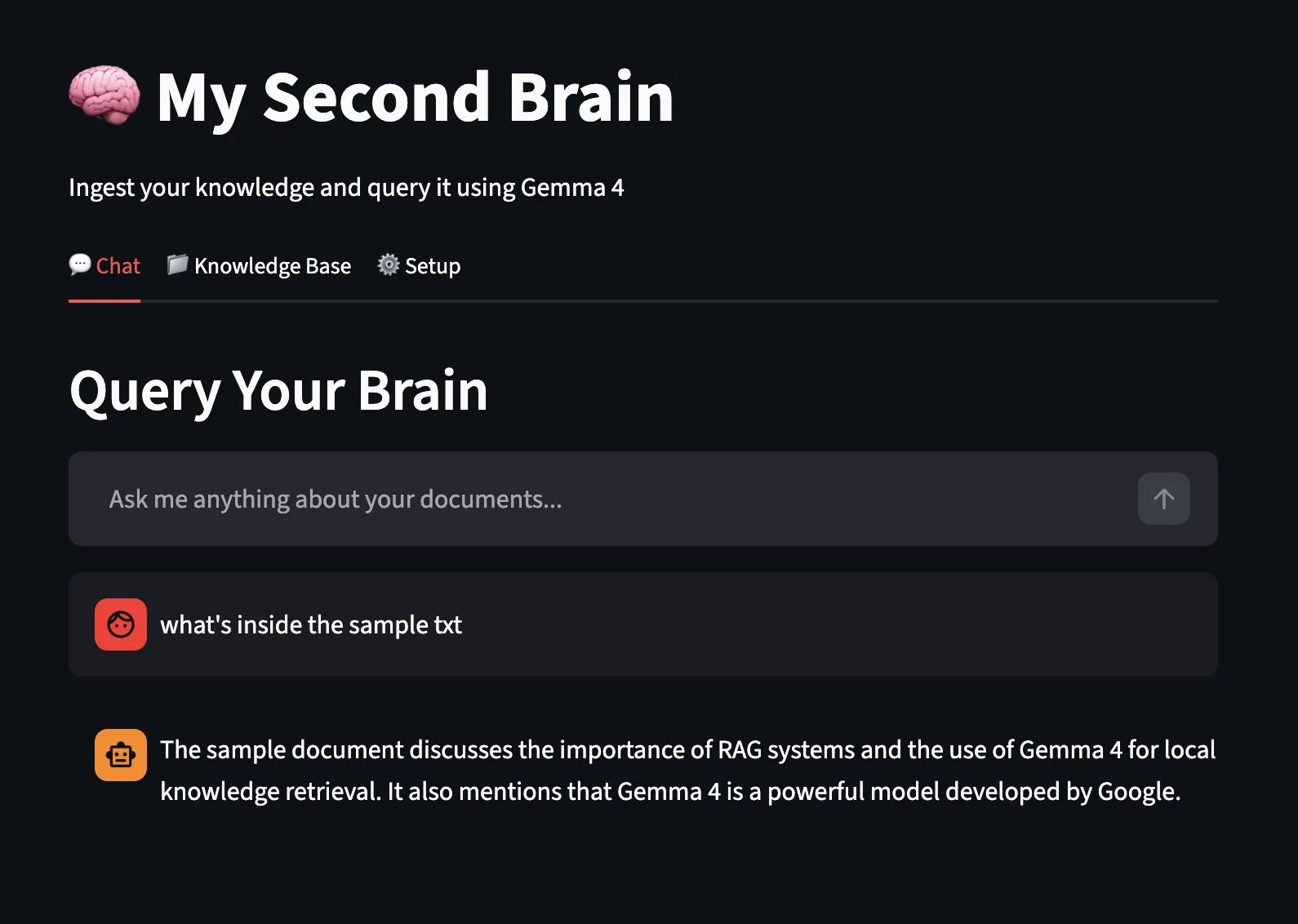

Testen wir nun die Chat-Funktion mit dem lokalen Gemma4-Modell und dem lokalen Ollama-Endpunkt zur Beantwortung:

Nach zahlreichen Iterationen glaube ich, dass die lokale Ausführung von Modellen und deren Verwendung zur Codegenerierung mit einem beliebten Instrument wie Claude Code noch ein langer Weg vor uns liegt. Während lokale LLMs, die auf Privat-PCs laufen, vielversprechend sind, unterliegen sie erheblichen Einschränkungen hinsichtlich Hardwareanforderungen, Inferenzlatenz und Intelligenzeinschränkungen. Um komplexe Arbeiten effizient erledigen zu können, mussten wir letztendlich wieder auf cloudbasierte Modelle umsteigen.

Abschluss

Von der Set up bis zur Erkundung der verschiedenen Varianten ist klar, dass diese Modellfamilie für den praktischen, realen Einsatz konzipiert ist. Wenn Sie es lokal ausführen, haben Sie die Kontrolle über Daten, verringern die Abhängigkeit von externen APIs und öffnen die Tür zum Aufbau schnellerer, privaterer Arbeitsabläufe.

Das Second Mind-Projekt zeigt, was möglich ist, wenn Sie Gemma 4 mit Instruments wie Claude Code CLI kombinieren. Dieses Hybrid-Setup verbindet fundiertes Denken mit effizienter Entwicklung und erleichtert so den Aufbau intelligenter Systeme, die in der Produktion funktionieren.

Häufig gestellte Fragen

A. Bei lokaler Verwendung mit Ollama garantiert Gemma 4 den Datenschutz, senkt die API-Gebühren und ermöglicht den Offline-Zugriff auf leistungsstarke KI-Dienste.

A. Je nach RAM Ihres Mac ist die Variante Gemma 4 die am besten geeignete Variante. E2B/E4B geeignet für 8 GB+ RAM. 26B/31B-Varianten benötigen 16 GB–24 GB+ VRAM.

A. Ein persönliches Wissenssystem ist ein KI-gestütztes zweites Gehirn. Es beantwortet Fragen und fasst lokale Dokumente mithilfe lokaler LLMs zusammen.

Melden Sie sich an, um weiterzulesen und von Experten kuratierte Inhalte zu genießen.