Einführung

Ein grundlegender Bestandteil von Statistische TechnikRegressionsanalysen sind unerlässlich, um Zusammenhänge zwischen Variablen zu untersuchen und zu messen. Ihre Einsatzmöglichkeiten sind vielfältig und reichen von der Prognose finanzieller Traits bis hin zur Auswertung medizinischer Ergebnisse. Dieses ausführliche Handbuch untersucht das Wesen der Regressionsanalyse und erklärt ihre verschiedenen Arten, Anwendungen und zugrunde liegenden Konzepte.

Überblick

- Entdecken Sie die verschiedenen Regressionstechniken, ihre Verwendung und die zugrunde liegende Mathematik.

- Erwerben Sie Kenntnisse über grundlegende Konzepte, einschließlich der Regressionsgleichung, der Koeffizientenauswertung und der Qualität von Anpassungsmetriken.

- Untersuchen Sie die grundlegenden Annahmen der Regressionsanalyse und ihre Bedeutung für vertrauenswürdige Ergebnisse.

- Erkennen Sie die vielen Möglichkeiten, wie Regressionsanalysen in verschiedenen Kontexten verwendet werden können.

- Analysieren Sie die Vor- und Nachteile der Regressionsanalyse und berücksichtigen Sie dabei ihre Diagnosefähigkeiten, die Quantifizierung von Korrelationen, die Möglichkeit, Störfaktoren zu berücksichtigen, ihre Vorhersagestärke und ihre Grenzen.

Was ist Regressionsanalyse?

Die Regressionsanalyse ist eine zuverlässige statistische Methode zur Ermittlung der Beziehung zwischen einer abhängigen Variable und einer oder mehreren unabhängigen Variablen. Sie verdeutlicht, wie sich Änderungen der unabhängigen Komponenten auf die abhängige Variable auswirken, und ist damit ein grundlegendes Konzept in den Bereichen Finanzen, Wirtschaft und Sozialwissenschaften.

Arten der Regression

- Einfache lineare Regression: So einfach lineare Regression zeigt, stellt eine Linie, die durch die angezeigten Datenpunkte verläuft, den Zusammenhang zwischen einer Prädiktorvariablen und einer Respondervariablen dar. Ziel ist es, den Umsatz beispielsweise über die für Werbung ausgegebenen Beträge zu ermitteln oder das Niveau der abhängigen Variablen numerisch so anzunähern, dass es dem Niveau der unabhängigen Variablen entspricht.

- A number of lineare Regression: A number of lineare Regression verwendet zwei oder mehr unabhängige Variablen, um eine einzelne abhängige Variable vorherzusagen, und erweitert damit die Möglichkeiten der grundlegenden linearen Regression. Diese Methode schätzt Immobilienwerte basierend auf Größe, Standort und Alter und spiegelt den kumulativen Einfluss mehrerer Faktoren auf die abhängige Variable wider.

- Logistische Regression: Logistische Regression wird verwendet, wenn die abhängige Variable kategorisch oder binär ist (z. B. wahr oder falsch, ja/nein). Anstatt eine gerade Linie anzupassen, um die Wahrscheinlichkeit eines bestimmten Ergebnisses vorherzusagen, wird eine logistische Funktion (Sigmoidkurve) verwendet. Beispielsweise kann vorhergesagt werden, ob ein Verbraucher einen Kauf tätigen wird (ja oder nein).

- Polynomische Regression: Polynomische Regression verwendet ein Polynom n-ten Grades, um die Beziehung zwischen den unabhängigen und abhängigen Variablen auszudrücken. Durch Ändern der Prädiktoren können nun komplexere, nichtlineare Verbindungen angepasst werden.

Lesen Sie auch: 7 Regressionstechniken, die Sie kennen sollten!

Die Regressionsgleichung

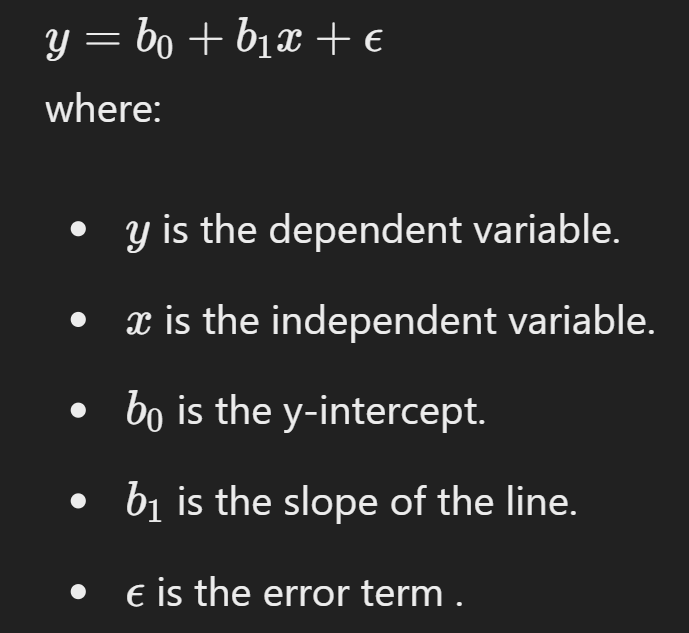

Die Grundidee besteht darin, eine mathematische Gleichung an beobachtete Daten anzupassen. Bei einer einfachen linearen Regression lautet die Gleichung:

Interpretation der Koeffizienten

Der Koeffizienten stellen den Achsenabschnitt und die Steigung dar. Sie zeigen, dass die Menge an j variiert, wenn X erhöht sich um eine Einheit. Jede unabhängige Variable in der multiplen Regression hat einen Koeffizienten, der ihren Einfluss auf die abhängige Variable darstellt.

Messen der Anpassungsgüte

- R-Quadrat (R²): Der Prozentsatz der Volatilität der abhängigen Variablen kann auf der Grundlage der unabhängigen Variablen vorhergesagt werden. Höhere R² Werte deuten auf eine bessere Übereinstimmung hin.

- Angepasstes R-Quadrat: Dieser Ansatz liefert eine genauere Schätzung in multiplen Regressionseinstellungen durch Anpassung R² für die Anzahl der Prädiktoren im Modell.

- P-Werte: Bewerten Sie die Signifikanz der Koeffizienten. Niedrige P-Werte, normalerweise weniger als 0,05, weisen darauf hin, dass die Assoziation statistisch signifikant ist.

Annahmen bei der Regression

- Linearität: Die Beziehung zwischen abhängigen und unabhängigen Variablen sollte linear sein.

- Unabhängigkeit: Beobachtungen sollten unabhängig voneinander sein.

- Homoskedastizität: Die Varianz der Fehler sollte über alle Ebenen der unabhängigen Variablen hinweg konsistent sein.

- Normalität: Normalerweise sollte man die Fehler verteilen.

Anwendungen der Regressionsanalyse

- Geschäft und Wirtschaft: Die Regressionsanalyse hilft Unternehmen, Umsätze vorherzusagen, Preise anzupassen und nach Marktindikatoren zu suchen. Sie wird auch verwendet, um zu verstehen wirtschaftliche Faktoren wie BIP und Arbeitslosigkeit.

- Finanzen: Sie ermöglichen die Bewertung der Risiken, denen eine bestimmte Anlage und ein bestimmtes Portfoliomanagement ausgesetzt ist, indem sie die Abhängigkeit zwischen Vermögenspreisen und anderen Variablen wie Zinssätzen oder Gewinnen aufzeigen.

- Gesundheitspflege: Dabei werden Informationen zu klinischen und demografischen Daten von Patienten verwendet, um Faktoren zu identifizieren, die mit Krankheiten in Zusammenhang stehen. Außerdem wird die Wirksamkeit therapeutischer Interventionen bewertet und der Behandlungserfolg von Patienten prognostiziert.

- Advertising: Bei der Regressionsanalyse handelt es sich um eine Methode, die von Vermarktern verwendet wird, um Umsätze vorherzusagen, Werbekampagnen auszuwerten und das Verbraucherverhalten zu analysieren.

- Sozialwissenschaften: Soziologen und Psychologen verwenden Regressionsanalysen, um die Beziehungen zwischen Variablen und Ergebnissen wie Bildungs- und Einkommensmustern zu verstehen.

Vorteile der Regressionsanalyse

- Vorhersagekraft: Die Daten dieser Forschung wurden durch Regressionsanalysen analysiert, um Erkenntnisse zu zukünftigen Ergebnissen zu gewinnen. Wenn die Abhängigkeit zwischen den Variablen verstanden wird, können zukünftige Aussichten, Umsätze und andere Faktoren im Element berechnet werden.

- Quantifizierung von Beziehungen: Es bietet einen präzisen mathematischen Rahmen zur Berechnung der Richtung und Intensität von Korrelationen zwischen verschiedenen Variablen. Dies hilft zu verstehen, wie sich Änderungen an einer Variablen auf Änderungen an einer anderen auswirken.

- Kontrolle von Störvariablen: Die a number of Regression kann mehrere unabhängige Variablen umfassen, was dabei hilft, den Einfluss einer Variablen zu bestimmen und gleichzeitig andere zu berücksichtigen. Dies ist besonders in anspruchsvollen Situationen der realen Welt hilfreich.

- Diagnosewerkzeuge: Die Regressionsanalyse unterstützt die Validierung und Verbesserung von Modellen, indem sie Diagnosetools (wie R-Quadrat, p-Werte und Residuendiagramme) zur Bewertung der Modellanpassung und der Bedeutung von Prädiktoren bereitstellt.

- Vielseitigkeit: Die Regressionsanalyse funktioniert mit verschiedenen Datenarten und Szenarien, einschließlich kontinuierlicher, kategorischer und binärer Ergebnisse. Darüber hinaus ist sie auf viele Berufe anwendbar, darunter Wirtschaftswissenschaften, Ingenieurwissenschaften und Sozialwissenschaften.

- Leichtigkeit der Durchsetzung: Dank moderner statistischer Software program und Instruments ist die Regressionsanalyse heute einfacher anzuwenden, auch für Personen ohne umfassende statistische Kenntnisse. Die Prozessvereinfachung wird durch automatisierte Instruments erreicht in Python, Rund andere Plattformen.

- Hypothesentest: Mithilfe der Regressionsanalyse können Theorien über die Korrelationen zwischen Variablen getestet werden. Sie bietet eine Struktur zur Bestimmung, ob bestimmte Prädiktoren die abhängige Variable signifikant beeinflussen.

Nachteile der Regressionsanalyse

- Annahmeabhängigkeiten: Regressionsmodellen liegen mehrere Annahmen zugrunde, darunter Linearität, Unabhängigkeit, Homoskedastizität und Fehlernormalität. Werden diese Annahmen missachtet, kann dies zu fehlerhaften oder irreführenden Ergebnissen führen.

- Multikollinearität: Viele unabhängige Variablen können die Ergebnisse beeinflussen, wodurch es schwierig wird, den Einfluss spezifischer Prädiktoren zu bestimmen.

- Überanpassung: Beim Coaching mit Trainingsdaten überangepasste Modelle können zu schlechteren Vorhersagen neuer Daten führen. Dies geschieht, wenn das Modell zusätzlich zum Sign auch Rauschen erfasst.

- Sensitivität gegenüber Ausreißern: Ausreißer können die Koeffizienten und Ergebnisse des Modells in der Regressionsanalyse erheblich verändern.

- Begrenzt durch lineare Beziehungen: Die Annahme einer linearen Verbindung zwischen Variablen in einer einfachen linearen Regression ist möglicherweise nicht in allen Fällen zutreffend. Für kompliziertere Interaktionen benötigen Forscher fortgeschrittene Methoden wie polynomische Regression oder Modelle des maschinellen Lernens.

- Interpretierbarkeitsprobleme: Es kann schwierig sein, zu bestimmen, wie sich jeder Prädiktor auf die Ergebnisse eines Modells mit vielen Prädiktoren auswirkt, insbesondere bei multipler Regression. Diese Schwierigkeit wird noch größer, wenn es Wechselwirkungen zwischen den Variablen gibt.

- Anforderungen an die Probengröße: Für die Regressionsanalyse ist eine beträchtliche Stichprobengröße erforderlich, um genaue Schätzungen zu liefern. Kleine Stichprobengrößen können zu instabilen Schätzungen und unzureichender Verallgemeinerung führen.

Abschluss

Als grundlegendes Werkzeug zur Datenanalyse liefert die Regressionsanalyse weiterhin Erkenntnisse und Vorhersagekraft für eine breite Palette von Anwendungen. Die Zuverlässigkeit hängt jedoch davon ab, dass Annahmen, Modellauswahl und Validierung genau beachtet werden, auch wenn sie wertvolle Werkzeuge für Prognosen und das Verständnis von Beziehungen bietet.

Häufig gestellte Fragen

A. Die Regressionsanalyse ist eine statistische Methode, die verwendet wird, um die Beziehung zwischen einer abhängigen Variablen und einer oder mehreren unabhängigen Variablen zu verstehen.

A. Es zeigt Ihnen, wie Änderungen der unabhängigen Variablen mit Änderungen der abhängigen Variablen zusammenhängen und hilft so, die abhängige Variable vorherzusagen oder zu erklären.

A. Der Hauptzweck besteht darin, die Beziehung zwischen Variablen zu modellieren, um Vorhersagen, Einblicke in kausale Beziehungen und ein Verständnis der Stärke dieser Beziehungen zu ermöglichen.

A. Ein Beispiel ist die Vorhersage des Gehalts einer Particular person (abhängige Variable) auf Grundlage ihrer Berufserfahrung und ihres Bildungsniveaus (unabhängige Variablen).