Künstliche Intelligenz hat sich schnell von experimentellen Pilotprojekten zum täglichen operativen Einsatz in den Bereichen Vertrieb, Advertising and marketing und Finanzen entwickelt. Unternehmen setzen KI-gesteuerte Dashboards, prädiktive Prognosetools und Analysen in natürlicher Sprache ein, um die Entscheidungsfindung zu beschleunigen und den manuellen Berichtsaufwand zu reduzieren.

Doch mit der zunehmenden Einführung von KI in allen Abteilungen entsteht eine entscheidende Herausforderung: unzuverlässige Ergebnisse aufgrund inkonsistenter zugrunde liegender Daten.

Die Diskussion beginnt sich von „Welches KI-Device ist das fortschrittlichste?“ zu verlagern. zu einer grundlegenderen Frage: „Sind unsere Daten intestine genug strukturiert, um den Ergebnissen zu vertrauen?“

Für Unternehmensleiter, die Analyseinvestitionen bewerten, wird die Verfügbarkeit von KI-Daten schnell zum entscheidenden Faktor zwischen Einblick und Instabilität.

Die wachsende Kluft zwischen KI-Fähigkeit und Datenstruktur

Moderne KI-Plattformen wie Databricks, ThoughtSpot, Glean und Unleash bieten leistungsstarke Modellierung, Abfragen in natürlicher Sprache und Vorhersagefunktionen. Diese Instruments haben fortgeschrittene Analysen für technisch nicht versierte Benutzer zugänglicher gemacht und die Hürde bei der Datenexploration drastisch gesenkt.

Diese Plattformen basieren jedoch auf einer Grundannahme: Die ihnen zugeführten Daten sind bereits einheitlich, normalisiert und systemübergreifend konsistent.

In vielen Organisationen trifft diese Annahme nicht zu.

Verkaufsdaten können in einem CRM gespeichert sein, das je nach Group oder Area unterschiedlich konfiguriert ist. Marketingplattformen definieren möglicherweise Kennzahlen wie Conversions, Attribution und Lead-Standing mithilfe inkonsistenter Logik. Finanzteams gleichen Zahlen oft über tabellenbasierte Konsolidierungsprozesse ab, die Risiken bei der Versionskontrolle mit sich bringen. Datenexporte werden für die Berichterstellung häufig manuell zusammengestellt.

Wenn KI-Modelle inkonsistente Eingaben verarbeiten, können die Ergebnisse auf subtile, aber sinnvolle Weise variieren. Prognosen ändern sich unerwartet. Attributionsmodelle führen zu widersprüchlichen Ergebnissen. Finanzielle Dashboards stimmen nicht mit betrieblichen Kennzahlen überein.

Mit der Zeit schwächt dies das Vertrauen der Führungskräfte in KI-gestützte Erkenntnisse.

Laut Sergiy Korolov, Mitbegründer von Coupler.io„Da die KI-Einführung zum Mainstream wird, erkennen Unternehmen, dass strukturierte, konsistente Dateneingaben darüber entscheiden, ob KI einen Mehrwert liefert. Die Infrastruktur hinter dem Modell ist genauso wichtig wie das Modell selbst.“

Diese Erkenntnis befeuert die Nachfrage nach einer neuen Ebene im Analyse-Stack.

Strukturierte Datenautomatisierung: Eine neue Priorität

Anstatt direkt in der Kategorie der KI-Modellierung zu konkurrieren, konzentrieren sich Plattformen wie Coupler.io auf die vorgelagerte Datenaufbereitung für die Analyse.

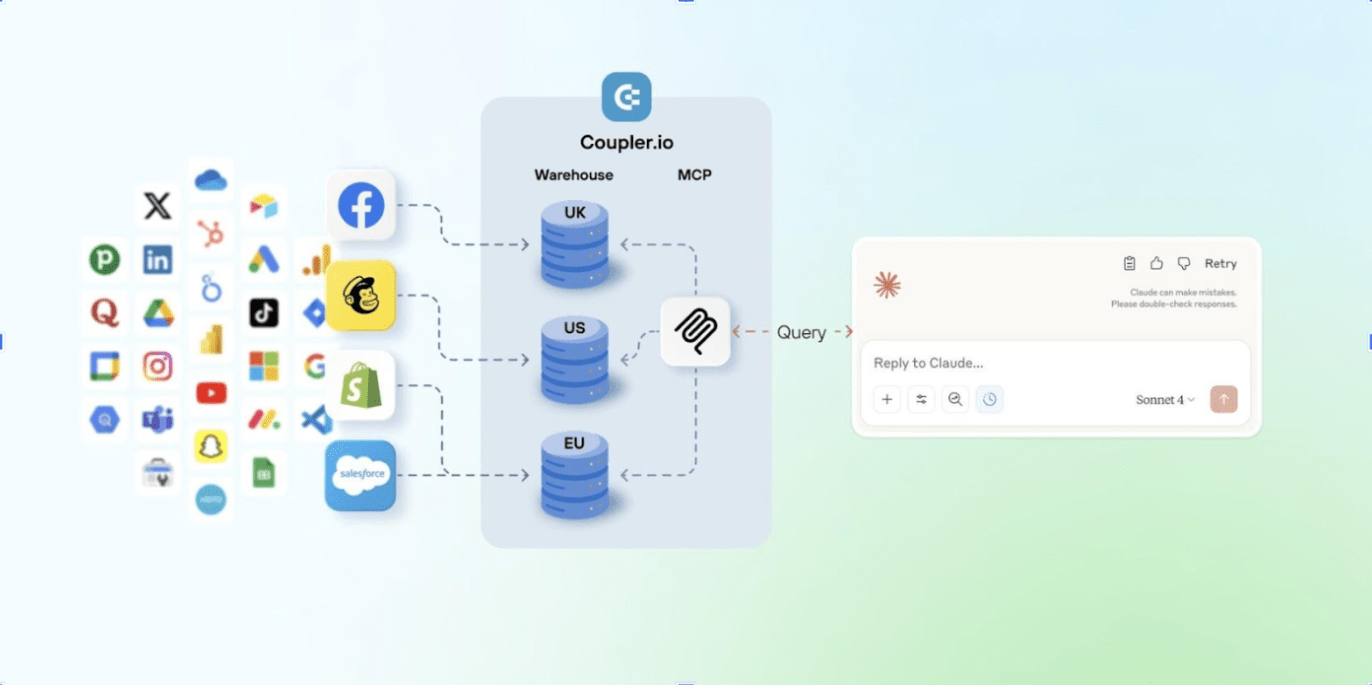

Coupler.io automatisiert die Synchronisierung wiederkehrender Daten über Geschäftsanwendungen und Plattformen hinweg und erstellt strukturierte, analysebereite Datensätze, bevor KI-Instruments angewendet werden. Die Plattform ist darauf ausgelegt, Vertriebs-, Advertising and marketing- und Finanzdaten in einen konsistenten Analyseworkflow zu integrieren und so die Abhängigkeit von manuellen Exporten und zeitaufwändigen Analysen zu reduzieren.

Durch diese Positionierung positioniert sich Coupler.io zwischen traditionellen Workflow-Automatisierungstools und ETL-Systemen der Enterprise-Klasse mit KI-Funktionen

Automatisierungsplattformen wie Zapier und Make eignen sich effektiv zum Verschieben von Daten zwischen Anwendungen basierend auf Triggern. Sie sind jedoch nicht in erster Linie für die wiederkehrende Normalisierung konzipiert, die für die Konsistenz der Analysen optimiert ist.

Enterprise-ETL-Anbieter wie Fivetran bieten leistungsstarke technische Lösungen, die große Information Warehouses unterstützen können. Diese Plattformen erfordern jedoch häufig dedizierte Datenteams, längere Implementierungszyklen und technisches Fachwissen, das in mittelständischen Unternehmen möglicherweise nicht verfügbar ist.

Der Ansatz von Coupler.io richtet sich an Geschäftsanwender, die eine strukturierte Datenautomatisierung ohne technische Komplexität benötigen.

Wie Korolov erklärt:

„Viele Unternehmen investieren viel in KI und erwarten sofortige Klarheit. Stattdessen stoßen sie oft auf Inkonsistenz. Wenn Ihre Datenpipelines fragmentiert sind, kann KI zwar Muster aufdecken, aber keine Stabilität garantieren. Zuverlässige Erkenntnisse beginnen mit einer zuverlässigen Struktur.“

Warum Entscheidungsträger im Bereich Datentools aufpassen

Für RevOps-Führungskräfte, Advertising and marketing-Analytics-Direktoren und CFOs sind KI-gesteuerte Dashboards nicht mehr elective. Sie beeinflussen die Budgetzuweisung, Einstellungsentscheidungen, Preisstrategien und die Berichterstattung des Vorstands.

In diesem Zusammenhang können selbst kleine Abweichungen in der Berichterstattung erhebliche Auswirkungen haben. Eine Umsatzprognose, die nicht mit den CRM-Definitionen übereinstimmt, kann Einstellungspläne verzerren. Ein inkonsistentes Attributionsmodell kann Marketingbudgets in die falsche Richtung verschieben. Finanzkennzahlen, die aus nicht übereinstimmenden Datenquellen abgeleitet werden, können das Vertrauen der Anleger untergraben.

Besonders wichtig ist die funktionsübergreifende Integration. Umsatzprognosen erfordern CRM-Konsistenz. Die Modellierung der Kundenakquisekosten hängt von normalisierten Advertising and marketing-Inputs ab. Die Finanzplanung erfordert konsolidierte, revisionssichere Zahlen, die abteilungsübergreifend übereinstimmen.

Instruments, die sich ausschließlich auf die Berichterstattung auf Kampagnenebene konzentrieren, wie z. B. Supermetrics, können Herausforderungen bei der Kanalsichtbarkeit lösen, erfüllen jedoch möglicherweise nicht den umfassenderen abteilungsübergreifenden Integrationsbedarf.

Datenbereitschaftsplattformen zielen darauf ab, diese Lücke zu schließen, indem sie strukturierte Datensätze erstellen, die Informationen über Geschäftssysteme hinweg vereinheitlichen, bevor die KI-Interpretation beginnt.

Für Entscheidungsträger verringert diese Upstream-Konsistenz das Risiko und erhöht gleichzeitig das Vertrauen in automatisierte Ergebnisse.

Der Wandel von Geschwindigkeit zu Stabilität

Bei der ersten Welle der KI-Einführung standen Schnelligkeit und Zugänglichkeit im Vordergrund. Führungskräfte wollten schnellere Dashboards, schnellere Berichtszyklen und eine geringere Abhängigkeit von Analysten.

Die nächste Welle legt Wert auf Stabilität und Wiederholbarkeit.

Da KI-generierte Ergebnisse zunehmend in Entscheidungen auf Führungsebene einfließen, nimmt die Toleranz gegenüber Inkonsistenzen ab. Entscheidungsträger möchten die Gewissheit haben, dass die heute erstellten Prognosen auch morgen konsistent bleiben, wenn sich die zugrunde liegenden Geschäftsbedingungen nicht geändert haben.

Dieses Vertrauen hängt von disziplinierten Datenpipelines ab.

Die Infrastruktur wird zu einem Wettbewerbsvorteil. Unternehmen, die in strukturierte Automatisierung investieren, berichten von weniger Diskrepanzen zwischen Abteilungen, kürzeren manuellen Abstimmungszeiten und einem größeren Vertrauen in KI-gesteuerte Ergebnisse.

Der Schwerpunkt verlagert sich vom Experiment hin zur Betriebssicherheit.

KI ersetzt nicht die Datendisziplin

Die Aufregung um KI kann manchmal eine einfache Realität verschleiern: KI-Systeme machen eine strukturierte Datenverwaltung nicht überflüssig.

Sie erhöhen es.

Da Unternehmen KI in ihren gesamten Betrieben einsetzen, entwickelt sich die Datenbereitschaft von einem IT-Anliegen zu einer strategischen Priorität für die Unternehmensführung. Gremien fragen nach Modellrisiken. CFOs fragen nach einheitlicher Berichterstattung. Umsatzführer fragen sich, warum trotz KI-Investitionen Prognoseabweichungen bestehen bleiben.

Plattformen, die sich mit dieser Grundschicht befassen, gewinnen nicht deshalb an Bedeutung, weil sie intelligentere Algorithmen versprechen, sondern weil sie die Umgebung stabilisieren, in der diese Algorithmen arbeiten.

In der sich weiterentwickelnden Analyselandschaft ist Intelligenz immer noch wichtig. Doch immer wichtiger wird die Struktur, denn letzten Endes ist KI keine Zauberei. Es ist Mathematik. Und Mathematik funktioniert nur, wenn die Eingaben sauber sind.