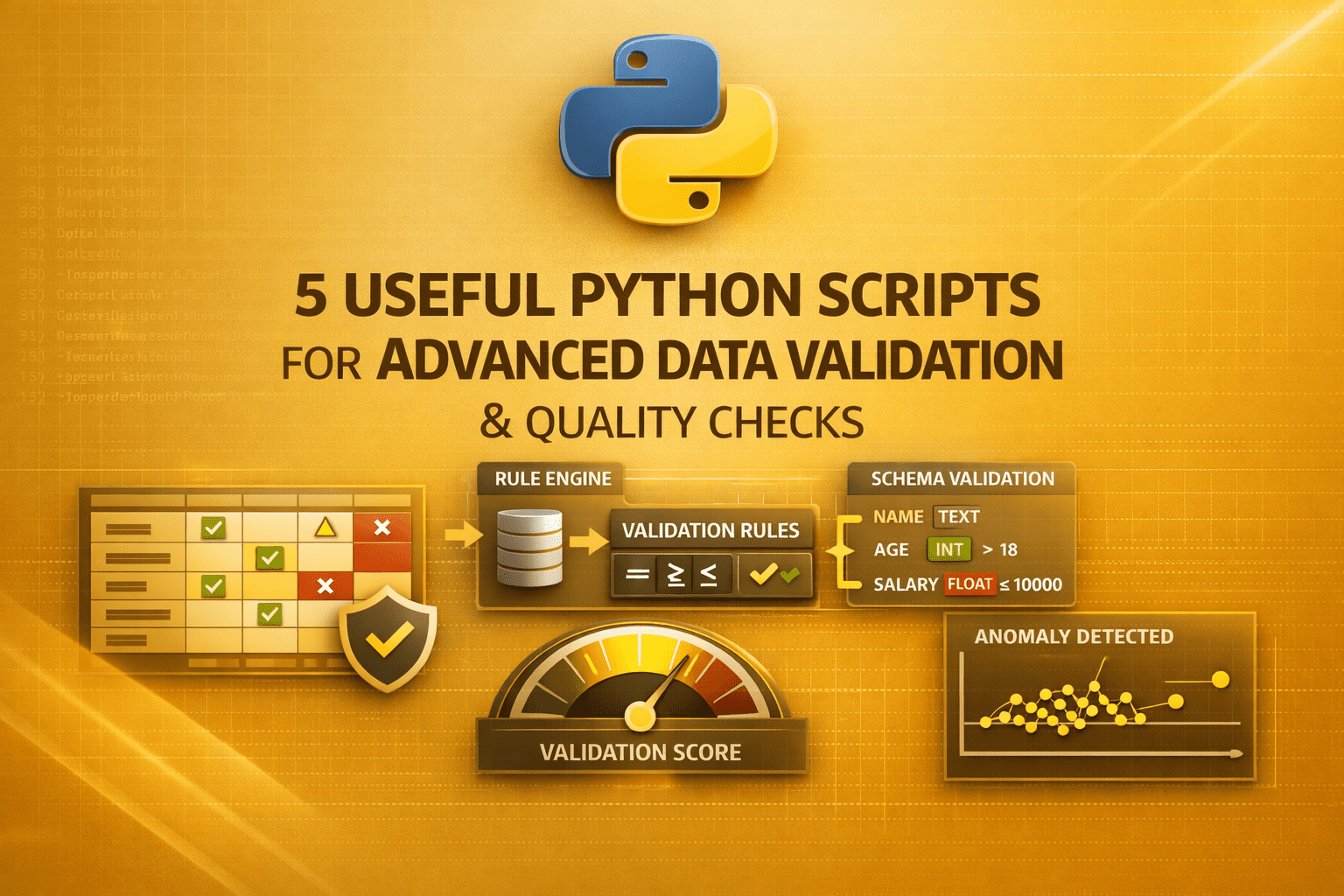

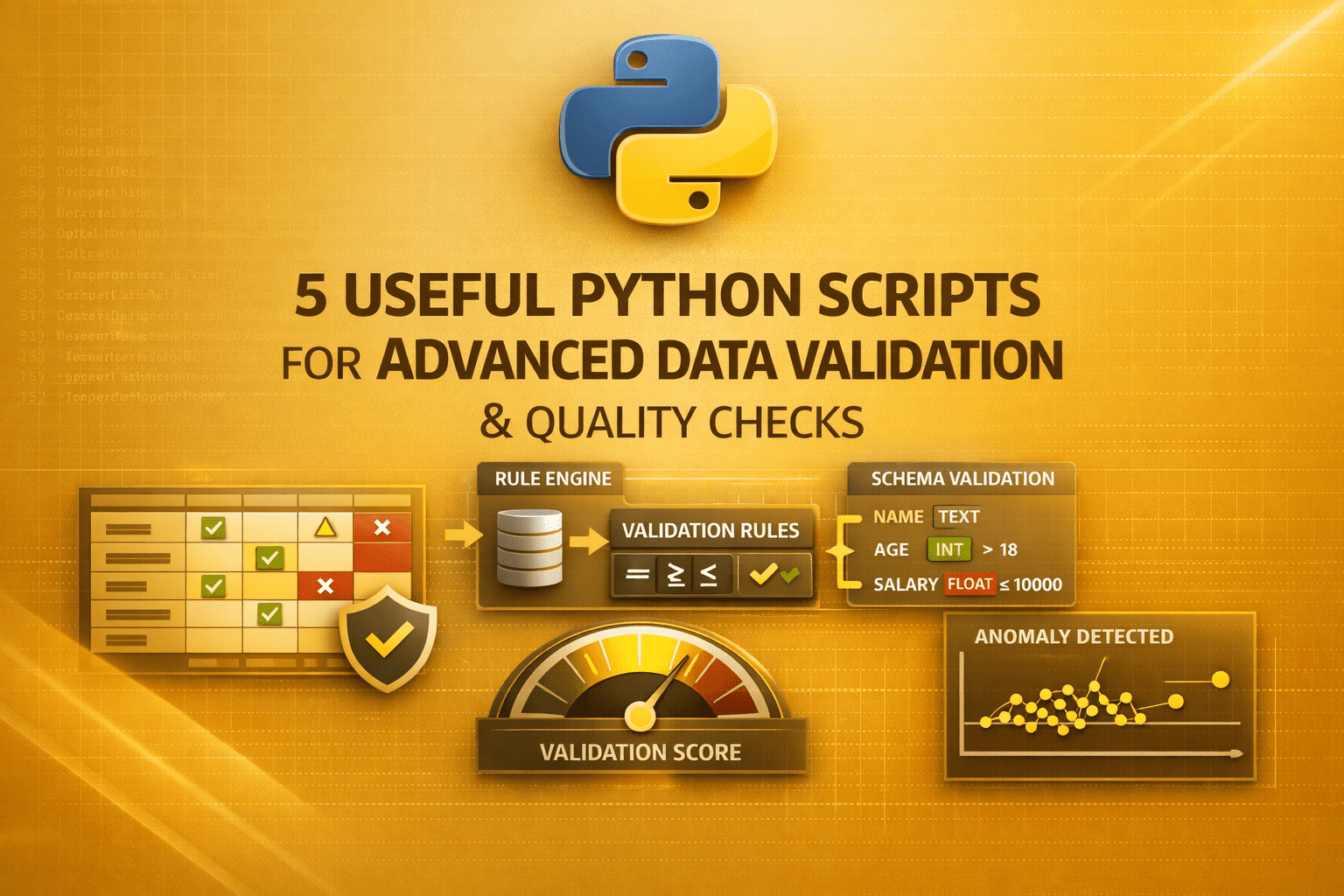

Bild vom Autor

# Einführung

Die Datenvalidierung beschränkt sich nicht nur auf die Suche nach fehlenden Werten oder doppelten Datensätzen. Bei Datensätzen aus der realen Welt gibt es Probleme, die bei grundlegenden Qualitätsprüfungen völlig übersehen werden. Sie werden auf semantische Inkonsistenzen, Zeitreihendaten mit unmöglichen Sequenzen, Formatdrift, bei dem sich Daten im Laufe der Zeit subtil ändern, und vieles mehr stoßen.

Diese fortgeschrittenen Validierungsprobleme sind heimtückisch. Sie bestehen grundlegende Qualitätsprüfungen, da einzelne Werte intestine aussehen, die zugrunde liegende Logik jedoch fehlerhaft ist. Die manuelle Prüfung dieser Probleme ist eine Herausforderung. Sie benötigen automatisierte Skripte, die den Kontext, die Geschäftsregeln und die Beziehungen zwischen Datenpunkten verstehen. In diesem Artikel werden fünf erweiterte Python-Validierungsskripte behandelt, die die subtilen Probleme erkennen, die bei grundlegenden Prüfungen übersehen werden.

Den Code erhalten Sie auf GitHub.

# 1. Validierung der Kontinuität und Muster von Zeitreihen

// Der Schmerzpunkt

Ihre Zeitreihendaten sollten vorhersehbaren Mustern folgen. Aber manchmal entstehen Lücken, wo keine sein sollten. Sie werden auf Zeitstempel stoßen, die unerwartet vorwärts oder rückwärts springen, auf Sensormesswerte mit fehlenden Intervallen, auf Ereignissequenzen, die nicht in der richtigen Reihenfolge auftreten, und auf mehr. Diese zeitlichen Anomalien verfälschen Prognosemodelle und Trendanalysen.

// Was das Skript macht

Validiert die zeitliche Integrität von Zeitreihendatensätzen. Erkennt fehlende Zeitstempel in erwarteten Sequenzen, identifiziert zeitliche Lücken und Überlappungen, markiert Datensätze außerhalb der Reihenfolge und validiert saisonale Muster und erwartete Häufigkeiten. Es prüft auch auf Zeitstempelmanipulation oder Rückdatierung. Das Skript erkennt auch unmögliche Geschwindigkeiten, bei denen sich Werte schneller ändern, als physikalisch oder logisch möglich.

// Wie es funktioniert

Das Skript analysiert Zeitstempelspalten, um auf die erwartete Häufigkeit zu schließen und Lücken in erwarteten kontinuierlichen Sequenzen zu identifizieren. Es überprüft, ob Ereignissequenzen logischen Ordnungsregeln folgen, wendet domänenspezifische Geschwindigkeitsprüfungen an und erkennt Saisonalitätsverstöße. Außerdem werden detaillierte Berichte erstellt, die zeitliche Anomalien mit einer Bewertung der geschäftlichen Auswirkungen aufzeigen.

⏩ Holen Sie sich das Zeitreihen-Kontinuitätsvalidierungsskript

# 2. Überprüfung der semantischen Gültigkeit mit Geschäftsregeln

// Der Schmerzpunkt

Einzelne Felder bestehen die Typvalidierung, aber die Kombination ergibt keinen Sinn. Hier einige Beispiele: eine Bestellung aus der Zukunft mit einem abgeschlossenen Liefertermin in der Vergangenheit. Ein Konto, das als „Neukunde“ gekennzeichnet ist, dessen Transaktionshistorie jedoch fünf Jahre umfasst. Diese semantischen Verstöße brechen die Geschäftslogik.

// Was das Skript macht

Validiert Daten anhand komplexer Geschäftsregeln und Domänenwissen. Überprüft die Mehrfeld-Bedingungslogik, validiert Phasen und zeitliche Abläufe, stellt sicher, dass sich gegenseitig ausschließende Kategorien respektiert werden, und markiert logisch unmögliche Kombinationen. Das Skript verwendet eine Regel-Engine, die erweiterte Geschäftsbeschränkungen ausdrücken kann.

// Wie es funktioniert

Das Skript akzeptiert Geschäftsregeln, die in einem deklarativen Format definiert sind, wertet komplexe bedingte Logik über mehrere Felder hinweg aus und validiert Zustandsübergänge und Workflow-Verläufe. Außerdem prüft es die zeitliche Konsistenz von Geschäftsereignissen, wendet branchenspezifische Domänenregeln an und erstellt Verstoßberichte, die nach Regeltyp und geschäftlichen Auswirkungen kategorisiert sind.

⏩ Holen Sie sich das Skript zur semantischen Gültigkeitsprüfung

# 3. Erkennen von Datendrift und Schemaentwicklung

// Der Schmerzpunkt

Ihre Datenstruktur ändert sich manchmal im Laufe der Zeit ohne Dokumentation. Neue Spalten erscheinen, vorhandene Spalten verschwinden, Datentypen verschieben sich subtil, Wertebereiche erweitern oder verkleinern sich, kategoriale Werte bilden neue Kategorien. Diese Änderungen beschädigen nachgelagerte Systeme, machen Annahmen ungültig und führen zu stillen Fehlern. Bis Sie es bemerken, haben sich monatelange beschädigte Daten angesammelt.

// Was das Skript macht

Überwacht Datensätze auf strukturelle und statistische Abweichungen im Zeitverlauf. Verfolgt Schemaänderungen wie neue und entfernte Spalten, Typänderungen, erkennt Verteilungsverschiebungen in numerischen und kategorialen Daten und identifiziert neue Werte in vermeintlich festen Kategorien. Es markiert Änderungen in Datenbereichen und Einschränkungen und warnt, wenn statistische Eigenschaften von den Grundwerten abweichen.

// Wie es funktioniert

Das Skript erstellt Basisprofile der Datensatzstruktur und -statistiken, vergleicht regelmäßig aktuelle Daten mit Basislinien und berechnet Driftwerte mithilfe statistischer Distanzmetriken wie KL-Divergenz, Wasserstein-Distanzund verfolgt Schemaversionsänderungen. Außerdem verwaltet es den Änderungsverlauf, führt Signifikanztests durch, um echte Abweichungen von Störungen zu unterscheiden, und erstellt Abweichungsberichte mit Schweregraden und empfohlenen Maßnahmen.

⏩ Holen Sie sich das Skript zur Datendrift-Erkennung

# 4. Validierung hierarchischer und grafischer Beziehungen

// Der Schmerzpunkt

Hierarchische Daten müssen azyklisch und logisch geordnet bleiben. Zirkuläre Berichtsketten, selbstreferenzierende Stücklisten, zyklische Taxonomien und Eltern-Form-Inkonsistenzen beeinträchtigen rekursive Abfragen und hierarchische Aggregationen.

// Was das Skript macht

Validiert Diagramm- und Baumstrukturen in relationalen Daten. Erkennt Zirkelverweise in Eltern-Form-Beziehungen, stellt sicher, dass die Tiefengrenzen der Hierarchie eingehalten werden, und überprüft, ob gerichtete azyklische Graphen (DAGs) azyklisch bleiben. Das Skript prüft außerdem auf verwaiste Knoten und nicht verbundene Untergraphen und stellt sicher, dass Wurzelknoten und Blattknoten den Geschäftsregeln entsprechen. Es validiert auch Viele-zu-Viele-Beziehungsbeschränkungen.

// Wie es funktioniert

Das Skript erstellt Diagrammdarstellungen hierarchischer Beziehungen, verwendet Zykluserkennungsalgorithmen, um Zirkelverweise zu finden, und führt Tiefen- und Breitendurchläufe durch, um die Struktur zu validieren. Anschließend identifiziert es stark verbundene Komponenten in vermeintlich azyklischen Graphen, validiert Knoteneigenschaften auf jeder Hierarchieebene und generiert visuelle Darstellungen problematischer Untergraphen mit spezifischen Verletzungsdetails.

⏩ Holen Sie sich das Validierungsskript für hierarchische Beziehungen

# 5. Validierung der referenziellen Integrität über Tabellen hinweg

// Der Schmerzpunkt

Relationale Daten müssen die referenzielle Integrität über alle Fremdschlüsselbeziehungen hinweg wahren. Verwaiste untergeordnete Datensätze, Verweise auf gelöschte oder nicht vorhandene übergeordnete Datensätze, ungültige Codes und unkontrollierte Kaskadenlöschungen führen zu versteckten Abhängigkeiten und Inkonsistenzen. Diese Verstöße beschädigen Verknüpfungen, verzerren Berichte, unterbrechen Abfragen und machen die Daten letztendlich unzuverlässig und schwer vertrauenswürdig.

// Was das Skript macht

Validiert Fremdschlüsselbeziehungen und tabellenübergreifende Konsistenz. Erkennt verwaiste Datensätze, denen übergeordnete oder untergeordnete Referenzen fehlen, validiert Kardinalitätseinschränkungen und prüft die Eindeutigkeit zusammengesetzter Schlüssel über Tabellen hinweg. Es analysiert auch die Auswirkungen kaskadierter Löschvorgänge, bevor sie auftreten, und identifiziert Zirkelverweise über mehrere Tabellen hinweg. Das Skript arbeitet mit mehreren Datendateien gleichzeitig, um Beziehungen zu validieren.

// Wie es funktioniert

Das Skript lädt einen primären Datensatz und alle zugehörigen Referenztabellen, überprüft das Vorhandensein von Fremdschlüsselwerten in übergeordneten Tabellen und erkennt verwaiste übergeordnete Datensätze und verwaiste untergeordnete Datensätze. Es überprüft Kardinalitätsregeln, um Eins-zu-eins- oder Eins-zu-viele-Einschränkungen sicherzustellen, und validiert, dass zusammengesetzte Schlüssel korrekt mehrere Spalten umfassen. Das Skript generiert außerdem umfassende Berichte, die alle Verletzungen der referenziellen Integrität mit der Anzahl der betroffenen Zeilen und spezifischen Fremdschlüsselwerten anzeigen, die die Validierung nicht bestehen.

⏩ Holen Sie sich das Skript zur Überprüfung der referenziellen Integrität

# Zusammenfassung

Die erweiterte Datenvalidierung geht über die Prüfung auf Nullen und Duplikate hinaus. Diese fünf Skripte helfen Ihnen, semantische Verstöße, zeitliche Anomalien, strukturelle Abweichungen und Brüche der referenziellen Integrität zu erkennen, die bei grundlegenden Qualitätsprüfungen völlig übersehen werden.

Beginnen Sie mit dem Skript, das Ihren wichtigsten Problempunkt anspricht. Richten Sie Basisprofile und Validierungsregeln für Ihre spezifische Domäne ein. Führen Sie die Validierung als Teil Ihrer Datenpipeline aus, um Probleme bei der Aufnahme und nicht bei der Analyse zu erkennen. Konfigurieren Sie Alarmschwellenwerte entsprechend Ihrem Anwendungsfall.

Viel Spaß beim Validieren!

Bala Priya C ist ein Entwickler und technischer Redakteur aus Indien. Sie arbeitet gerne an der Schnittstelle von Mathematik, Programmierung, Datenwissenschaft und Inhaltserstellung. Zu ihren Interessen- und Fachgebieten gehören DevOps, Datenwissenschaft und Verarbeitung natürlicher Sprache. Sie liebt es zu lesen, zu schreiben, zu programmieren und Kaffee zu trinken! Derzeit arbeitet sie daran, zu lernen und ihr Wissen mit der Entwickler-Neighborhood zu teilen, indem sie Tutorials, Anleitungen, Meinungsbeiträge und mehr verfasst. Bala erstellt außerdem ansprechende Ressourcenübersichten und Programmier-Tutorials.