Der Omniparser V2 von Microsoft ist ein hochmoderner AI-Display screen-Parser, der strukturierte Daten aus GUIs durch Analyse von Screenshots extrahiert und AI-Agenten ermöglicht, nahtlos mit Elementen auf dem Bildschirm zu interagieren. Dieses Instrument ist perfekt zum Aufbau autonomer GUI-Agenten und ist ein Spielveränderer für die Automatisierung und die Workflow-Optimierung. In diesem Leitfaden behandeln wir die Set up von Omniparser V2 lokal, seine Betriebsmechanik und ihre Integration in Omnitool sowie die realen Anwendungen. Seien Sie gespannt auf unseren nächsten Artikel Qwen 2.5– GUI -Automatisierung auf die nächste Ebene.

Wie funktioniert Omniparser V2?

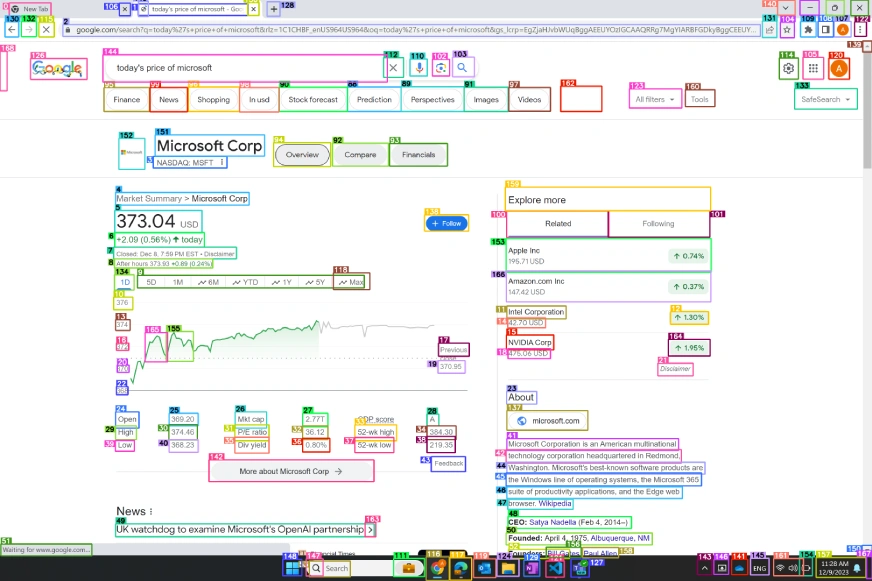

Omniparser V2 verwendet einen zweistufigen Prozess: Erkennung und Bildunterschrift. Erstens hängt sein Erkennungsmodul auf eine Feinabstimmung ab Yolov8 Modell zum Erkennen interaktiver Elemente wie Schaltflächen, Symbolen und Menüs in Screenshots. Als nächstes verwendet das Bildunterschriftenmodul das Florence-2-Stiftungsmodell, um beschreibende Beschriftungen für diese Elemente zu erstellen und ihre Rollen innerhalb der Schnittstelle zu erklären. Zusammen helfen diese Module großen Sprachmodellen (LLMs), GUIS vollständig zu verstehen und präzise Interaktionen und Aufgabenausführung zu ermöglichen.

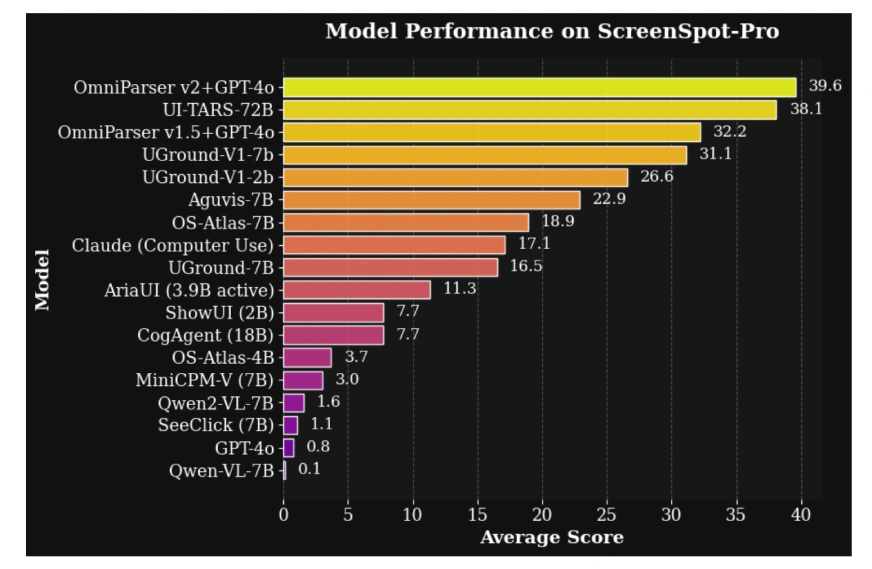

Im Vergleich zu seinem Vorgänger liefert Omniparser V2 wichtige Upgrades. Es senkt die Latenz um 60% und verbessert die Genauigkeit, insbesondere zum Erkennen kleinerer Elemente. In Checks wie Screenspot Professional erreichte Omniparser V2, gepaart mit GPT-4O, eine durchschnittliche Genauigkeit von 39,6%, was einem großen Sprung gegenüber dem Grundwert von 0,8percententspricht. Diese Gewinne stammen aus dem Coaching auf einem größeren, detaillierteren Datensatz, der umfangreiche Informationen über Symbole und ihre Funktionen enthält.

Voraussetzungen für die Set up von Omniparser V2

Stellen Sie vor Beginn des Installationsprozesses sicher, dass Ihr System die folgenden Anforderungen erfüllt:

- Git: Installieren Sie Git, um das Omniparser -Repository zu klonen:

sudo apt set up git-all- Miniconda: Installieren Sie Miniconda für die Verwaltung von Python -Umgebungen. Anweisungen finden Sie in: Miniconda Set up Information.

- Nvidia Cuda Toolkit und CUDA -Compiler: Für die GPU -Beschleunigung erforderlich. Laden Sie die entsprechende Datei für Ihr Betriebssystem herunter: CUDA -Downloads. Alternativ können Sie alles installieren, indem Sie WSL in Home windows installieren, indem Sie:

wsl --installInstallationsschritte

Nachdem Sie alle Dinge fertig haben, schauen wir uns die Set up von Omniparser V2 an:

Schritt 1: Klonen Sie das Omniparser -Repository

Öffnen Sie Ihr Terminal und klonen Sie das Omniparser -Repository von GitHub:

git clone https://github.com/microsoft/OmniParser

cd OmniParserSchritt 2: Richten Sie die Conda -Umgebung ein

Erstellen Sie eine Conda -Umgebung mit dem Namen „Omni“ mit Python 3.12:

conda create -n "omni" python==3.12Schritt 3: Aktivieren Sie die Umgebung

conda activate omniSchritt 4: Installieren Sie die erforderlichen Abhängigkeiten mit PIP

pip set up -r necessities.txtSchritt 5: Modellgewichte herunterladen

Laden Sie die V2 -Gewichte herunter und legen Sie sie in den Gewichtsordner. Stellen Sie sicher, dass der Ordner zum Bildunterschrift Gewicht genannt wird icon_caption_florence. Wenn nicht heruntergeladen, verwenden Sie:

rm -rf weights/icon_detect weights/icon_caption weights/icon_caption_florence

huggingface-cli obtain microsoft/OmniParser-v2.0 --local-dir weights

mv weights/icon_caption weights/icon_caption_florenceSchritt 6: Demos laufen

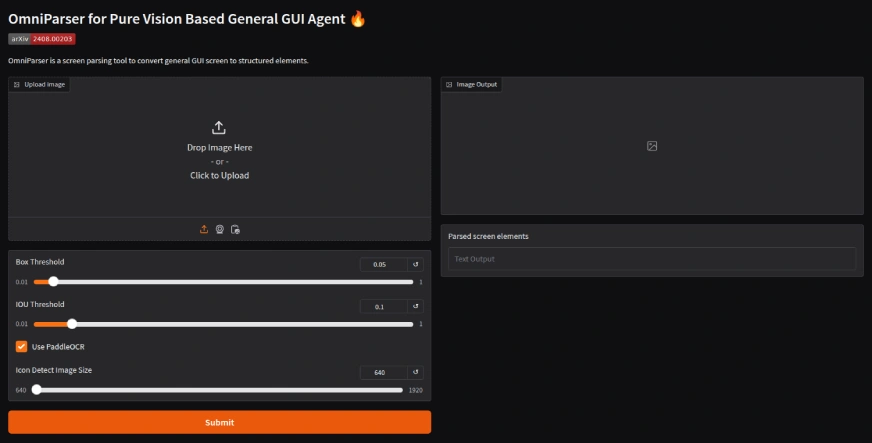

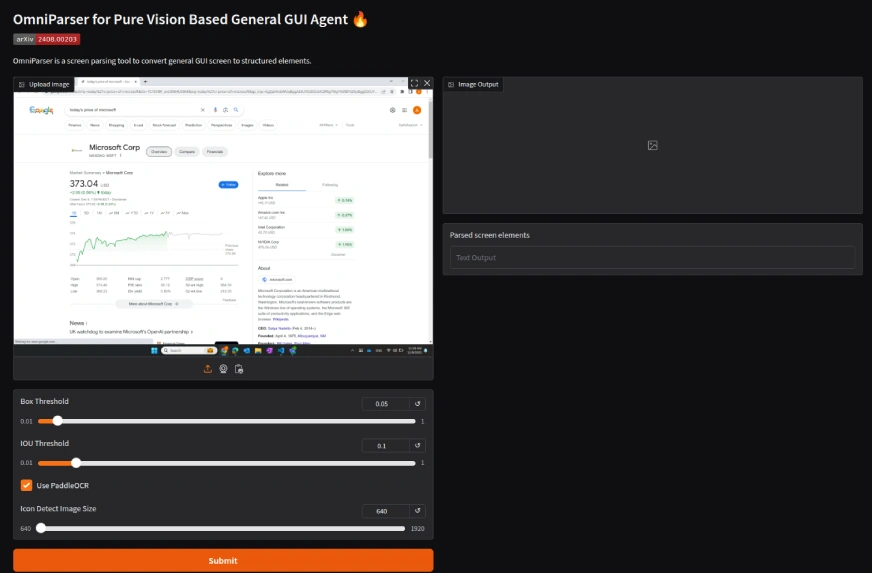

Um die Demo von Gradio auszuführen, führen Sie aus:

python gradio_demo.py

Ausgabe

Omnitool ist eine virtuelle Home windows -Maschine, die Omniparser mit einem integriert Llm (wie zum Beispiel Gpt-4o), um vollständig autonome agentenaktionen zu ermöglichen.

Vorteile der Verwendung von Omnitool:

- Autonome agentenaktionen: Ermöglicht AI -Agenten, Aufgaben ohne menschliche Eingriffe auszuführen.

- Reale Automatisierung: Erleichtert die Automatisierung von sich wiederholenden Aufgaben durch GUI -Interaktion.

- Barrierefreiheitslösungen: Bietet strukturierte Daten für assistive Technologien.

- Benutzeroberflächenanalyse: Analysiert und verbessert die Benutzeroberflächen basierend auf extrahierten strukturierten Daten.

Anwendungen von Omniparser V2

Die Fähigkeiten von Omniparser V2 eröffnen zahlreiche Anwendungen:

- UI -Automatisierung: Automatisierung von Interaktionen mit grafischen Benutzeroberflächen.

- Barrierefreiheitslösungen: Bereitstellung von Lösungen für Benutzer mit Behinderungen.

- Benutzeroberflächenanalyse: Analyse und Verbesserung des Designs der Benutzeroberfläche basierend auf extrahierten strukturierten Daten.

Abschluss

Omniparser V2 ist ein großer Sprung nach vorne in der visuellen Analyse von KI, wobei der Textual content und die Verarbeitung visueller Daten nahtlos verbindet. Mit seiner Geschwindigkeit, Präzision und nahtlosen Integration ist es ein Muss für Entwickler und Unternehmen, die mit KI-betriebenen Lösungen aufbauen möchten. In unserem nächsten Artikel werden wir mit QWEN 2.5 in den Ausführen von Omniparser V2 eingehen, um noch mehr Potenzial für reale Anwendungen auszuschöpfen. Bleiben Sie dran!