Der Aufbau eines Sprach-KI-Agenten in Produktionsqualität ist heute eine der größten technischen Herausforderungen beim angewandten maschinellen Lernen. Es geht nicht nur um die Genauigkeit der Transkription. Sie benötigen ein System, das den Kontext während eines fünfminütigen Gesprächs beibehalten, externe APIs während des Anrufs ohne unangenehme Pause aufrufen kann, sich reibungslos erholt, wenn ein Anrufer sich selbst korrigiert, und das alles zuverlässig erledigt, wenn die Audioqualität durch Hintergrundgeräusche, einen starken Akzent oder ein ausgelassenes Wort beeinträchtigt wird. Die meisten aktuellen Systeme erfüllen eine oder zwei dieser Anforderungen. xAI ist neu erschienen grok-voice-think-fast-1.0 erhebt ernsthaft den Anspruch, alle Probleme zu bewältigen – und die Benchmark-Zahlen untermauern dies.

Verfügbar über die xAI-API, grok-voice-think-fast-1.0 ist das neue Flaggschiff-Sprachmodell des xAI. Es wurde speziell für komplexe, mehrdeutige, mehrstufige Arbeitsabläufe in den Bereichen Kundensupport, Vertrieb und Unternehmensanwendungen entwickelt und wird bereits in großem Umfang eingesetzt, um den Reside-Telefonbetrieb von Starlink zu unterstützen.

Was macht einen Sprachagenten zum Vollduplexbetrieb aus?

Bevor Sie die Benchmark-Ergebnisse auspacken, sollten Sie verstehen, um welche Artwork von Modell es sich handelt grok-voice-think-fast-1.0 Ist. Es wird auf der (Tau) τ-Voice-Financial institution als bewertet Vollduplex-Sprachagent. Das System verarbeitet eingehende Sprache und generiert gleichzeitig Antworten, anstatt darauf zu warten, dass der Sprecher aufhört, bevor er mit dem Nachdenken beginnt. So kommunizieren Menschen in echten Gesprächen. Aus diesem Grund ist der Umgang mit Unterbrechungen auch ein wirklich schwieriges technisches Downside: Das Modell muss in Echtzeit entscheiden, ob eine Äußerung mitten im Satz eine Korrektur, eine Klarstellung oder nur ein Füllwort ist, und sein Verhalten entsprechend anpassen.

Der τ-voice Bench bewertet Agenten speziell unter diesen realistischen Bedingungen: Lärm, Akzente, Unterbrechungen und natürliches Abwechseln, was ihn zu einem relevanteren Maß für Produktionseinsätze macht als herkömmliche ASR-Benchmarks mit sauberem Audio.

Die Zahlen: Ein bedeutender Hinweis

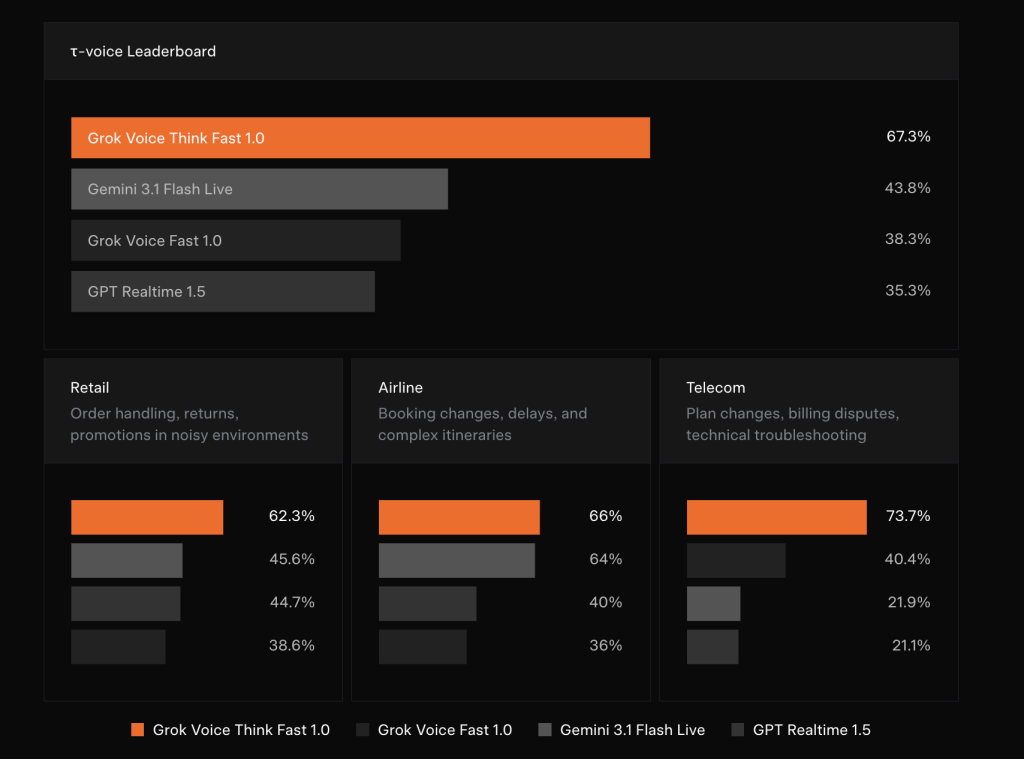

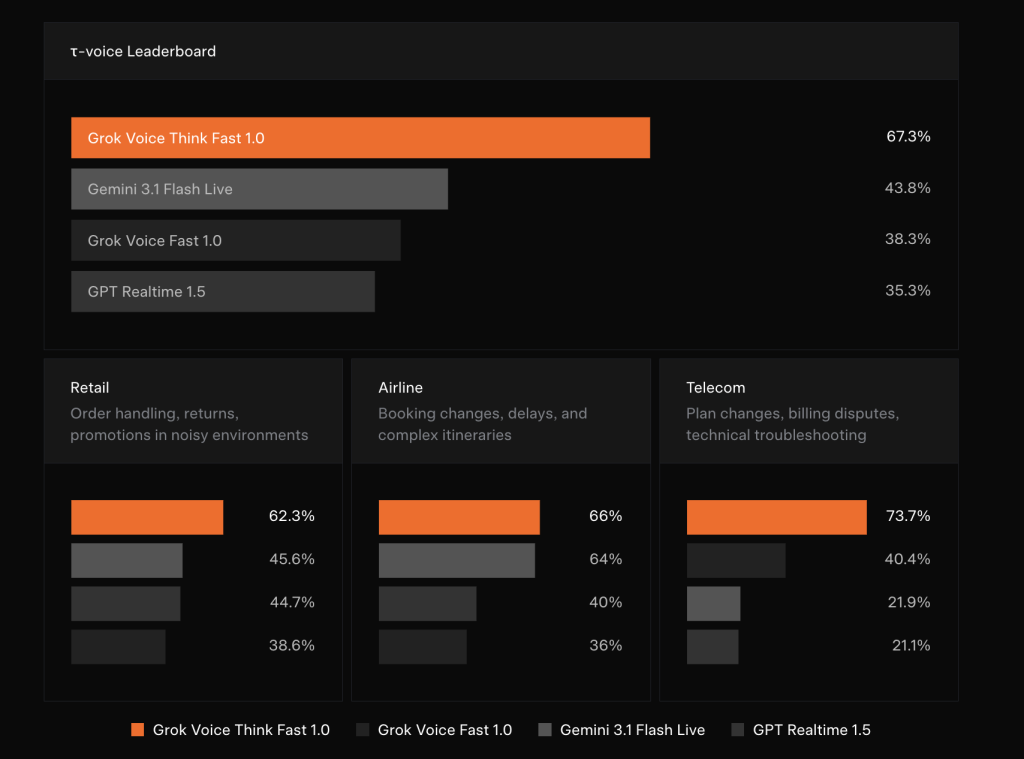

Die von xAI veröffentlichten Benchmark-Ergebnisse machen deutlich, wie groß die Lücken sind. Auf der Gesamtbestenliste der τ-Voice Bench grok-voice-think-fast-1.0 Partituren 67,3 %im Vergleich zu 43,8 % für Gemini 3.1 Flash Reside, 38,3 % für Grok Voice Quick 1.0 (xAIs eigenes Vorgängermodell) und 35,3 % für GPT Realtime 1.5.

Wenn man das nach Branchen aufschlüsselt, ergibt sich eine noch klarere Aussage:

In Einzelhandel – umfasst Auftragsabwicklung, Retouren und Werbeaktionen in lauten Umgebungen – grok-voice-think-fast-1.0 Partituren 62,3 %gefolgt von Grok Voice Quick 1.0 bei 45,6 %Gemini 3.1 Flash Reside unter 44,7 %und GPT Realtime 1.5 bei 38,6 %.

In Fluggesellschaft – Buchungsänderungen, Verspätungen und komplexe Reisepläne – die Ergebnisse sind 66 % für Grok Voice Suppose Quick 1.0, 64 % für Grok Voice Quick 1.0, 40 % für Gemini 3.1 Flash Reside und 36 % für GPT Realtime 1.5.

Die dramatischste Lücke zeigt sich in Telekommunikation: Planänderungen, Abrechnungsstreitigkeiten und technische Fehlerbehebung – wo grok-voice-think-fast-1.0 erreicht 73,7 %während Grok Voice Quick 1.0 punktet 40,4 %Gemini 3.1 Flash Reside 21,9 %und GPT Realtime 1.5 21,1 %. Ein Vorsprung von 33 Prozentpunkten vor dem nächsten Konkurrenten in einer einzelnen Vertikale ist keine geringfügige Verbesserung. Das ist ein architektonischer Vorteil.

Argumentation in Echtzeit ohne zusätzliche Latenz

Eine der technisch bedeutsamsten Entwurfsentscheidungen in diesem Modell ist die Artwork und Weise, wie Argumentation gehandhabt wird. grok-voice-think-fast-1.0 führt Überlegungen im Hintergrund durch und durchdenkt anspruchsvolle Abfragen und Arbeitsabläufe in Echtzeit, ohne Auswirkungen auf die Antwortlatenz. Für KI-Groups ist dies der schwierige Teil beim Aufbau: Argumentationsmodelle verlängern traditionell die Reaktionszeit, weil sie vor der Erstellung einer Antwort Zwischen-„Denk“-Token generieren. Um diese Berechnung aus dem Konversationslatenzbudget auszublenden und dennoch davon zu profitieren, ist sorgfältige Architekturarbeit erforderlich.

Der praktische Vorteil ist Genauigkeit ohne Trägheit. Das xAI-Staff demonstriert dies anhand eines repräsentativen Randfalls: Auf die Frage „Welche Monate des Jahres werden mit dem Buchstaben X geschrieben?“ grok-voice-think-fast-1.0 antwortet richtig, dass kein Monat den Buchstaben Diese Fehlerklasse, bei der ein Modell mit hoher Sicherheit eine plausibel klingende, aber falsche Antwort liefert, ist bei Sprachschnittstellen besonders schädlich, da den Benutzern keine Textausgabe zur Gegenprüfung zur Verfügung steht.

Präzise Dateneingabe und Rücklesung

Eine zentrale Workflow-Funktion von grok-voice-think-fast-1.0 ist die strukturierte Datenerfassung und das Rücklesen. Das Modell kann nahtlos E-Mail-Adressen, physische Straßenadressen, Telefonnummern, vollständige Namen, Kontonummern und andere strukturierte Daten erfassen, selbst wenn Informationen schnell oder mit starkem Akzent gesprochen werden. Es geht elegant mit Sprachstörungen um, akzeptiert natürliche Korrekturen wie ein Mensch und liest dem Benutzer dann die bestätigten Daten vor.

xAI veranschaulicht dies anhand eines konkreten Beispiels. Ein Anrufer sagt: „Ja, es ist 1410, äh, Second, 1450 Web page Mill Avenue. Eigentlich tut es mir leid, das ist Web page Mill Highway.“ Das Modell verarbeitet die gesprochenen Korrekturen in Echtzeit und ruft a auf search_address Werkzeug mit dem korrigierten Parameter "1450 Web page Mill Rd"und liest die normalisierte Adresse zur Benutzerbestätigung zurück. Datenteams, die viel Zeit in den Aufbau von Publish-Name-Cleanup-Pipelines investiert haben, um strukturierte Felder aus chaotischen Transkripten zu extrahieren, stellt diese native Erfassungs- und Rücklesefunktion eine deutliche Reduzierung der Komplexität der nachgelagerten Verarbeitung dar.

Das Modell wurde unter härtesten realen Bedingungen getestet: Telefonton, Hintergrundgeräusche, starke Akzente und häufige Unterbrechungen. Es unterstützt nativ mehr als 25 Sprachen und eignet sich daher supreme für den globalen Einsatz in verschiedenen Anwendungsfällen, einschließlich Kundensupport, Telefonverkauf, Terminbuchung und Restaurantreservierungen.

Die Starlink-Bereitstellung: Produktion im Maßstab

Die überzeugendste Bestätigung von grok-voice-think-fast-1.0 ist nicht nur der Benchmark, sondern die Reside-Bereitstellung. Grok Voice betreibt den gesamten Telefonverkauf und Kundensupport für Starlink unter +1 (888) GO STARLINK. Die Zahlen, die xAI aus diesem Einsatz bekannt gibt, sind operativ bedeutsam: a 20 % Umsatz-Conversion-Charge (Das bedeutet, dass jeder fünfte Anrufer, der eine Verkaufsanfrage stellt, den Starlink-Dienst kauft, während er mit Grok telefoniert), a 70 % autonome Auflösungsrate für Kundensupportanfragen, ohne dass ein Mensch auf dem Laufenden ist und ein einziger Agent für die gesamte Abwicklung zuständig ist 28 verschiedene Werkzeuge Es umfasst Hunderte von Assist- und Vertriebsabläufen.

Wichtige Erkenntnisse

- grok-voice-think-fast-1.0 führt die τ-voice Bench mit einer Punktzahl von 67,3 % anund übertraf damit Gemini 3.1 Flash Reside (43,8 %), Grok Voice Quick 1.0 (38,3 %) und GPT Realtime 1.5 (35,3 %).

- Das Modell führt Hintergrundschlussfolgerungen ohne zusätzliche Latenz durchDies ermöglicht es, komplexe, mehrstufige Arbeitsabläufe in Echtzeit zu durchdenken, ohne die Konversationsantworten zu verlangsamen.

- Die präzise Dateneingabe und das Zurücklesen ist eine native FunktionDadurch kann das Modell strukturierte Daten wie Namen, Adressen, Telefonnummern und Kontonummern erfassen und bestätigen, selbst wenn es schnell gesprochen wird, mit Akzent oder mit Korrekturen mitten im Satz.

- Das Modell unterstützt mehr als 25 Sprachen und Instrument-Aufrufe mit hohem VolumenDadurch ist es in globalen Unternehmensanwendungsfällen einsetzbar, einschließlich Kundensupport, Telefonverkauf, Terminbuchung und Restaurantreservierungen.

- Der Reside-Einsatz von Starlink beweist die Produktionsbereitschaft im großen Maßstab: Ein einzelner Grok Voice-Agent arbeitet mit 28 Instruments und Hunderten von Arbeitsabläufen, erreicht eine Verkaufskonversionsrate von 20 % und löst 70 % der Kundensupportanfragen autonom, ohne dass ein Mensch auf dem Laufenden ist.

Schauen Sie sich das an Dokumentation Und Offizielle Veröffentlichung. Sie können uns auch gerne weiter folgen Twitter und vergessen Sie nicht, bei uns mitzumachen 130.000+ ML SubReddit und Abonnieren Unser Publication. Warten! Bist du im Telegram? Jetzt können Sie uns auch per Telegram kontaktieren.

Möchten Sie mit uns zusammenarbeiten, um Ihr GitHub-Repo ODER Ihre Hugging Face Web page ODER Produktveröffentlichung ODER Ihr Webinar usw. zu bewerben?Vernetzen Sie sich mit uns

Der Beitrag xAI führt grok-voice-think-fast-1.0 ein: Spitzenwert bei τ-voice Bench mit 67,3 %, übertrifft Gemini, GPT Realtime und mehr erschien zuerst auf MarkTechPost.