Generative KI -Modelle verändern die Artwork und Weise, wie wir Inhalte erstellen, egal ob Textual content, Bilder, Video oder Code. Mit Googles Gen AI Python SDK können Sie nun die generativen KI -Modelle von Google in Ihren Python -Anwendungen leichter zugreifen und mit der Gemini Developer API und der Verwendung der Gemini Developer API und einfacher zu interagieren. Scheitelpunkt ai apis. Das bedeutet, dass Entwickler leichter Anwendungen erstellen können, einschließlich Chatbots, Inhaltsgeneratoren oder kreativen Instruments. In diesem Artikel werden wir alles abdecken, was Sie wissen müssen, um mit dem Google Gen AI Python SDK zu beginnen.

Lesen Sie auch: Erstellen Sie ein LLM -Modell mit Google Gemini API

Was ist der Google Gen Ai Python SDK?

Das Google Gen AI Python SDK ist eine Consumer -Bibliothek, in der Entwickler die generativen KI -Fähigkeiten von Google problemlos mit Python verwenden können. Es bietet:

- Unterstützung für die Gemini -Entwickler -API (Google Superior Textual content und Multimodal Generative Fashions)

- Integration mit Vertex-AI-APIs für KI-Workloads im Unternehmensmaßstab

- Unterstützung für das Generieren von Textual content, Bildern, Movies, Einbettungen, Chat -Gesprächen und mehr

- Instruments für Dateimanagement, Caching und Async -Unterstützung

- Fortgeschrittene Funktionsanrufe und Schema -Durchsetzungsfunktionen

Dieser SDK wird auch einen Großteil der Komplexität der API-Anrufe abstrahiert und ermöglicht es Ihnen, sich auf den Aufbau von AI-betriebenen Anwendungen zu konzentrieren.

Set up

Die Set up des SDK ist einfach. Laufen:

pip set up google-genaiDer obige Befehl installiert das Google Gen AI Python SDK -Paket mit PIP. Dieser Befehl lädt alles herunter, was Sie für die Python -Umgebung benötigen, um die Google Generative AI -Dienste zu starten, einschließlich der Ressourcen und aller Abhängigkeiten.

Importe und Consumer -Setup

Sobald Sie das SDK installiert haben, erstellen Sie eine Python -Datei und importieren Sie die SDK:

from google import genai

from google.genai import varietiesDer SDK hat zwei Module – Genai und Typen. Das Genai -Modul erstellt einen Consumer, der für die API -Interaktion verwendet wird, während das Typenmodul Datenstrukturen und Klassen enthält, die als Helfer dienen, die zum Erstellen von Anforderungen und Konfigurieren von Anforderungsparametern dienen.

Sie erstellen eine Instanz des Shoppers für jede Interaktion mit den Google Generative AI -Modellen. Sie werden den Consumer je nach der von Ihnen verwendeten API mit unterschiedlichen Methoden instanziieren.

Für die Gemini -Entwickler -API können Sie den Kunden instanziieren, indem Sie Ihren API -Schlüssel weitergeben:

consumer = genai.Consumer(api_key='YOUR_GEMINI_API_KEY')Sie instanziieren den Consumer, den Sie mit der Gemini -Entwickler -API interagieren können, indem Sie Ihren API -Schlüssel übergeben. Dieser Kunde kümmert sich um das Zugangs -Token und das Anfragemanagement.

Non-compulsory: Verwenden von Google Cloud Vertex AI

consumer = genai.Consumer(

vertexai=True,

challenge="your-project-id",

location='us-central1'

)Wenn Sie Google Cloud Vertex AI verwenden möchten, werden Sie den Consumer unterschiedlich initialisieren, indem Sie die Projekt -ID und den Standort angeben.

Hinweis: Die Verwendung von Vertex AI ist non-obligatory. Du kannst Erstellen Sie hier Ihre Projekt -ID.

Wenn Sie keine Vertex -AI verwenden, können Sie einfach die oben genannte API -Schlüsselmethode verwenden.

API -Model und Konfiguration

Standardmäßig verwendet der SDK Beta -Endpunkte, um auf Beta -Funktionen zuzugreifen. Wenn Sie jedoch stabile APIs verwenden möchten, können Sie die API -Model mit dem Argument http_options angeben:

from google.genai import varieties

consumer = genai.Consumer(

vertexai=True,

challenge="your-project-id",

location='us-central1',

http_options=varieties.HttpOptions(api_version='v1')

)Es liegt an Ihnen, wie Sie fortfahren möchten, um die Stabilität mit modernsten Funktionen auszugleichen.

Verwenden von Umgebungsvariablen (non-obligatory)

Anstatt direkt Tasten zu übergeben, sollten wir zunächst Umgebungsvariablen festlegen:

Gemini Developer API:

export GEMINI_API_KEY='your-api-key'Scheitelpunkt AI:

export GOOGLE_GENAI_USE_VERTEXAI=true

export GOOGLE_CLOUD_PROJECT='your-project-id'

export GOOGLE_CLOUD_LOCATION='us-central1'Initialisieren Sie dann den Kunden einfach mit:

consumer = genai.Consumer()Google Gen AI Python SDK -Anwendungsfälle

Hier sind die verschiedenen Möglichkeiten, wie Sie die Funktionen von Google Gen AI Python SDK nach der Einrichtung verwenden können.

Inhaltsgenerierung

Die Hauptfunktion des SDK besteht darin, KI -Inhalte zu generieren. Sie stellen Eingabeaufforderungen in verschiedenen Formen bereit, z. B. einfache Zeichenfolgen, strukturierte Inhalte oder komplexe multimodale Eingänge.

Grundlegende Textgenerierung

response = consumer.fashions.generate_content(

mannequin="gemini-2.0-flash-001",

contents="Why Does the solar rises from east"

)

print(response.textual content)Ausgabe

Dies sendet eine Eingabeaufforderung an das Modell und gibt die generierte Antwort zurück.

Strukturierte Inhalteeingänge

Sie können strukturierte Inhalte über verschiedene Rollen hinweg wie Benutzer oder Modell für Chatbot-, Konversations- oder Multiturn-Kontexte einfügen.

from google.genai import varieties

content material = varieties.Content material(

position="consumer",

elements=(varieties.Half.from_text(textual content="Inform me a enjoyable truth about work."))

)

response = consumer.fashions.generate_content(mannequin="gemini-2.0-flash-001", contents=content material)

print(response.textual content)Ausgabe

Das SDK übersetzt intern viele verschiedene Eingabetypen in ein strukturiertes Datenformat für das Modell.

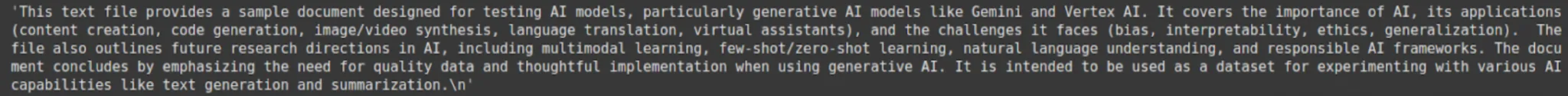

Datei -Add und Verwendung

Mit der API von Gemini Builders können Sie Dateien hochladen, damit das Modell verarbeitet werden kann. Dies ist ideally suited für die Zusammenfassung oder die Extraktion von Inhalten:

file = consumer.recordsdata.add(file="/content material/sample_file.txt")

response = consumer.fashions.generate_content(

mannequin="gemini-2.0-flash-001",

contents=(file, 'Please summarize this file.')

)

print(response.textual content)Ausgabe

Dies ist ein idealer Ansatz, um die KI-Funktionalität zu dokumentbasierten Aufgaben hinzuzufügen.

Funktionsaufruf

Eine einzigartige Fähigkeit ist die Möglichkeit, Python -Funktionen als „Instruments“ zu übergeben, damit das Modell beim Erstellen der Fertigstellung automatisch aufgerufen werden kann.

def get_current_weather(location: str) -> str:

return 'sunny'

response = consumer.fashions.generate_content(

mannequin="gemini-2.0-flash-001",

contents="What's the climate like in Ranchi?",

config=varieties.GenerateContentConfig(instruments=(get_current_weather))

)

print(response.textual content)Ausgabe

Dies ermöglicht eine dynamische Echtzeitdatenintegration in KI-Antworten.

Erweiterte Konfiguration

Sie können die Erzeugung mit Parametern wie Temperatur, max_output_tokens und Sicherheitseinstellungen anpassen, um die Zufälligkeit, Länge und Filterinhalte zu verwalten.

config = varieties.GenerateContentConfig(

temperature=0.3,

max_output_tokens=100,

safety_settings=(varieties.SafetySetting(class='HARM_CATEGORY_HATE_SPEECH', threshold='BLOCK_ONLY_HIGH'))

)

response = consumer.fashions.generate_content(

mannequin="gemini-2.0-flash-001",

contents=""'Supply some encouraging phrases for somebody beginning a brand new journey.''',

config=config

)

print(response.textual content)Ausgabe

Dies kann eine Granularität gegenüber der Qualität und Sicherheit inhaltlich sein.

Multimedia -Unterstützung: Bilder und Movies

Mit dem SDK können Sie Bilder generieren und bearbeiten und Movies generieren (in der Vorschau).

- Generieren Sie Bilder mithilfe von Texteingabeaufforderungen.

- Hochskalte oder passen erzeugte Bilder.

- Generieren Sie Movies aus Textual content oder Bildern.

Beispiel der Bildgenerierung:

response = consumer.fashions.generate_images(

mannequin="imagen-3.0-generate-002",

immediate="A tranquil seashore with crystal-clear water and colourful seashells on the shore.",

config=varieties.GenerateImagesConfig(number_of_images=1)

)

response.generated_images(0).picture.present()Ausgabe

Beispiel der Videogenerierung:

import time

operation = consumer.fashions.generate_videos(

mannequin="veo-2.0-generate-001",

immediate="A cat DJ spinning vinyl information at a futuristic nightclub with holographic beats.",

config=varieties.GenerateVideosConfig(number_of_videos=1, duration_seconds=5)

)

whereas not operation.accomplished:

time.sleep(20)

operation = consumer.operations.get(operation)

video = operation.response.generated_videos(0).video

video.present()Ausgabe:

Dies ermöglicht kreative, multimodale AI -Apps.

Chat und Gespräche

Sie können mit Chat -Sitzungen beginnen, die den Kontext in Ihren Nachrichten bewahren:

chat = consumer.chats.create(mannequin="gemini-2.0-flash-001")

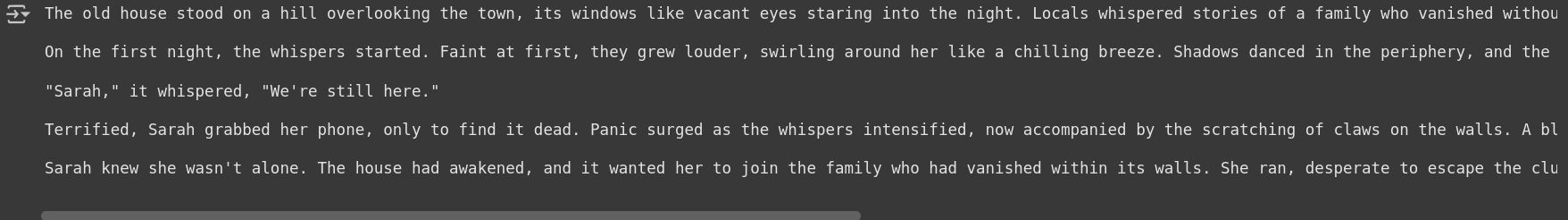

response = chat.send_message('Inform me a narrative')

print(response.textual content)

response = chat.send_message('Summarize that story in a single sentence')

print(response.textual content)

Dies ist nützlich, um eine Konversations -KI zu erstellen, die sich an den früheren Dialog erinnert.

Asynchrone Unterstützung

Alle Haupt -API -Methoden haben asynchronisierte Funktionen, um eine bessere Integration in asynchrische Python -Apps zu integrieren:

response = await consumer.aio.fashions.generate_content(

mannequin="gemini-2.0-flash-001",

contents="Inform a Horror story in 200 phrases."

)

print(response.textual content)

Token -Zählen

Token Counting Tracks Wie viele Token (Textteile) sind in Ihrer Eingabe. Dies hilft Ihnen, innerhalb von Modellgrenzen zu bleiben und kostengünstige Entscheidungen zu treffen.

token_count = consumer.fashions.count_tokens(

mannequin="gemini-2.0-flash-001",

contents="Why does the sky have a blue hue as a substitute of different colours?"

)

print(token_count)

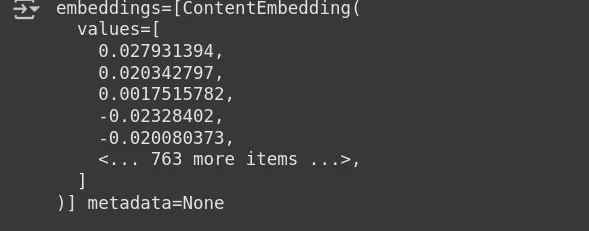

Einbettungen

Einbettungen verwandeln Ihren Textual content in numerische Vektoren, die seine Bedeutung darstellen, die für die Suche, Clusterbildung und AI -Bewertung verwendet werden kann.

embedding = consumer.fashions.embed_content(

mannequin="text-embedding-004",

contents="Why does the sky have a blue hue as a substitute of different colours?"

)

print(embedding)

Mit dem SDK können Sie problemlos Token zählen und Einbettungen vornehmen, um Ihre KI -Anwendungen zu verbessern und zu verbessern.

Abschluss

Das Google Gen AI Python SDK ist ein robustes, vielseitiges Device, mit dem Entwickler auf das Prime von Google zugreifen können Generative AI -Modelle in ihren Python -Projekten. Von der Textgenerierung, Chat und Chatbot über Bild-/Videogenerierung, Funktionsaufruf und vieles mehr bietet es einen robusten Funktionssatz mit einfachen Schnittstellen. Mit einer einfachen Paketinstallation, einem einfachen Consumer -Konfigurationsprozess und Unterstützung für async -Programmierung und Multimedia erleichtert der SDK Gebäudeanwendungen, die KI erheblich einfacher nutzen. Egal, ob Sie ein Anfänger oder ein erfahrener Entwickler sind, die Verwendung des SDK ist relativ schmerzlos, aber leistungsfähig, wenn es darum geht, generative KI in Ihre Workflows einzubeziehen.

Häufig gestellte Fragen

Es handelt sich

Sie führen PIP-Set up Google-Genai aus. Wenn Sie das SDK asynchron verwenden möchten, führen Sie PIP Set up Google-Genai (AIOHTTP) aus.

Bei der Erstellung von Consumer können Sie einen API -Schlüssel übergeben oder die Umgebungsvariablen gemini_api_key festlegen oder Google Cloud -Anmeldeinformationen für Vertex AI festlegen.

Ja, das SDK kann Vorgänge ausführen, bei denen Bilder und Dateien betroffen sind, hochladen und bearbeiten und in strukturierten Inhalten verwenden.

generate_content nimmt einfache Zeichenfolgen, Pay attention von Nachrichten, strukturierte Eingabeaufforderungen an, bei denen Sie Rollen zuweisen, und Multipartinhalte (Textual content zusammen mit Bildern oder Dateien).

Mit der Funktionsaufruf -Funktion kann das Modell während der Sitzung dynamisch Python -Funktionen aufrufen. Daher können Sie einen Workflow haben, der externe Logik oder Pc aufruft.

Ja, bei generate_content können Sie den Parameter von Generation_Config mit Argumenten wie Temperatur (zur Steuerung von Zufälligkeit) und max_output_tokens (um die Modellantwort zu begrenzen) verwenden.

Melden Sie sich an, um weiter zu lesen und Experten-Kuratinhalte zu genießen.