Bild vom Autor

Die meisten Menschen ohne technisches Wissen denken vielleicht, dass die Arbeit mit KI oder LLMs (Massive Language Fashions) eine Herausforderung darstellt und Experten und Ingenieuren vorbehalten ist. Was wäre jedoch, wenn ich Ihnen sagen würde, dass Sie lediglich Python-Kenntnisse benötigen, um eine breite Palette von LLM-Projekten zu erstellen, von Q&A-Systemen bis hin zu YouTube-Zusammenfassungen? Sie können sogar Ihre eigene GPT-4o-Anwendung mit mehreren Open-Supply-Modellen und -Komponenten erstellen.

In diesem Projekt werden wir interessante und leicht umsetzbare LLM-Projektideen erkunden, die Sie mit kostenlosen oder erschwinglichen Ressourcen umsetzen können. Darüber hinaus wird jede Projektidee von einem Beispielprojektlink begleitet, den Sie sich ansehen können, um besser zu verstehen, wie es funktioniert.

1. Feinabstimmung von Llama 3 und lokale Verwendung

Der Feinabstimmung von Llama 3 und lokale Verwendung ist ein richtiges Projekt mit mehreren Schritten und Dateien. Ziel ist es, das Modell anhand eines Datensatzes von Patienten-Arzt-Gesprächen mithilfe kostenloser Ressourcen von Kaggle zu optimieren. Sobald das Modell erfolgreich optimiert ist, kann es medizinische Fragen auf hochprofessionelle Weise beantworten.

Bild aus dem Projekt

Um das Modell offline auf Ihrem Laptop computer zu verwenden, können Sie die folgenden Schritte ausführen:

- Führen Sie die Adopter-Ebene mit dem Basismodell zusammen.

- Konvertieren Sie das Modell in das Llama.cpp-Format, bekannt als GGUF.

- Reduzieren Sie die Größe des Modells mithilfe der Quantisierungsmethode.

- Verwenden Sie das Modell schließlich mit der Home windows Jan-Anwendung auf Ihrem Laptop computer.

Es ist wichtig, dass medizinische Gespräche zwischen Arzt und Affected person vertraulich bleiben. Daher ist es notwendig, die Lösung lokal zu nutzen und die Privatsphäre zu wahren.

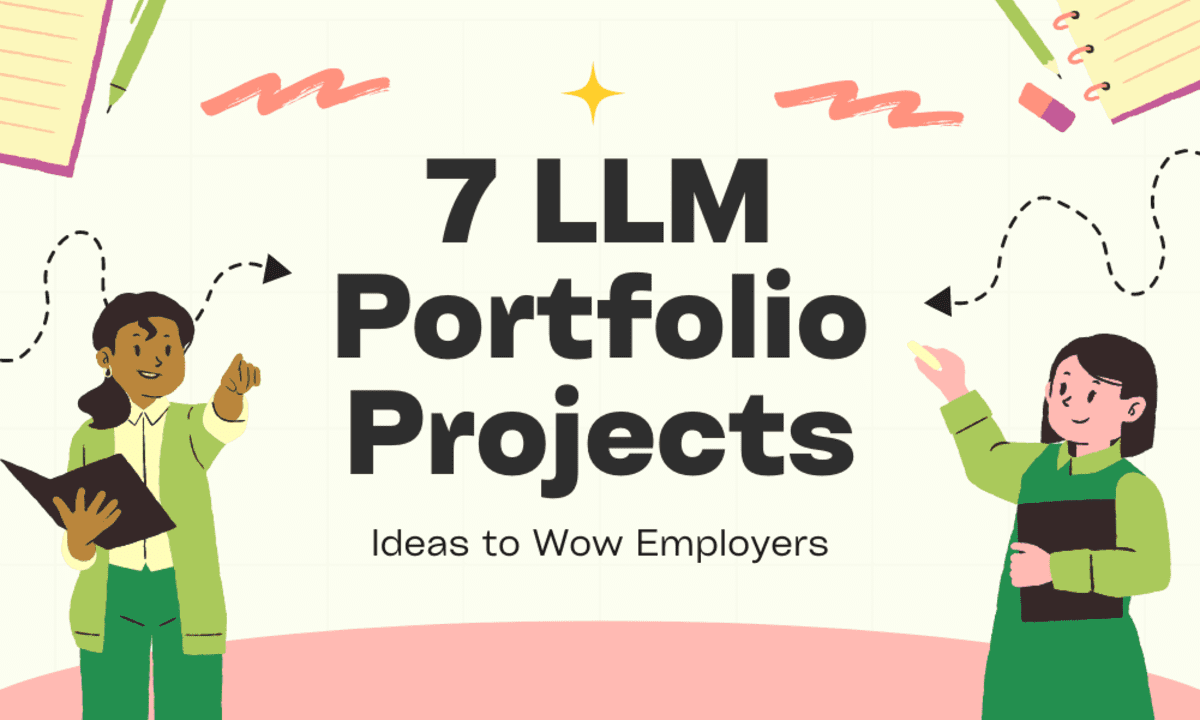

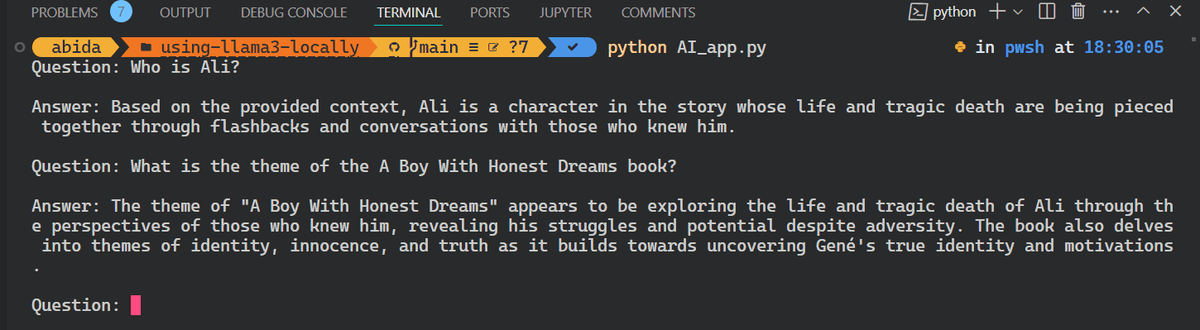

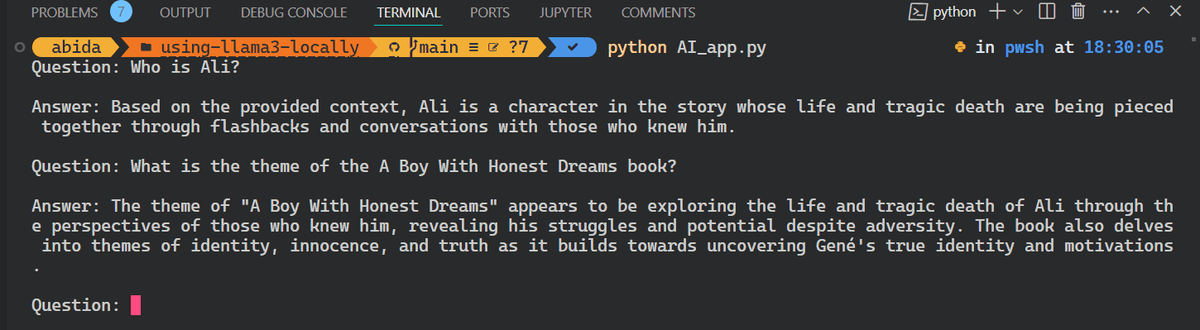

2. Q&A-Abrufsystem

Wenn Sie das Modell nicht optimieren möchten, können Sie mit Instruments wie LangChain, Chroma DB und Ollama trotzdem kontextsensitive KI-Anwendungen lokal erstellen. Diese Anwendung verwendet Ihren Datensatz als Kontext, bevor sie die Antwort generiert.

Zum Erstellen der RAG-Anwendung (Retrieval-augmented technology) können Sie die folgenden Schritte ausführen:

- PDF-Dateien laden: Laden Sie zunächst alle PDF-Dateien aus dem angegebenen Ordner.

- Textual content teilen: Teilen Sie den Textual content zur effizienteren Verarbeitung in kleinere Abschnitte auf.

- In Einbettungen konvertieren: Wandeln Sie den Textual content in Einbettungen um und speichern Sie diese in der Vektordatenbank.

- Abrufkette erstellen: Erstellen Sie mit LangChain eine Abrufkette.

- Python-Anwendung entwickeln: Erstellen Sie eine entsprechende Python-Anwendung, um ein nahtloses Chat-Erlebnis zu gewährleisten.

Bild aus Projekt

LangChain vereinfacht den Prozess, indem es eine hochrangige API und einfach zu verwendende Befehle bereitstellt. Indem Sie dem Tutorial auf „So führen Sie Llama 3 lokal aus„können Sie eine kontextsensitive, intelligente LLM-Anwendung erstellen.

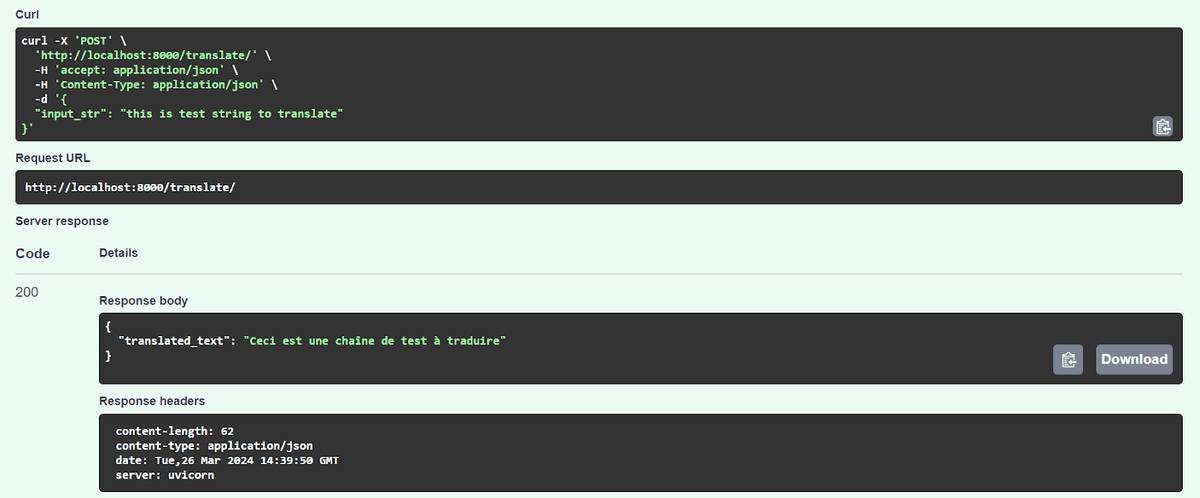

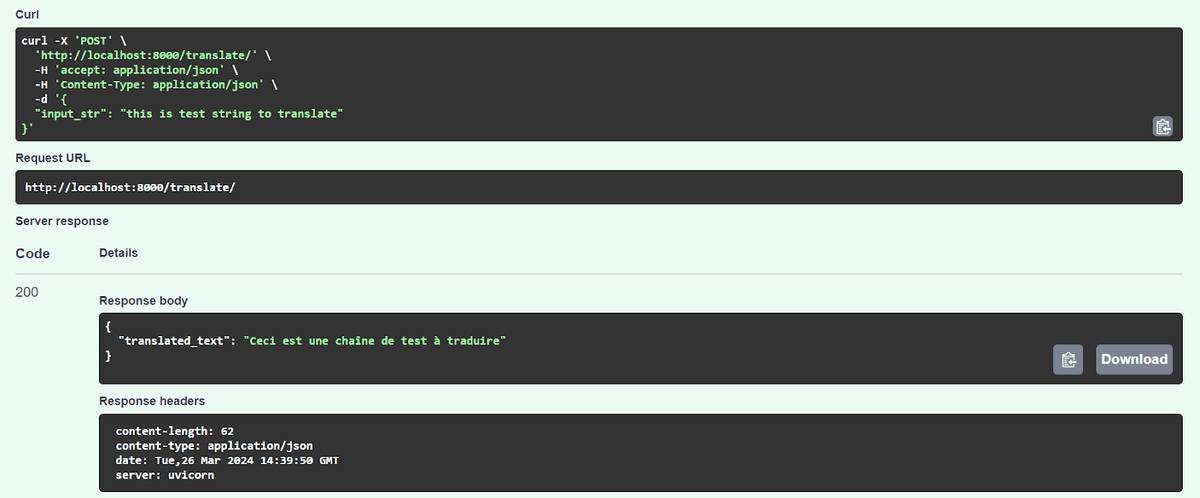

3. Bereitstellen einer LLM-Anwendung als API-Endpunkt mit FastAPI in Python

In diesem Projekt erstellen Sie mithilfe der OpenAI API und FastAPI eine API für die Übersetzung von Englisch nach Französisch. Das Projekt besteht aus zwei Hauptteilen: Verstehen, wie Sie mithilfe der OpenAI API sicherstellen, dass die generierte Ausgabe immer auf Französisch ist, und Erstellen einer REST-API mithilfe von FastAPI, um Textual content aufzunehmen und über einen einfachen CURL-Befehl eine Ausgabe zu generieren.

Wenn Sie mit FastAPI vertraut sind, können Sie in 30 Minuten eine noch bessere LLM-Anwendung erstellen, die als API-Endpunkt dienen kann.

Bild aus Projekt

Als Referenz folgen Sie der Anleitung „Bereitstellen einer LLM-Anwendung als API-Endpunkt mithilfe von FastAPI in Python“ und versuchen Sie, Ihr LLM bereitzustellen. Es kann auch ein Modell sein, das Sie lokal ausführen.

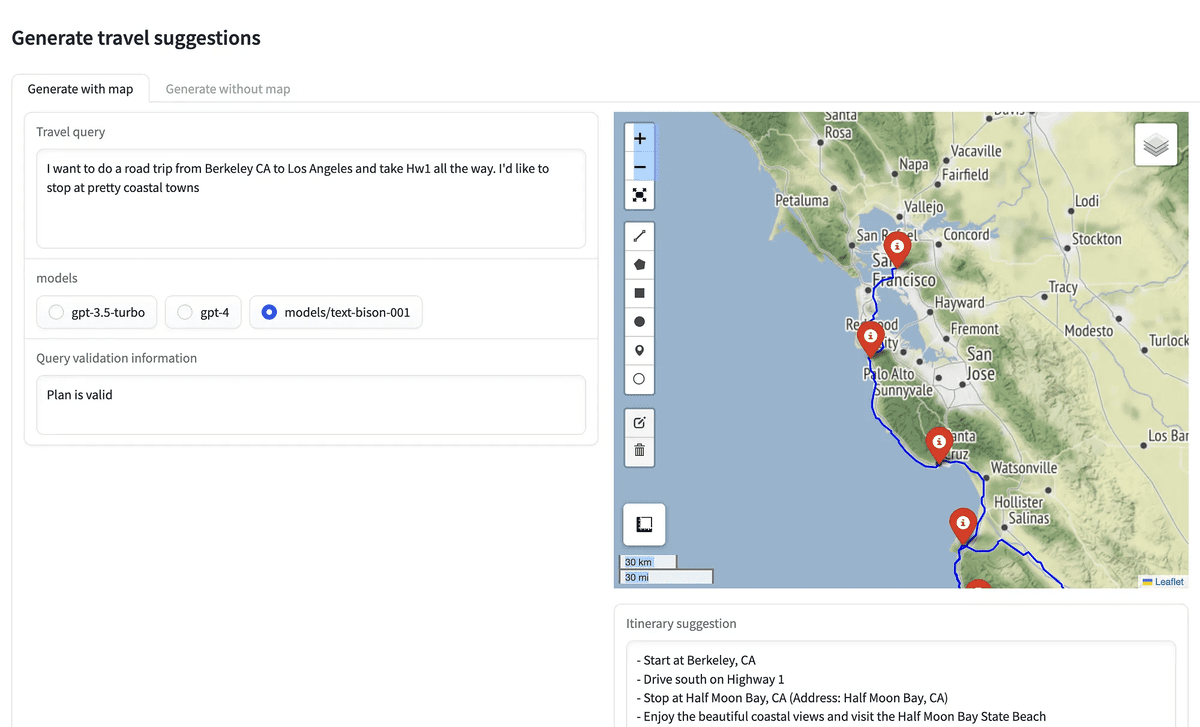

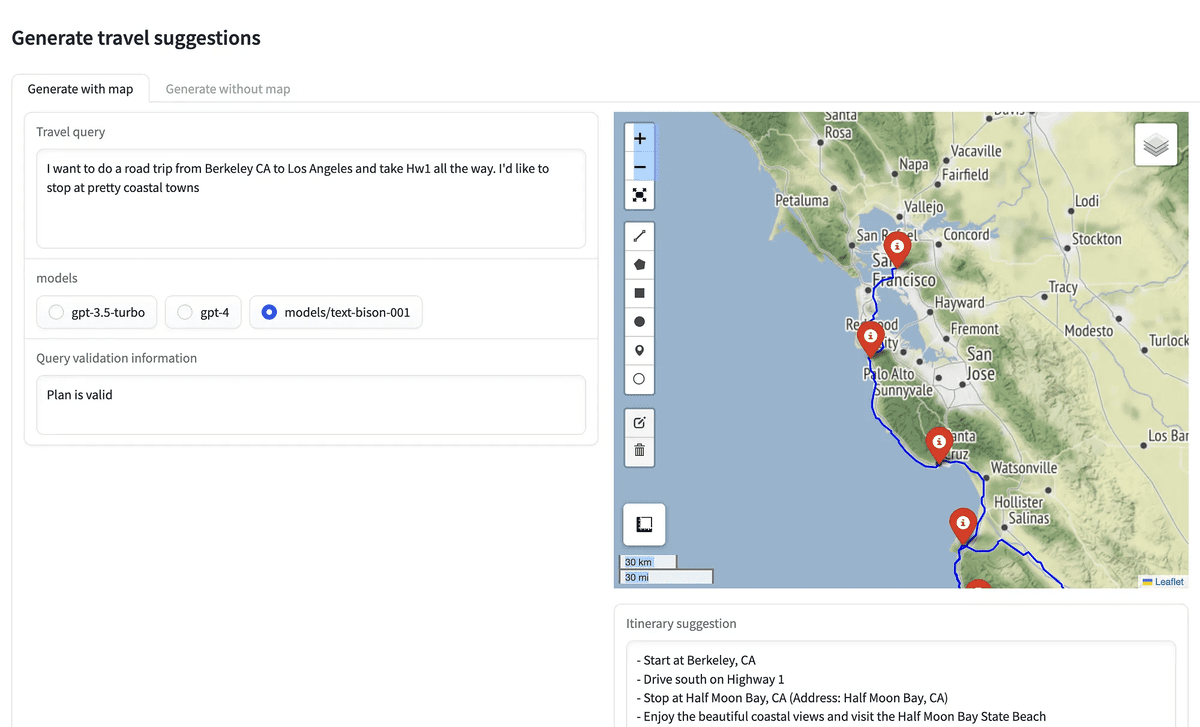

4. Urlaubsplanungsassistent

Einen Urlaub ohne Reisebüro zu planen, kann schwierig sein. Es gibt so viele bewegliche Teile und manchmal wissen die Leute nicht einmal, was sie tun sollen. Warum additionally nicht Ihre eigene Reiserouten-App erstellen, die Ihre Reiseroute auf einer Karte anzeigt und detaillierte Pläne und verschiedene Sehenswürdigkeiten bereitstellt?

In diesem Projekt erstellen Sie eine Webanwendung, die Benutzeranweisungen zu ihren Reiseplänen entgegennimmt und Reiseroutenvorschläge macht und diese auf einer Karte anzeigt.

Bild aus Projekt

Das Projekt erfordert, dass Sie einige Grundlagen über Gradio, Launching und die Google Maps API lernen, bevor Sie in das Projekt eintauchen. Sie können beginnen, indem Sie den „Erstellen eines intelligenten Reiseroutenvorschlags mit LangChain, Google Maps API und Gradio (Teil 1)„-Tutorial, aber wenn Sie den Urlaubsplanungsassistenten erstellen möchten, müssen Sie Ihrer Anwendung möglicherweise weitere Komponenten hinzufügen und sie robuster machen.

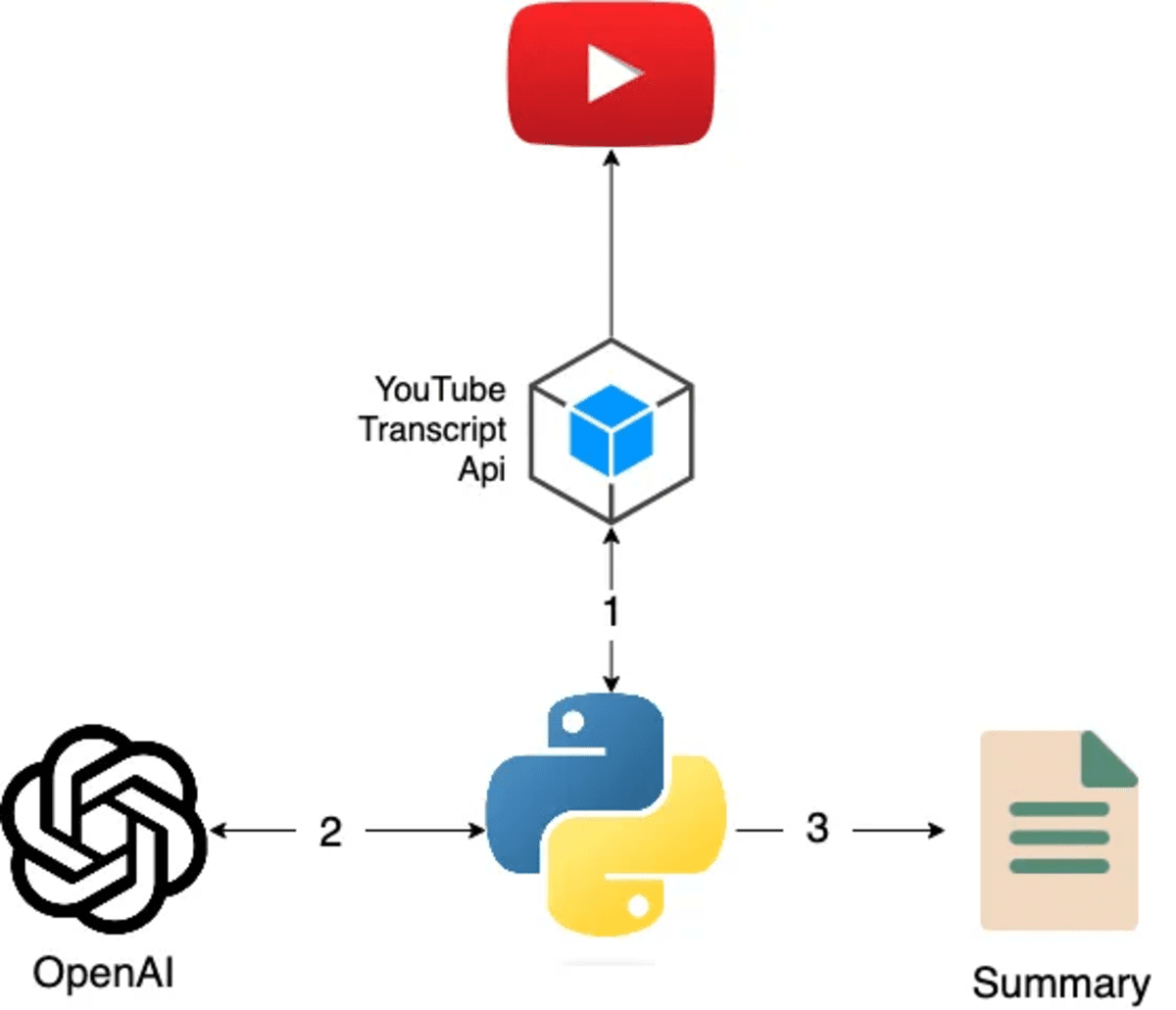

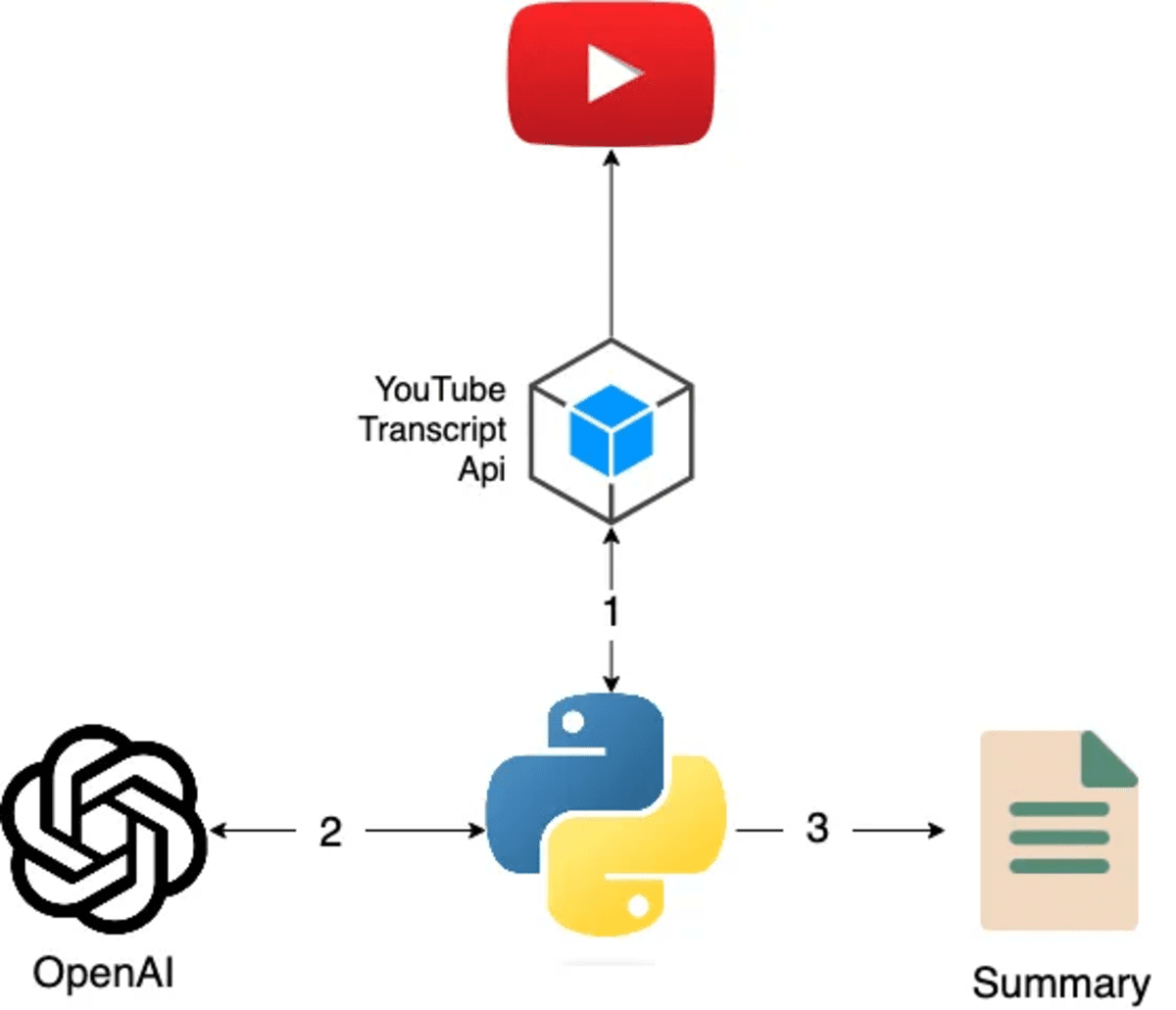

5. YouTube-Zusammenfassung

YouTube Summarizer ist ein anfängerfreundliches Projekt, das sich perfekt für Studenten und Neueinsteiger in APIs und natürlicher Sprachverarbeitung eignet. Das Projekt beinhaltet die Verwendung der YouTube-API zum Extrahieren von Transkripten aus Movies und der OpenAI-API zum Zusammenfassen dieser Transkripte. Da einige Movies lang sein können und das Kontextfenster von Modellen wie ChatGPT möglicherweise begrenzt ist, muss das Transkript für das Projekt in überschaubare Teile aufgeteilt werden. Jeder Teil wird einzeln zusammengefasst und die zusammengefassten Abschnitte werden dann kombiniert, um eine zusammenhängende Zusammenfassung des gesamten Movies zu erstellen.

Bild aus Projekt

Folgen Sie den Anweisungen unter „Erstellen Sie in nur 3 einfachen Schritten Ihre eigene YouTube-Videozusammenfassungs-App„-Tutorial und erleben Sie die Großartigkeit selbst.

Notiz: Das Projekt verwendet die alte API. Sie können jederzeit die OpenAI API-Dokumentation prüfen, um auf die neue Struktur zu aktualisieren.

6. Internet Scraping mit LLMs

Internet Scraping kann ein lukratives Geschäft sein, mit dem Einzelpersonen bis zu 200 Greenback professional Tag verdienen können, indem sie ein einfaches Skript ausführen. Es gilt als lukrativ, weil es schwierig sein kann, bestimmte Web site-Strukturen zu umgehen. In solchen Fällen kann die Erstellung eines LLM-gestützten Internet Scrapers mit Scrapy und Ollama helfen, das Internet-Parsing zu automatisieren oder zu verbessern.

Bild von books.toscrape.com

Folgen Sie der Anleitung „Internet Scraping mit LLMs,“ können Sie lernen, LLM auf jeder Webseite zu verwenden, um bestimmte Attribute wie Produktname und Preis zu extrahieren. Mit LLM ist keine manuelle Codierung mehr erforderlich, um diese Attribute aus der Webseite zu extrahieren. Sie müssen lediglich die Eingabeaufforderung immediate.e ändern.

7. Erstellen Sie GPT4o mit Open Fashions

Der Aufbau einer All-in-One-KI-Anwendung erfordert in der Regel Millionen von Greenback und jahrelange Forschung. Was wäre, wenn ich Ihnen sagen würde, dass Sie Ihr eigenes GPT-4o-Modell mithilfe eines Open-Supply-Modells kostenlos und in nur einem Tag erstellen können?

In diesem Projekt werden wir eine umfassende Open GPT-4o-Anwendung erstellen, die Audio-, Bild- und Textdaten verstehen kann. Sie wird eine Stay-Voice-Chat-Funktion und Video-Chat-Funktionen enthalten. Darüber hinaus können Sie damit Bilder und Movies generieren. Kurz gesagt, es wird Ihre AGI-Anwendung (Synthetic Normal Intelligence) sein.

Bitte beachten Sie, dass für das Projekt weder eine Anleitung noch ein Tutorial mitgeliefert wird. Sie müssen sich additionally alles aneignen, indem Sie den Quellcode verstehen: app.py · KingNish/OpenGPT-4o bei principal (huggingface.co)

Bild von OpenGPT 4o

Bevor Sie Ihre LLM-Anwendung erstellen, empfehle ich Ihnen dringend, OpenGPT 4o. Informieren Sie sich über die verschiedenen Funktionen und den verwendeten Modelltyp. Erfahren Sie, wie effizient und schnell es ist.

Abschließende Gedanken

Der Aufbau eines LLM-Portfolioprojekts kann Ihre Karriereaussichten erheblich verbessern. Wenn Sie Scholar auf Arbeitssuche sind, werden Ihnen diese 7 Projekte helfen, schneller als andere einen Job zu finden. Personalvermittler und Personalmanager sind besonders von Projekten beeindruckt, die die neuesten Technologien wie KI integrieren.

Setzen Sie zunächst ein Lesezeichen auf diese Seite und beginnen Sie mit der Erstellung einfacher Projekte. Wenn Sie zu komplexeren Projekten übergehen, achten Sie darauf, Ihre Arbeit konsequent auf LinkedIn zu präsentieren. Auf diese Weise werden Sie bald die Aufmerksamkeit von Personalvermittlern erregen.

Abid Ali Awan (@1abidaliawan) ist ein zertifizierter Datenwissenschaftler, der gerne Modelle für maschinelles Lernen erstellt. Derzeit konzentriert er sich auf die Erstellung von Inhalten und das Schreiben technischer Blogs zu Technologien für maschinelles Lernen und Datenwissenschaft. Abid hat einen Grasp-Abschluss in Technologiemanagement und einen Bachelor-Abschluss in Telekommunikationstechnik. Seine Imaginative and prescient ist es, mithilfe eines Graph-Neural-Networks ein KI-Produkt für Studenten zu entwickeln, die mit psychischen Erkrankungen zu kämpfen haben.