Nur drei Monate nach der Veröffentlichung seines hochmodernen Modells Gemini 3 Professional ist Google DeepMind mit seiner neuesten Model hier: Gemini 3.1 Professional.

Das Gemini 3.1 Professional-Modell ist ein radikales Improve in Bezug auf Leistungsfähigkeit und Sicherheit und soll für jedermann zugänglich und bedienbar sein. Unabhängig von Ihrer Präferenz, Plattform und Kaufkraft hat das Modell allen Nutzern viel zu bieten.

Ich würde die Fähigkeiten von Gemini 3.1 Professional testen und die wichtigsten Funktionen näher erläutern. Vom Zugriff auf Gemini 3.1 Professional bis hin zu Benchmarks wurde in diesem Artikel alles über dieses neue Modell angesprochen.

Gemini 3.1 Professional: Was ist neu?

Gemini 3.1 Professional ist das neueste Mitglied der Gemini-Modellfamilie. Wie üblich verfügt das Modell über eine erstaunliche Anzahl an Funktionen und Verbesserungen aus der Vergangenheit. Einige der auffälligsten sind:

- 1 Million Kontextfenster: Behält die branchenführende Eingabekapazität von 1 Million Token bei und ermöglicht die Verarbeitung von über 1.500 Textseiten oder ganzen Code-Repositorys in einer einzigen Eingabeaufforderung.

- Erweiterte Argumentationsleistung: Es liefert mehr als das Doppelte der Argumentationsleistung des Gemini 3 Professional und punktet 77,1 % auf dem ARC-AGI-2-Benchmark.

- Verbesserte Agentenzuverlässigkeit: Speziell optimiert für autonome Arbeitsabläufe, einschließlich eines dedizierten API-Endpunkts (gemini-3.1-pro-preview-customtools) für hochpräzise Software-Orchestrierung und Bash-Ausführung.

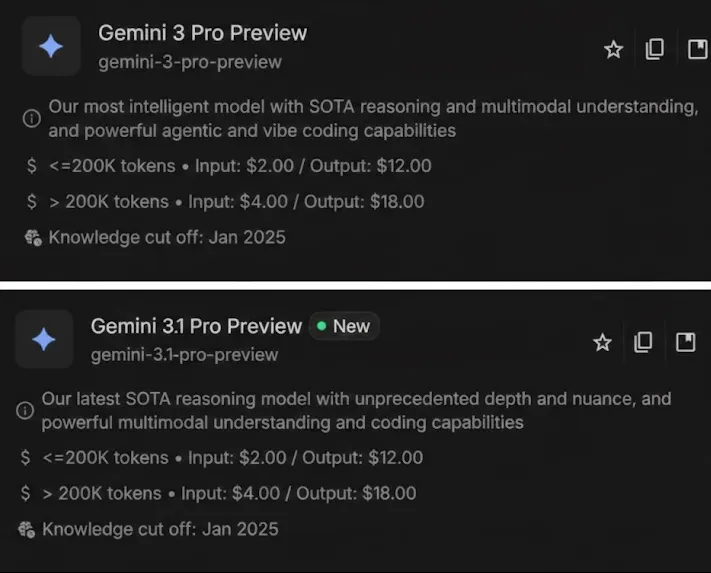

- Preise: Der Preis/Token des neuesten Modells ist derselbe wie der seines Vorgängers. Für diejenigen, die an die Professional-Variante gewöhnt sind, gibt es ein kostenloses Improve.

- Erweiterte Vibe-Codierung: Das Modell beherrscht die visuelle Codierung außergewöhnlich intestine. Es kann webbasierte, animierte SVGs ausschließlich durch Code generieren, was eine gestochen scharfe Skalierung und winzige Dateigrößen bedeutet.

- Halluzinationen: Gemini 3.1 Professional hat das Halluzinationsproblem direkt angegangen, indem es die Halluzinationsrate von 88 % auf reduziert hat 50 % über AA-Omniscience: Wissens- und Halluzinations-Benchmark

- Granulares Denken: Das Modell erweitert die vom Vorgänger angebotenen Denkmöglichkeiten um mehr Granularität. Jetzt können die Benutzer zwischen hohen, mittleren und niedrigen Denkparametern wählen.

| Denkebene | Gemini 3.1 Professional | Gemini 3 Professional | Gemini 3 Flash | Beschreibung |

| Minimal | Nicht unterstützt | Nicht unterstützt | Unterstützt |

Entspricht der Einstellung „Kein Nachdenken“ für die meisten Abfragen. Für komplexe Codierungsaufgaben kann das Modell minimal denken. Minimiert die Latenz für Chat oder Anwendungen mit hohem Durchsatz. |

| Niedrig | Unterstützt | Unterstützt | Unterstützt |

Minimiert Latenz und Kosten. Splendid für die einfache Befolgung von Anweisungen oder Anwendungen mit hohem Durchsatz. |

| Medium | Unterstützt | Nicht unterstützt | Unterstützt |

Ausgewogene Argumentation für die meisten Aufgaben. |

| Hoch | Unterstützt (Customary, Dynamisch) | Unterstützt (Customary, Dynamisch) | Unterstützt (Customary, Dynamisch) |

Maximiert die Argumentationstiefe. Kann die Latenz erhöhen, aber die Ausgaben sind sorgfältiger begründet. |

Arms-On: Lasst uns Spaß haben

Alles Gerede der Welt würde nichts nützen, wenn die Leistung in der Praxis versagt. Um Gemini 3.1 Professional richtig zu bewerten, habe ich es in drei Kategorien getestet:

- Komplexe Argumentation

- Codegenerierung und Debugging

- Langkontextsynthese

Aufgabe 1: Mehrstufiges logisches Denken

Was das testet: Gedankenkettendenken, Umgang mit Einschränkungen und Halluzinationsresistenz.

Immediate:

„Sie erhalten das folgende Szenario:

Fünf Analysten – A, B, C, D und E – sind drei Projekten zugeordnet: Alpha, Beta und Gamma.

Regeln:

1. Jedes Projekt muss mindestens einen Analysten haben.

2. A kann nicht mit C zusammenarbeiten.

3. B muss demselben Projekt wie D zugeordnet sein.

4. E kann nicht auf Alpha sein.

5. Kein Projekt kann mehr als drei Analysten haben.

Frage: Alle gültigen Zuweisungskombinationen auflisten. Machen Sie Ihre Argumentation deutlich und stellen Sie sicher, dass keine Regel verletzt wird.

„

Antwort:

Gemini 3.1 Professional bewältigte die Logik mit vielen Einschränkungen, ohne in Widersprüche zu verfallen, wo die meisten Modelle stolpern. Die Konsistenz und Klarheit bei der Aufzählung gültiger Kombinationen zeigte eine ernsthafte Argumentationstiefe.

Aufgabe 2: Codegenerierung und Refactoring

Was das testet: Strukturiertes Denken, Grenzfallbewusstsein, Code-Korrektheit und Produktionsrealismus.

Immediate:

„Sie erhalten die folgende Python-Funktion:

def process_orders(orders):

complete = 0

for order in orders:

if order("standing") == "accomplished":

complete += order("quantity")

return completeRefaktorieren Sie diese Funktion wie folgt:

1. Gehen Sie sicher mit fehlenden Schlüsseln um.

2. Ignorieren Sie adverse Beträge.

3. Protokoll übersprungene ungültige Einträge.

4. Seien Sie mit Typhinweisen und Dokumentzeichenfolgen produktionsbereit.

5. Integrieren Sie Unit-Checks für Randfälle.

Geben Sie nur sauberen, intestine strukturierten Python-Code zurück.

„

Antwort:

import logging

import unittest

from typing import Listing, Dict, Any

logger = logging.getLogger(__name__)

def process_orders(orders: Listing(Dict(str, Any))) -> float:

"""

Course of an inventory of order dictionaries and calculate

the full quantity of accomplished orders.

"""

complete: float = 0.0

if not isinstance(orders, record):

logger.error("'orders' should be an inventory.")

return complete

for index, order in enumerate(orders):

if not isinstance(order, dict):

logger.warning("Skipping index %d: Not a dictionary.", index)

proceed

if order.get("standing") != "accomplished":

proceed

if "quantity" not so as:

logger.warning("Skipping index %d: Lacking 'quantity'.", index)

proceed

quantity = order("quantity")

if not isinstance(quantity, (int, float)) or isinstance(quantity, bool):

logger.warning("Skipping index %d: 'quantity' should be numeric.", index)

proceed

if quantity < 0:

logger.warning("Skipping index %d: Detrimental quantity (%.2f).", index, quantity)

proceed

complete += float(quantity)

return complete

class TestProcessOrders(unittest.TestCase):

def setUp(self):

logging.disable(logging.WARNING)

def tearDown(self):

logging.disable(logging.NOTSET)

def test_valid_completed_orders(self):

orders = (

{"standing": "accomplished", "quantity": 100},

{"standing": "accomplished", "quantity": 50.5}

)

self.assertEqual(process_orders(orders), 150.5)

def test_ignore_pending_orders(self):

orders = (

{"standing": "pending", "quantity": 100},

{"standing": "accomplished", "quantity": 50}

)

self.assertEqual(process_orders(orders), 50.0)

def test_missing_keys_skipped(self):

orders = (

{"quantity": 100},

{"standing": "accomplished"},

{"standing": "accomplished", "quantity": 20}

)

self.assertEqual(process_orders(orders), 20.0)

def test_negative_amounts_ignored(self):

orders = (

{"standing": "accomplished", "quantity": -10},

{"standing": "accomplished", "quantity": 3Der überarbeitete Code fühlte sich produktionsorientiert an, nicht auf Spielzeugniveau. Es berücksichtigte Randfälle, erzwang Typsicherheit und umfasste aussagekräftige Checks. Dies ist die Artwork von Ausgabe, die tatsächlich reale Entwicklungsstandards respektiert.

Aufgabe 3: Analytische Langkontext-Synthese

Was das testet: Informationskomprimierung, strukturierte Zusammenfassung und kontextübergreifendes Denken.

Immediate:

„Nachfolgend finden Sie einen synthetischen Geschäftsbericht:

Unternehmen: NovaGrid AI

Umsatz 2022: 12 Millionen US-Greenback

2023 Einnahmen : 28 Millionen US-Greenback

2024 Einnahmen: 46 Millionen US-Greenback

Die Kundenabwanderung stieg im Jahr 2024 von 4 % auf 11 %.

Die F&E-Ausgaben stiegen im Jahr 2024 um 70 %.

Die operative Marge sank von 18 % auf 9 %.

Die Zahl der Unternehmenskunden stieg um 40 %.

Die Zahl der KMU-Kunden ging um 22 % zurück.

Die Kosten für die Cloud-Infrastruktur haben sich verdoppelt.

Aufgabe:

1. Diagnostizieren Sie die wahrscheinlichsten Ursachen für den Margenrückgang.

2. Identifizieren Sie strategische Risiken.

3. Empfehlen Sie 3 datengestützte Maßnahmen.

4. Präsentieren Sie Ihre Antwort in einem strukturierten Government-Memo-Format.

„

Antwort:

Es verknüpfte Finanzsignale, operative Veränderungen und strategische Risiken zu einer kohärenten Führungserzählung. Die Fähigkeit, Margendruck zu diagnostizieren und gleichzeitig Wachstumssignale auszugleichen, zeugt von starken geschäftlichen Überlegungen. Es las sich wie etwas, das ein kluger Strategieberater entwerfen würde, und nicht wie eine allgemeine Zusammenfassung.

Notiz: Ich habe nicht die Standardaufgaben „Dashboard erstellen“ verwendet, wie sie bei den meisten neueren Modellen üblich sind Sonett 4.6, Kimi Okay 2,5sind leicht in der Lage, eine zu erstellen. Für ein so leistungsfähiges Modell würde es additionally keine große Herausforderung darstellen.

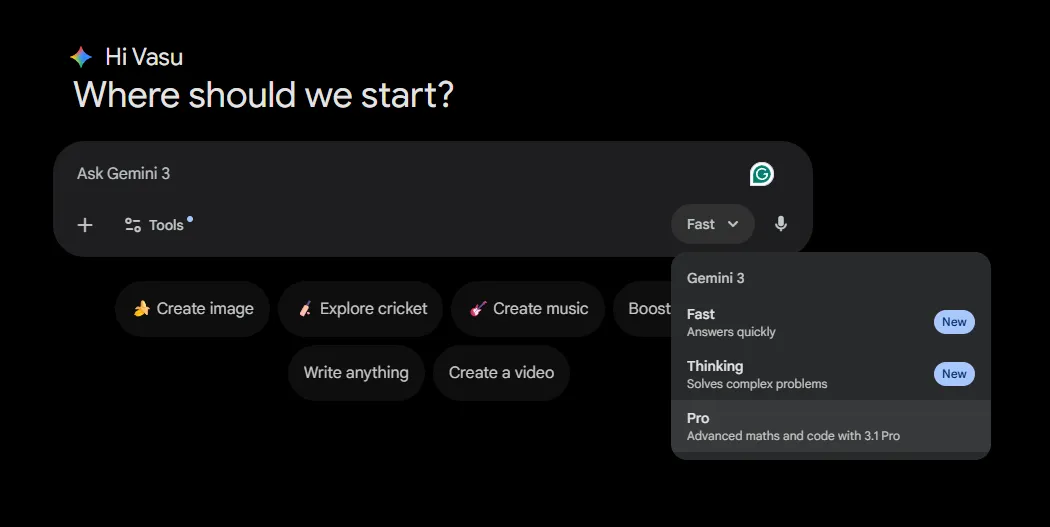

Wie greife ich auf Gemini 3.1 Professional zu?

Im Gegensatz zu den vorherigen Professional-Modellen ist Gemini 3.1 Professional für alle Benutzer auf der Plattform ihrer Wahl frei zugänglich.

Nachdem Sie sich nun für die Verwendung von Gemini 3.1 Professional entschieden haben, sehen wir uns an, wie Sie auf das Modell zugreifen können.

- Gemini-Net-Benutzeroberfläche: Free- und Gemini Superior-Benutzern steht jetzt 3.1 Professional unter der Possibility „Modell“ zur Verfügung.

- API: Verfügbar über Google AI Studio für Entwickler (Modelle/Gemini-3.1-pro).

| Modell | Basiseingabetoken | 5 Mio. Cache-Schreibvorgänge | 1 Stunde Cache-Schreibvorgänge | Cache-Treffer und Aktualisierungen | Ausgabetoken |

| Gemini 3.1 Professional (≤200.000 Token) | 2 $ / 1 Mio. Token | ~0,20–0,40 $ / 1 Mio. Token | ~4,50 $ / 1 Mio. Token professional Stunde Lagerung | Nicht offiziell dokumentiert | 12 $ / 1 Mio. Token |

| Gemini 3.1 Professional (>200.000 Token) | 4 $ / 1 Mio. Token | ~0,20–0,40 $ / 1 Mio. Token | ~4,50 $ / 1 Mio. Token professional Stunde Lagerung | Nicht offiziell dokumentiert | 18 $ / 1 Mio. Token |

- Cloud-Plattformen: Wird für NotebookLM, Vertex AI von Google Cloud und Microsoft Foundry eingeführt.

Benchmarks

Um zu quantifizieren, wie intestine dieses Modell ist, würden die Benchmarks hilfreich sein.

Hier gibt es viel zu entschlüsseln. Aber die erstaunlichste Verbesserung von allen gibt es sicherlich bei den abstrakten Denkrätseln.

Lassen Sie mich die Dinge ins rechte Licht rücken: Gemini 3 Professional wurde mit einem ARC-AGI-2-Rating von 31,1 % veröffentlicht. Dies battle der höchste Wert seiner Zeit und galt als Durchbruch für die LLM-Requirements. Nur drei Monate später wurde dieser Wert von seinem eigenen Nachfolger in den Schatten gestellt die Marge verdoppeln!

Dies ist das rasante Tempo, mit dem sich KI-Modelle verbessern.

Wenn Sie mit den Checks dieser Benchmarks nicht vertraut sind, lesen Sie diesen Artikel: KI-Benchmarks.

Fazit: Leistungsstark und zugänglich

Gemini 3.1 Professional beweist, dass es mehr als ein auffälliges multimodales Modell ist. In Bezug auf Argumentation, Code und analytische Synthese demonstriert es echte Leistungsfähigkeit mit Produktionsrelevanz. Es ist nicht fehlerfrei und erfordert dennoch strukturierte Anweisungen und menschliche Aufsicht. Aber als Grenzmodell, eingebettet in das Google-Ökosystem, ist es leistungsstark, wettbewerbsfähig und absolut eine ernsthafte Bewertung wert.

Häufig gestellte Fragen

A. Es ist für fortgeschrittenes Denken, Verarbeitung langer Kontexte, multimodales Verständnis und KI-Anwendungen in Produktionsqualität konzipiert.

A. Entwickler können über Google AI Studio für Prototyping oder Vertex AI für skalierbare Unternehmensbereitstellungen darauf zugreifen.

A. Es ist leistungsstark, erfordert aber dennoch strukturierte Anweisungen und menschliche Aufsicht, um Genauigkeit sicherzustellen und Halluzinationen zu reduzieren.

Melden Sie sich an, um weiterzulesen und von Experten kuratierte Inhalte zu genießen.