Indien ist ein vielfältiges Land mit einem reichhaltigen Wandteppich an Sprachen, das in Regionen nahtlose Kommunikation in den Regionen zu einer anhaltenden Herausforderung macht. Sarvams Bulbul-V2 von Sarvam trägt jedoch dazu bei, diese Lücke mit seinem fortschrittlichen Textual content-zu-Sprach (TTS) Technologie. Durch die Bereitstellung natürlicher, regional authentischer Stimmen bringt das Modell digitale Plattformen lokaler Geschmack und macht KI für Desi -Leute wie Sie und mich integrativer und zugänglicher. Da sich digitale Inhalte weiter erweitern, werden Instruments wie Bulbul-V2 für Entwickler und Inhaltsersteller immer wichtiger. In diesem Artikel werde ich Sarvam Ai’s Discover Bulbul-V2 für TTS abdecken.

Was ist Saravm?

Sarvam ist ein indisches KI -Startup mit Sitz in Bengaluru, das von einem Workforce maschineller Lerningenieure gegründet wurde. Sarvam wurde kürzlich von der indischen Regierung für ihre Arbeit an indischen Großsprachenmodellen (LLMs) anerkannt und konzentriert sich auf die Entwicklung sprachbasierter KI-Modelle, die auf indische Sprachen zugeschnitten sind. Sein Ziel ist es, natürliche synthetische Stimmen zu schaffen, die die Nuancen der menschlichen Sprache erfassen. Im Gegensatz zu herkömmlichen TTS -Systemen, die häufig roboter und emotionlos klingen, betonen die Modelle von Sarvam die ausdrucksstarke Entbindung, einschließlich natürlicher Pausen und emotionaler Kontext.

Erkundung von Sarvams Fashions

Sarvam bietet Hochleistungs-Sprachdienste mit Schwerpunkt auf natürlichen und ausdrucksstarken synthetisierten Stimmen, die für die Konversations-KI optimiert sind. Ihr Flaggschiff-Modell, Bulbul-V2, ist ein hochmodernes Textual content-zu-Sprach-System (TTS), das speziell für Indic-Sprachen erstellt wurde. Es passt an verschiedene regionale Sprachen und Sprechstile, versteht kontextbezogene Hinweise aus dem umgebenden Textual content und liefert Sprache mit angemessenem emotionalem Ton und natürlicher Prosodie. Sarvam bietet 4 KI -Modelle an, um verschiedene indische Sprachbedürfnisse zu erfüllen:

- Mayura: Ein mehrsprachiges Übersetzungsmodell, das Englisch und 11 indische Sprachen mit automatischer Spracherkennung unterstützt, die Bedeutung und Kontext bewahrt.

- Saras: Ein Sprach-zu-Textual content-Modell, das Audio transkribiert und zwischen indischen Sprachen in einer einzelnen Pipeline überträgt.

- Saarika: Ein Textual content-zu-Sprache-Modell mit hoher Genauigkeit für mehrere indische Sprachen, das eine klare und verständliche Ausgabe bietet.

- Bulbul: Das TTS-Rückgrat von Sarvam, Bulbul, bietet menschliche Prosodien, mehrere Sprachpersönlichkeiten und Echtzeitsynthese, die auf indische Akzente und Sprachen zugeschnitten sind.

Lesen Sie auch: 9 Beste Open Supply Textual content-to-Speech-Motoren (TTS)

Was ist das Besondere an Bulbul-V2?

Bulbul-V2 ist das bisher fortschrittlichste TTS-Modell von Sarvam und baut auf dem Erfolg seines Vorgängers mit mehreren innovativen Verbesserungen auf. Es unterstützt 11 indische Sprachen und liefert einheimische Stimmen mit authentischen regionalen Akzenten. Bulbul-V2 ist sowohl für die Geschwindigkeit als auch für die Kosteneffizienz ausgelegt. Es ist intestine geeignet für eine Vielzahl von Anwendungsfällen. Diese reichen von großen Anwendungen bis hin zu kleineren Bereitstellungen. Das Modell bietet mehrere Sprachpersönlichkeiten wie Meera und Arvind. Es unterstützt die kundenspezifische Sprachkreation, mit der Unternehmen ein unverwechselbares Audio -Branding aufbauen können.

Schlüsselmerkmale von Bulbul-V2

- Sprachkontrolle: Feinkörnige Kontrolle über Tonhöhe (-1 bis 1), Tempo (0,3 bis 3) und Lautstärke (0,1 bis 3)

- Beispielrate -Optionen: Mehrere Stichprobenraten: 8kHz, 16 kHz, 22,05 kHz, 24 kHz.

- Textvorverarbeitung: Good Normalisierung von Zahlen, Daten und gemischten Sprachen Textual content

- Sprachunterstützung: Unterstützung für 11 indische Sprachen mit BCP-47-Codes.

Wie kann ich über API auf Bulbul-V2 zugreifen?

Gehen Sie zu Beginn der Sarvam -Web site und klicken Sie mit Google auf Signal Signal:

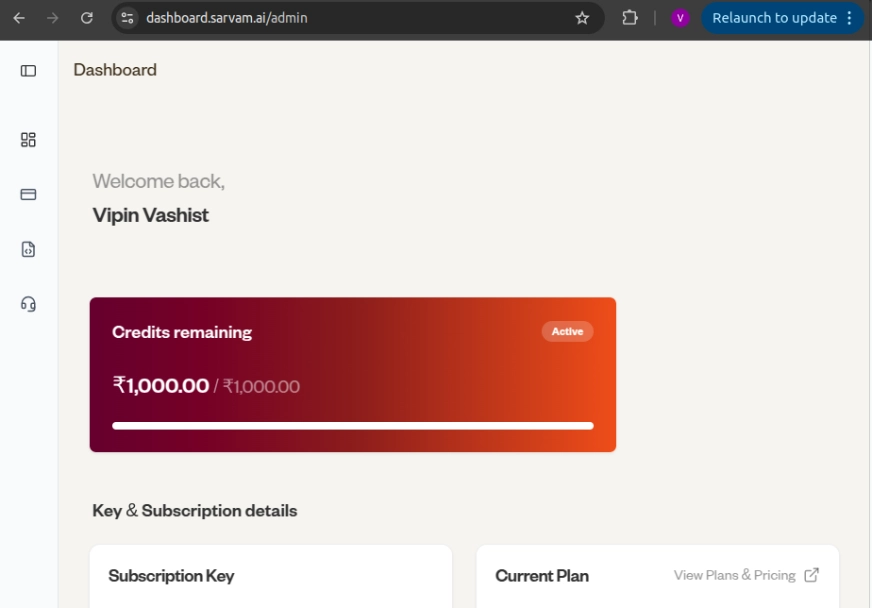

Wenn Sie jetzt unterschrieben haben, werden Sie zum Dashboard umgeleitet, wo Sie kostenlose Credit im Wert von INR 1000 erhalten.

Überprüfen Sie den Abschnitt „Abonnementschlüssel“, um den API -Schlüssel Ihres Sarvams zu kopieren.

Den ersten API -Anruf machen

1. Installieren der erforderlichen Bibliotheken

!pip set up sarvamai

from sarvamai import SarvamAI

from sarvamai.play import play

import base64- Sarvamai: Haupt -SDK -Klasse, die verwendet wurde, um mit der Sarvam -API zu interagieren.

- Paay: Eine Helferfunktion, die Audio in Ihrem System abspielt.

- Basis64: Das integrierte Modul von Python zur Dekodierung von Audio von Base64 (API gibt Audio auf diese Weise zurück).

2. Initialisieren des API -Purchasers

shopper = SarvamAI(

api_subscription_key="your_api_key"

)- Erstellt ein Sarvamai -Kundenobjekt.

3.. Textual content-to-Speech konvertieren

response = shopper.text_to_speech.convert(

inputs=("Welcome to Sarvam AI!"),

mannequin="bulbul:v2",

target_language_code="en-IN",

speaker="anushka",

pitch=0.5, # Vary: -1 to 1

tempo=1.0, # Vary: 0.3 to three

loudness=1.2, # Vary: 0.1 to three

speech_sample_rate=8000, # Choices: 8000, 16000, 22050, 24000

enable_preprocessing=True # Handles numbers, dates, and combined textual content

)

play(response)- Modell: Verwendet das Bulbul: V2 TTS -Modell.

- TARGE_LANGUAGE_CODE: Gibt Englisch (Indien) mit Akzent (EN-In) an.

- Pitch, Tempo, Lautstärke: Steuert den Ton, die Geschwindigkeit und das Volumen.

- Sprache_sample_rate: Wählt Audio -Beispielqualität. 8000 Hz ist einfach (Telefonieebene).

- enable_preprocessing: Wenn es zutrifft, wird die Eingabe automatisch (z. B. Daten/Zahlen) automatisch-normalisiert (z. B. Daten/Zahlen).

- Lautsprecher: Verwendet die vordefinierte Stimme „Anushka“. Weitere verfügbare Optionen sind:

4. Speichern der Ausgabe

audio_base64 = response.audios(0) # It is a str, base64-encoded

audio_bytes = base64.b64decode(audio_base64) # Decode to bytes

with open("output.wav", "wb") as f:

f.write(audio_bytes)- Nimmt das Basis64-kodierte Audio als Eingabe und dekodiert sie in Bytes.

- Speichert es als die Datei Ausgabe.WAV.

Lesen Sie auch: Mehrsprachige Textual content-zu-Sprache-Modelle für Indic-Sprachen

Bulbul-V2 in Aktion: Stimmen aus verschiedenen Sprachen

In diesem Abschnitt testen wir die Leistung von Bulbul-V2 bei drei Hauptaufgaben. Wie Sarvam sagt Ai, dass Bulbul-V2 natürliche, menschliche Stimmen mit regionalen Akzenten in 11 Sprachen liefert. Um dies zu testen, werden wir es überprüfen:

- Textual content zur Sprachumwandlung (in derselben Sprache (dh Punjabi zu Punjabi oder Hindi zu Hindi)

- Die nächsten 2 Aufgaben sind zu überprüfen

Aufgabe 1: Humorvoller TTS -Take a look at

Diese praktische Demo wird dazu beitragen, zu analysieren, wie intestine Bulbul-V2 den Klang und das Gefühl der indischen Sprachvielfalt erfasst. In dieser Aufgabe werde ich einen humorvollen Textual content an das TTS -Modell weitergeben und seine Antwort basierend auf seiner Antwort analysieren.

Eingabeaufforderung: ““ हाहा! मैंने पूछा, ‚तुम ठीक हो?‘ तो उसने जवाब दिया, ‚मुझे लगता है मुझे वाय हो गया है!‘ हेहे! “ हाहा! फिफि मेमेा प्िंटिंट हँसने लगा, औऔ माउस चिल्लाते हुए बोला, ‚फिफि से नहीं!‘ हेहेहे! सच में, लगता है मेमे गैजेट्स को मुझसे ज्यादा छुट्टी चाहिए। हाहा, ओह टेक्नोलॉजी! „

shopper = SarvamAI(

api_subscription_key="api_key" # Put your API key right here

)

response = shopper.text_to_speech.convert(

inputs=( immediate),

mannequin="bulbul:v2",

target_language_code="gu-IN",

speaker="karun", # pure and conversational

pitch=0.3,

tempo=1.0,

loudness=1.0,

speech_sample_rate=16000,

enable_preprocessing=True

)

play(response)

audio_base64 = response.audios(0)

audio_bytes = base64.b64decode(audio_base64)

with open("output_hindi.wav", "wb") as f:

f.write(audio_bytes)Ausgabe:

Analyse

In dieser Aufgabe haben wir eine lustige und humorvolle Aufforderung verwendet, um Bulbul-V2 zu testen. Das Modell sprach fließend und behandelte die Sprache intestine, es erfasste jedoch nicht den lustigen oder spielerischen Ton. Die Witze und das Lachen klangen flach und fehlten den ausdrucksstarken Teil. Insgesamt conflict die Klarheit intestine, aber die emotionale Lieferung braucht immer noch eine gewisse Verbesserung.

Aufgabe 2: Punjabi zur tamilischen Übersetzung

In dieser Aufgabe geben wir eine Punjabi -Eingabeaufforderung und bitten das Modell, es in Tamil zu ändern.

Eingabeaufforderung: ““ „“

from sarvamai import SarvamAI

from sarvamai.play import play

import base64

shopper = SarvamAI(

api_subscription_key="api_key" # Put your API key right here

)

response = shopper.text_to_speech.convert(

inputs=(immediate),

mannequin="bulbul:v2",

target_language_code="ta-IN",

speaker="manisha",

pitch=0.3,

tempo=1.0,

loudness=1.0,

speech_sample_rate=16000,

enable_preprocessing=True

)

play(response)

audio_base64 = response.audios(0)

audio_bytes = base64.b64decode(audio_base64)

with open("output_tamil.wav", "wb") as f:

f.write(audio_bytes)Ausgabe:

Analyse

Für diese Aufgabe habe ich eine Punjabi-Eingabeaufforderung zur Verfügung gestellt und Bulbul-V2 gebeten, tamilische Sprache zu erzeugen. Die Ausgabe beginnt jedoch mit Punjabi und beginnt dann plötzlich Tamil, anstatt eine reibungslose tamilische Reaktion zu geben. Dies zeigt, dass das Modell noch keine Übersetzung durchgeführt hat. Es liest nur die Eingabe, und infolgedessen fehlt es die Fähigkeit, in Tamilisch richtig zu übersetzen.

Aufgabe 3: Malayalam zur Übersetzung von Gujarati

In dieser Aufgabe geben wir eine Malayalam -Eingabeaufforderung und bitten das Modell, es in Gujarati zu ändern.

Immediate:“എന്താണ് ഇവർ ചിന്തിക്കുന്നത്? ഞാനൊരു മണിക്കൂർ കാത്തിരുന്നത്! ഇത് എല്ലാം സപ്പോർട്ട് ഇല്ലാത്തതാണ്! എന്താ സങ്കടം! അവർക്ക് അറിയാമോ എത്ര വണ്ണം ചെലവാക്കേണ്ടി വന്നിരിക്കുന്നു! ഇങ്ങനെ പോകുന്നത് എങ്ങിനെയാണ്? ഈ ലോകത്ത് ആരും എത്രയും നിശ്ചയിച്ച് തങ്ങളുടെയായി നടക്കുന്നു!“

from sarvamai import SarvamAI

from sarvamai.play import play

import base64

shopper = SarvamAI(

api_subscription_key="your_api_key" # Put your API key right here

)

response = shopper.text_to_speech.convert(

inputs=(immediate),

mannequin="bulbul:v2",

target_language_code="gu-IN",

speaker="abhilash",

pitch=0.3,

tempo=1.0,

loudness=1.0,

speech_sample_rate=16000,

enable_preprocessing=True

)

play(response)

audio_base64 = response.audios(0)

audio_bytes = base64.b64decode(audio_base64)

with open("output_gujrati.wav", "wb") as f:

f.write(audio_bytes)Ausgabe:

Analyse

Für diese Aufgabe habe ich eine Malayalam -Eingabeaufforderung zur Verfügung gestellt und das Modell gebeten, Gujarati -Rede zu generieren. Das Modell übersetzt jedoch die Eingabeaufforderung in Gujarati jedoch nicht. Stattdessen verleiht es ein reibungsloses Malayalam als Reaktion. Dies zeigt, dass das Modell noch keine Übersetzung durchgeführt hat. Für eine genaue Sprachumwandlung sollte ein externer Übersetzungsschritt enthalten sein, bevor der Textual content an TTS -Modi weitergegeben wird.

Gesamtleistung

| Aufgabe | Eingabesprache | Zielsprache | Wie intestine es funktioniert hat | Was ist passiert | Was ist als nächstes zu tun? |

| 1 | Lustige Aufforderung (Englisch) | Englisch | Intestine | Sprach klar und reibungslos, aber es fehlte Humor oder Lebendigkeit. | Verbessern Sie die Stimme, um Emotionen wie Lachen besser auszudrücken. |

| 2 | Punjabi | Tamil | Nicht intestine | Begann in Punjabi und wechselte plötzlich mitten in Tamil. | Verwenden Sie einen ordnungsgemäßen Übersetzungsdienst vor TTS. |

| 3 | Malayalam | Gujarati | Fehlgeschlagen | Die Ausgabe conflict noch in Malayalam; Es trat keine Übersetzung auf. | Übersetzen Sie den Textual content manuell, bevor Sie TTs verwenden. |

Muss lesen: GPT 4O vs indic llms – Wer wird den Sprachkrieg gewinnen?

Anwendungsfälle

Die schnellen und natürlichen Textual content-zu-Speech-Funktionen von Bulbul-V2 machen es in vielen Fällen in der realen Welt, in denen keine Umwandlung zwischen Sprache ist, nicht intestine. Hier sind einige praktische Beispiele, bei denen dies verwendet werden kann:

- Hilfstechnologie: TTS verwandelt Textual content für sehbehinderte Benutzer in Sprache. Bildschirmleser, die von dieser Artwork von Technologie betrieben werden, können den Benutzern ein natürliches und ansprechendes Erlebnis bieten. Daher können TTs nonverbale Personen helfen, zu kommunizieren.

- E-Studying und Inhaltserstellung: TTS-Modelle können verwendet werden, um Hörbücher, andere Bildungsmaterialien und Voice-Over für Movies herzustellen. Dies hilft beim Lernen ansprechender, da Einzelpersonen es in ihrer Muttersprache einsetzen können und es auch integrativer macht.

- Sprachübersetzung und Lokalisierung: Die TTS -Technologie unterstützt die Erstellung lokalisierter Inhalte. Es ermöglicht Echtzeitübersetzung für Anwendungen. Bulbul-V2 hat eine geringe Latenz, was es für Echtzeitanwendungen geeignet ist. Dazu gehören Konferenzinterpretation der Unterstützung und Reside -Interaktion des Kundendienstes. Bildungsplattformen können es auch nutzen, um Einzelpersonen zu helfen, ordnungsgemäß zu hören.

Bulbul-V2 gegen andere beliebte TTS-Modelle

Bulbul-V2 macht einen starken Eindruck im Bereich der TTS-Modelle, insbesondere für den indischen Markt. Der Hauptvorteil gegenüber anderen ist, dass es 11 indische einheimische Sprachen unterstützt, die die Mehrheit des indischen Subkontinents abdecken.

Beim Vergleich von Bulbul-V2 mit globalen Rivalen wie elfLabs. Der Bulbul-V2 zeichnet sich mit seiner schnellen Leistung mit der Lieferung von P90 in 0,398 Sekunden aus, was ungefähr doppelt so schnell ist wie elf Labs.

Bulbul-V2 bietet auch einen Parameter wie Kontrolle über Tonhöhe, Tempo, Lautstärke und Probenrate sowie eine intelligente Verarbeitung für Zahlen und Daten. Es ist nicht nur mit internationalen TTS -Führungskräften Schritt, sondern auch neue Benchmarks in Geschwindigkeit, Effizienz und Erschwinglichkeit.

Kasse: Andere beliebte Indikatore

Abschluss

Bulbul-V2 macht auf der Reise Indiens einen bedeutenden Sprung nach vorne, um ein eigenes LLM zu entwickeln, insbesondere im Bereich von Take a look at-to-Speech-Modellen, indem er schnelle, natürliche und regionale authentische Stimmen liefert. Seine außergewöhnliche Geschwindigkeit und Erschwinglichkeit machen es für eine Vielzahl von Anwendungen zugänglich und variieren von Hilfsmitteln bis hin zur Erstellung von Inhalten. Während es derzeit keine Unterstützung für die automatische Übersetzung zwischen Sprachen hat, kann dies durch Kombination von Bulbul-V2 mit externen Instruments wie Google Translate übertrieben werden. Mit fortlaufenden Verbesserungen der Ausdruckskraft und erweiterten Merkmalen, um ansprechendere Spracherlebnisse aufzubauen. Damit wird Bulbul-V2 eine Schlüsselrolle in der Zukunft der indischen KI spielen.

Melden Sie sich an, um weiter zu lesen und Experten-Kuratinhalte zu genießen.