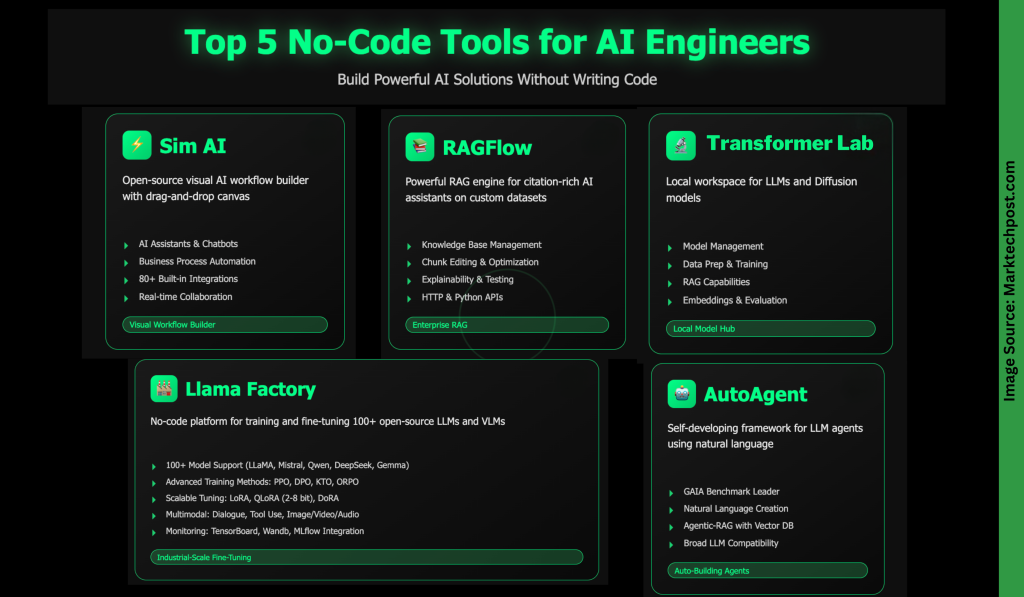

In der heutigen KI-gesteuerten Welt verändern No-Code-Instruments, wie Menschen intelligente Anwendungen erstellen und bereitstellen. Sie befähigen jeden – unabhängig von der Codierungsexpertise -, um schnell und effizient Lösungen zu erstellen. Diese Plattformen verkürzen die Entwicklungszeit und -anstrengung dramatisch, von der Entwicklung von Rag-Systemen für Unternehmensqualität bis hin zum Entwerfen von Workflows mit mehreren Agenten oder der Feinabstimmung von Hunderten von LLMs. In diesem Artikel werden wir fünf leistungsstarke No-Code-Instruments untersuchen, mit denen KI-Lösungen schneller und zugänglicher sind als je zuvor.

SIM AI ist eine Open-Supply-Plattform zum visuellen Erstellen und Bereitstellen von AI-Agenten-Workflows-keine Codierung erforderlich. Mit seiner Drag-and-Drop-Leinwand können Sie AI-Modelle, APIs, Datenbanken und Geschäftstools anschließen, um zu erstellen:

- AI -Assistenten und Chatbots: Agenten, die das Net durchsuchen, auf Kalender zugreifen, E -Mails senden und mit Geschäfts -Apps interagieren.

- Geschäftsprozessautomatisierung: Streamline -Aufgaben wie Dateneingabe, Erstellung von Berichten, Kundensupport und Inhaltsgenerierung.

- Datenverarbeitung und -analyse: Extrahieren Sie Erkenntnisse, analysieren Sie Datensätze, erstellen Sie Berichte und synchronisieren Sie Daten über Systeme hinweg.

- API -Integrations -Workflows: Orchestrieren Sie die komplexe Logik, vereinigen Sie Dienste und verwalten Sie eine ereignisgesteuerte Automatisierung.

Schlüsselmerkmale:

- Visuelle Leinwand mit „intelligenten Blöcken“ (KI, API, Logik, Ausgabe).

- Mehrere Auslöser (Chat, Relaxation -API, Webhooks, Scheduler, Slack/Github -Ereignisse).

- Zusammenarbeit in Echtzeit-Staff mit der Kontrolle der Berechtigungen.

- 80+ integrierte Integrationen (KI-Modelle, Kommunikationstools, Produktivitäts-Apps, Entwicklerplattformen, Suchdienste und Datenbanken).

- MCP -Unterstützung für benutzerdefinierte Integrationen.

Bereitstellungsoptionen:

- Cloud-gehostete (verwaltete Infrastruktur mit Skalierung und Überwachung).

- Selbst gehostet (über Docker, mit lokaler Modellunterstützung für Datenschutz).

Ragflow ist eine leistungsstarke Abruf-Era (RAG) -Motor, mit der Sie geerdete, zitierreiche KI-Assistenten auf Ihren eigenen Datensätzen bauen können. Es läuft auf X86 -CPUs oder NVIDIA -GPUs (mit optionalen ARM -Builds) und bietet vollständige oder schlanke Docker -Bilder für die schnelle Bereitstellung. Nachdem Sie einen lokalen Server ausgedrückt haben, können Sie eine LLM-VIA-API oder lokale Laufzeiten wie Ollama-anschließen, um Chat-, Einbettungs- oder Bild-zu-Textual content-Aufgaben zu erledigen. Ragflow unterstützt die beliebtesten Sprachmodelle und ermöglicht es Ihnen, Standardeinstellungen festzulegen oder Modelle für jeden Assistenten anzupassen.

Zu den wichtigsten Funktionen gehören:

- Wissensbasismanagement: Laden und analysieren Sie Dateien (PDF, Phrase, CSV, Bilder, Folien und mehr) in Datensätze, wählen Sie ein Einbettungsmodell aus und organisieren Sie Inhalte für ein effizientes Abrufen.

- Chunk -Bearbeitung und -Optimierung: Überprüfen Sie Parsen -Stücke, fügen Sie Key phrases hinzu oder passen Sie Inhalte manuell an, um die Suchgenauigkeit zu verbessern.

- KI -Chat -Assistenten: Erstellen Sie Chats, die mit einem oder mehreren Wissensbasen verknüpft sind, Fallback-Antworten und Feinabstiegsanforderungen oder Modelleinstellungen konfigurieren.

- Erklärung und Assessments: Verwenden Sie integrierte Instruments, um die Qualität der Abruf zu validieren, die Leistung zu überwachen und Echtzeitzitate anzusehen.

- Integration und Erweiterbarkeit: Nutzen Sie HTTP- und Python -APIs für die App -Integration mit einer optionalen Sandbox für eine sichere Codeausführung in Chats.

Transformator Lab ist ein kostenloser Open-Supply-Arbeitsbereich für Großsprachenmodelle (LLMs) und Diffusionsmodelle, die auf Ihrer lokalen Maschine ausgeführt wurden-ob es sich um eine GPU-, TPU- oder Apple M-Serie-Mac handelt. Es ermöglicht es Ihnen, LLMs herunterzuladen, zu chatten und zu bewerten, Bilder mithilfe von Diffusionsmodellen zu generieren und Einbettungen aus einer flexiblen Umgebung zu berechnen.

Zu den wichtigsten Funktionen gehören:

- Modellmanagement: Laden Sie LLMs herunter und interagieren Sie sie oder generieren Sie Bilder mit hochmodernen Diffusionsmodellen.

- Datenvorbereitung und Schulung: Erstellen Sie Modelle für Datensätze, Feinhilfen oder Zug, einschließlich der Unterstützung für RLHF und Präferenzabstimmung.

- REMAINAL-AUGENTED-Era (LAG): Verwenden Sie Ihre eigenen Dokumente, um intelligente, geerdete Gespräche zu führen.

- Einbettung und Bewertung: Berechnen Sie die Einbettung und bewerten Sie die Modellleistung über verschiedene Inferenzmotoren hinweg.

- Erweiterbarkeit & Neighborhood: Erstellen Sie Plugins, tragen Sie zur Kernanwendung bei und arbeiten Sie über die aktive Discord -Neighborhood zusammen.

Lama-Manufacturing unit ist eine leistungsstarke Plattform ohne Code für das Coaching und die Feinabstimmung von Open-Supply-Modellen (Language Fashions) und Imaginative and prescient-Sprage-Modellen (VLMs). Es unterstützt über 100 Modelle, multimodale Feinabstimmungen, erweiterte Optimierungsalgorithmen und skalierbare Ressourcenkonfigurationen. Es wurde für Forscher und Praktiker entwickelt und bietet umfangreiche Werkzeuge für die Voraussetzungs-, Überwachungsmethoden für Feinabstimmungen, Belohnungsmodellierung und Verstärkungslernmethoden wie PPO und DPO-zusammen mit einfachem Experiment-Monitoring und einer schnelleren Inferenz.

Zu den wichtigsten Highlights gehören:

- Breite Modellunterstützung: Arbeitet mit Lama, Mistral, Qwen, Deepseek, Gemma, Chatglm, Phi, Yi, Mixtral-Moe und vielen anderen.

- Trainingsmethoden: Unterstützt kontinuierliche Vorausbildung, multimodale SFT, Belohnungsmodellierung, PPO, DPO, KTO, Orpo und mehr.

- Skalierbare Abstimmungsoptionen: Vollstimming, Gefrierabbau, Lora, Qlora (2–8 Bit), Ofl, Dora und andere ressourceneffiziente Techniken.

- Erweiterte Algorithmen und Optimierungen: Enthält Galore, Badam, Apollo, Myon, Flashattention-2, Seilskalierung, Neftune, Rslora und andere.

- Aufgaben und Modalitäten: Griff Dialog, Werkzeuggebrauch, Bild/Video/Audioverständnis, visuelle Erdung und mehr.

- Überwachung und Inferenz: Integriert sich in Llamaboard, Tensorboard, Wandb, Mlflow und Swanlab sowie eine schnelle Folgerung über OpenAI-APIs, Gradio UI oder CLI mit VllM/Sglang-Arbeitern.

- Versatile Infrastruktur: Kompatibel mit Pytorch, umarmenden Gesichtstransformatoren, Deepspeed, BitsandBytes und unterstützt beide CPU/GPU-Setups mit speichereffizienter Quantisierung.

Autoagent ist ein vollständig automatisiertes, selbstentwickeltes Framework, mit dem Sie LLM-Antriebsmittel nur mit natürlicher Sprache erstellen und bereitstellen können. Entwickelt, um komplexe Workflows zu vereinfachen, können Sie intelligente Instruments und Assistenten erstellen, anpassen und ausführen, ohne eine einzelne Codezeile zu schreiben.

Zu den wichtigsten Funktionen gehören:

- Hohe Leistung: Erzielt erstklassige Ergebnisse auf dem Gaia-Benchmark und konkurrieren mit fortgeschrittenen Deep Analysis Brokers.

- Mühelose Agent- und Workflow -Erstellung: Erstellen Sie Werkzeuge, Agenten und Workflows durch einfache natürliche Sprache – keine Codierung erforderlich.

- Agentenrang mit nationaler Vektordatenbank: Kommt mit einer Selbstverwaltungs-Vektor-Datenbank und bietet im Vergleich zu herkömmlichen Lösungen wie Langchain überlegene Abruf.

- Breite LLM -Kompatibilität: Integriert nahtlos in führende Modelle wie OpenAI, Anthropic, Deepseek, Vllm, Grok, Umarmung und mehr.

- Versatile Interaktionsmodi: Unterstützt sowohl Funktionen für Funktionen als auch React-Stil für vielseitige Anwendungsfälle.

Leicht und erweiterbar: Ein dynamischer persönlicher KI-Assistent, der sich leicht anpassen und ausdehnen und gleichzeitig ressourceneffizient bleibt.