Haben Sie jemals gedacht, dass Sie einen mächtigen KI -Assistenten in Ihrer Tasche halten könnten? Nicht nur eine App, sondern auch eine erweiterte Intelligenz-, konfigurierbare, non-public und leistungsstarke AI-Sprachmodell? Treffen Gemma 3n. Dies ist nicht nur eine weitere Tech -Modeerscheinung. Es geht darum, ein Hochleistungs-Sprachmodell direkt in die Hände in Ihr Telefon zu legen. Egal, ob Sie Weblog -Ideen im Zug entwickeln, Nachrichten übersetzt oder einfach nur die Zukunft von AI miterleben, Gemma 3n bietet Ihnen eine bemerkenswert einfache und äußerst unterhaltsame Erfahrung. Lassen Sie uns einspringen und sehen, wie Sie die gesamte KI -Magie Schritt für Schritt auf Ihrem mobilen Gerät erfolgen können.

Was ist Gemma 3n?

Gemma 3n ist Mitglied von Google’s Gemma -Familie von offenen Modellen; Es ist so konzipiert, dass es auf Geräten mit niedrigresserner Ressourcen wie Smartphones intestine laufen kann. Mit rund 3 Milliarden Parametern stellt Gemma 3n eine starke Kombination zwischen Fähigkeit und Effizienz auf und ist eine gute Choice für die KI-Arbeit in Sensible Assistants, Textverarbeitung und mehr.

Gemma 3n Efficiency und Benchmark

Gemma 3n, die auf Geschwindigkeit und Effizienz auf Geräten mit niedrigem Ressourcen ausgelegt ist, ist eine aktuelle Ergänzung der Familie von Googles offenen Großsprachenmodellen, die ausdrücklich für Mobilfunk-, Pill- und andere Kantenhardware entwickelt wurden. Hier finden Sie eine kurze Bewertung der realen Leistung und den Benchmarks:

Modellgrößen und Systemanforderungen

- Modellgrößen: E2B (5B -Parameter, effektiver Speicher und effektiv 2B) und E4B (8B -Parameter, effektiver Speicher und effektiver 4B).

- RAM erforderlich: E2B läuft nur auf 2 GB RAM; E4B benötigt nur 3 GB RAM – intestine im Bereich der meisten modernen Smartphones und Tablets.

Geschwindigkeit & Latenz

- Reaktionsgeschwindigkeit: Bis zu 1,5-fach schneller als frühere On-Machine-Modelle für die Erzeugung der ersten Reaktion, beträgt der Durchsatz in der Regel 60 bis 70 Token/Sekunde bei den jüngsten mobilen Prozessoren.

- Startup & Inferenz: Time-to-First-Token ermöglicht es nur 0,3 Sekunden, dass Chat- und Assistenzanwendungen ein sehr reaktionsschnelles Erlebnis bieten können.

Benchmark -Ergebnisse

- Larena Rangliste: E4B ist das erste Sub-10B-Parametermodell, das eine Punktzahl von 1300+ übertroffen hat und die lokale Modelle mit ähnlichen Größe über verschiedene Aufgaben übertrifft.

- MMLU -Punktzahl: Gemma 3n E4B erreicht ~ 48,8% (repräsentiert ein solides Denken und allgemeines Wissen).

- Intelligenzindex: Ungefähr 28 für E4B, wettbewerbsfähig unter allen lokalen Modellen unter der Parametergröße von 10B.

Qualitäts- und Effizienzinnovationen

- Quantisierung: Unterstützt sowohl 4-Bit- als auch 8-Bit-quantisierte Versionen mit minimalem Qualitätsverlust und kann auf Geräten mit nur 2-3 GB RAM ausgeführt werden.

- Multimodal: Das E4B-Modell kann Textual content, Bilder, Audio und sogar kurze Video-On-Machine verarbeiten-enthält das Kontextfenster von bis zu 32.000 Token (weit über den meisten Konkurrenten in seiner Größenklasse).

- Optimierungen: Nutzt mehrere Techniken wie die Ausbettung (PLE) professional Schicht, die selektive Aktivierung von Parametern, und verwendet Matformer, um die Geschwindigkeit zu maximieren, den RAM-Fußabdruck zu minimieren und eine gute Qualitätsausgabe zu erzeugen, obwohl sie einen kleineren Fußabdruck haben.

Was sind die Vorteile von Gemma 3n auf Mobilgeräte?

- Privatsphäre: Alles läuft vor Ort, sodass Ihre Daten privat gehalten werden.

- Geschwindigkeit: Die Verarbeitung von Einrichtungen bedeutet bessere Reaktionszeiten.

- Web nicht erforderlich: Cellular bietet viele Funktionen, auch wenn keine aktive Internetverbindung vorhanden ist.

- Anpassung: Kombinieren Sie Gemma 3n mit Ihren gewünschten mobilen Apps oder Workflows.

Voraussetzungen

Ein modernes Smartphone (Android oder iOS) mit ausreichend Speicher und mindestens 6 GB RAM, um die Leistung zu verbessern. Einige Grundkenntnisse über die Set up und Verwendung mobiler Anwendungen.

Schritt-für-Schritt-Anleitung zum Ausführen von Gemma 3n auf dem Useful

Schritt 1: Wählen Sie die entsprechende Anwendung oder das entsprechende Framework aus

Mehrere Apps und Frameworks können das Ausführen von großsprachigen Modellen wie Gemma 3N auf mobilen Geräten unterstützen, darunter:

- LM Studio: Eine beliebte Anwendung, die Modelle lokal über eine einfache Schnittstelle ausführen kann.

- MLC -Chat (MLC LLM): Eine Open-Supply-Anwendung, die die lokale LLM-Inferenz sowohl auf Android als auch auf iOS ermöglicht.

- Ollama Cellular: Wenn es Ihre Plattform unterstützt.

- Benutzerdefinierte Apps: Mit einigen Apps können Sie Modelle laden und öffnen. (zB, umarme Apps von Face -Transformers für Mobilgeräte).

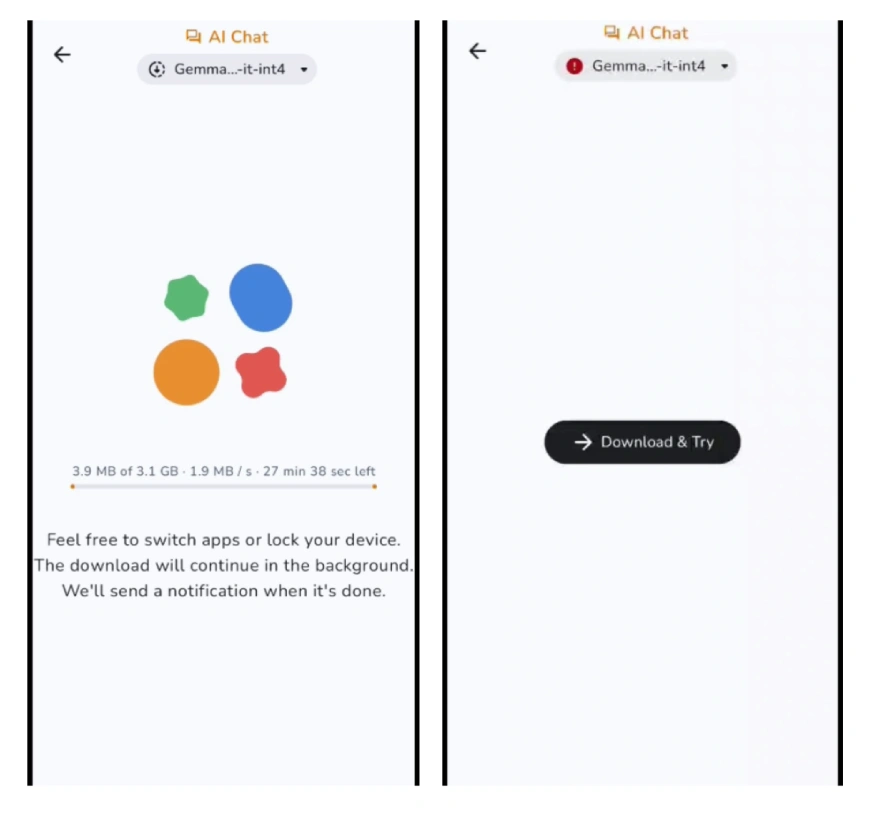

Schritt 2: Laden Sie das Gemma 3N -Modell herunter

Sie können es finden, indem Sie in den Modellrepositories wie Hugging Face nach „Gemma 3n“ suchen, oder Sie können bei Google in Google suchen und das AI -Modell von Google direkt finden.

Notiz: Wählen Sie sicher, dass Sie die quantisierte (Ex-, 4-Bit- oder 8-Bit) -Model für Mobilgeräte auswählen, um Platz und Speicher zu sparen.

Schritt 3: Importieren des Modells in Ihre cell App

- Starten Sie nun Ihre LLM -App (Ex., LM Studio, MLC -Chat).

- Klicken Sie auf die Schaltfläche „Importieren“ oder „Modell hinzufügen“.

- Suchen Sie dann in die von Ihnen heruntergeladene Gemma 3N -Modelldatei und importieren Sie sie.

Notiz: Die App kann Sie durch zusätzliche Optimierungen oder Quantisierung führen, um die cell Funktion sicherzustellen.

Schritt 4: Einstellungsmodelleinstellungen

Konfigurieren Sie Optionen für die Leistung im Vergleich zur Genauigkeit (niedrigere Quantisierung = schneller, höhere Quantisierung = bessere Ausgabe, langsamer). Erstellen Sie, falls gewünschte, schnelle Vorlagen, Konversationen, Integrationen usw.

Schritt 5: Jetzt können wir mit Gemma 3n beginnen

Verwenden Sie die Chat oder die Eingabeaufforderung, um mit dem Modell zu kommunizieren. Fühlen Sie sich frei, Fragen zu stellen, Textual content zu generieren oder sie als Autor/Coder -Assistent entsprechend Ihren Vorlieben zu verwenden.

Vorschläge, um die besten Ergebnisse zu erzielen

- Schließen Sie Hintergrundprogramme, um Systemressourcen zu recyceln.

- Verwenden Sie die neueste Model Ihrer App für die beste Leistung.

- Passen Sie die Einstellungen an, um ein akzeptables Leistungsbilanz für Qualität entsprechend Ihren Anforderungen zu finden.

Mögliche Verwendungen

- Entwerfen Sie non-public E -Mails und Nachrichten.

- Übersetzung und Zusammenfassung in Echtzeit.

- Hilfsmittel für Entwickler.

- Brainstorming -Ideen, Geschichten oder Weblog -Inhalte während der Zeit.

Lesen Sie auch: Erstellen Sie KI-Agenten mit No-Code auf Ihrem Telefon kostenlos mit der mobilen App Repit!

Abschluss

Bei der Verwendung von Gemma 3n auf einem mobilen Gerät gibt es keinen Mangel an potenziellen Anwendungsfällen für erweiterte künstliche Intelligenz direkt in Ihrer Tasche, ohne die Privatsphäre und Bequemlichkeit zu beeinträchtigen. Egal, ob Sie ein gelegentlicher Benutzer von KI -Technologien mit ein wenig Neugier, einem vielbeschäftigten Fachmann sind, der nach Produktivitätssteigerungen sucht, oder ein Entwickler mit Interesse an Experimenten, Gemma 3n bietet jede Möglichkeit, Technologie zu erkunden und zu personalisieren. Mit vielen Möglichkeiten zu Innovationen werden Sie neue Möglichkeiten entdecken, Aktivitäten zu optimieren, neue Erkenntnisse auszulösen und Verbindungen ohne Internetverbindung aufzubauen. Probieren Sie es aus und sehen Sie, wie viel KI Ihren Alltag unterstützen kann, und sein immer unterwegs!

Melden Sie sich an, um weiter zu lesen und Experten-Kuratinhalte zu genießen.