Wir haben gerade von ControlNet erfahren. Lassen Sie uns nun herausfinden, wie Sie Ihren Charakter am effektivsten anhand der menschlichen Pose steuern können. OpenPose ist ein großartiges Instrument, das Körperstellen in Bildern und Movies erkennen kann. Durch die Integration von OpenPose mit Steady Diffusion können wir die KI bei der Generierung von Bildern unterstützen, die zu bestimmten Posen passen.

In diesem Beitrag erfahren Sie mehr über OpenPose von ControlNet und wie Sie damit ähnliche Posenzeichen generieren können. Im Einzelnen werden wir Folgendes behandeln:

- Was ist Openpose und wie funktioniert es?

- So verwenden Sie ControlNet Hugging Face Areas, um mithilfe des Referenzbilds präzise Bilder zu generieren.

- So richten Sie OpenPose in der Steady Diffusion WebUI ein und verwenden es zum Erstellen hochwertiger Bilder.

- Verschiedene OpenPose-Prozessoren konzentrieren sich auf bestimmte Körperteile.

Lass uns anfangen.

Verwendung von OpenPose mit stabiler Diffusion

Foto von motor akyurt. Einige Rechte vorbehalten.

Überblick

Dieser Beitrag besteht aus vier Teilen; sie sind:

- Was ist ControlNet OpenPose?

- ControlNet im Hugging Face House

- OpenPose-Editor in der Steady Diffusion-Internet-Benutzeroberfläche

- Bild-zu-Bild-Generierung

Was ist ControlNet OpenPose?

OpenPose ist ein Deep-Studying-Modell zur Erkennung der menschlichen Pose anhand eines Bildes. Seine Ausgabe sind die Positionen mehrerer Schlüsselpunkte (wie Ellbogen, Handgelenke und Knie) des Menschen auf dem Bild. Das OpenPose-Modell in ControlNet akzeptiert die Schlüsselpunkte als zusätzliche Konditionierung des Diffusionsmodells und erzeugt das Ausgabebild, wobei der Mensch an diesen Schlüsselpunkten ausgerichtet ist. Sobald Sie die genaue Place von Schlüsselpunkten angeben können, können Sie realistische Bilder menschlicher Posen basierend auf einem Skelettbild erstellen. Sie können damit künstlerische Fotos, Animationen oder Illustrationen verschiedener Posen erstellen.

ControlNet in umarmenden Gesichtsräumen

Um die Leistungsfähigkeit des ControlNet OpenPose-Modells auszuprobieren, können Sie die kostenlose On-line-Demo zu Hugging Face Areas nutzen:

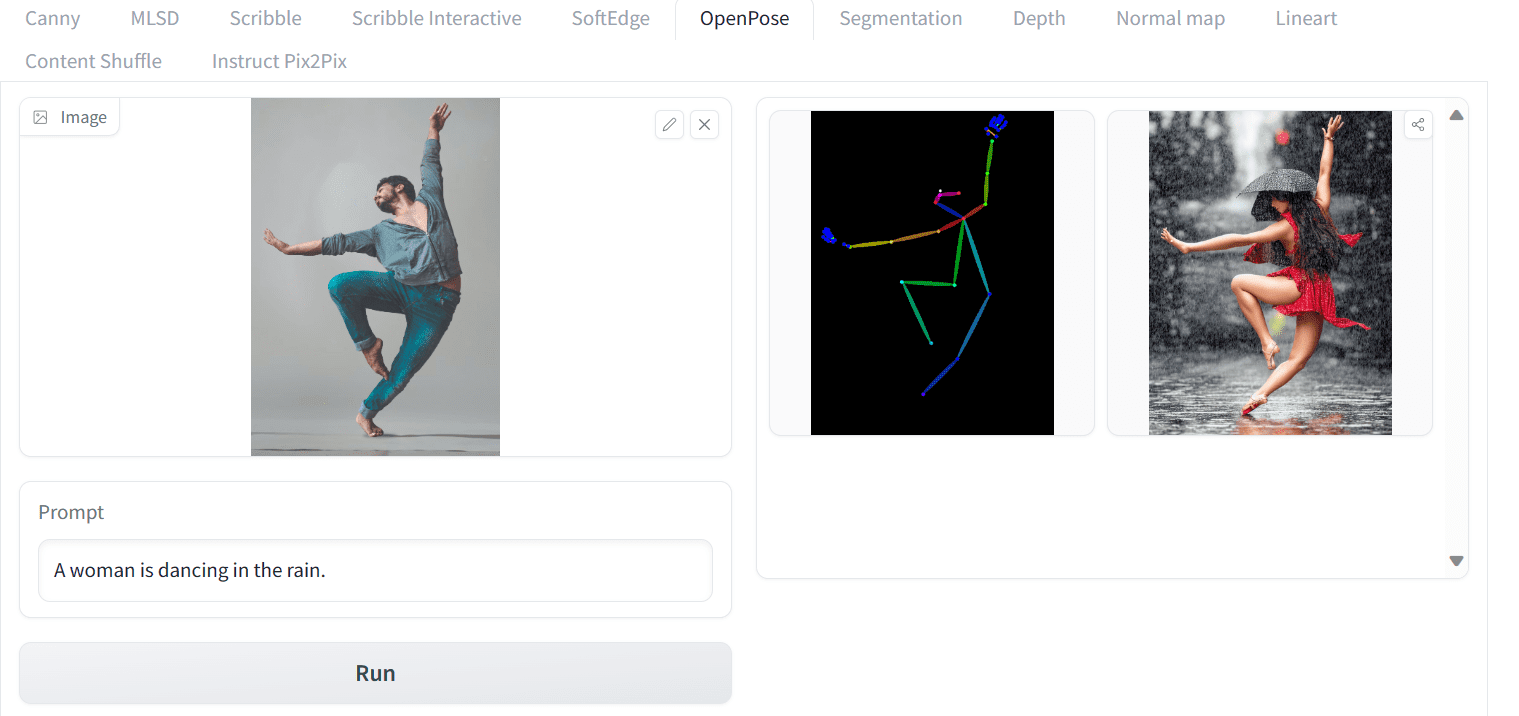

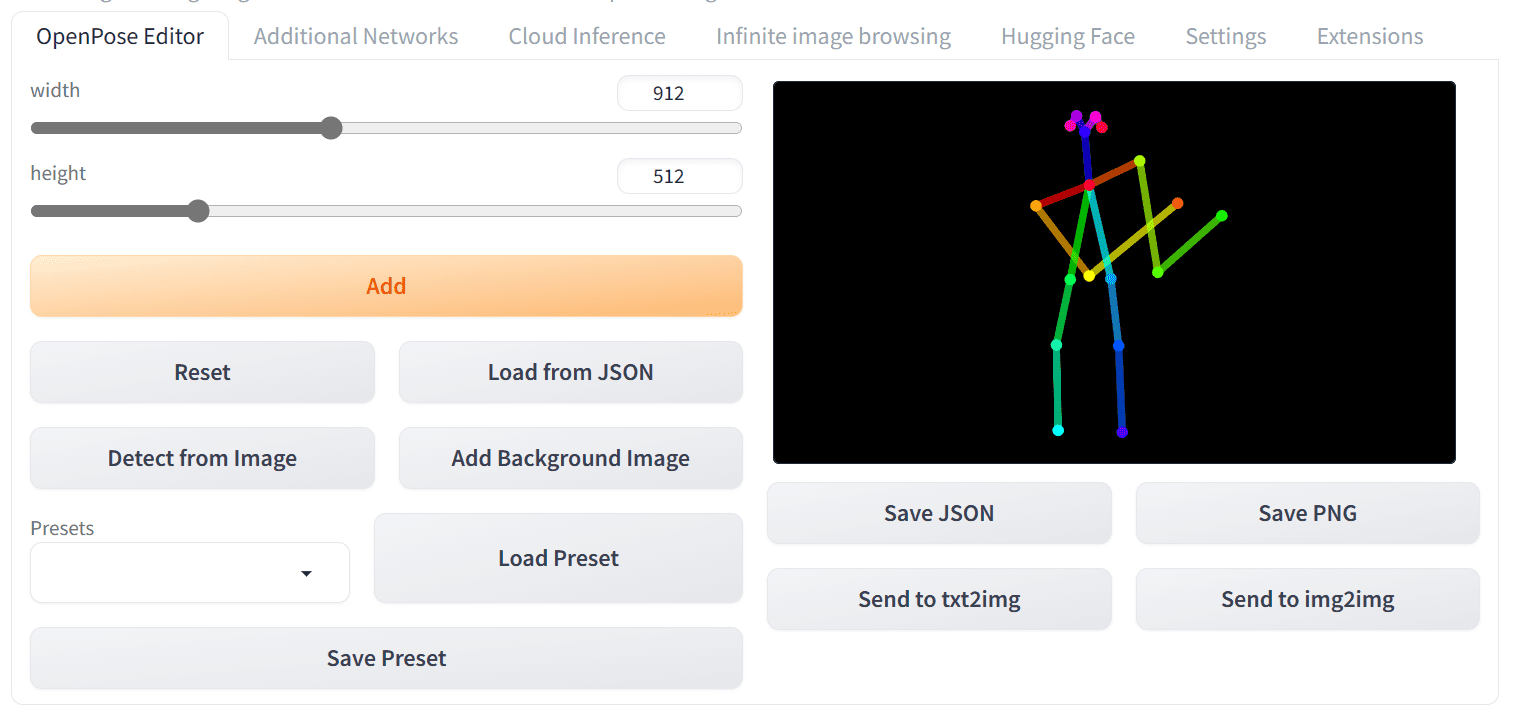

Zunächst müssen Sie die Posenschlüsselpunkte erstellen. Dies kann ganz einfach erfolgen, indem Sie ein Bild hochladen und das OpenPose-Modell diese erkennen lassen. Zuerst können Sie herunterladen Yogendra SinghErstellen Sie ein Foto und laden Sie es dann in die ControlNet Areas hoch. Dieses ControlNet hilft Ihnen, die Pose festzulegen, Sie müssen jedoch immer noch eine Textaufforderung bereitstellen, um ein Bild zu generieren. Schreiben wir die einfache Aufforderung „Eine Frau tanzt im Regen.“ und drücken Sie die Run-Style.

Verwendung des OpenPose ControlNet-Modells zum Umarmen von Gesichtsräumen

Aufgrund der zufälligen Natur der Bildgenerierung möchten Sie möglicherweise mehrere Versuche durchführen. Sie können die Eingabeaufforderung auch aufpolieren, um weitere Particulars anzugeben, z. B. die Beleuchtung, die Szene und das Outfit, das die Frau trägt. Sie können den Bereich „Erweiterte Optionen“ unten sogar erweitern, um weitere Einstellungen bereitzustellen, z. B. unfavourable Eingabeaufforderungen.

Einstellungen im Bereich „Erweiterte Optionen“.

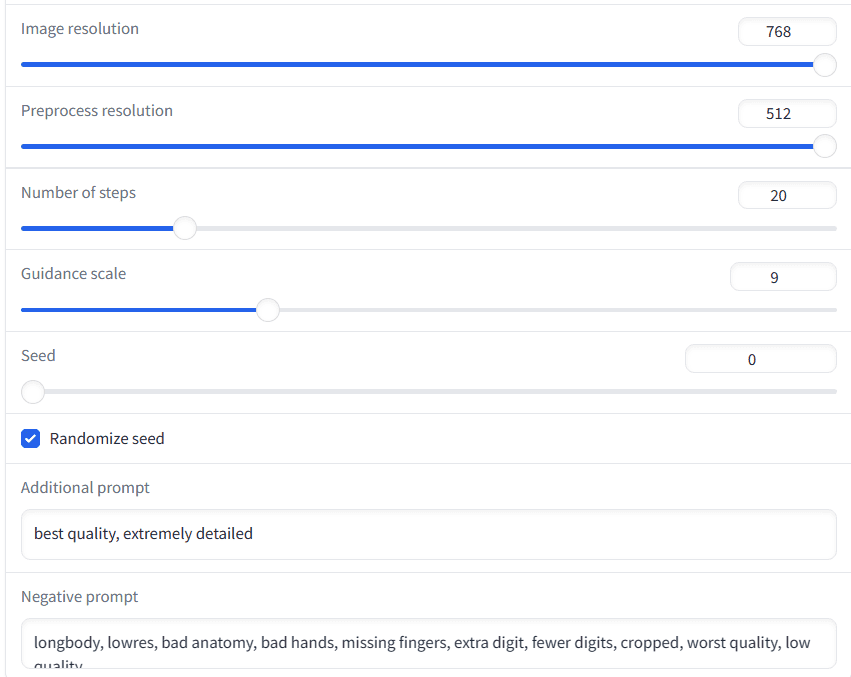

Im obigen Beispiel können Sie sehen, dass aus einem Skelettbild ein hochwertiges Bild einer im Regen tanzenden Frau in einer ähnlichen Pose wie Ihr hochgeladenes Bild erstellt wird. Unten sind drei weitere Generationen unter derselben Aufforderung aufgeführt. Alle sind außergewöhnlich und folgen genau der Pose des Referenzbilds.

Andere generierte Bilder aus derselben Eingabeaufforderung

OpenPose-Editor über die Steady Diffusion-Internet-Benutzeroberfläche

Sie können das OpenPose ControlNet-Modell auch über die Steady Diffusion-Internet-Benutzeroberfläche verwenden. Tatsächlich können Sie nicht nur ein Bild hochladen, um die Pose zu erhalten, sondern Sie können die Pose auch bearbeiten, bevor Sie sie auf das Diffusionsmodell anwenden. In diesem Abschnitt erfahren Sie, wie Sie OpenPose lokal einrichten und Bilder mit dem OpenPose Editor generieren.

Bevor Sie den OpenPose-Editor verwenden können, müssen Sie ihn installieren und die Modelldatei herunterladen.

- Stellen Sie sicher, dass Sie die ControlNet-Erweiterung installiert haben. Wenn nicht, lesen Sie bitte den vorherigen Beitrag.

- Installieren Sie die OpenPose Editor-Erweiterung: Klicken Sie auf der Registerkarte „Erweiterungen“ der WebUI auf „Von URL installieren“ und geben Sie zur Set up die folgende URL ein:

- https://github.com/fkunn1326/openpose-editor

- Gehen Sie zum Hugging Face-Repository: https://hf.co/lllyasviel/ControlNet-v1-1/tree/predominant

- Laden Sie das OpenPose-Modell herunter „control_v11p_sd15_openpose.pth”

- Legen Sie die Modelldatei im SD-WebUI-Verzeichnis ab

stabile-diffusion-webui/extensions/sd-webui-controlnet/fashions oder

stabile-diffusion-webui/fashions/ControlNet

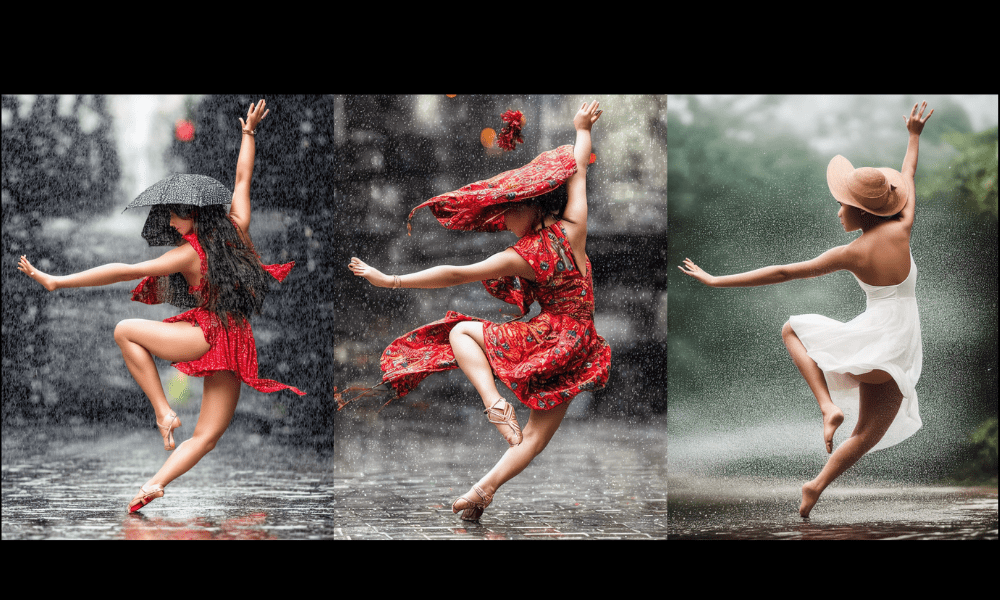

Nachdem Sie nun alles eingerichtet haben, wird der Internet-Benutzeroberfläche eine neue Registerkarte mit dem Namen „OpenPose Editor“ hinzugefügt. Navigieren Sie zur Registerkarte „OpenPose Editor“ und passen Sie die Breite und Höhe der Leinwand nach Ihren Wünschen an. Als nächstes können Sie mit der Maus beginnen, das Skelettbild auf der rechten Seite zu ändern. Es ist ein unkomplizierter Prozess.

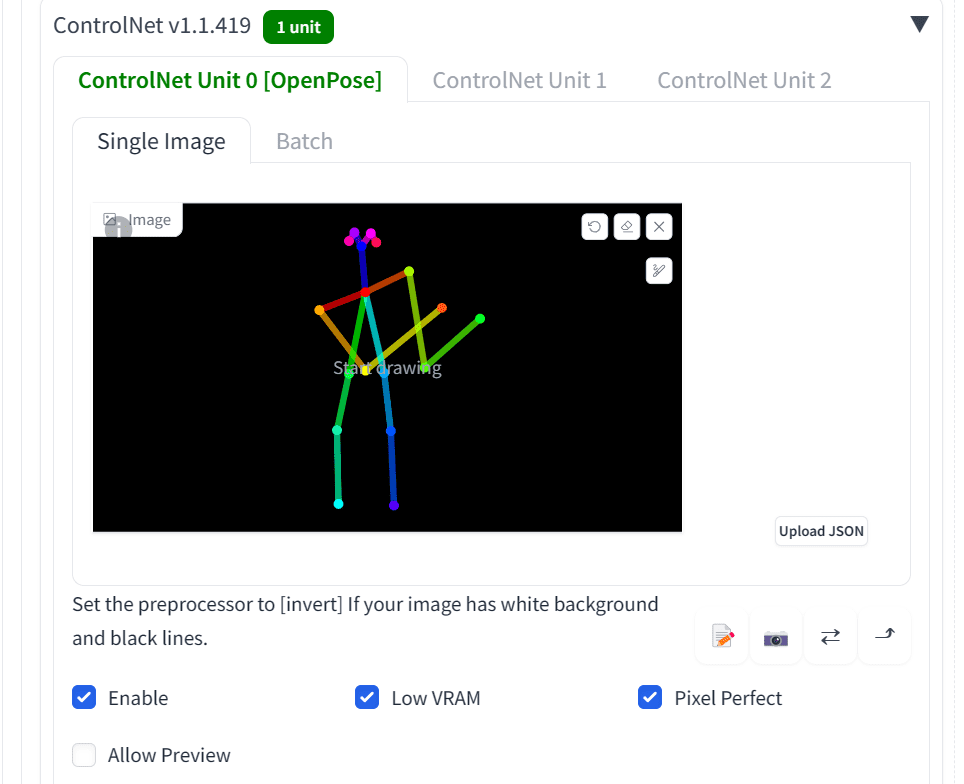

Versuchen wir, ein Bild von einem Mann zu erstellen, der eine große Waffe trägt. Sie können Änderungen am Skelettbild vornehmen, damit es wie folgt aussieht:

Erstellen einer Pose mit dem OpenPose Editor

Klicken Sie dann auf die Schaltfläche „An text2img senden“. Sie gelangen zu text2img mit dem dem ControlNet-Bedienfeld hinzugefügten Skelettbild.

Die erstellte Pose im ControlNet-Bedienfeld

Wählen Sie dann „Aktivieren“ für dieses ControlNet-Modell und stellen Sie sicher, dass die Possibility „OpenPose“ aktiviert ist. Sie können auch „Low VRAM“ und „Pixel Good“ aktivieren. Ersteres ist nützlich, wenn Ihr Pc nicht über genügend Speicher auf der GPU verfügt, und letzteres besteht darin, das ControlNet-Modell aufzufordern, die optimale Auflösung entsprechend der Ausgabe zu verwenden.

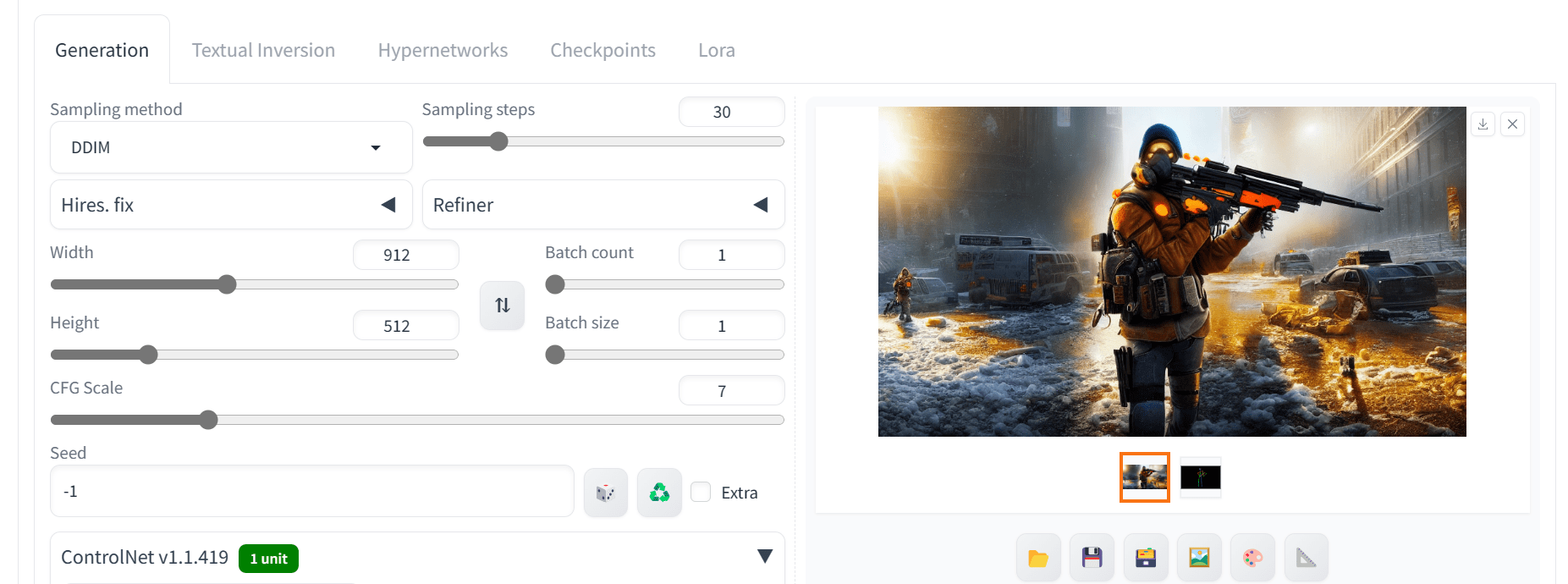

Als Nächstes richten Sie die constructive und unfavourable Eingabeaufforderung ein und nehmen Änderungen an der Größe des Ausgabebilds, der Sampling-Methode und den Sampling-Schritten vor. Die constructive Aufforderung kann zum Beispiel sein

detailliert, Meisterwerk, beste Qualität, erstaunlich, bezaubernd, beeindruckend, Tom Clancy’s the Division, man_holding_gun, us_marine, Strandhintergrund

und die unfavourable Aufforderung kann sein

schlechteste Qualität, niedrige Qualität, niedrige Auflösung, Monochrom, Graustufen, mehrere Ansichten, Comedian, Skizze, schlechte Anatomie, deformiert, entstellt, Wasserzeichen, mehrere Ansichten, Mutationshände, Wasserzeichen, schlechte Gesichtsbehandlung

Es stellte sich heraus, dass das Bild unten mit der Größe 912×512 und dem Sampler DDIM für 30 Schritte perfekt zur ähnlichen Pose passte und gute Particulars aufweist.

Ausgabe mit dem OpenPose ControlNet-Modell

Bild-zu-Bild-Generierung

Wenn Sie das ControlNet-Modell in der Internet-Benutzeroberfläche ausprobiert haben, sollten Sie feststellen, dass es mehrere OpenPose-Präprozessoren gibt. Im Folgenden wollen wir einige davon untersuchen, um uns auf das Gesicht und den Oberkörper zu konzentrieren.

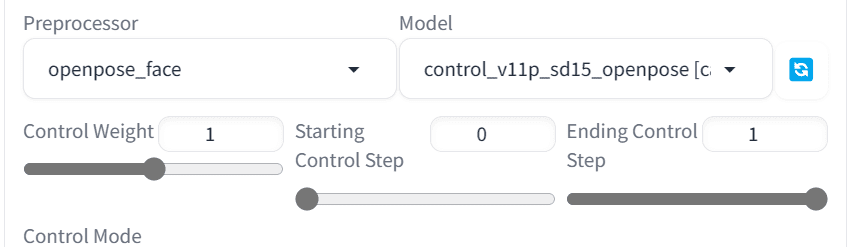

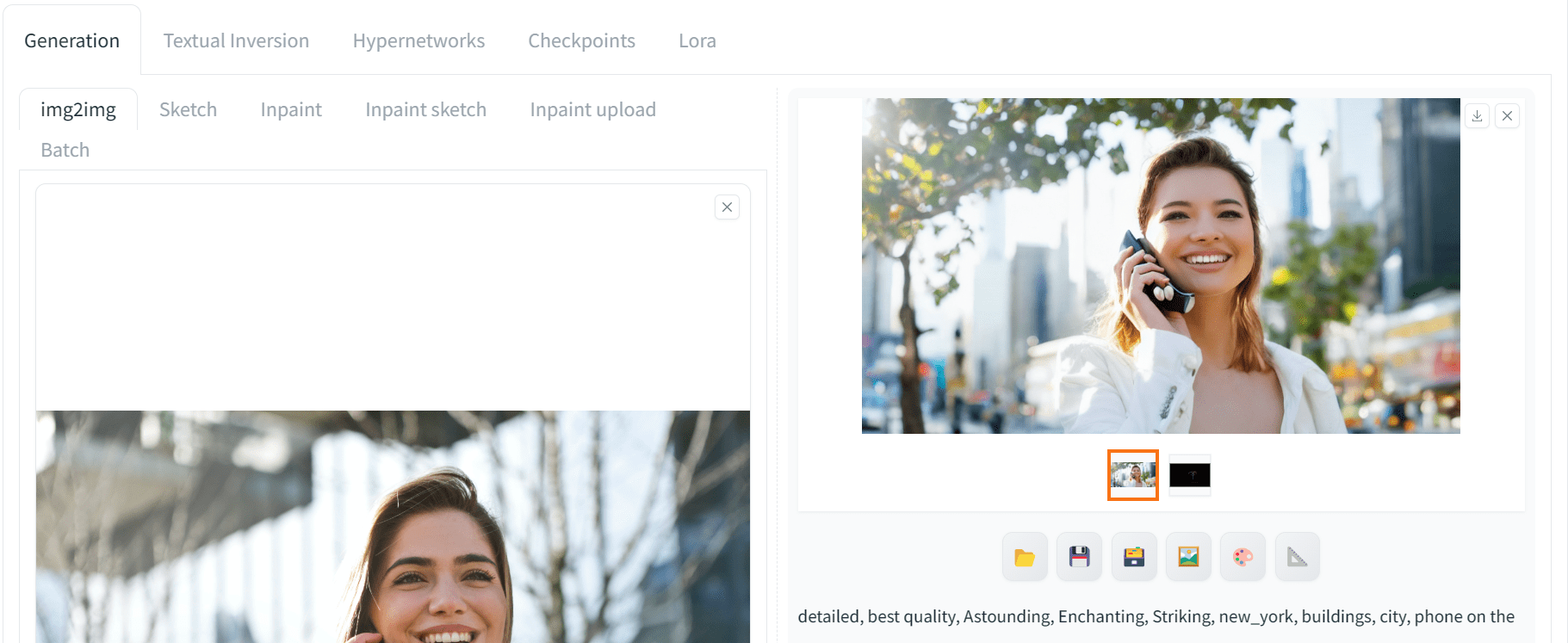

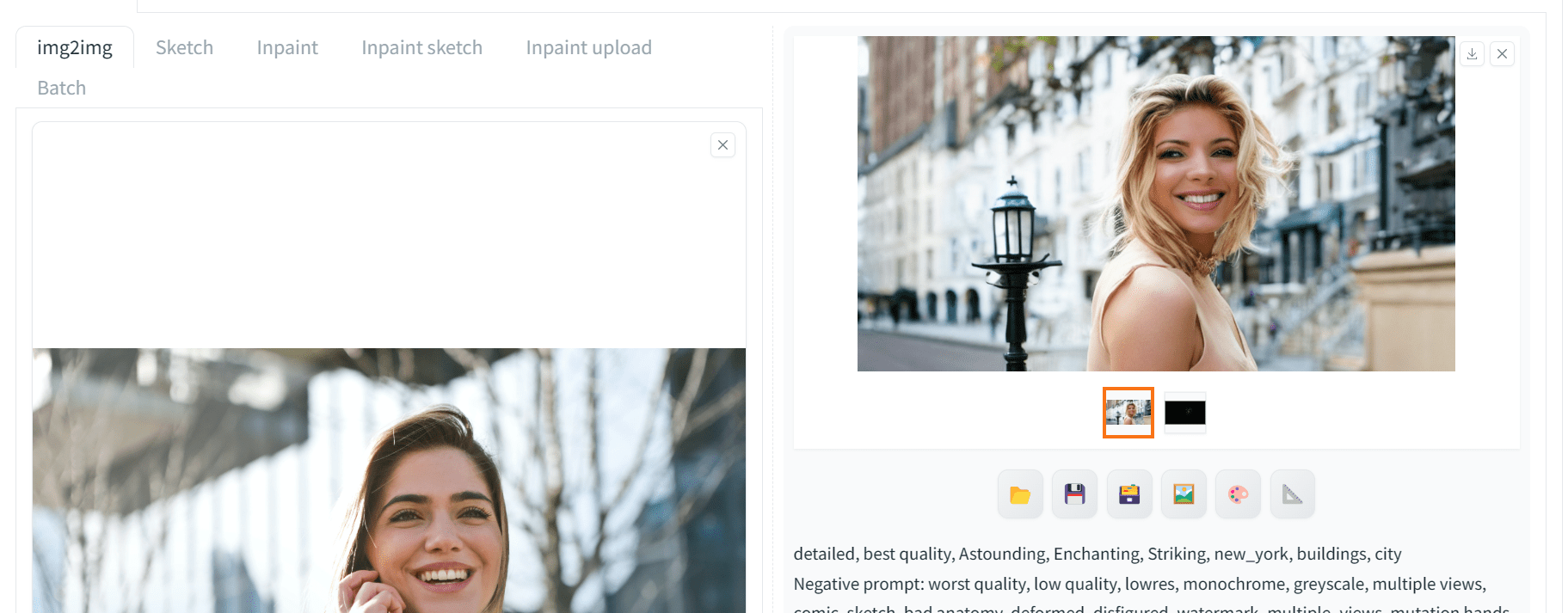

Wir werden verwenden das Foto von Andrea Piacquadio von Pexels.com als Referenzbild. Wechseln wir in der Internet-Benutzeroberfläche zur Registerkarte „img2img“ und laden Sie das Referenzbild hoch. Aktivieren Sie dann im ControlNet-Panel die Possibility „OpenPose“ und wählen Sie sie als Steuerungstyp aus. Standardmäßig geben Sie in img2img das Referenzbild für ControlNet frei. Als nächstes ändern Sie den Präprozessor im ControNet-Bedienfeld wie folgt in „openpose_face“:

Verwendung von „openpose_face“ als Präprozessor

Stellen Sie anschließend die constructive Eingabeaufforderung so ein, dass sie dem Stil des Referenzbilds entspricht, und generieren Sie das Bild. Anstelle eines Bildes, das ein Pill hält, machen wir die Frau, die ein Telefon hält:

detailliert, beste Qualität, erstaunlich, bezaubernd, auffällig, New York, Gebäude, Stadt, Telefon am Ohr

Nachfolgend finden Sie, was Sie erhalten könnten:

Bild generiert mit img2img

Wir haben mit der ähnlichen Pose ein qualitativ hochwertiges Ergebnis erzielt. Sie müssen die Eingabeaufforderung umgehen, um sie an die Pose anzupassen. Der hier verwendete Präprozessor ist „openpose_face“, was sowohl die Pose als auch das Gesicht bedeutet. Daher stimmte das erzeugte Bild sowohl hinsichtlich der Gliedmaßenpositionen als auch des Gesichtsausdrucks mit der Referenz überein.

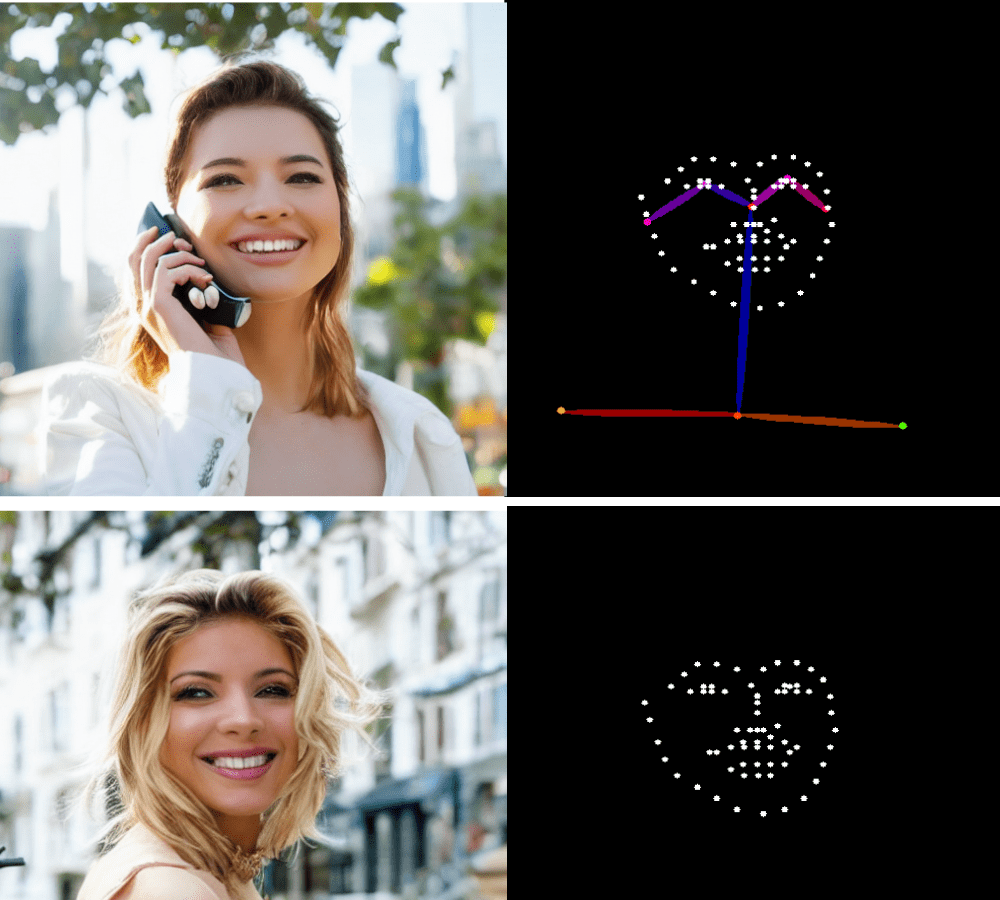

Ändern wir den Präprozessor in „openpose_faceonly“, um uns nur auf Gesichtsmerkmale zu konzentrieren. Auf diese Weise werden nur die Schlüsselpunkte im Gesicht erkannt und es werden keine Informationen über die Körperhaltung aus dem ControlNet-Modell übernommen. Stellen Sie nun die Eingabeaufforderung auf

detailliert, beste Qualität, erstaunlich, bezaubernd, auffällig, New York, Gebäude, Stadt

Durch genaues Befolgen jedes Schlüsselworts in der Eingabeaufforderung wird ein verbessertes Ergebnis generiert, die Körperhaltung unterscheidet sich jedoch erheblich von der vorherigen:

Das mit ControlNet erstellte Bild lieferte nur die Gesichts-Schlüsselpunkte

Um zu verstehen, warum dies der Fall ist, können Sie das Ausgabebild von überprüfen Präprozessor, wie folgt. Das obere Bild wurde mit dem Präprozessor „openpose_face“ generiert, während das untere Bild mit „openpose_faceonly“ generiert wurde. Ebenso können Sie die Ausgabe verschiedener Präprozessoren verstehen, indem Sie beide Skelettstrukturen analysieren.

Von verschiedenen OpenPose-Präprozessoren generierte Schlüsselpunkte

Weitere Lektüre

In diesem Abschnitt finden Sie weitere Ressourcen zum Thema, wenn Sie tiefer in die Materie einsteigen möchten.

Zusammenfassung

In diesem Beitrag sind wir tiefer in die Welt von ControlNet OpenPose eingetaucht und wie wir damit präzise Ergebnisse erzielen können. Im Einzelnen haben wir Folgendes abgedeckt:

- Was ist OpenPose und wie kann es Bilder sofort generieren, ohne etwas einzurichten?

- So verwenden Sie Steady Diffusion WebUI und OpenPose Editor, um ein Bild einer benutzerdefinierten Pose zu generieren, indem Sie das Eingabeaufforderungs- und Skelettbild ändern.

- Mehrere OpenPose-Präprozessoren zum Generieren des Bildes mithilfe von Vollgesichts- und Nur-Gesichts-Präprozessoren in der Steady Diffusion WebUI.