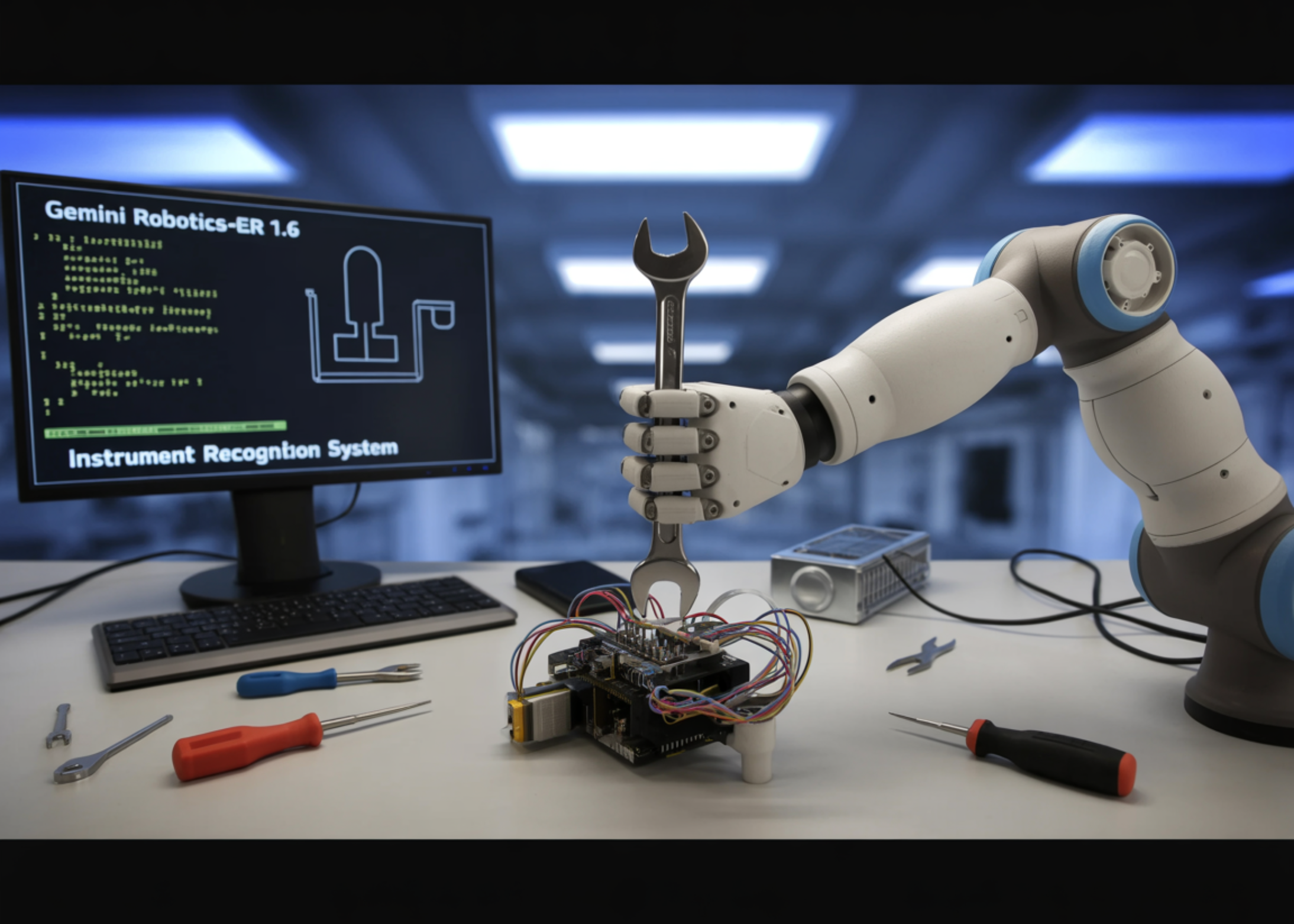

Das Google DeepMind-Forschungsteam stellte Gemini Robotics-ER 1.6 vor, eine bedeutende Verbesserung seines verkörperten Argumentationsmodells, das als „kognitives Gehirn“ von Robotern dienen soll, die in realen Umgebungen operieren. Das Modell ist auf für die Robotik entscheidende Denkfähigkeiten spezialisiert, darunter visuelles und räumliches Verständnis, Aufgabenplanung und Erfolgserkennung. Es fungiert als übergeordnetes Denkmodell für einen Roboter und ist in der Lage, Aufgaben durch den nativen Aufruf von Instruments wie der Google-Suche, Imaginative and prescient-Language-Motion-Modellen (VLAs) oder anderen benutzerdefinierten Funktionen von Drittanbietern auszuführen.

Hier ist die wichtigste architektonische Idee, die es zu verstehen gilt: Google DeepMind verfolgt einen Twin-Modell-Ansatz für Robotik-KI. Gemini Robotics 1.5 ist das Imaginative and prescient-Language-Motion (VLA)-Modell – es verarbeitet visuelle Eingaben und Benutzeraufforderungen und übersetzt sie direkt in physikalische Motorbefehle. Gemini Robotics-ER hingegen ist das Modell des verkörperten Denkens: Es ist darauf spezialisiert, physische Räume zu verstehen, zu planen und logische Entscheidungen zu treffen, steuert aber Roboterglieder nicht direkt. Stattdessen liefert es umfassende Erkenntnisse, die dem VLA-Modell bei der Entscheidung helfen, was als nächstes zu tun ist. Betrachten Sie es als den Unterschied zwischen einem Strategen und einem Testamentsvollstrecker – Gemini Robotics-ER 1.6 ist der Stratege.

Was ist neu in Gemini Robotics-ER 1.6?

Gemini Robotics-ER 1.6 zeigt deutliche Verbesserungen gegenüber Gemini Robotics-ER 1.5 und Gemini 3.0 Flash und verbessert insbesondere die räumlichen und physischen Denkfähigkeiten wie Zeigen, Zählen und Erfolgserkennung. Die wichtigste Neuerung ist jedoch eine Funktion, die in früheren Versionen überhaupt nicht vorhanden warfare: das Lesen von Instrumenten.

Zeigen als Grundlage für räumliches Denken

Das Zeigen – die Fähigkeit des Modells, präzise Positionen auf Pixelebene in einem Bild zu identifizieren – ist weitaus leistungsfähiger, als es sich anhört. Punkte können verwendet werden, um räumliches Denken (präzises Erkennen und Zählen von Objekten), relationale Logik (Vergleiche durchführen, z. B. das Identifizieren des kleinsten Parts in einer Menge oder Definieren von Von-Bis-Beziehungen wie „Bewege

In internen Benchmarks zeigt Gemini Robotics-ER 1.6 einen klaren Vorteil gegenüber seinem Vorgänger. Gemini Robotics-ER 1.6 identifiziert korrekt die Anzahl der Hämmer, Scheren, Pinsel, Zangen und Gartengeräte in einer Szene und verweist nicht auf angeforderte Gegenstände, die nicht im Bild vorhanden sind – wie etwa eine Schubkarre und einen Ryobi-Bohrer. Im Vergleich dazu erkennt Gemini Robotics-ER 1.5 nicht die richtige Anzahl an Hämmern oder Pinseln, übersieht überhaupt eine Schere und halluziniert eine Schubkarre. Für KI-Robotik-Experten ist dies wichtig, da die Erkennung halluzinierter Objekte in Roboterpipelines zu kaskadenartigen Ausfällen nachgelagerter Systeme führen kann – ein Roboter, der ein Objekt „sieht“, das nicht vorhanden ist, wird versuchen, mit leerem Raum zu interagieren.

Erfolgserkennung und Multi-View Reasoning

In der Robotik ist es genauso wichtig zu wissen, wann eine Aufgabe beendet ist, wie zu wissen, wie man sie startet. Die Erfolgserkennung dient als wichtige Entscheidungsmaschine, die es einem Agenten ermöglicht, clever zu entscheiden, ob er einen fehlgeschlagenen Versuch wiederholen oder mit der nächsten Section eines Plans fortfahren möchte.

Das ist ein schwierigeres Drawback, als es aussieht. Die meisten modernen Robotik-Setups umfassen mehrere Kameraansichten, beispielsweise einen Overhead- und einen am Handgelenk montierten Feed. Das bedeutet, dass ein System verstehen muss, wie unterschiedliche Standpunkte zu jedem Zeitpunkt und über die Zeit hinweg zusammenwirken, um ein kohärentes Bild zu ergeben. Gemini Robotics-ER 1.6 verbessert das Multi-View-Argumentation und ermöglicht eine bessere Zusammenführung von Informationen aus mehreren Kameraströmen, selbst in verdeckten oder sich dynamisch ändernden Umgebungen.

Instrumentenlesung: Ein Durchbruch in der realen Welt

Die wirklich neue Funktion in Gemini Robotics-ER 1.6 ist die Instrumentenablesung – die Fähigkeit, analoge Messgeräte, Druckmesser, Schaugläser und digitale Anzeigen in industriellen Umgebungen zu interpretieren. Diese Aufgabe ergibt sich aus den Anforderungen der Anlageninspektion, einem wichtigen Schwerpunktbereich für Boston Dynamics. Spot, ein Boston Dynamics-Roboter, ist in der Lage, Instrumente in einer Anlage zu besuchen und Bilder von ihnen aufzunehmen, die von Gemini Robotics-ER 1.6 interpretiert werden können.

Das Lesen von Instrumenten erfordert ein komplexes visuelles Denken: Man muss eine Vielzahl von Eingaben präzise wahrnehmen – einschließlich der Nadeln, des Flüssigkeitsstands, der Behältergrenzen, der Markierungen und mehr – und verstehen, wie sie alle miteinander in Beziehung stehen. Bei Schaugläsern geht es darum, abzuschätzen, wie viel Flüssigkeit das Schauglas füllt, und dabei die Verzerrung aus der Kameraperspektive zu berücksichtigen. Messgeräte enthalten in der Regel Textual content, der die Einheit beschreibt, der gelesen und interpretiert werden muss, und einige verfügen über mehrere Nadeln, die sich auf verschiedene Dezimalstellen beziehen, die kombiniert werden müssen.

Gemini Robotics-ER 1.6 erreicht seine Instrumentenwerte mithilfe von Agentic Imaginative and prescient (einer Fähigkeit, die visuelles Denken mit Codeausführung kombiniert, eingeführt mit Gemini 3.0 Flash und erweitert in Gemini Robotics-ER 1.6). Das Modell führt Zwischenschritte durch: Zuerst zoomt man in ein Bild hinein, um kleine Particulars in einem Messgerät besser ablesen zu können, dann verwendet man Zeige- und Codeausführung, um Proportionen und Intervalle abzuschätzen, und schließlich wendet man Weltwissen an, um die Bedeutung zu interpretieren.

Gemini Robotics-ER 1.5 erreicht eine Erfolgsquote von 23 % beim Instrumentenlesen, Gemini 3.0 Flash erreicht 67 %, Gemini Robotics-ER 1.6 erreicht 86 % und Gemini Robotics-ER 1.6 mit Agentic Imaginative and prescient erreicht 93 %. Ein wichtiger Vorbehalt: Gemini Robotics-ER 1.5 wurde ohne Agentic Imaginative and prescient evaluiert, da es diese Funktion nicht unterstützt. Die anderen drei Modelle wurden mit aktiviertem Agentic Imaginative and prescient für die Instrumentenleseaufgabe evaluiert, sodass der Basiswert von 23 % weniger eine Leistungslücke als vielmehr ein grundlegender architektonischer Unterschied darstellt. Für KI-Entwickler, die Modellgenerationen bewerten, ist diese Unterscheidung wichtig – Sie vergleichen nicht Äpfel mit Äpfeln in der gesamten Benchmark-Spalte.

Wichtige Erkenntnisse

- Gemini Robotics-ER 1.6 ist ein Argumentationsmodell, kein Aktionsmodell: Es fungiert als übergeordnetes „Gehirn“ eines Roboters – es kümmert sich um räumliches Verständnis, Aufgabenplanung und Erfolgserkennung –, während das separate VLA-Modell (Gemini Robotics 1.5) die eigentlichen physikalischen Motorbefehle verarbeitet.

- Zeigen ist mächtiger, als es aussieht: Die Zeigefähigkeit von Gemini Robotics-ER 1.6 geht weit über die einfache Objekterkennung hinaus – sie ermöglicht relationale Logik, Bewegungstrajektorienkartierung, Greifpunktidentifizierung und auf Einschränkungen basierendes Denken, die alle für eine zuverlässige Robotermanipulation von grundlegender Bedeutung sind.

- Die Instrumentenablesung ist die größte neue Funktion: Gemini Robotics-ER 1.6 wurde in Zusammenarbeit mit dem Spot-Roboter von Boston Dynamics für die Inspektion von Industrieanlagen entwickelt und kann jetzt analoge Messgeräte, Druckmessgeräte und Schaugläser mithilfe von Agentic Imaginative and prescient mit einer Genauigkeit von 93 % ablesen – im Vergleich zu nur 23 % bei Gemini Robotics-ER 1.5, dem diese Fähigkeit völlig fehlte.

- Die Erfolgserkennung ermöglicht echte Autonomie: Wenn ein Roboter weiß, wann eine Aufgabe tatsächlich abgeschlossen ist – über mehrere Kameraansichten, in verdeckten oder dynamischen Umgebungen –, kann er ohne menschliches Eingreifen entscheiden, ob er es erneut versucht oder mit dem nächsten Schritt fortfährt.

Schauen Sie sich das an Technische Particulars Und Modellinformationen. Sie können uns auch gerne weiter folgen Twitter und vergessen Sie nicht, bei uns mitzumachen 130.000+ ML SubReddit und Abonnieren Unser Publication. Warten! Bist du im Telegram? Jetzt können Sie uns auch per Telegram kontaktieren.

Möchten Sie mit uns zusammenarbeiten, um Ihr GitHub-Repo ODER Ihre Hugging Face Web page ODER Produktveröffentlichung ODER Ihr Webinar usw. zu bewerben? Vernetzen Sie sich mit uns